XGen-Image-1の内部:Salesforce Researchが巨大なテキストから画像へのモデルを構築、トレーニング、評価する方法

XGen-Image-1の内部:Salesforce Researchがテキストから画像へのモデルを構築、トレーニング、評価する方法

テキストから画像へのモデルの最も効率的なトレーニングプロセスの一つ。

私は最近、AIに特化した教育ニュースレターを始めました。既に16万人以上の購読者がいます。TheSequenceは、5分で読めるノン・ヒュープ(つまり、誇大宣伝やニュースなどはなし)の機械学習指向のニュースレターです。このニュースレターでは、機械学習プロジェクト、研究論文、概念について最新情報を提供します。ぜひ以下の購読ボタンから試してみてください:

TheSequence | Jesus Rodriguez | Substack

機械学習、人工知能、データの最新動向を追い続けるための最良の情報源

thesequence.substack.com

Salesforceは、新しい基盤モデルの波において最も活発な研究所の一つです。最近、Salesforce Researchは、言語、コーディング、コンピュータビジョンなど、さまざまなドメインでモデルをリリースしています。最近、彼らはXGen-Image-1という大規模なテキストから画像へのモデルを公開し、さまざまなコンピュータビジョンのタスクで最先端のパフォーマンスを示しました。Salesforce Researchは、XGen-Image-1のトレーニング方法とベストプラクティスについて詳細な情報を提供しました。今日は、それらの詳細の一部について詳しく説明します。XGen-Image-1の構築プロセスでは、戦略的な設計の選択肢やトレーニング方法論、初期の画像生成モデルに関するパフォーマンスメトリクスなど、非常に難しい決定の連続が行われました。

- モデルのトレーニング:アーキテクチャの観点から見ると、XGen-Image-1は8億6000万のパラメータを持つ潜在的な拡散モデルです。Salesforce Researchは、トレーニングにおいて、1.1億の公開データセットであるLAIONのテキスト-画像ペアを活用しました。• 解像度の管理: XGen-Image-1は、利用可能なピクセルアップサンプラーを備えた潜在的な変数オートエンコーダ(VAE)を使用し、低解像度でのトレーニングを効果的に行い、計算コストを低減しました。• コスト効率: テキストから画像へのモデルのトレーニングにおいては、常にコストが懸念されます。XGen-Image-1の場合、Salesforce Researchは、GoogleのTPUスタックを使用して、約7.5万ドルの控えめな投資で競争力のある画像生成モデルを育成できることを確立しました。• パフォーマンスの均等性: XGen-Image-1は、画像生成の優れたモデルの先駆者であるStable Diffusion 1.5および2.1と同等のパフォーマンスを示しました。• 自動的な改善: 特定の領域における自動的な改善の形で注目すべき側面が浮かび上がりました。たとえば、「顔」のような領域は改善が行われ、生成された画像が効果的に向上しました。• 推論の向上: 推論中に拒否サンプリングを統合することで、結果の品質が大幅に向上し、緻密な方法論の拡張の力を証明しました。

トレーニング

ほとんどのテキストから画像へのモデルは、独自のトレーニング方法論を開拓してきました。XGen-Image-1は、条件付け、エンコーディング、アップサンプリングの単純な課題ではなく、再利用性の範囲に焦点を当て、効率的なトレーニングの限界を探求することに重点を置いています。この独自の視点により、事前学習されたオートエンコーダとオプションのピクセルベースのアップサンプラを組み合わせることで、低解像度の生成が可能になり、壮大な画像(1024×1024)が生成されます。彼らの展望は、解像度の実用的な下限のさらなる探求にも及びます。定量的な評価は、アップサンプリングを行わないVAEフェーズの直後の256×256の時点で行われます。定性的な評価は、SDXLの「Refiner」と同様に256から64から256への「再アップサンプラ」を使用し、256から1024へのアップサンプラを使用します。

- 「ケンブリッジの研究者たちは、機械学習システムに不確実性を組み込むことを開発しています」

- ボストン大学の研究者たちは、プラチプスファミリーと称されるファインチューニングされたLLMsを公開しました:ベースLLMsの安価で高速かつパワフルな改良を実現するために

- IBMの研究者が、深層学習推論のためのアナログAIチップを紹介:スケーラブルなミックスドシグナルアーキテクチャの重要な構成要素を披露

トレーニングインフラストラクチャ

Salesforce ResearchはTPU v4を使用してモデルのトレーニングを行いました。トレーニングプロセス全体で、モデルのチェックポイントを保持するためにGoogle Cloud Storage(GCS)を利用しました。さらに、巨大なデータセットを保存するためにGloudマウントドライブを利用しました。トレーニングはv4–512 TPUマシン上で行われ、約9日間にわたって約110万ステップが実行されました。ハードウェアのコストは約73,000ドルであり、他の代替手段と比較して非常に安価です!

このプロセスは課題もありました。モデルの損失は、寛大なバッチサイズにもかかわらず、ステップごとに乱れた変動を示しました。その原因は、すべてのワーカーに対して一様なシードが行われたことによるもので、この変動性が生じました。解決策は、ランダムなシードを各ワーカーのランクに合わせて行い、ノイズステップが均等に分散し、より滑らかな損失曲線が得られるようにすることで実現しました。

評価

XGen-Image-1の評価には、CLIPスコア(プロンプトへの適合性を表すもの)をx軸に、データセット全体の外観の類似性を示すFID(Fréchet Inception Distance)をy軸に持つ二軸表現の手法が使用されました。この評価は15のガイダンススケールで行われ、初期の図では30,000の画像-プロンプトペアが関与しました。チェックポイント間の比較では、この範囲が1,000ペアに狭まります。データペアはCOCO Captionsデータセットから厳密にサンプリングされ、キャプションには「A photograph of」が追加され、異なるグラフィックスタイルに関連するFIDペナルティを軽減しました。

Salesforce Researchはまた、XGen-Image-1をベンチマークするために人間の評価も使用しました。この評価はAmazon Mechanical Turkを通じて行われ、参加者には画像とプロンプトの適合性を判断するよう求められました。精度に対する固い信念を持って、回答者は6つの異なるトライアルで1,632のプロンプトすべてに関与し、比較ごとに約10,000の回答を得る大規模なリポジトリを作成しました。

高品質な画像の生成

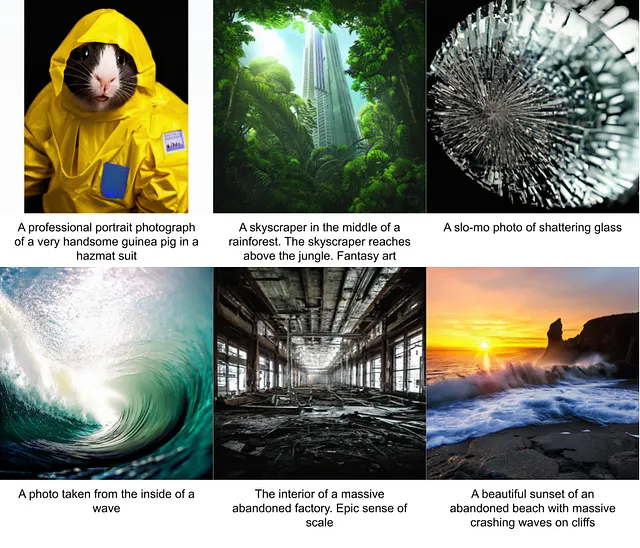

XGen-Image-1の構築の重要な部分は、高品質な画像を生成することです。このプロセスは2つのよく知られたトリックに基づいて行われました。最初の戦略は、多数の画像を生成し、最適なものを選び出すことでした。Salesforce Researchは、1つのプロンプトに対して1つの出力構造を維持するという原則を守りながら、この方法論を自動化することに取り組みました。このアプローチの探索により、複数の画像の生成と最適な候補の自動選択を含む拒否サンプリングという手法に至りました。最初は美的スコアやCLIPスコアなど、さまざまなメトリックが検討されましたが、最終的にはPickScoreが堅牢な総合メトリックであることが分かりました。このメトリックは、文献で裏付けられたように、人間の好みと驚くほど一致することが示されました。この方法論に従って、XGen-Image-1はA100 GPU上で約5秒で32枚の画像(4×8グリッド)を生成し、最も高いスコアの画像を選択します。

2つ目のテクニックは、最適でない外観を持つ領域の埋め込みによる画像の改善の模範として実現しました。

- プロンプトから抽出されたセグメンテーションマスクが対象オブジェクトを囲みます。2. セグメンテーションマスクに基づいてオブジェクトを適切に切り抜きます。3. 切り抜いた領域を拡張します。4. セグメンテーションプロンプトと一致するキャプション(例:「顔の写真」)との間でimg2img操作を行い、領域の微調整を容易にします。5. セグメンテーションマスクは、拡張された切り抜き領域を元の画像にシームレスにブレンドする際に重要な役割を果たします。これらの方法の組み合わせにより、XGen-Image-1で高品質な画像が生成されます。

XGen-Image-1は、テキストから画像を生成するモデルにおいて画期的なものではありませんが、非常に有用な貢献を提供しています。最も大きなものは、このタイプのモデルで最先端のパフォーマンスを達成するために、多くの事前学習済みのコンポーネントを再利用できることを示すことです。X-Gen-Image-1は、トレーニングの計算リソースの一部しか使用せずに、StableDiffusionと同等のパフォーマンスを達成しました。非常に印象的です。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- アップルとブリティッシュコロンビア大学のAI研究者が提案する「FaceLit:ニューラル3D再点灯可能な顔のための革新的なAIフレームワーク」

- Salesforceの研究者は、XGen-Image-1を導入しました:複数の事前学習済みコンポーネントを再利用するために訓練されたテキストから画像への潜在的な拡散モデル

- UCサンタクルーズの研究者たちは、概念や価値観間の暗黙的なステレオタイプと、画像内のそれらを定量化する画像対テキスト関連性テストツールを提案しています

- 「これまでに見たことのない新しいコンセプトをどのように生成できるのか?テルアビブ大学の研究者たちは、ConceptLabという名前の新しいアイデア生成手法を提案していますこれは拡散事前制約を用いた創造的な生成手法です」

- メタAIの研究者たちは、大規模な言語モデルの生成物を批評するための新しいAIモデルを紹介しました

- ペンシルベニア大学の研究者たちは、腎臓のマッチングを改善し、移植片の失敗リスクを減らすための機械学習戦略の開発を行っています

- バイトダンスとCMUの研究者は、AvatarVerseを紹介しますテキストの説明とポーズガイダンスの両方で制御される高品質な3Dアバターを生成するための新しいAIパイプラインです