Amazon Lexの新しい生成AI機能で、セルフサービスアシスタントを向上させましょう

「Amazon Lexの新たなAI生成機能により、セルフサービスアシスタントのパフォーマンス向上を実現しましょう」

この投稿では、Generative AIが対話型AI業界を変革している方法について話します。それにより、新しい顧客とボットビルダーの体験が提供され、Amazon Lexでの新機能もこれらの進歩を利用しています。

対話型AIの需要が増える中で、開発者は人間のような対話やFAQの処理といった高度な機能を持つチャットボットを向上させる方法を求めています。Generative AIの最新のブレイクスルーにより、自然言語理解の大幅な向上がもたらされ、対話システムがより知能的になっています。AI研究者が兆個のトークンを持つデータセットで大規模なニューラルネットワークモデルをトレーニングすることで、ボットがより複雑な質問を理解し、微妙でより自然な人間らしい応答を提供し、幅広いトピックを処理する技術を開発しました。これらの新しいGenerative AIのイノベーションにより、テキストや音声ベースのセルフサービスとしての対話型アシスタントをより自然で直感的で助けになるものにすることができます。Generative AIの急速な進歩により、自動化されたチャットボットや仮想アシスタントは、真に知能的で自由な対話を実現する目標に大幅に近づいています。ディープラーニングとニューラルネットワーク技術のさらなる進歩により、対話システムはさらに柔軟で共感性があり、人間らしさを持つものとなるでしょう。この新世代のAIパワードアシスタントは、多くのユースケースでシームレスなセルフサービス体験を提供できます。

Amazon Bedrockが対話型AIの景色を変える方法

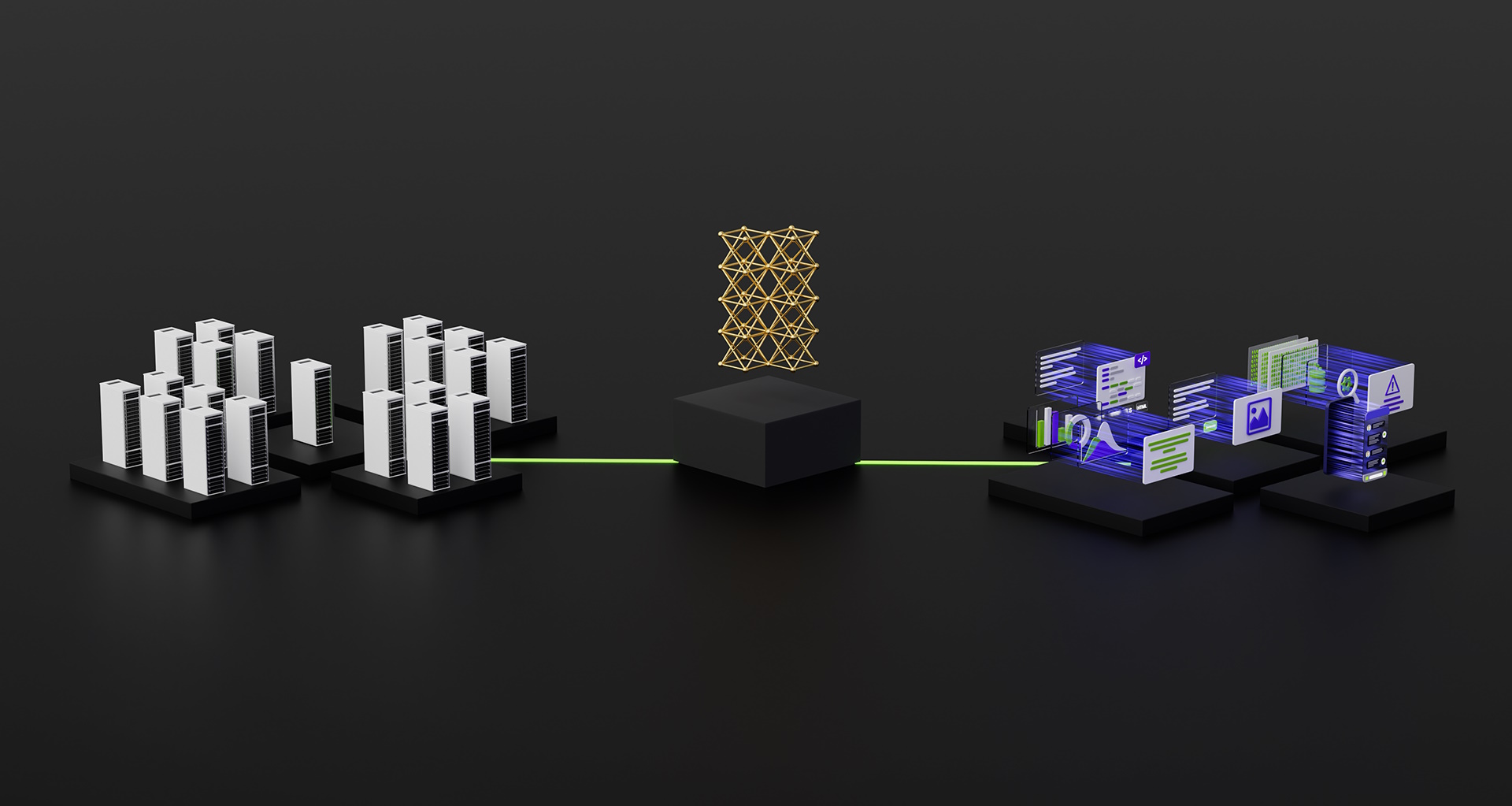

Amazon Bedrockは、基盤モデル(FM)を使用してGenerative AIアプリケーションを構築およびスケーリングするユーザーフレンドリーな方法です。 Amazon Bedrockは、主要なプロバイダーのさまざまなFMを提供しており、AWSの顧客は特定のユースケースに最適なモデルを選択して使用する柔軟性と選択肢があります。

- 「異常検知への推測を排除する:ヒストグラムが閾値を設定します」

- 「トランスフォーマーの再定義:シンプルなフィードフォワードニューラルネットワークが効率的なシーケンス・トゥ・シーケンスのタスクにおいて注意機構を模倣する方法」

- 「LQ-LoRAに会ってください:効率的な言語モデルの微調整のための低ランク量子化行列分解を可能にするLoRAの派生版」

現代の忙しい世界では、すべてのビジネスから迅速かつ効率的な顧客サービスを期待しています。しかし、問い合わせの量が人的リソースを上回る場合、優れた顧客サービスを提供することは非常に困難です。Generative AIの大規模な言語モデル(LLM)によって駆動される進歩を生かすことで、ビジネスは効率的にこの課題に取り組むことができます。

数年にわたり、AWSはAI、機械学習(ML)およびGenerative AIへのアクセスを民主化し、理解を高めるために投資してきました。 LLMは、コンタクトセンターでの自動化されたFAQへの応答、顧客の感情や意図の分析による適切なコールルーティング、エージェントを支援する会話の要約の生成、さらには一般的な顧客の問い合わせに対する自動的な電子メールやチャットの応答の生成など、非常に役立ちます。 LLMは、反復的なタスクを処理し、会話から洞察を得ることで、コンタクトセンターエージェントが個別化されたサービスと複雑な問題の解決に重点を置くことができます。

会話型FAQで顧客体験を向上させる方法

Generative AIは、対話的な方法でよくある顧客の質問に迅速かつ信頼性のある回答を提供するという非常に大きなポテンシャルを持っています。許可された知識源とLLMsにアクセスすることで、既存のAmazon Lexボットは、タスク指向の対話を超えて、有益で自然かつ正確なFAQの回答を提供できます。当社の検索強化生成(RAG)アプローチにより、Amazon Lexはリポジトリに利用可能な幅広い知識とLLMsの流暢さを活用することができます。質問を自由な形式の対話的な言語で簡単にするだけで、数秒以内に自然で適切な回答が得られます。Amazon Lexの新しい会話型FAQ機能を使用すると、ボットの開発者や会話デザイナーは、ボット内で網羅的なFAQベースの会話フローを設計する代わりに、ビジネスロジックの定義に集中することができます。

我々は、LLMを使用して許可された知識源をクエリし、意味のある文脈に基づいた回答を提供する組み込みのQnAIntentを導入しています。また、開発者はQnAIntentを設定して特定の知識ベースセクションを指すこともでき、ユーザリクエストを満たすために実行時に特定の知識コンテンツのみがクエリされるようにすることができます。この機能により、金融サービスや健康など高度に規制された業界では、コンプライアンス言語での回答のみを提供する必要があります。Amazon Lexの会話型FAQ機能により、組織はミスしたクエリや人間による代理店の移行の高コストを避けながら、コンテイメント率を向上させることができます。

記述的なボットビルダーを使用してAmazon Lexボットを作成する

ゼロからの会話ボットの構築は、潜在的なリクエストを予測し、適切な応答をコード化するために、ユーザーがボットとどのように対話するかについての深い知識が必要な、時間のかかるプロセスです。今日、会話デザイナーや開発者は、全てのユーザーアクション(インテント)、ユーザーがリクエストを表現するさまざまな方法(発話)、およびそれらのアクションを完了するためにユーザーから必要な情報(スロット)を実行するためのコードを書くために多くの日数を費やしています。

Amazon Lexの新しい記述的なボットビルディング機能は、生成的AIを使用してボットビルディングプロセスを加速させます。コードを書く代わりに、会話デザイナーやボット開発者は、ボットが達成することをプレーンな英語で記述するだけで良くなります(たとえば、「名前と連絡先情報、旅行日程、部屋タイプ、および支払い情報を使用してホテルの予約を受け付ける」など)。このシンプルなプロンプトだけで、Amazon Lexは自動的にインテント、トレーニング発話、スロット、プロンプト、および対話フローを生成して、記述されたボットを生き生きとさせます。基本的なボットデザインを提供することで、この機能は会話型チャットボットの構築の時間と複雑さを大幅に減らし、ビルダーが会話の体験を微調整するための努力を再調整することを可能にします。

Amazon Lexは、説明的なLLMを活用することで、開発者や非技術ユーザーが目標を記述するだけでボットを構築できるようにします。従来のようにインテント、発話、スロットなどを細心の注意を払ってコーディングする必要はありません。開発者は自然言語のプロンプトを提供するだけで、Amazon Lexがさらなる改善のための基本的なボットフローを自動的に生成します。この機能は初期段階では英語のみで利用可能ですが、展開前にAIによって生成されたボットを必要に応じてさらにカスタマイズすることができ、手動の開発作業を多くの時間節約することができます。

補助的なスロット解決によるユーザー体験の向上

消費者はチャットボットやインタラクティブな音声応答(IVR)システムにより馴染みが増すにつれ、セルフサービス体験にはより高度なインテリジェンスが求められるようになりました。対話的な応答の曖昧さを明確にすることは、自然で人間らしい体験を提供するための成功要素です。チャットボットの能力に対する消費者の信頼が高まる中、自然言語理解(NLU)におけるパフォーマンスの向上が期待されます。意味的に単純または複雑な発話がスロットに適切に解決されなかった場合、ユーザーの信頼は低下することがあります。そのような場合には、LLMが既存のAmazon Lex NLUモデルを動的に補助し、ユーザーの発話がスロットモデルの範囲を超えている場合でも正確なスロット解決を保証します。Amazon Lexでは、補助的なスロット解決機能により、ボット開発者は収束力を向上させるためのさらなる手段を提供されます。

実行時に、会話ターン中にNLUがスロットを解決できない場合、Amazon Lexはボット開発者が選択したLLMを呼び出してスロットの解決を支援します。LLMがスロットのリトライ時に値を提供できる場合、ユーザーは通常通り会話を続けることができます。たとえば、スロットのリトライ時にボットが「保険加入者の居住都市はどこですか?」と尋ね、ユーザーが「私はスプリングフィールドに住んでいます」と応答する場合、LLMは値を「スプリングフィールド」に解決できます。この機能では、AMAZON.City、AMAZON.Country、AMAZON.Number、AMAZON.Date、AMAZON.AlphaNumeric(正規表現なし)、AMAZON.PhoneNumber、AMAZON.Confirmationのスロットタイプがサポートされています。この機能は執筆時点では英語のみで利用可能です。

トレーニング発話生成によるビルダー体験の向上

ボットビルダーや会話デザイナーがしばしば直面する課題の1つは、インテントの呼び出しやスロット情報の要求時に応答のバリエーションと多様性を予測することです。ボット開発者が新しいインテントを作成するとき、MLモデルに訓練するためにサンプル発話を提供する必要があります。顧客が使用する措辞と文法の変化を予測することは難しいことがよくあります。Utterance generationでは、Amazon LexはAmazon Titanなどの基本モデルを使用して、プロンプトエンジニアリングの必要性なしに、ワンクリックでトレーニング発話を生成します。

Utterance generationでは、インテント名、既存の発話、およびオプションでインテントの説明を使用してLLMと共に新しい発話を生成します。ボット開発者や会話デザイナーは、生成された発話を編集または削除することができます。この機能は新規および既存のインテントの両方で使用できます。

結論

生成的AIの最近の進歩は、自動化された消費者の体験を確かに向上させました。Amazon Lexでは、生成的AIをビルダーとユーザー体験のあらゆる側面に注入することに専念しています。この投稿で言及された機能はまだ初めに過ぎないものであり、今後の展開にご期待ください。

詳細については、Amazon Lexのドキュメントを参照し、Amazon Lexコンソールでこれらの機能を試してみてください。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Amazon Personalize Next Best Actionを使用して、ユーザーにアクションを推奨することでブランドの忠誠心を構築します

- 「Amazon Personalizeと創造的AIを活用して、ハイパーカスタマイズされたお客様体験を実現しましょう」

- Amazon Transcribeは、100以上の言語に対応する新しいスピーチ基礎モデル搭載のASRシステムを発表しました

- 医療画像AIがより簡単になりました:NVIDIAがMONAIをホステッドクラウドサービスとして提供

- 効果的にLLMをトレーニングする方法:小規模な導入のためのベストプラクティス

- 「PhysGaussian(フィジカルガウシアン)に会いましょう:物理的に根拠のあるニュートン力学を3Dガウス関数に組み込むことで高品質な新世代モーションシンセシスを生み出す人工知能技術」

- 「インフレクションは、世界で最高のAIモデルであり、そのクラスのコンピューティングでは世界で2番目に能力のあるLLMです」