複数の画像やテキストの解釈 Machine learning - Section 108

このAI論文は、大規模なビジョン・ランゲージ・ナビゲーション(VLN)トレーニングのための効果的なパラダイムを提案し、パイプライン内の各コンポーネントの影響を定量的に評価しています

ビジュアルナビゲーションの学習のために、いくつかの人間のデモが収集され、最近の巨大なデータセットには数百の対話的なシ...

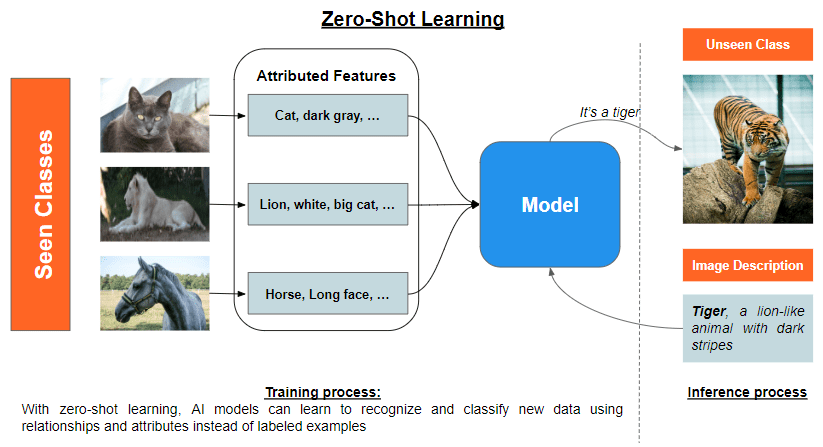

データの壁を破る:ゼロショット、ワンショット、およびフューショットラーニングが機械学習を変革している

「ゼロショット、ワンショット、そしてフューショット学習の概念を発見しましょうこれらは、機械学習モデルが限られた数の例...

「ToolLLMをご紹介します:大規模言語モデルのAPI利用を向上させるためのデータ構築とモデルトレーニングの一般的なツールユースフレームワーク」

多くのツール(API)と効率的に接続し、困難なタスクを完了するために、ツール学習は大規模な言語モデル(LLM)の潜在能力を...

AIシステム:発見されたバイアスと真の公正性への魅力的な探求

「人工知能(AI)はもはや未来の概念ではありません-それは私たちの生活の一部になっています Visaが1秒間に1,700件のトラン...

GoogleのSymbol Tuningは、LLM(Language Learning Models)におけるIn-Context Learningを行う新しいFine-Tuningテクニックです

言語モデルのスケーリングアップにより、機械学習は革命的な急増を経験し、インコンテキスト学習を通じて難しい推論タスクを...

「LP-MusicCapsに会ってください:データの乏しさ問題に対処するための大規模言語モデルを使用したタグから疑似キャプション生成アプローチによる自動音楽キャプション作成」

音楽のキャプション生成は、与えられた音楽トラックの自然言語による説明を生成することによる音楽情報の検索です。生成され...

大規模な言語モデルを税理士として活用する:このAI論文は、税法の適用におけるLLMの能力を探求します

AIの進歩が進んでいます。大規模言語モデル(LLM)は急速に進化しています。現代のLLMは、ツールを使用し、計画を立て、標準...

ロラハブにお会いしましょう:新しいタスクにおいて適応性のあるパフォーマンスを達成するために、多様なタスクでトレーニングされたロラ(低ランク適応)モジュールを組み立てるための戦略的なAIフレームワーク

大規模な事前学習言語モデル(LLM)であるOpenAI GPT、Flan-T5、LLaMAは、NLPの急速な進歩に大きく貢献してきました。これら...

モジラのコモンボイスでの音声言語認識 — Part I.

「話者の言語を特定することは、後続の音声テキスト変換のために最も困難なAIのタスクの一つですこの問題は、例えば人々が住...

「マスタリングモンテカルロ:より良い機械学習モデルをシミュレーションする方法」

モンテカルロ:統計的シミュレーションが機械学習を支える方法、πの推定からハイパーパラメータの最適化までPythonでこの多目...

- You may be interested

- 線形代数4:行列方程式

- HNSW(Hierarchical Navigable Small Worl...

- このAI研究では、BOFT(Foundationモデル...

- 「GANが人工的なセレブリティのアイデンテ...

- マイクロソフトの研究者たちは、人間のフ...

- 「抗議を取り締まっているロシアは、監視...

- 「視覚化された実装と共に、Graph Attenti...

- 私たちは本当に人工知能AIウォーターマー...

- データサイエンスへのゲートの解除:GATE ...

- 「新しいコードが量子コンピューティング...

- 「飛躍的進展:UCCの研究者が量子コンピュ...

- 「カーシブと出会う:LLMとのインタラクシ...

- 「形を変える繊維が変形する生地を生み出す」

- In Japanese ゼファー7Bベータ:必要な...

- 「言語モデルにおける連鎖思考推論の力を...

Find your business way

Globalization of Business, We can all achieve our own Success.