「思考伝搬:大規模言語モデルを用いた複雑な推論の類推的手法」

「美とファッション:複雑な推論の類推的手法における大規模言語モデルの活用」

重要なポイント

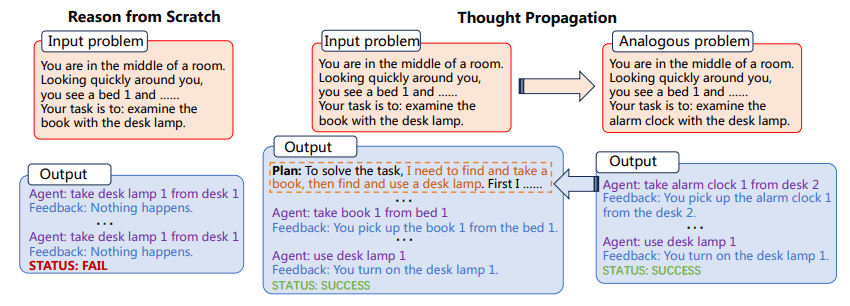

- Thought Propagation(TP)は、大規模言語モデル(LLM)の複雑な推論能力を高める新しい手法です。

- TPは、LLMがゼロから推論するのではなく、類似の問題とその解決策を活用して推論を改善します。

- さまざまなタスクでの実験結果は、TPがベースラインの手法を大幅に上回り、改善率が12%から15%に及ぶことを示しています。

TPは、最初にLLMに入力問題に関連する一連の類似の問題を提案し、解決させます。その後、TPは類似の問題の結果を再利用して、新しい解決策を直接的に提供するか、ゼロから得られた初期解決策を修正するための知識集約型の実行計画を導きます。

イントロダクション

大規模言語モデル(LLM)の汎用性と計算能力は否定できませんが、限界も存在します。LLMの最も重要かつ一貫した課題の1つは、新しいタスクごとに最初の原則からの推論を行う一般的なアプローチです。これは適応性が高くなりますが、特に多段階の推論を必要とするタスクでは、エラーの可能性が高まります。

「ゼロから推論する」という課題は、ロジックと推論の複数のステップを必要とする複雑なタスクに特に顕著です。たとえば、LLMに対してネットワーク内の接続ポイントの最短経路を見つけるように依頼した場合、通常は前の知識や類似の問題を活用して解決策を見つけることはありません。代わりに、孤立した問題を解決しようとするため、最適でない結果や明白なエラーが発生する可能性があります。ここに「Thought Propagation」(TP)が登場します。TPは、LLMの推論能力を向上させるために設計された手法で、類似の問題とそれに対応する解決策を活用します。この革新的な手法は、LLMによる解決策の正確性を向上させるだけでなく、多段階で複雑な推論タスクに取り組む能力も大幅に向上させます。TPはアナロジーの力を活用し、LLMの固有の推論能力を増幅するフレームワークを提供し、真にインテリジェントな人工システムの実現に一歩近づくのです。

Thought Propagationの理解

Thought Propagationには主に2つのステップがあります:

- まず、LLMに入力問題に関連する一連の類似の問題を提案し、解決させます

- 次に、これらの類似の問題の解答を使用して、新しい解答を直接的に提供するか、初期解答を修正します

類似の問題を特定するプロセスにより、LLMは問題解決の戦略と解答を再利用することができ、推論能力を向上させることができます。TPは既存のプロンプト手法と互換性があり、重要なタスク特有のエンジニアリングを行わずにさまざまなタスクに組み込むことができる汎用的な解決策を提供します。

さらに、TPの適応性は過小評価できません。既存のプロンプト手法との互換性により、非常に柔軟なツールとなります。これにより、TPは特定の種類の問題解決領域に限定されることはありません。これにより、タスク固有の微調整と最適化の魅力的な可能性が生まれ、さまざまなアプリケーションの幅広い範囲でLLMの効用と効果を高めることができるのです。

Thought Propagationの実装

Thought Propagationの実装は、既存のLLMのワークフローに統合することができます。たとえば、最短経路推論タスクでは、TPはまず、さまざまな可能性のある経路を理解するため、より簡単な類似の問題のセットを解決します。次に、これらの知見を使用して複雑な問題を解決し、最適な解決策を見つける可能性を高めます。

例1

- タスク:最短経路推論

- 類似の問題:ポイントAからポイントBへの最短経路、ポイントBからポイントCへの最短経路

- 最終的な解決策:類似の問題の解答を考慮したポイントAからCへの最適経路

例2

- タスク: クリエイティブライティング

- 類似の問題: 友情についての短編小説を書く, 信頼についての短編小説を書く

- 最終的な解決策: 友情と信頼のテーマを統合した複雑な短編小説を書く

このプロセスでは、まず類似の問題を解決し、得られた洞察を使って複雑な課題に取り組みます。この方法は複数のタスクでその効果を示しており、パフォーマンスの指標において大幅な改善が見られています。

Thought Propagationの意義は、既存の指標を単に改善することを超えています。この促し技術は、LLMの理解と展開方法を変える可能性を持っています。この方法論は、孤立した、個別的な問題解決からより包括的で相互に関連するアプローチにシフトすることを強調しています。これにより、データだけでなく問題解決のプロセスからも学ぶことができるようになったLLMは、予測できない課題に対処する準備ができ、急速に変化する環境でより強靱で適応性のあるものとなります。

結論

Thought Propagationは、LLMの能力を向上させることを目的とした促し方法のツールボックスに有望な追加です。類似の問題とその解決策を活用することにより、TPはより繊細で効果的な推論方法を提供します。実験はその効果を確認しており、さまざまなタスクでLLMのパフォーマンスを向上させるための候補戦略となっています。TPは、より能力のあるAIシステムを探求する上で、重要な進歩となる可能性があります。

****[Matthew Mayo](https://www.kdnuggets.com/wp-content/uploads/./profile-pic.jpg)**** (@mattmayo13) は、コンピュータサイエンスの修士号とデータマイニングの大学院修了証を持っています。VoAGIの編集長として、Matthewは複雑なデータサイエンスの概念を理解しやすくすることを目指しています。彼の専門的な興味は、自然言語処理、機械学習アルゴリズム、新興のAIの探求にあります。彼はデータサイエンスコミュニティにおける知識の民主化を使命としています。Matthewは6歳からコーディングを始めています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「総合的な指標を通じて深層生成モデルのエンジニアリング設計評価を向上させる」

- ユリーカに会ってください:大規模な言語モデルでパワードされた人間レベルの報酬設計アルゴリズム

- 「3D-GPT(3D-指示駆動型モデリングのための人工知能フレームワーク)に会ってください 大規模な言語モデル(LLM)を利用した指示駆動型3Dモデリングのための人工知能フレームワーク」

- 「ファストテキストを使用したシンプルなテキスト分類」となります

- 「16/10から22/10までの週のトップ重要なコンピュータビジョン論文」

- 「前例のない緊急事態下でのオンライン機械学習による流水下水の influent(流入)流量予測」

- [GPT-4V-Actと出会いましょう:GPT-4V(ision)とウェブブラウザを調和させたマルチモーダルAIアシスタント]