スタンフォードの研究者たちは「CORNN」という機械学習手法を紹介します:大規模な脳神経記録のリアルタイム分析のためのものです

「CORNN」という機械学習手法による大規模な脳神経記録のリアルタイム分析 - スタンフォードの研究者が紹介

技術の進歩により、神経科学の研究分野では新たな時代を迎えました。この非凡な力により、生物の脳機能と行動の微妙な関係をより深く理解することが可能になりました。神経科学の研究では、ニューロンのダイナミクスと計算機能の間に重要なつながりがあります。科学者たちは、光学的または電気生理学的な画像化技術によって取得された大規模なニューラルレコーディングを使用して、ニューロン集団ダイナミクスの計算構造を理解するためにこれらを利用します。

近年、さまざまな記録法の新しい進展により、より多くの細胞を記録し操作する能力が向上しました。その結果、さまざまな記録手法によって生成される巨大なデータセットを効率的に分析できる理論的および計算的ツールの必要性が高まっています。特に単一の細胞や小規模な細胞グループを記録する場合、手動で構築されたネットワークモデルが使用されてきましたが、これらのモデルは現代の神経科学で生成される大規模なデータセットを管理するのは困難でした。

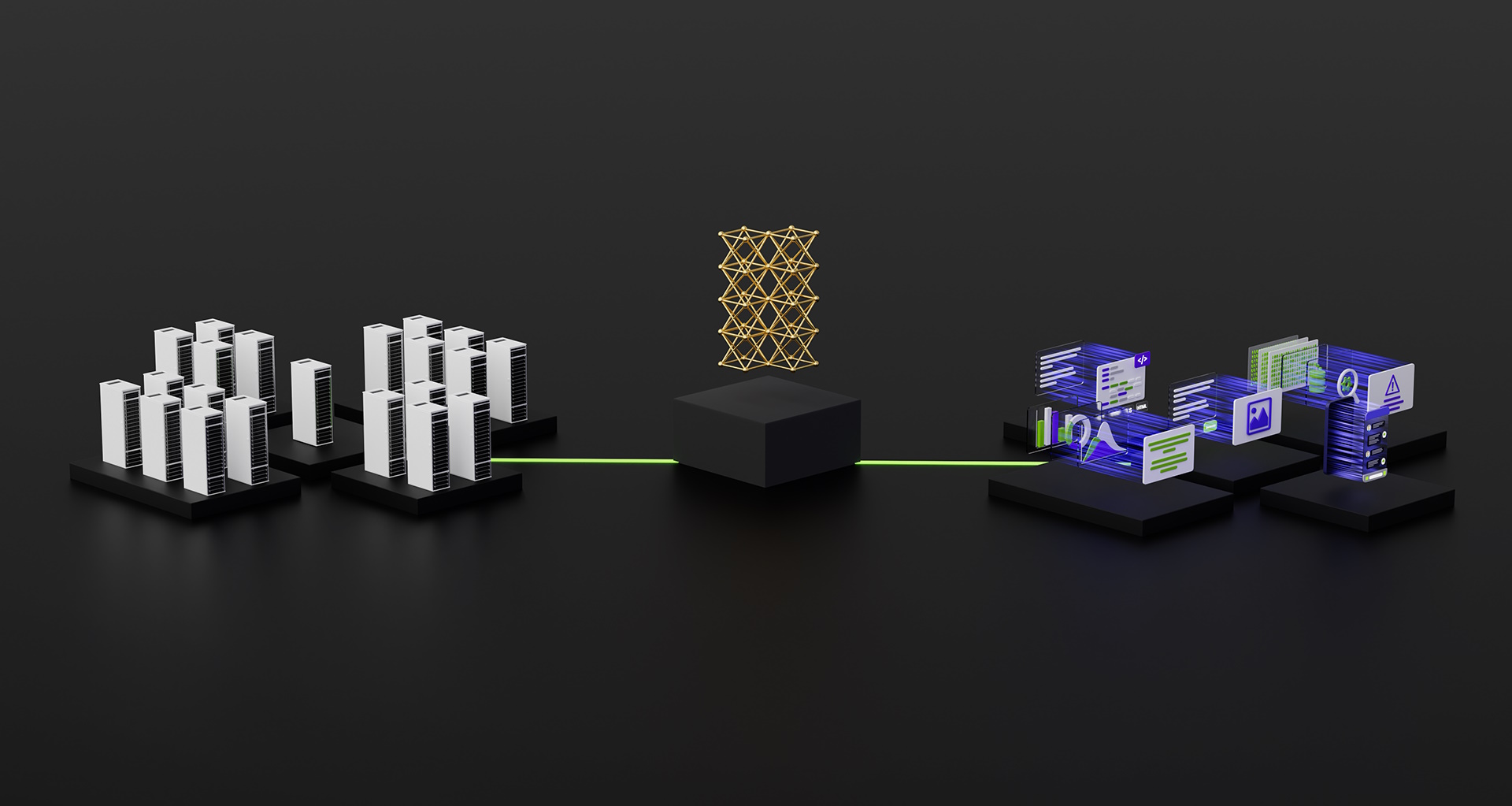

これらの大規模なデータセットから計算原理を導くために、研究者たちはデータ制約再帰ニューラルネットワーク(dRNN)をトレーニングするためのアイデアを提案しました。その目的は、リアルタイムでこのトレーニングを行い、医療応用や研究手法において単一細胞の分解能で治療をモデル化・調節することで特定の動物行動タイプに影響を与えることです。しかし、現在のdRNNトレーニング方法の限定的なスケーラビリティと効率の低さは、広範な脳レコーディングの分析を妨げる障害となっています。

- 「Johns Hopkins Medicineの研究者たちは、正確な骨肉腫壊死計算のための機械学習モデルを開発しました」

- スタンフォード大学の研究者がRT-Sketchを紹介します:目標仕様としての手描きスケッチを通じた視覚模倣学習の向上

- UCSDの研究者が、チューリングテストでのGPT-4のパフォーマンスを評価:人間のような欺瞞とコミュニケーション戦略のダイナミクスを明らかにする

これらの課題を克服するために、研究チームはConvex Optimisation of Recurrent Neural Networks(CORNN)という独自のトレーニング技術を提案しました。CORNNは従来の最適化技術の非効率性を排除することで、トレーニングの速度とスケーラビリティを向上させることを目指しています。シミュレートされた記録調査において、CORNNは従来の最適化技術に比べてトレーニング速度が約100倍速く、モデリングの正確性を損なうことなく、むしろ向上させる結果を示しています。

研究者たちは、CORNNの有効性を、タイミング応答や3ビットフリップフロップの実行など、基本的な操作を行う数千の細胞が含まれるシミュレーションを使用して評価しました。これは、CORNNが複雑なニューラルネットワークのジョブを処理する能力の高さを示しています。研究者たちはまた、CORNNがアトラクタ構造とネットワークダイナミクスを再現する能力が非常にロバストであることを示しています。CORNNは、ニューラルタイムスケールの食い違いや、観測されるニューロンの極度のサブサンプリング、またはジェネレータと推論モデルの非互換性などの障害に直面しても、正確かつ信頼性のある結果を生み出す能力を示しています。

結論として、CORNNは通常のコンピュータ上で数百万のパラメータを持つdRNNをサブミニットの処理速度でトレーニングすることができるため、その重要性は大きいです。この達成は、広範なニューロン記録によって制限されるリアルタイムネットワーク再現への重要な第一歩を示しています。CORNNによって大規模なニューラルデータセットのより速く、よりスケーラブルな研究が可能になることで、ニューラルコンピューティングの理解が向上する可能性を秘めた強力な計算ツールとしての位置づけがされています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- マイクロソフトの研究者たちは「エモーションプロンプト」を発表しました:複数の言語モデルにおけるAIの感情的知性を向上させる

- インテルの研究者たちは、CPU上でLLMs(Large Language Models)をより効率的に展開するための新しい人工知能のアプローチを提案しています

- マイクロソフトの研究者たちは、FP8混合精度トレーニングフレームワークを公開しました:大規模な言語モデルのトレーニング効率を超高速化します

- 「MIT研究者がLILOを導入:プログラム合成のための解釈可能なライブラリを学ぶための神経シンボリックフレームワーク」

- アマゾンの研究者がフォーチュナを紹介:ディープラーニングにおける不確実性量子化のためのAIライブラリ

- 「ハギングフェイスの研究者たちは、Distil-Whisperを紹介しました:高性能でリソースが限られた環境におけるギャップを埋めるコンパクトな音声認識モデル」

- このAI研究は、単一の画像を探索可能な3Dシーンに変換する、パノラマニックNeRF(PERF)を紹介します