Learn more about Search Results 7 参考文献: - Page 6

- You may be interested

- シミュレーション106:ネットワークを用い...

- 「Tracememを使用して、Pythonのセッショ...

- AIが私のいとこのような運動障害を持つ人...

- 「機械学習とAIが偽のレビューを迅速に検...

- 「Pythonでの日付と時刻の効果的なコーデ...

- 会社独自のChatGPTを開発するには、技術の...

- 「LangChain、Activeloop、そしてGPT-4を...

- 「MLを学ぶ勇気:F1、再現率、適合率、ROC...

- SparkとPlotly Dashを使用したインタラク...

- Hugging Face Optimumを使用して、Transfo...

- 「日常的な言葉で説明された最も一般的な...

- 「クルーズ、サンフランシスコでの自動運...

- 基本に戻る週3:機械学習の紹介

- 統計分析入門ガイド | 5つのステップと例

- ディープラーニングを使用した自動音楽生成

「Pythonによる(バイオ)イメージ解析:Matplotlibを使用して顕微鏡画像を読み込み、ロードする」

過去20年間、光学顕微鏡の分野は、共焦点レーザースキャニング顕微鏡(CLSM)などの画期的な技術の導入により、注目すべき進歩を遂げました...

イネイテンスとは何か?人工知能にとって重要なのか?(パート2)

「生物学と人工知能における先天性の問題は、人間のようなAIの将来にとって重要ですこの2部構成の深い探求は、この概念とその応用についての議論を解消するかもしれません...」

トランスフォーマーにおける対比的探索を用いた人間レベルのテキスト生成 🤗

1. 紹介: 自然言語生成(テキスト生成)は自然言語処理(NLP)の中核的なタスクの一つです。このブログでは、現在の最先端のデコーディング手法であるコントラスティブサーチを神経テキスト生成のために紹介します。コントラスティブサーチは、元々「A Contrastive Framework for Neural Text Generation」[1]([論文] [公式実装])でNeurIPS 2022で提案されました。さらに、この続編の「Contrastive Search Is What You Need For Neural Text Generation」[2]([論文] [公式実装])では、コントラスティブサーチがオフザシェルフの言語モデルを使用して16の言語で人間レベルのテキストを生成できることが示されています。 [備考] テキスト生成に馴染みのないユーザーは、このブログ記事を詳しくご覧ください。 2.…

行動の組み合わせによる高速強化学習

新しいレシピを学ぶたびに、切る・皮をむく・かき混ぜる方法を再び学ばなければならないとしたらどうでしょうか多くの機械学習システムでは、新たな課題に直面するときに、エージェントは完全にゼロから学ばなければなりませんしかし、明らかなことは、人々はこれよりも効率的に学ぶことができるということです彼らは以前に学んだ能力を組み合わせることができます有限の単語の辞書がほぼ無限の意味を持つ文に再構成されるように、人々は既に持っているスキルを再利用し再組み合わせして新しい課題に取り組むのです

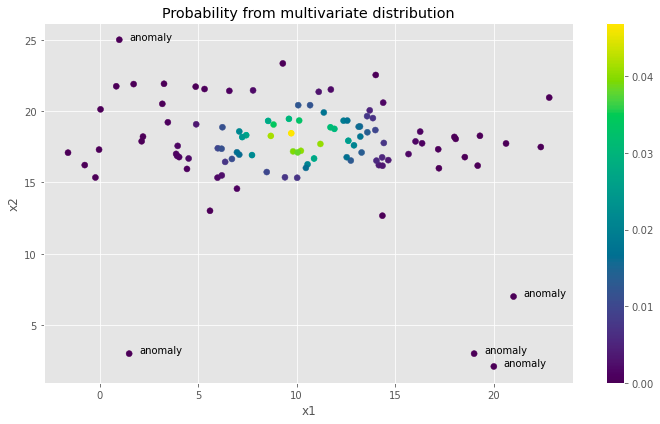

多変量ガウス分布による異常検知の基本

私たちの生まれつきのパターン認識能力によって、私たちはこのスキルを使って抜け落ちた部分を埋めたり、次に何が起こるかを予測したりすることができますしかし時折、私たちの予測に合わないことが起こります...

ニューラルネットワークにおける活性化関数の種類

ニューラルネットワークの活性化関数は、ディープラーニングの重要な部分であり、トレーニングモデルの精度と効率を決定します。大規模なニューラルネットワークの作成や分割に使用されるモデルとディープラーニングモデルの出力を決定します。活性化関数は、関連するデータに焦点を当てながら、他のデータを破棄するため、ニューラルネットワークにとって貴重なツールです。他の関数と同様に、活性化関数(転送関数)は入力を受け取り、その入力に比例する出力を返します。ニューラルネットワークのノードの活性化関数は、特定の入力または入力グループに対するノードの出力を指定します。 意図した結果を達成するために、どのニューロンを活性化または非活性化するか効果的に選択します。入力も非線形に変換され、高度なニューラルネットワークでのパフォーマンスが向上します。1から-1までの情報は、活性化関数で出力を正規化することができます。ニューラルネットワークは通常、何百万ものデータポイントでトレーニングされるため、活性化関数が高速であり、結果を計算するために必要な時間を最小限に抑えることが重要です。 さて、ニューラルネットワークの構造を確認し、ニューラルネットワークアーキテクチャがどのように組み立てられ、ニューラルネットワークにどの要素が存在するかを見てみましょう。 人工ニューラルネットワークは、多くのリンクされた個々のニューロンを含んでいます。各ニューロンの活性化関数、バイアス、および重みが指定されます。 入力層 – ドメインの生データが入力層に送られます。この層は計算が行われる最も低いレベルです。これらのノードが行う唯一のことは、データを次の隠れ層に中継することです。 隠れ層 – 入力層から特徴を受け取った後、隠れ層はさまざまな計算を行い、結果を出力層に渡します。レイヤー2のノードは表示されず、基礎となるニューラルネットワークの抽象化レイヤーを提供します。 出力層 – ネットワークの隠れ層の出力がこの層でまとめられ、ネットワークの最終的な値が提供されます。 活性化関数の重要性 線形方程式は1次の多項式であるため、活性化関数を持たないニューラルネットワークは単なる線形回帰モデルです。解くのは簡単ですが、複雑な問題や高次の多項式に対処する能力は制限されています。 活性化関数は、ニューラルネットワークに非線形性を提供するために使用されます。活性化関数の計算は、順伝播の各層で追加のステップを行いますが、その手間は十分に報われます。 活性化関数がない場合、各ニューロンは重みとバイアスを使用して入力に対する線形変換を行います。2つの線形関数の合成は、それ自体が線形関数です。したがって、ニューラルネットワークの隠れ層の総数はその動作に影響を与えません。 活性化関数の種類 ニューラルネットワークは、異なる活性化関数が使用される3つの主要な部分に分類されます。 バイナリステップ関数 線形関数 非線形活性化関数 バイナリステップニューラルネットワークの活性化関数 バイナリステップ関数…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.