MITとETH Zurichの研究者たちが、動的なセパレータの選択を通じて、拡張された混合整数線形計画法(MILP)の解決を目的とした機械学習技術を開発しました

「MITとETH Zurichの研究者による、拡張混合整数線形計画法(MILP)の解決を目的とした動的セパレータの選択に基づく機械学習技術の開発」

複雑な最適化問題に効率的に取り組むことは、グローバルパッケージルーティングから電力グリッド管理まで、持続的な課題です。伝統的な方法である混合整数線形計画(MILP)ソルバーは、複雑な問題を分解するための重要なツールとして使用されてきました。しかし、計算の集中度には課題があり、しばしば最適でない解決策や長時間の解決につながります。これらの制約に対応するため、MITとETHチューリッヒの研究者は、革新的なデータ駆動型機械学習技術を開発し、複雑な物流上の課題へのアプローチと解決方法を革新するという約束を果たしました。

最適化が重要な物流業界では、課題は困難です。サンタクロースが魔法のソリとトナカイを持っていたとしても、FedExのような企業は効率的に休暇のパッケージを配送する迷路と戦っています。企業が使用するソフトウェアの骨子であるMILPソルバーは、多大な最適化問題を分解するための分割統治アプローチを採用しています。しかし、これらの問題の複雑さは、解決にかかる時間が数時間、または数日に及ぶことがしばしばです。時間的な制約から、企業はソルバーの途中で解決を中断し、時間制約による最適でない解決策に妥協することがしばしばあります。

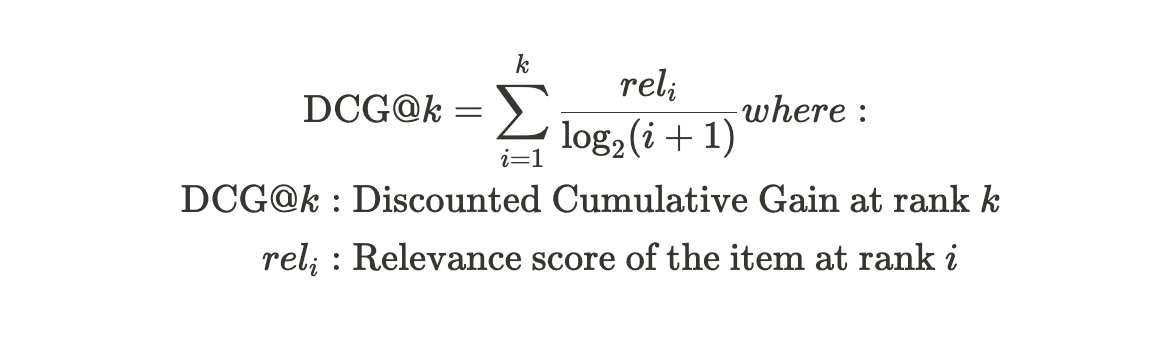

研究チームは、解決時間の長さに重要な中間ステップをMILPソルバーで特定しました。このステップはセパレータ管理と呼ばれるもので、すべてのソルバーの中核的な要素ですが、しばしば見過ごされがちです。セパレータ管理は、セパレータアルゴリズムの理想的な組み合わせを特定する負担の多い問題です。これに気付いた研究者たちは、MILPソルバーにデータ駆動型アプローチを取り込むことを目指しました。

- AI2とワシントン大学の研究者が、LLMsの表面的な性質を明らかにし、チューニングフリーの新しい方法であるURIALを紹介した

- 最近の人類学的研究によれば、クロード2.1の戦略的な促進を通じて、プロンプトに単一の追加をすることで、LLMsの記憶容量を70%増加させることができると報告されました

- MITとFAIR Metaの研究者は、「組織化された条件つき画像生成 (Representation-Conditioned Image Generation; RCG):クラス非依存の画像生成における画期的なAIフレームワーク」を発表しました

既存のMILPソルバーは、一般的なアルゴリズムと技術を使用して広範な解の空間をナビゲートしています。しかし、MITとETHチューリッヒのチームは、セパレータ検索空間を合理化するためのフィルタリングメカニズムを導入しました。彼らは約20のオプションに抑え込まれた圧倒的な130,000の潜在的な組み合わせを減らしました。このフィルタリングメカニズムは、限界効果減少の原則に基づいており、最も利益が得られるのはごく少数のアルゴリズムであると主張しています。

この革新的な飛躍は、機械学習をMILPソルバーフレームワークに統合することにあります。研究者は、問題固有のデータセットでトレーニングされた機械学習モデルを使用して、狭められたオプションから最適なアルゴリズムの組み合わせを選択しました。事前定義された設定を持つ従来のソルバーとは異なり、このデータ駆動型アプローチにより、企業は自社のデータを活用して一般的なMILPソルバーを特定の問題に適合させることができます。たとえば、FedExのようにルーティング問題を定期的に解決する企業は、過去の経験から実際のデータを使用してソリューションを洗練させることができます。

機械学習モデルは、コンテキストベースのバンディット、リインフォースメントラーニングの形態で動作します。この反復学習プロセスでは、潜在的なソリューションを選択し、その効果についてフィードバックを受け取り、後続の反復で洗練されます。結果として、MILPソルバーの劇的な高速化が実現し、正確性が損なわれることなく、30%から驚異的な70%までの範囲で達成されます。

総括すると、MITとETHチューリッヒの共同研究は、最適化分野での重要なブレイクスルーを成し遂げました。古典的なMILPソルバーと機械学習を結びつけることにより、研究チームは複雑な物流上の課題に取り組むための新たな道を開拓しました。解決時間を短縮しつつ精度を維持する能力は、MILPソルバーに実用的な優位性をもたらし、実世界のシナリオにより適用されるようになります。この研究は最適化の領域に貢献し、複雑な実世界の問題の解決に機械学習の広範な統合の舞台を提供しています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「このAI研究は、姿勢オブジェクト認識を次のトークン予測として新しいアプローチを提案します」という意味です

- 新しいCMUとMetaによるAI研究、PyNeRFの導入:スケールに意識したグリッドベースのレンダリングにおけるニューラル輝度場の進化

- マイクロソフトの研究者が提案するTaskWeaver:LLMを活用した自律エージェントの構築のためのコード優先の機械学習フレームワーク

- イリノイ大学の研究者は、コードのための完全なオープンソース大規模言語モデル(LLM)のシリーズであるマジコーダを紹介しました

- Amazon AlexaのAI研究者がQUADRoを発表:QAシステムの向上に向けた画期的なリソースで、440,000以上のアノテーション付きの例があります

- 『Google AI Researchが効率的な連成振動子のシミュレーションに革新的な量子アルゴリズムを導入』

- 「DARPA資金による研究が量子コンピューティングの飛躍的進展をもたらす」