メタAIは、122の言語に対応した初の並列読解評価ベンチマーク「BELEBELE」をリリースしました

MetaAI has released the first parallel reading comprehension evaluation benchmark, 'BELEBELE', which supports 122 languages.

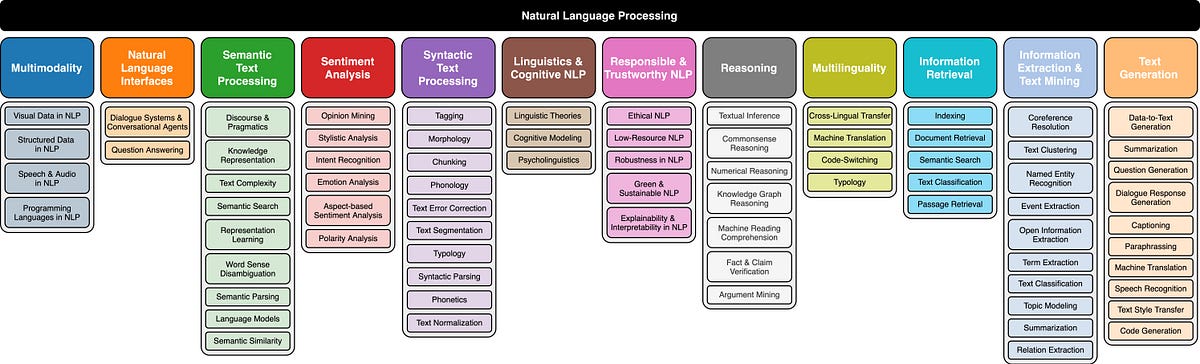

多言語モデルのテキスト理解能力を評価する上での重要な課題は、高品質で同時的な評価基準の不足です。FLORES-200などの高カバレッジの自然言語処理データセットがありますが、それらは主に機械翻訳に使用されています。100以上の言語が理解や生成テキストサービスを使用していますが、ラベル付きデータの不足は、ほとんどの言語で効果的なシステムを構築する上で重要な障壁となっています。

低リソース言語のためのNLPシステムの効率的かつ成功した開発を可能にするためには、LLM以外の重要な科学研究が必要です。多くのモデリングアプローチが言語に依存しないと主張していますが、それらの適用範囲はしばしば一部の言語でのみテストされます。

Meta AI、Abridge AI、およびReka AIによる新たな研究では、122の異なる言語バリエーションを横断して自然言語理解システムを評価するための重要なベンチマークであるBELEBELEが公開されました。データセットの各488パラグラフは、データセット全体の900の質問に対応しています。質問は言語理解能力の異なるモデルを区別し、注意深く作成されています。これらの質問は高い知識や推論を必要とはしませんが、一般化可能なNLUモデルを奨励し、バイアスのあるモデルを故意にペナルティを与えるように設計されています。英語で行われる質問は人間によってほぼ完璧な精度で回答することができます。さまざまなモデルの出力は、これがよく知られたLLMベンチマークであるMMLUと同様の識別的なNLUの課題であることを示しています。

- 機械学習:中央化とスケーリングの目的を理解する

- 「AIは本当に低品質な画像から顔の詳細を復元できるのでしょうか? DAEFRとは何か:品質向上のためのデュアルブランチフレームワークに出会う」

- 「マイクロソフトが、自社の新しい人工知能搭載スマートバックパックに関する特許を申請」

BELEBELEシステムは、その種としては初めてであり、すべての言語で並列になっています。これにより、言語間でモデルの性能を直接比較することができます。データセットには29の文字システムと27の言語ファミリが含まれており、さまざまなリソースの利用可能性と言語の多様性を表しています。ヒンディー語、ウルドゥー語、ベンガル語、ネパール語、シンハラ語のローマ字化バージョンのための最初の自然言語処理(NLP)ベンチマークの一つは、これらの7つの言語を2つの異なるスクリプトで書かれたものに基づいています。

データセットの並列性により、さまざまな言語間シナリオでクロスリンガルなテキスト表現を評価することができ、単言語および多言語モデルの評価に使用することができます。タスクは、比較可能なQAデータセットからトレーニングセットを組み合わせてフルファインチューニングによって評価することができます。研究者たちは、多言語間および英語と他の言語間の翻訳のために多数のマスク言語モデル(MLM)を使用しています。ファイブショットのコンテキスト学習とゼロショット(言語内および翻訳テスト)評価を使用して、LLMのさまざまなモデルを比較しています。

研究結果は、英語中心のLLMが30以上の言語に広がり、VoAGIおよび低リソース言語で訓練されたモデルが大きな語彙サイズとバランスの取れた事前トレーニングデータの恩恵を最も受けることを示しています。

チームは、彼らの研究が既存のモデルアーキテクチャとトレーニング方法を改善するのに役立つことを願っています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- このAI論文は、大規模な言語モデルにおける長期的な会話の一貫性を向上させるための再帰的なメモリ生成手法を提案しています

- 「フラミンゴとDALL-Eはお互いを理解しているのか?イメージキャプションとテキストから画像生成モデルの相互共生を探る」

- 自動小売りチェックアウトは、ラベルのない農産物をどのように認識するのか? PseudoAugmentコンピュータビジョンアプローチとの出会い

- 専門家モデルを用いた機械学習:入門

- 「Amazon SageMakerでのRayを使用した効果的な負荷分散」

- 『ご要望に合わせたチャット:ソフトウェア要件に応用した生成AI(LLM)の旅』

- プラグインを使ったチャットボットのためのカスタムスキルの作成