「MindGPTとは、fMRI信号から察知された視覚刺激を自然言語に解釈する非侵襲的な神経デコーダーです」

『MindGPT』:脳神経デコーダーが描き出す視覚刺激を自然な言葉に変換

他の人とコミュニケーションを取るために、人間は外界で見たことを説明するために限られた量の言葉しか使うことができません。この適応性のある認知能力は、言語を介して伝達される意味情報が、特に視覚に関する異なる形態の感覚入力と複雑に絡み合っていることを示しています。神経科学の研究によると、アモーダルな意味表現は視覚と言語の経験の間で共有されています。例えば、単語「猫」は猫のイメージに匹敵する概念情報を生成します。ただし、概念的なカテゴリとV&Lモダリティ間の意味関係や滑らかな遷移は、時には計算モデルを使用して数量化または実現されることがあります。

最近の神経デコーダの研究では、機能的磁気共鳴イメージングで捉えられた視覚皮質の表現から視覚コンテンツを再構築することができることが示されています。しかし、再構築された画像のぼやけや意味のなさや不一致は依然として存在します。一方、神経科学のコミュニティは、脳の視覚野がV&L形式の意味的なアイデアにアクセスできるという主張を裏付ける強力な証拠を提供しています。その結果、私たちはあなたが口頭で知覚することを翻訳するための新しい「心の読み取り」装置の開発を推進する必要があります。このような取り組みは、クロスモーダルな意味統合メカニズムを明らかにする上で相当な科学的価値を持ち、補完的または修復的な脳-コンピュータインタフェースに有用な情報を提供するかもしれません。

浙江大学の著者らは、MindGPTという非侵襲的な神経言語デコーダを紹介しています。これは、静的な視覚刺激によって生成される血液酸素レベル依存パターンを適切な単語の列に変換するものです(図1参照)。彼らの知識によれば、Tangらは非侵襲的言語デコーダの作成を試みた最初の研究者であり、非侵襲的言語デコーダに沈黙の映画の意味を回復する能力すらも備えています。しかし、fMRIの時間的解像度が低いため、候補の単語と誘発された脳の反応との間の微細な意味的意義を予測するためには、多くのfMRIデータを収集する必要があります。

- 「PIXART-αに会ってください:画像生成の品質が最先端の画像生成器と競争するTransformerベースのT2I拡散モデル」

- 「POCOと出会う:3D人体姿勢と形状推定のための画期的な人工知能フレームワーク」

- 「xVal」というものに出会いましょう:科学応用のために数字を言語モデルにエンコードするための継続的な方法で、任意の数字を表すために単一のトークンだけを使用します

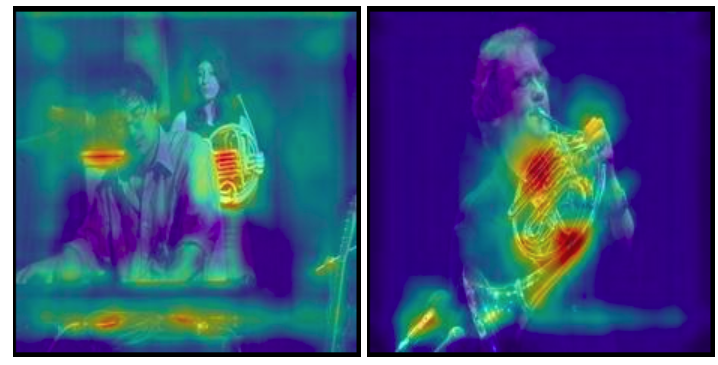

図1: 左:MindGPTの非侵襲的言語デコーダの全体的なパイプライン。右:私たちのMindGPT再構築、SMALLCAP画像キャプションモデル、VQ-fMRI、MinD-Vis視覚デコーディング手法の結果。

この研究では、単一の画像などの静的な視覚感覚体験によってアモーダルな言語マップがどの程度意味的にラベル付けされるかに焦点を当てています。彼らのMindGPTは2つの重要な要件を満たすために構築されています:(i) 脳活動から視覚的な意味表現を抽出できる必要があり、(ii) 学習されたVSRを適切に構築された単語の列に変換する方法を含まなければなりません。彼らはまず、大規模な言語モデルであるGPT-2をテキスト生成器として使用することを決定しました。このモデルはWebTextと呼ばれる数百万のウェブサイトのデータセットで事前学習されており、文のパターンを適切な形式の自然な英語に似せることができます。

その後、脳-視覚言語表現間の意味のギャップを閉じるために、彼らはシンプルで効果的なCLIPガイドのfMRIエンコーダと交差注意層を採用しました。このニューラルデコーディングの形式は、学習可能なパラメータ数が非常に少なく、軽量かつ効率的です。この研究では、MindGPTが信頼性の高いV&L意味変換のための脳の視覚野と機械の間のリンクとして機能する可能性を示しています。彼らの技術は一般化可能な脳の意味的表現とB & V & Lモダリティの包括的な理解を学習し、観察された入力の視覚的な意味を正確に捉えた言語を生成します。

さらに、彼らは非常に少量のfMRI画像トレーニングデータでも、熟練したMindGPTが刺激画像の視覚的な手がかりを記録する能力を持つように見えることを発見しました。これにより、視覚特徴が言語の意味にどのように貢献するかを調査することが容易になりました。また、視覚化ツールの助けを借りて、MindGPTによって教えられた潜在的な脳の表現が、低レベルの視覚的側面と高レベルの意味的アイデアの両方で有益な局所性特性を持っていることがわかり、神経科学の一部の研究結果と一致しています。全体として、MindGPTは以前の研究とは対照的に、fMRIの時間的解像度を考慮せずに脳のVC内のV&L表現間の意味的な関係を推測することが可能であることが明らかになりました。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「多言語AIは本当に安全なのか?低リソース言語における大規模言語モデルの脆弱性を明らかにする」

- このAIの論文は、テキスト変換グラフとして言語モデルパイプラインを抽象化するプログラミングモデルであるDSPyを紹介しています

- 「取得した文書の圧縮は言語モデルのパフォーマンスを向上させることができるのか?このAIの論文では、圧縮と選択的な拡張によって検索増強型LMを改良するためのRECOMPを紹介しています」

- なぜ人々は人工知能AIを恐れているのか?

- 「DiffPoseTalk(デフポーズトーク)をご紹介:新しい音声対応3Dアニメーション人工知能フレームワーク」

- 「テキストを科学的なベクトルグラフィックスに変換することはできるのか?このAI論文では、AutomaTikZを紹介し、TikZのパワーを説明しています」

- ディープラーニングのためのラストバーンライブラリ