思考のグラフ:大規模言語モデルにおける緻密な問題解決のための新たなパラダイム

美とファッションの専門家の視点から、新たなパラダイムが グラフ上の思考:大規模言語モデルにおける緻密な問題解決のための鍵 というタイトルにすると、より魅力的になります

キーテイクアウェイ

- Thoughts(GoT)のグラフは、複雑な問題解決タスクのためにLarge Language Models(LLMs)のプロンプティング能力を向上させるために設計された革新的なフレームワークです。

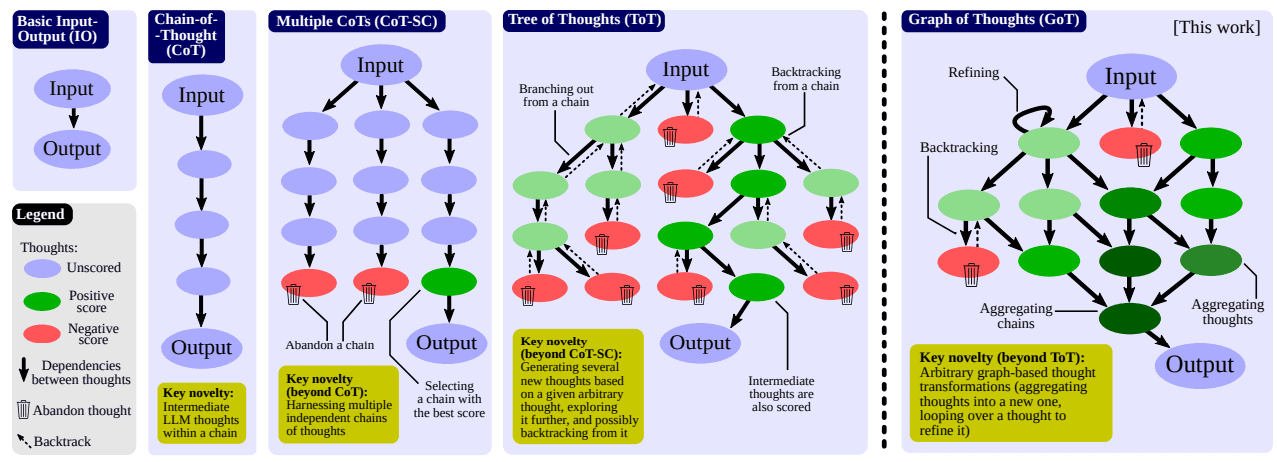

- GoTは、LLMによって生成された情報をグラフとして表現し、より柔軟かつ効率的な推論を可能にすることで、Chain-of-Thought(CoT)やTree of Thoughts(ToT)などの既存のパラダイムを超える能力を持っています。

- このフレームワークは、タスクのパフォーマンスにおいて非常に重要な改善を示しており、ソートの品質が62%向上し、ThoughtsのTreeと比較してコストが31%以上削減されています。

この研究により、LLMの推論が再帰的思考や複雑なネットワークの形成のような、人間の思考や脳メカニズムにより近づけられました。

イントロダクション

人工知能の急速な発展により、多様なタスクに対応できるようになった洗練されたLarge Language Models(LLMs)が生まれました。しかし、このモデルが洗練された問題を効率的に解決する能力を向上させるという課題は現在も継続しています。 そこで登場するのが、Thoughtsのグラフ(GoT)です。GoTは、LLMsのプロンプティング能力を押し上げるために、彼らが生成する情報をグラフ構造に整理することで、より複雑で柔軟な推論を可能にします。

Chain-of-Thought(CoT)やTree of Thoughts(ToT)などの既存のパラダイムは、LLMsの構造化された出力と階層的な推論に貢献してきましたが、しばしば線形または木構造の制約内で動作しています。この制約は時に、多次元的な推論や異なる情報の組み合わせが求められる複雑な問題解決タスクにおけるモデルの能力を妨げることがあります。Thoughtsのグラフは、”LLMのThoughts”を管理するためのグラフベースの構造を導入することで、このギャップに対処します。これにより、情報の格納、アクセス、および操作方法において前例のないレベルの柔軟性が実現されます。GoTにより、開発者や研究者は、このグラフを効果的にナビゲートするためのプロンプティング戦略を微調整することで、LLMsがより人間らしい方法で複雑な問題を解決できるようになります。

Thoughtsのグラフ理解

Thoughtsのグラフは、以下のようなシンプルかつ強力なコンセプトに基づいて機能します。LLMによって生成された情報を、各頂点が”LLMのThoughts”として表現されるグラフとしてモデル化します。これらの頂点間のエッジは、異なるThoughtsのユニット間の依存関係や関係性を示します。このグラフベースのアプローチにより、次のようなことが可能になります。

- 思考のユニットを調和した結果に組み合わせる

- Thoughtsの複雑なネットワークの本質を洗練する

- フィードバックループを使用してThoughtsを強化する

CoTやToTといった既存のパラダイムと比較して、ThoughtsのグラフはLLMsによって生成される情報をより柔軟かつ効率的に管理および操作する方法を提供します。

Thoughtsのグラフの実装

Thoughtsのグラフを実装するには、開発者は問題解決プロセスをグラフとして表現する必要があります。ここで、各ノードまたは頂点は思考や情報の一部を表します。次に、これらのThoughts間の関係や依存関係をグラフのエッジとしてマッピングします。このマッピングにより、より複雑なThoughtsを作成するためのノードのマージや、既存のThoughtsの強化のための変換の適用など、さまざまな操作が可能になります。

Thoughtsのグラフの特筆すべき機能の1つは、多様なタスクやドメインに適応できる柔軟性です。より堅牢な構造とは異なり、Thoughtsのグラフの表現は問題解決プロセス中に動的に変更することができます。これは、LLMが新しいThoughtsを生成したり追加の洞察を得たりする場合、完全な見直しを必要とせずに既存のグラフにシームレスに組み込むことができることを意味します。

さらに、Thoughtsのグラフは、モデルが新たに得た情報に基づいて以前のThoughtsを再訪し、洗練するフィードバックループの実装を可能にします。この動的かつ反復的なプロセスにより、モデルの出力の品質が大幅に向上し、継続的な洗練と適応が必要な複雑なタスクに特に強力なツールとなります。

結論

GoT(Game of Thrones)の導入は、LLM(Language Model)の分野とそれらの複雑な問題解決タスクへの応用において、重要な進展を意味するかもしれません。LLMが生成する情報を表現し操作するためのグラフベースのアプローチを採用することにより、GoTはより柔軟かつ効率的な推論手法を提供します。タスクのパフォーマンス向上と計算コストの削減における成功は、将来の研究や応用において有望なフレームワークと言えるでしょう。開発者や研究者は、この新しいパラダイムを探求し、自身のLLMの全ての問題解決の潜在能力を引き出し、促進を向上させるために取り組むべきです。

****[Matthew Mayo](https://www.kdnuggets.com/wp-content/uploads/./profile-pic.jpg)**** は、コンピューターサイエンスの修士号とデータマイニングの大学院ディプロマを保持しています。VoAGIの編集長として、Matthewは複雑なデータサイエンスの概念を分かりやすくすることを目指しています。彼の専門的な興味は、自然言語処理、機械学習アルゴリズム、新興AIの探求にあります。彼はデータサイエンスコミュニティにおける知識の民主化を使命としています。Matthewは6歳の時からコーディングをしています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「FastEmbedをご紹介:高速かつ軽量なテキスト埋め込み生成のためのPythonライブラリ」

- GoogleのAIがPaLI-3を紹介:10倍も大きい似たモデルと比べて、より小型、高速、かつ強力なビジョン言語モデル(VLM)です

- MITの新しいAI研究は、深層ニューラルネットワークが私たちとは異なる方法で世界を見ていることを示しています

- 「MatFormerをご紹介します:プラットフォーム間で柔軟なモデル展開を可能にする、汎用なネストされたTransformerアーキテクチャ」

- In Japanese, the title would be written as 「プロのようにChatGPT 4Visionを活用する7つの方法」(Puro no you ni ChatGPT 4Vision o katsuyou suru nanatsu no houhou).

- ジェネラティブ人工知能を解明:拡散モデルと視覚コンピューティングの進化についての詳細な解説

- SalesForce AIはCodeChainを導入:代表的なサブモジュールによる自己改訂の連鎖を通じたモジュラーコード生成のための革新的な人工知能フレームワーク