「AI倫理ツールキットが機能する理由を探る」

Exploring the reasons behind the functioning of AI ethics toolkit.

AI倫理ツールキットはどこでも見かけますが、本当に理解していますか?

イントロダクション

AIシステムの重要な影響を持つアプリケーションでの使用が増えるにつれて、専門家たちはこれらのシステムを設計する際に参加型で価値意識の高いプラクティスを求めてきました。AIシステム設計における利益は多岐にわたりますが、その中にはより包括的にし、既存のバイアスを解消し、責任を持たせるというものがあります。これに応えて、AI倫理の分野では近年、多くのツールキットが開発されてきました。これらは大学、企業、規制機関など異なる出典から提供され、さまざまな技術やフレームワークを使用し、データサイエンティストやAIエンジニアからデザイナーや一般の人々まで、さまざまな対象を想定しています(Wong et al.、2023年)。

多くのAI倫理ツールキットは、AIの作成に関連する技術的な側面に焦点を当て、主に技術の専門家(例:FAIR自己評価ツール)を対象としています。しかし、エンドユーザーやドメインエキスパートなど、AIの作成チームの外のステークホルダーに焦点を当て、参加を促すツールキットもいくつかあります(例:AI Meets Design Toolkit)。ステークホルダーの参加に焦点を当てたツールキットは、キャンバスやカードのデッキなどのリソースを提供することで、非技術的なバックグラウンドを持つステークホルダーがデザイン活動に参加できるようにしています。この参加は、異なる意思決定の結果をブレインストーミングしたり、AIユーザーと共感するための手段となることがあります。

しかし、これら多数のツールキットにもかかわらず、それらがどのように機能し、その基本的な戦略は何かを理解しようとする試みはほとんどありませんでした。そのため、広範な利用があるにもかかわらず、これらのツールキットが実際にツールキットのユーザーやその使用時に生じる成果にどのような効果をもたらすのかは明確ではありません。そのため、私は特定のツールキットがどのように機能するかを調査することにしました。それは非常に有益な経験でした。

私が行ったこと

私はAIをさまざまな形で活用している9人の参加者とデザインワークショップを行いました。ワークショップは、架空の対話型AIを使用して糖尿病の自己管理を支援するための使用事例やデザイン機能をブレインストーミングするためのアイデア創出活動から構成されていました。個人のデザイナーが作成したAI倫理ツールキットを使用しました。私はこれを意図的に選び、大規模な資金援助を受けていない小規模なツールキットが根本的にどのように機能するのかを本質的に探求するためです。

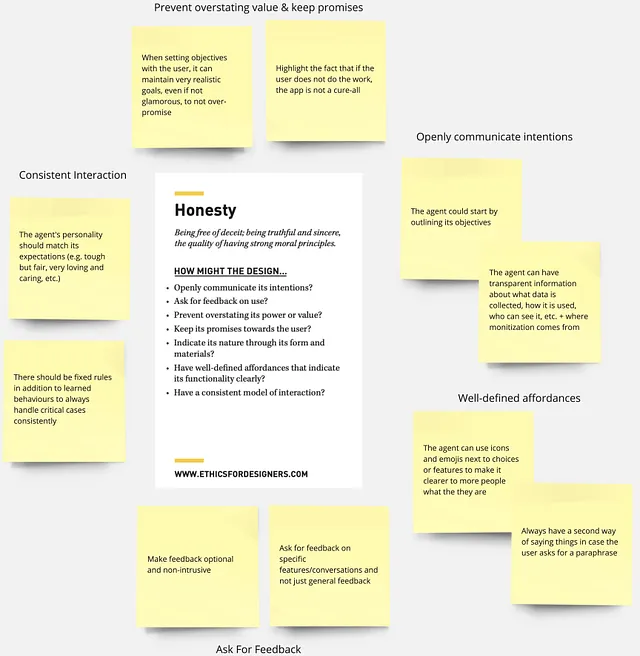

ワークショップはMiroを使用して2時間かけて行いました。ツールキットの動作方法は、カードのデッキで構成されています。それぞれのカードには値(プライバシー、自律性、安全性など)と、与えられた値を尊重するための異なるアイデアを促す「How Might We?」の質問が記載されています。私はこれらのカードをMiroボードに配置し、人々がブレインストーミングするための付箋を残し、その後、各人に個別に焦点を当てるために2つの値を割り当てました。

1時間後、私たちは集まり、カードを裏返して値を見えなくし、人々が書いたアイデアが記載された付箋だけが見えるようにしました。各人に自分が書き留めたアイデアを発表してもらい、他の参加者はそれが尊重しようとしている値を推測しなければなりませんでした。

学んだこと

価値観をスプリングボードとして利用して共感力と広い視野を構築する

このツールキットは、彼らが提供した価値観のリストをアイデアを出し、ブレインストーミングするためのスプリングボードとして使用するために設計されました。3人の参加者が、これは非常に有用なアプローチであると述べています:

「さまざまな価値観が会話エージェントの開発に適用可能であることを見ることが興味深かったです。」

「1つの価値観の視点からデザインについて考えること。」

「価値観のカードを見て、それらに関連するアイデアを生み出すこと。」

- 技術的な実現可能性よりも、価値観とユーザーの視点からの異なるアイデアの重要性に焦点を当てることが少なかったです。参加者は、これを好きまたは好む傾向がありました。これは、技術的な側面に焦点を当て、安全性や公平性などの価値観を見落とすことからの歓迎される変化を提供したためです。1人の参加者は、これらの価値観がシステムやそれを構築する技術の背後にあるものを考えるときに必ずしも浮かび上がってこないかもしれないと感じたと述べました。また、もっと簡単で早い方法を考えるときにも同様です。彼らは、設計する際にこれらの価値観について考えるべきだと言いましたが、常にそうではないとし、他の優先事項がこれを上回る場合もあると述べました。 要するに、価値観を前面に出すことで、参加者は非技術的な側面を考慮に入れてブレインストーミングすることができました。

- この演習により、参加者は糖尿病患者の生活や彼らの経験についてさらに理解し、最もカスタマイズされた具体的な方法でサポートする方法を知りたくなりました。また、仮定に基づかない実際に関連性のある解決策を見つけることを目指しました。この欲求を引き起こした価値観は、「静けさ」(ストレスや不安を引き起こす状況に関する情報を知りたい)と「安全性」(彼らの生命を脅かす状況に関する情報を知りたい)でした。 要するに、価値観に焦点を当てることで、参加者の(i)ターゲットユーザーへの共感力および(ii)最善のサポート方法を学ぶという好奇心/欲求が高まりました。

ゲーミフィケーションを利用して参加度を向上させ、結果を改善する

参加者は、価値観を推測する際のゲーミフィケーションの要素を非常に楽しんでいました:

「アイデアがどの価値観に関連しているのかを推測するのが楽しかったです。単に読み進めたり議論したりするだけではなく、アイデアにより関与できました。」

「私は、価値観を推測する部分が、さまざまな価値観を本当に理解し、それらがどのように相互に関連しているかを知るために最も役立ったと思いました。」

- 価値観を推測する際、参加者は、いくつかのアイデアが異なる価値観に対応する可能性があり、異なる価値観の下の異なるアイデアが同じ概念や提案を指していることがわかりました。議論では、いくつかの価値観があまりにも似ているか、大幅に重なっていることが明らかになりました。- 多くの価値観が似ているか重なっていると考えられ、参加者はそれらを推測したり区別したりするのに苦労しました。さまざまな価値観の間には多くのリンクがあり、いくつかは他の価値観につながるか、促進するか、または類似の現象/感情を具現化することができます。推測中、「公平性」が「包含性」と間違えられました。「コミュニティ」、「自由」、および「自治」は互いに区別できませんでした。「習熟」は「勇気」と「好奇心」と混同されました。「包含性」は「アクセシビリティ」と「尊重」と間違えられました。 要するに、ゲーミフィケーションにより、参加者はアイデアと価値観の相互関係を本当に理解することができました。

将来の改善点とアイデア

- 3人の参加者は、会話型AIの対象ステークホルダーとの共感を深めるために、より多くの文脈情報やプロンプトが欲しかったと述べました。『安全性』や『静けさ』などの具体的な価値により、参加者はユーザーに共感し、彼らの経験についてもっと知りたかったので、よりカスタマイズされたソリューションを提供し、彼らのニーズに特に対応することができます。1人の参加者は、初期のプロンプトが(糖尿病患者向けに設計している人々からの)フィードバックを欠いているため、彼らのためにアイデアを出すためのブレストーミングが本当にできなかったと感じました。彼らは、ユーザーのシナリオに関するよりカスタマイズされた/具体的な情報、彼らの生活からの瞬間の説明、またはアイデアをよりカスタマイズするために使用できる現実的な文脈情報が必要であると考えました。

- 1つの提案は、まずは抽象的で高レベルなことに焦点を当て、あまり事前情報を持たずにワークショップを行い、その後でユーザー情報を収集するというものでした。なぜなら、最初にユーザー情報を収集すると、アイデアや価値観を見逃す可能性があり、収集した情報に過度に焦点を当てる可能性があるからです。その後、収集した情報をすべて持ち込んで、両方の知識源を活用してシナリオや技術的な側面について再びブレストーミングできます。

- 2人の参加者は、値のリストと定義がなければ、値を記述するための正確な単語を考えるのに困難を感じたかもしれないと指摘しました。値の意味を理解するには、それらの下に説明を提供する必要があったため、それらの値が明確に定義されていない場合、異なる人によって異なる意味を持つことがあり、それらの間には多くの衝突や重複があるかもしれません。

これがあなたのお手伝いになる方法

AI倫理ツールキットの特性を探るこの実験により、ゲーミフィケーションと価値ベースの演習の力についてより深い理解が得られました。以下に、AIデザインに関するデザインワークショップでAI倫理ツールキットをステークホルダーと共に使用し、AIデザインのアイデア出しや構想を行う際に役立つ6つのポイントをまとめました。

- AI倫理について共同で考える主なポイントの1つは、AIをより人間中心にすることです。そのため、ターゲットユーザーやデザイン対象者についての多くの文脈情報(できれば一次情報)を含めることが非常に重要です。技術の専門家の多くは共感構築の演習やアイデア出しなどに慣れていないかもしれないので、本当に誰を助けようとしているのかを明確にすることで彼らをサポートしてあげましょう。

- ワークショップには高レベルな視点から関連性や重要性を絞り込むための多くの活動が必要かどうかを考えてください。両方を混ぜることは参加者にとって混乱を招くことがあります、特に同じレベルで比較できないアイデアのランク付けや評価を求める場合は。

- 値を扱う場合は、各値が何を意味するのかを明確に定義してください。これは重要です。なぜなら、異なる人によって異なる意味を持つことがあり、明確に定義されていないと、値の間に多くの衝突や重複が生じる可能性があるからです。

- 値をAIデザインの活動に取り入れることは、参加者がアイデアを出したり、共通に見落とされがちな非技術的な側面を考慮したり、ターゲットユーザーとの共感を深めたり、それらのユーザーをよりよくサポートしようとする好奇心を高める助けとなります。

- ゲーミフィケーションの技術を取り入れることは、AI倫理のワークショップ中の参加者の関与度と楽しさを向上させるだけでなく、アイデア間のつながりをより深く理解するのにも役立ちます。

私の役割

私のPhDプロジェクトは、デザイン分野のツールや技術を活用して、AIシステムの設計をアクセス可能かつ包括的にすることを目指しています。私は、価値感に焦点を当てた参加型プロセスとそのサポートツールを作成し、AIライフサイクル全体で人々を体系的に参加させることに取り組んでいます。

私のプロジェクトの公式ページをImperial College Londonのウェブサイトでご覧いただけます。また、私のPhDプロジェクトの詳細を説明した別の記事もご覧いただけます。

私はこのVoAGIアカウントを設立しました。PhDプロジェクトに取り組む中で興味深い知見を公開し、AIシステムに関するニュースや情報を誰にでも分かりやすい形で広めることを願っています。

参考文献

Richmond Y. Wong, Michael A. Madaio, and Nick Merrill. 2023. Seeing Like a Toolkit: How Toolkits Envision the Work of AI Ethics. Proc. ACM Hum.-Comput. Interact. 7, CSCW1, Article 145 (April 2023), 27 pages. https://doi.org/10.1145/3579621

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「アフリカのコミュニティが気候変動に適応するためにAIが助ける3つの方法」

- 「チャットモデル対決:GPT-4 vs. GPT-3.5 vs. LLaMA-2によるシミュレートされた討論会-パート1」

- 情報セキュリティ:IoT業界内のAIセキュリティ

- 本番環境向けのベクトル検索の構築

- 「Numexprの探索:Pandasの背後にある強力なエンジン」

- 「GPU インスタンスに裏打ちされた SageMaker マルチモデルエンドポイントを利用して、数百の NLP モデルをホストします」

- 「ABBYYインテリジェントオートメーションレポートによると、AIの予算は80%以上増加していることが明らかになりました」