システムにエージェントが存在するかを発見する

Discover if there is an agent in the system.

AIエージェントの因果モデリングとそのインセンティブのための新しい形式的な定義が明確な原則を提供

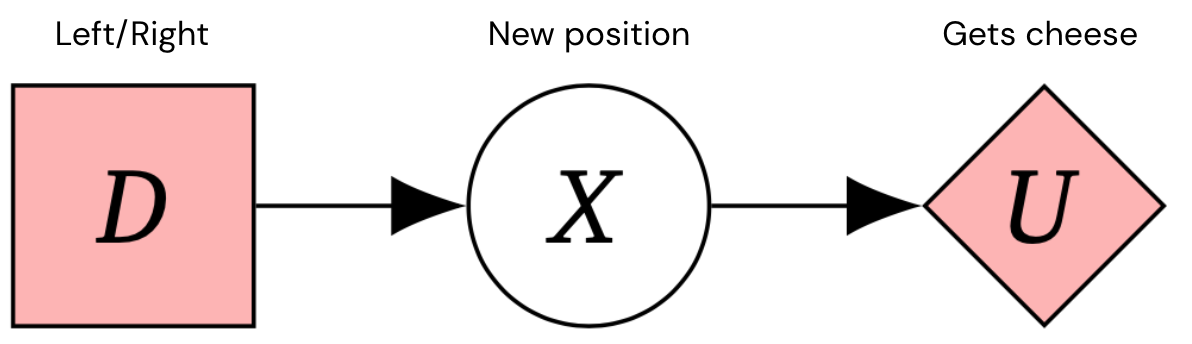

私たちは、意図した目標を追求する安全でアラインメントされた人工汎用知能(AGI)システムを構築したいと考えています。因果関係ダイアグラム(CIDs)は、エージェントのインセンティブについて推論するための意思決定状況をモデル化する方法です。たとえば、次のCIDは、意思決定問題の典型的なフレームワークである1ステップマルコフ意思決定プロセスのCIDです。

トレーニング設定をエージェントの行動を形成するインセンティブに関連付けることで、CIDsはエージェントの訓練前の潜在的なリスクを明らかにし、より良いエージェント設計のインスピレーションを与えるのに役立ちます。しかし、CIDがトレーニング設定の正確なモデルであるかどうかをどのように知るのでしょうか?

私たちの新しい論文、エージェントの発見は、次の問題に取り組むための新しい方法を紹介しています:

- エージェントの最初の形式的な因果的定義:エージェントは、行動が異なる方法で世界に影響を与える場合、ポリシーを適応するシステムです

- 経験データからエージェントを発見するためのアルゴリズム

- 因果モデルとCIDsの間の変換

- エージェントの因果モデリングの以前の混乱を解決する

これらの結果を組み合わせることで、モデリングの間違いがなされていないことを保証するための追加の保証が提供されます。これにより、CIDsを使用してエージェントのインセンティブと安全性の特性をより自信を持って分析することができます。

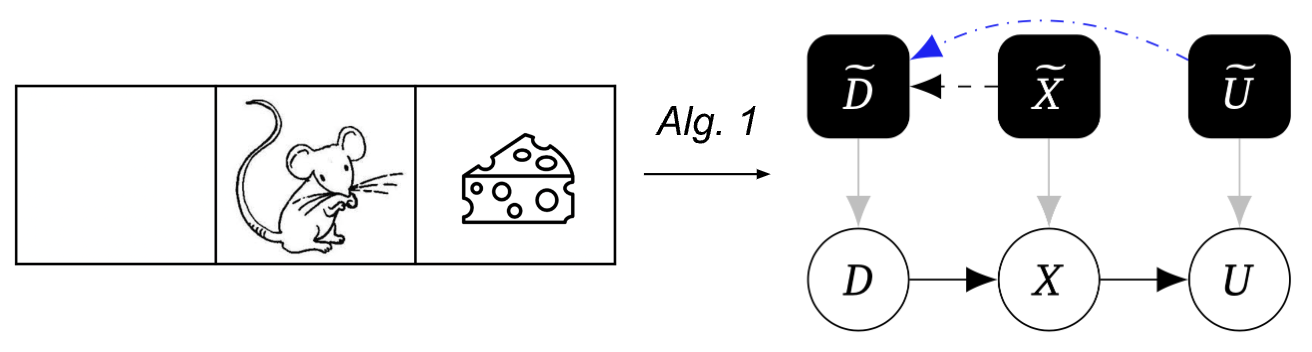

例:マウスをエージェントとしてモデリングする

私たちの方法を説明するために、次の例を考えてみましょう。マウスが中央の正方形にいて左または右に進むことを選び、次の位置に到達してからチーズを手に入れる可能性がある世界で構成される例です。床は滑りやすいため、マウスは滑るかもしれません。チーズは時には右にありますが、時には左にあります。

これは、次のCIDで表すことができます:

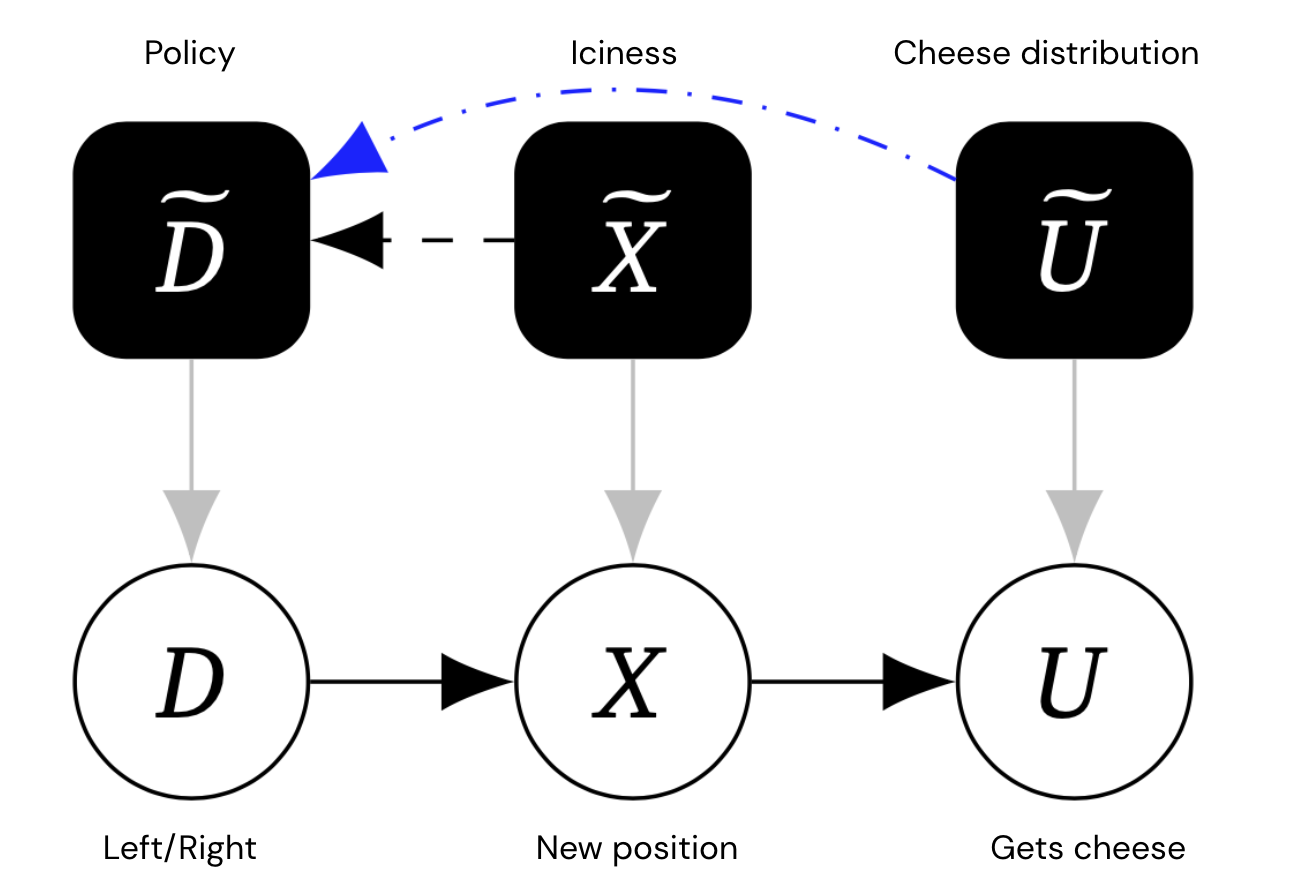

マウスが異なる環境設定(凍結度、チーズの分布)に対して異なる行動を選択する直感は、機械化された因果グラフによって捉えることができます。このグラフは、(オブジェクトレベルの)変数ごとに、親に依存する方法を制御するメカニズム変数も含まれています。重要なことは、メカニズム変数間のリンクを許可していることです。

このグラフには、マウスのポリシーや凍結度、チーズの分布を表す黒色の追加メカニズムノードが含まれています。

メカニズム間のエッジは直接の因果関係を表しています。青いエッジは特別な終端エッジであり、おおよそ、オブジェクトレベルの変数Aが出力エッジを持たないように変更されたとしても、メカニズムエッジA〜→B〜は存在し続けるエッジです。

上記の例では、Uには子がいないため、そのメカニズムエッジは終端である必要があります。しかし、メカニズムエッジX〜→D〜は終端ではありません。なぜなら、Xをその子であるUから切り離した場合、マウスはもはや自身の位置がチーズを取得するかどうかに影響を与えないため、意思決定を適応させなくなるからです。

エージェントの因果関係の発見

因果関係の発見は、介入を伴う実験から因果グラフを推論します。特に、変数Aに介入し、他のすべての変数を固定したままであっても、Bが反応するかどうかを実験的に確認することで、変数Aから変数Bへの矢印を発見することができます。

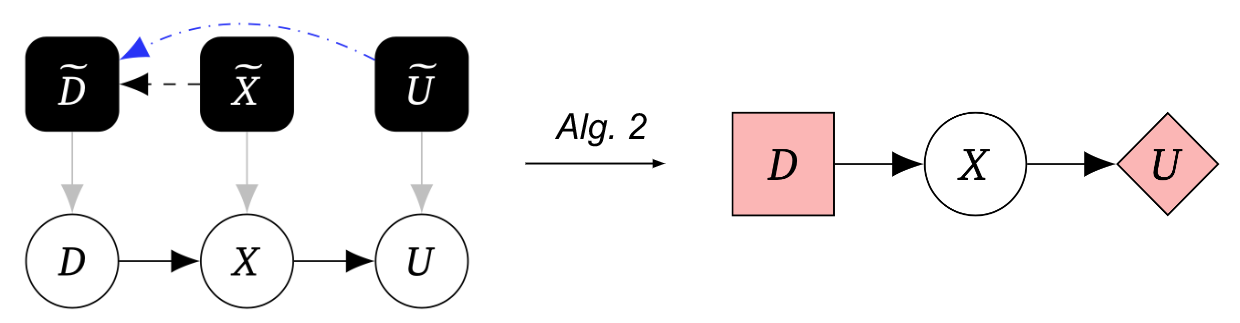

最初のアルゴリズムは、この技術を使用して機械化された因果グラフを発見します:

2番目のアルゴリズムは、この機械化された因果グラフをゲームグラフに変換します:

アルゴリズム1に続いてアルゴリズム2を適用することで、因果関係の実験からエージェントを発見し、CIDsを使用してそれらを表現することができます。

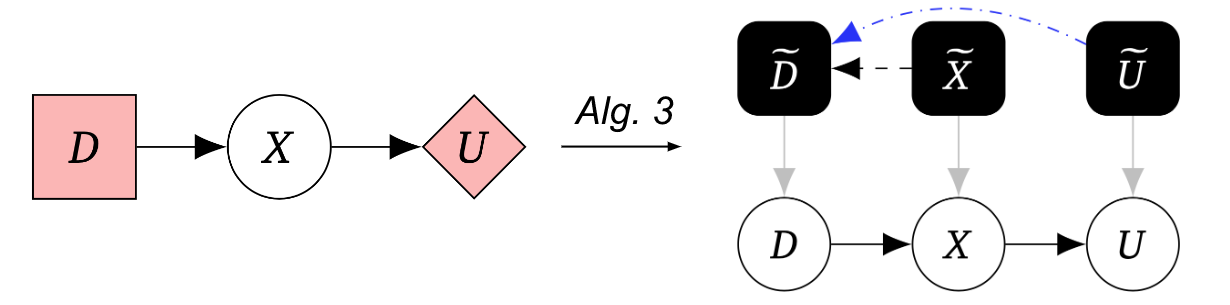

3番目のアルゴリズムは、ゲームグラフを機械化された因果グラフに変換し、いくつかの追加の仮定の下でゲームグラフと機械化された因果グラフの表現間を変換します:

AIエージェントをモデル化するためのより良い安全ツール

私たちは、エージェントの最初の形式的な因果定義を提案しました。因果的な発見に基づいている私たちの重要な洞察は、エージェントは、彼らの行動が世界にどのように影響を与えるかが変化するにつれて、その行動を適応させるシステムであるということです。実際、私たちのアルゴリズム1と2は、システムがエージェントを含んでいるかどうかを評価するのに役立つ、正確な実験プロセスを説明しています。

AIシステムの因果モデリングへの関心は急速に高まっており、私たちの研究はこのモデリングを因果的な発見の実験に基づいています。私たちの論文は、いくつかの例のAIシステムの安全性分析の向上を通じて、私たちのアプローチの潜在能力を示し、因果関係がAGIからのリスク評価における重要な懸念であるシステムにエージェントが存在するかどうかを発見するための有用なフレームワークであることを示しています。

さらに詳しく知りたいですか?私たちの論文をご覧ください。フィードバックやコメントは大歓迎です。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles