Contextual AIは、VQAv2においてFlamingoを9%上回る(56->65%)ビジョン補完言語モデルのためのAIフレームワークLENSを導入しました

Contextual AIは、VQAv2のAIフレームワークLENSを導入し、Flamingoを9%上回るビジョン補完言語モデル(56%から65%)を実現しました

大規模言語モデル(LLM)は、最近の数年間で自然言語理解を変革し、ゼロショットおよびフューショットの環境での特に意味理解、クエリ解決、およびテキスト生成の能力を示しています。図1(a)に示すように、ビジョンに関わるタスクでLLMを使用するためのいくつかの手法が提案されています。光学エンコーダを使用して各画像を連続埋め込みの系列として表現し、LLMが理解できるようにする方法もあります。別の手法では、コントラスト学習でトレーニングされた固定ビジョンエンコーダを使用し、凍結されたLLMに追加の層を追加してゼロから学習します。

別の手法では、凍結された視覚エンコーダ(コントラスト学習で事前トレーニングされたもの)と凍結されたLLMを整列させるために、軽量トランスフォーマをトレーニングすることを推奨しています。上記の研究では進歩していますが、追加の事前トレーニング段階の計算コストを正当化するのは依然として困難です。また、既存のLLMと視覚および言語のモダリティを同期させるために、テキスト、写真、動画などの大規模なデータベースが必要です。Flamingoでは、視覚特徴を追加するために、事前トレーニングされたLLMに新しいクロスアテンション層を追加します。

マルチモーダルプリトレーニング段階では、驚くべき20億の画像テキストペアと4300万のウェブサイトが必要であり、事前にトレーニングされた画像エンコーダと凍結されたLLMを使用しても最大15日かかることがあります。代わりに、さまざまな「ビジョンモジュール」を使用して、彼らはビジュアル入力から情報を抽出し、詳細なテキスト表現(タグ、属性、アクション、関係など)を生成し、それをLLMに直接フィードして追加のマルチモーダルプリトレーニングの必要性を回避することができます(図1(b)参照)。Contextual AIとスタンフォード大学の研究者は、LENS(Large Language Models ENnhanced to See)というモジュラーな戦略を紹介し、LLMを「推論モジュール」として使用し、個別の「ビジョンモジュール」で機能する方法を提案しています。

- 3B、4B、9B のスケールで 5 つの新しいマルチモーダルモデルを備えた OpenFlamingo チームが、前モデルを上回る OpenFlamingo v2 をリリースしました

- 大規模な言語モデルにおけるコンテキストに基づく学習アプローチ

- Unityは、Museというテキストからビデオゲームを作成するプラットフォームのリリースを発表しましたこのプラットフォームでは、自然言語でテクスチャ、スプライト、アニメーションを作成することができます

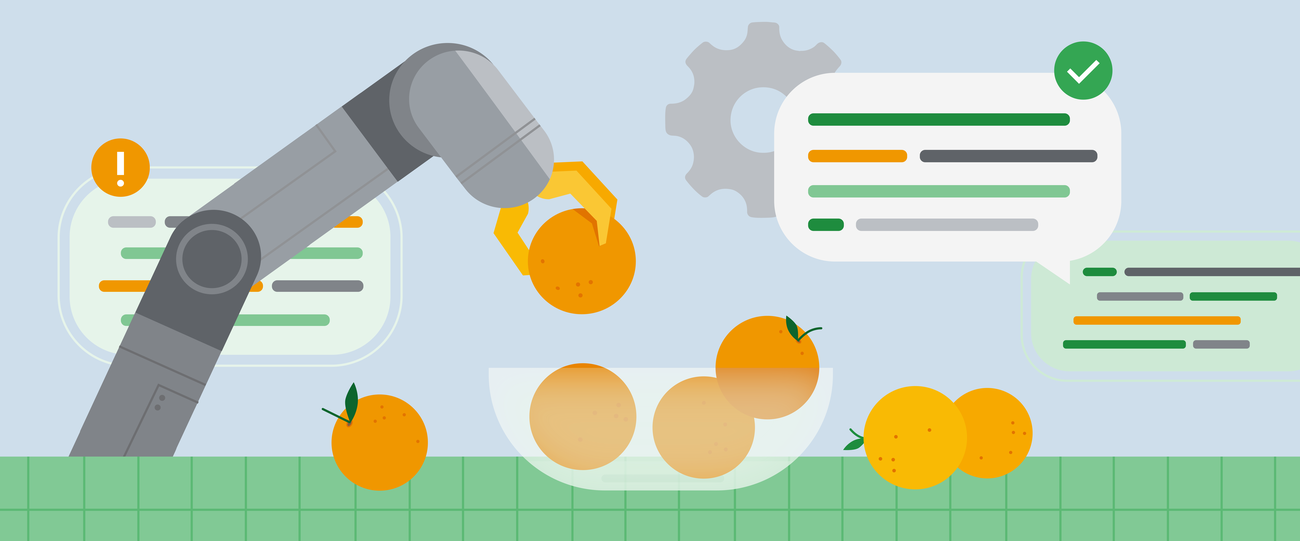

彼らはまず、コントラストモデルや画像キャプションモデルなどの事前トレーニング済みビジョンモジュールを使用してLENS手法で豊富なテキスト情報を抽出します。そのテキストは次にLLMに送られ、オブジェクト認識、ビジョン、言語(V&L)を含むタスクを実行することができます。LENSは、追加のマルチモーダルプリトレーニングステージやデータの必要性をなくすことで、モダリティ間のギャップを無償で埋めることができます。また、この統合により、コンピュータビジョンと自然言語処理の最新の進歩を即座に活用することができ、両分野の利点を最大限に引き出すことができます。

彼らは以下の貢献を提供しています:

• LENSは、言語モデルのfew-shot、インコンテキスト学習能力を使用して、コンピュータビジョンの課題を処理するモジュラーな方法を提供します。

• LENSにより、追加のトレーニングやデータなしで、どの市販のLLMでも視覚情報を認識することができます。

• 凍結されたLLMを使用してオブジェクト認識およびビジュアル推論タスクを処理するために、ビジョンと言語のアライメントやマルチモーダルデータの追加は必要ありません。実験結果は、彼らの手法が、KosmosやFlamingoなどのエンドツーエンド共同プリトレーニングモデルと競合または優れたゼロショットパフォーマンスを達成することを示しています。彼らの論文の一部の実装はGitHubで利用できます。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- FastSAMとは、最小限の計算負荷で高性能のセグメンテーションを実現する画期的なリアルタイムソリューションです

- もし、口頭および書面によるコミュニケーションが人間の知能を発展させたのであれば… 言語モデルは一体どうなっているのでしょうか?

- Webスケールトレーニング解放:DeepMindがOWLv2とOWL-STを紹介、未知語彙物体検出の革新的ツール、前例のない自己学習技術によって駆動されます

- 製造品の品質におけるコンピュータビジョンの欠陥検出を、Amazon SageMaker Canvasを使用したノーコード機械学習で民主化する

- エンタープライズAIとは何ですか?

- DORSalとは 3Dシーンの生成とオブジェクトレベルの編集のための3D構造拡散モデル

- Hugging FaceとGradioを使用して、5分でAIチャットボットを構築する