中国の研究者がImageBind-LLMを紹介:ImageBindを介した大規模言語モデル(LLM)のマルチモダリティインストラクションチューニング方法

Chinese researchers introduce ImageBind-LLM. ImageBindを介した大規模言語モデル(LLM)のマルチモダリティインストラクションチューニング方法 translates to method for multimodal instruction tuning of large-scale language models (LLM) via ImageBind.

研究者は最近、大規模言語モデル(LLM)の指示調整において大きな改善を見ています。ChatGPTとGPT-4は、言語と視覚に従って人間の命令に従う汎用対話システムです。しかし、クローズドソースの制約のため、それらはまだ再現不可能です。Alpaca、LLaMAAdapter、および関連する取り組みは、これに対応するために自己生成されたデータを使用して、公開されているLLaMAを言語指示モデルに変更することを提供します。LLaVA、LLaMA-Adapter、およびその他のモデルは、画像指示のカスタマイズを実現するために、ビジュアル理解能力をLLMに統合します。

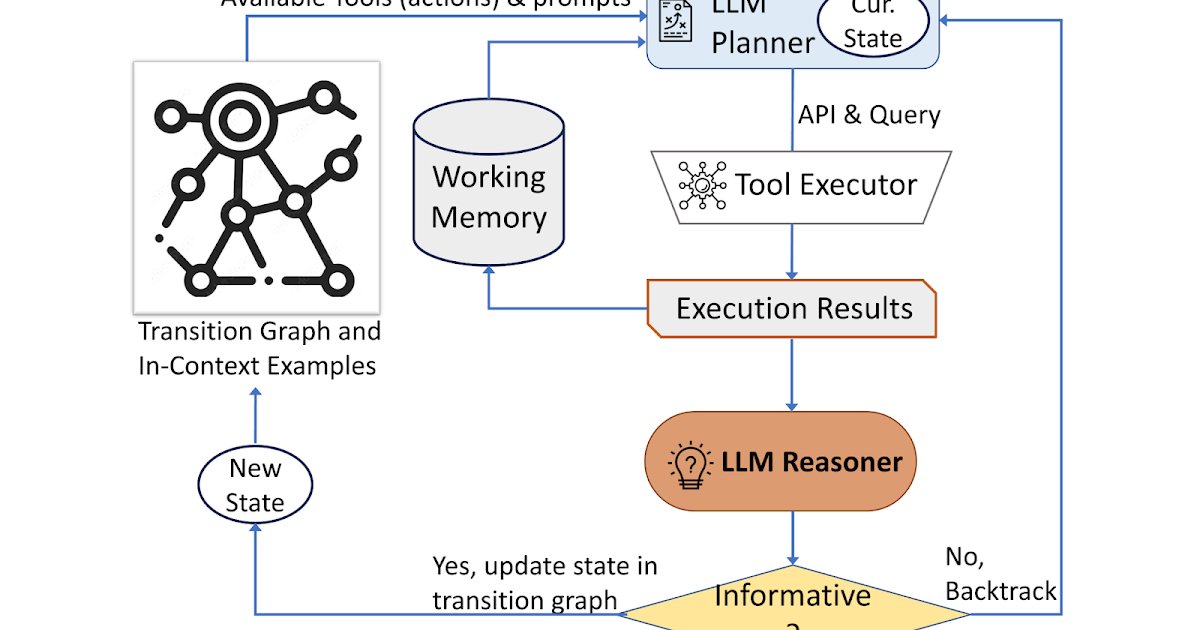

現在の指示調整技術の成功にもかかわらず、テキスト、画像、音声、3Dポイントクラウド、およびビデオなどの広範な多文化指示のためのLLMを作成するためには、さらなる改良が必要です。上海人工知能研究所、CUHK MMLab、およびvivo AI Labの研究者は、事前学習されたImageBindの結合埋め込み空間の指示に従って、効果的にLLaMAを微調整するImageBind-LLMマルチモーダリティ指示フォローモデルを紹介しています。図1に示すように、彼らのImageBind-LLM(b)は、従来のビジュアル指示モデル(a)とは異なり、画像以外のさまざまなモダリティの入力指示に応答することができます。これは、有望な拡張性と汎化能力を示しています。

彼らは、ImageBindの画像に整列したマルチモーダリティ埋め込み空間の指示の微調整に、ビジョン-言語データのみを使用することを提案しています。画像キャプションのペアに対して、彼らはまず、ImageBindの凍結された画像エンコーダを使用してグローバルな画像特徴を抽出し、学習可能なバインドネットワークを使用して埋め込み変換を行います。変換された画像特徴は、LLaMAのすべてのトランスフォーマーレイヤーの単語トークンに適用され、適切なテキストキャプションの生成のためのビジュアルコンテキストを作成します。LLaMA-Adapterシリーズのゼロ初期化されたアテンションとは異なり、彼らのビジュアルインジェクションメカニズムはシンプルであり、訓練可能なゼロ初期化ゲート要素で重み付けされます。

- スタンフォード大学の研究者たちは、「Protpardelle」という画期的な全原子拡散モデルを導入しましたこれは、タンパク質の構造と配列を共同設計するためのものです

- スタンフォード大学の研究者たちは、スペルバーストという大規模言語モデル(LLM)を搭載したクリエイティブコーディング環境を紹介しました

- 「MITの研究者が、デバイス内の意味的セグメンテーションのための新しい軽量マルチスケールアテンションを紹介」

この効果的な方法により、訓練が進むにつれて、ImageBindのマルチモーダリティ埋め込みの指示キューがLLaMAに徐々に導入され、元の言語理解に干渉することなく導入されることがあります。テキスト、画像、音声、ビデオなどのモダリティにおけるビジョン-言語エンコーディングにImageBindを使用することで、基本的なビジョン-言語トレーニングの後に、ImageBind-LLMはさまざまなモダリティの指示に従う能力を獲得します。彼らは、3Dドメインの指示のために入力の3Dポイントクラウドをエンコードするために、Point-Bindの事前学習された3Dエンコーダを使用します。また、画像トレーニングとテキスト、音声、3D、またはビデオ条件の制作とのモダリティギャップを解消するために、推論中の埋め込み拡張のためのトレーニングフリーのビジュアルキャッシュアプローチも提供します。

キャッシュモデルは、ImageBindによって取得されたトレーニングデータセットの数百万の画像特徴で構成されており、テキスト/音声/3D/ビデオの埋め込みを向上させるために比較可能なビジュアル特性(Tip-Adapter)を獲得します。その結果、マルチモーダルな指示に対する口頭の応答は、より高い品質になります。彼らは、ImageBind-LLMのマルチモーダリティ指示に従う能力をさまざまな状況でテストし、一貫して優れたパフォーマンスを発揮することを確認しています。

全体として、彼らのImageBind-LLMは以下の4つの特性を示します。

• 多数のモードを持つ指示。ImageBind-LLMは、ImageBindおよびPoint-Bindによって表される画像、テキスト、音声、3Dポイントクラウド、およびビデオなどの一般的なマルチモーダリティ入力に応答するように最適化されています。これは、従来の言語と画像の指示モデルとは異なります。

• 効率のチューニング。トレーニング中に、ImageBindの画像エンコーダーをフリーズし、LoRAやバイアスノームチューニングなどのパラメータ効率の良い手法を使用して、LLaMAの一部の重みを調整します。また、ゼロ初期化されたゲーティングファクターと追加のバインドネットワークもトレーニングします。

• アテンションなしのゼロ初期化インジェクション。彼らは、進行的な知識インジェクションのための学習可能なゲーティング方法を採用し、注意レイヤーを介する追加の命令信号を導入する代わりに、LLaMAのすべての単語トークンを直接使用してマルチモダリティの要件を組み込みます。

• クロスモーダルキャッシュからの検索。彼らは、ImageBindによって抽出された画像特徴に基づく視覚的なキャッシュモデルを提供し、トレーニング(単一の画像)と推論(多くのモダリティ)の間のモダリティの不均衡を解消するための埋め込み補完のためのクロスモーダリティの検索を行います。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「Google DeepMind Researchがニューラルネットワークにおける理解現象の謎を探求:記憶と一般化の相互作用を明らかにする」

- ヘリオットワット大学とAlana AIの研究者は、大規模言語モデルに基づく新しい具現化対話エージェント「FurChat」を提案しています

- テルアビブとコペンハーゲン大学からの新しいAI研究は、識別信号を使用して、テキストから画像への拡散モデルを迅速に微調整するための「プラグアンドプレイ」アプローチを紹介しています

- 「UCIとハーバードの研究者が、ユーザーに機械学習モデルを説明するTalkToModelを紹介する」

- マイクロソフトリサーチがBatteryMLを紹介:バッテリー劣化における機械学習のためのオープンソースツール

- 「ポーズマッピング技術によって、脳性麻痺の患者を遠隔で評価することができます」

- マイクロソフトの研究者が「InstructDiffusion:コンピュータビジョンタスクを人間の指示に合わせるための包括的かつ汎用的なAIフレームワーク」というタイトルで発表しました