「作者の正体を暴く:AIか人間か?IBMの革新的なテキスト検出ツールを用いたAIフォレンジックスの出現を探る」

AI vs. Human Unmasking the Author - Exploring the Emergence of AI Forensics with IBM's Innovative Text Detection Tool

急速に進化するAIの時代において、注目すべき課題が存在します。それは、生成AIの透明性と信頼性です。IBMの研究者たちは、世界にAI検出と帰属のツールを提供することで、生成AIの認識方法を変えることを目指しています。しかし、複雑なことに、LLMは自分が書いたコンテンツを検出したり、チューニングされたモデルのソースを追跡するのにはあまり優れていません。日常のコミュニケーションを再構築し続ける中で、研究者たちは、生成AIをより説明可能で信頼性のあるものにするための新しいツールに取り組んでいます。

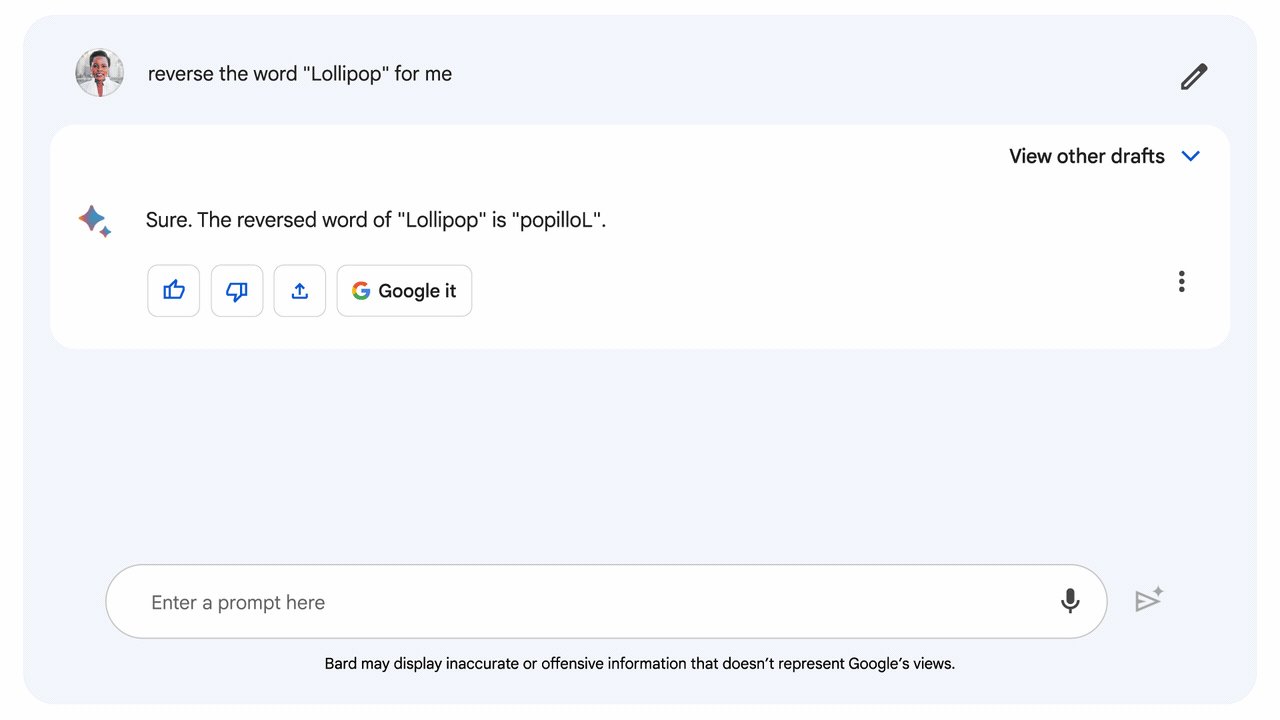

研究者たちは、現代の時代の基盤となる信頼性のあるAIツールキットを適応させることで、これらの進化し続けるテクノロジーに対して責任と信頼性を確保することを目指しています。IBMとハーバードの研究者は、最初のAIテキスト検出器の1つであるGLTRを作成しました。GLTRは単語間の統計的関係を分析したり、生成テキストの特徴的な手がかりを探したりします。IBMの研究者は、AI検出器を欺くためにパラフレーズされたAI生成テキストを特定するのに役立つ画期的なツールであるRADARを開発しました。RADARは、テキストをパラフレーズするモデルとAI生成されたかどうかを判定するモデルとを対決させます。チャットGPTのようなサードパーティモデルへの従業員のアクセスを制限することで、クライアントデータの漏洩を防止するための安全対策が実施されています。

生成AIの世界では、テキストを生成したモデルとそのテキストの起源を特定することが課題となっています。これは帰属として知られる分野を通じて行われます。IBMの研究者たちは、応答を比較し関連するモデルを明らかにするためのマッチングペア分類器を開発しました。機械学習を用いた自動のAI帰属は、特定のモデルの起源や他の数多くの要素を特定するのに研究者たちを支援しています。これらのツールは、モデルの基盤を追跡し、その振る舞いを理解するのに役立ちます。

- FHEを用いた暗号化された大規模言語モデルに向けて

- 「機械学習におけるモデルの解釈性においてSHAP値の使用」

- 「AWSとAccelが「ML Elevate 2023」を立ち上げ、インドのAIスタートアップエコシステムを力強く支援」

IBMは、説明可能で信頼性のあるAIの推進者として長年の歴史があります。彼らはバイアスの緩和と説明可能性を製品に取り入れたAI Fairness 360ツールキットを導入しました。そして、Watsonx.governanceの11月リリースにより、彼らはAIワークフローの透明性を向上させています。IBMは、透明性のツールのアクセシビリティを誰にでも提供するという使命に固執しています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「業界アプリケーションにおける大規模言語モデルを評価するための4つの重要な要素」

- 「7月24日から7月31日までの週間でのトップのコンピュータビジョン論文」

- 2023年に知っておくべきトップ13の自然言語処理プロジェクト

- このAIニュースレターは、あなたが必要なもの全てです#58

- 「UniDetectorであなたが望むものを検出しましょう」

- 「QLORAとは:効率的なファインチューニング手法で、メモリ使用量を削減し、単一の48GB GPUで65Bパラメーターモデルをファインチューニングできるだけでなく、完全な16ビットのファインチューニングタスクのパフォーマンスも保持します」

- 「LLMは強化学習を上回る- SPRINGと出会う LLM向けの革新的なプロンプティングフレームワークで、コンテキスト内での思考計画と推論を可能にするために設計されました」