「Adversarial Autoencoders オートエンコーダーとGANの間のギャップを埋める」

Adversarial Autoencoders ギャップを埋める

イントロダクション

機械学習のダイナミックな領域において、2つの強力な技術を組み合わせることで、Adversarial Autoencoders(AAEs)として知られる多目的なモデルが生まれました。オートエンコーダーとGenerative Adversarial Networks(GANs)の特徴をシームレスに組み合わせることで、AAEsはデータ生成、表現学習などの強力なツールとして登場しました。本記事では、AAEsの本質、アーキテクチャ、トレーニングプロセス、応用について探求し、理解を深めるためのPythonコードの実例を提供します。

この記事はData Science Blogathonの一部として公開されました。

オートエンコーダーの理解

AAEsの基盤となるオートエンコーダーは、データの圧縮、次元削減、特徴抽出のために設計されたニューラルネットワーク構造です。このアーキテクチャは、入力データを潜在空間の表現にマッピングするエンコーダーと、この圧縮された表現から元のデータを再構築するデコーダーから構成されています。オートエンコーダーは、画像のノイズ除去、異常検知、潜在空間の可視化など、さまざまな分野で重要な役割を果たしてきました。

オートエンコーダーは、効率的な次元削減を可能にしながら、データから意味のある特徴を抽出することができるニューラルネットワークの基本的なクラスです。エンコーダーは入力データを低次元の潜在表現に圧縮し、デコーダーはこの圧縮された形式から元の入力を再構築します。オートエンコーダーは、画像処理、自然言語処理などの領域を含むさまざまなタスクにおいて、ノイズ除去、異常検知、表現学習などの目的で使用されます。コンパクトで情報量のある表現を学習することにより、オートエンコーダーは複雑なデータセットの潜在的な構造に対する貴重な洞察を提供します。

Adversarial Autoencodersの紹介

Adversarial Autoencoders(AAEs)は、オートエンコーダーとGenerative Adversarial Networks(GANs)を巧みに組み合わせた革新的なモデルです。このハイブリッドモデルでは、エンコーダーが入力データを潜在空間にマッピングし、デコーダーが再構築します。AAEsの特徴的な要素は、生成されたデータサンプルの品質を評価するディスクリミネーターが存在する敵対的なトレーニングの統合です。この生成器とディスクリミネーターの間の敵対的な相互作用により、潜在空間が洗練され、高品質なデータ生成が促進されます。

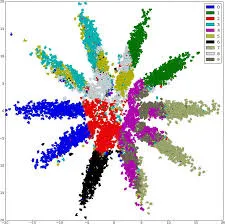

AAEsは、データ合成、異常検知、教師なし学習などさまざまな応用で、堅牢な潜在表現を提供します。その多様性は、画像合成、テキスト生成などのさまざまな領域で有望なアプローチを提供しています。AAEsは、生成モデルの向上や人工知能の進歩に貢献する可能性があるため、注目を集めています。

オートエンコーダーとGANの潜在空間の探索を組み合わせることにより、Adversarial Autoencodersは生成モデリングに革新的な次元を加えます。オートエンコーダーの潜在空間の探索能力とGANの敵対的なトレーニングメカニズムの利点をバランスさせることで、AAEsはデータ生成の向上と潜在空間でのより意味のある表現を実現します。

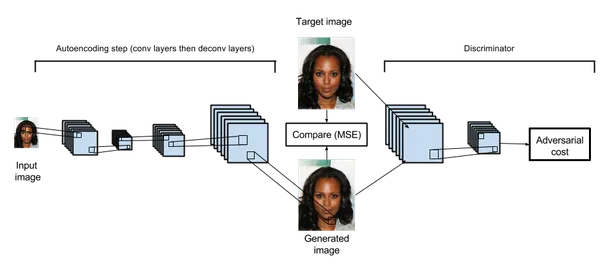

AAEのアーキテクチャ

AAEsのアーキテクチャの設計図は、エンコーダー、ジェネレーター、ディスクリミネーターの3つの重要な要素を中心に展開されています。エンコーダーは入力データを圧縮された表現に変換し、ジェネレーターはこれらの圧縮された表現から元のデータを再構築します。ディスクリミネーターは実際のデータと生成されたデータサンプルを区別することを目指した敵対的な要素を導入します。

AAEのトレーニング

AAEsのトレーニングは、エンコーダー、ジェネレーター、ディスクリミネーターの3つの要素の反復的なダンスです。エンコーダーとジェネレーターは、再構築エラーを最小化するために協力し、生成されたデータが元の入力に似ていることを保証します。同時に、ディスクリミネーターは実際のデータと生成されたデータの区別能力を磨きます。この敵対的な相互作用により、洗練された潜在空間と改善されたデータ生成品質が実現されます。

AAEの応用

AAEsの多様性は、さまざまな応用によって示されています。AAEsは、画像、テキストなどのドメインで現実的なサンプルを生成する能力に優れています。異常検知の能力は、データセット内の異常を特定するために役立ちます。さらに、AAEsは教師なし表現学習にも適しており、特徴抽出や転移学習を支援します。

異常検出とデータのノイズ除去:AAEの潜在空間正則化により、ノイズや異常値を除去する能力が向上し、データのノイズ除去や異常検出のタスクにおいて堅牢な選択肢となります。

スタイル変換とデータ変換:AAEは潜在空間ベクトルを操作することで、入力間のスタイル変換を可能にし、画像を滑らかに変形させ、同じコンテンツの異なるバージョンを生成することができます。

半教師あり学習:AAEはラベル付きおよびラベルなしのデータを利用して教師あり学習のタスクを改善し、教師ありと教師なしアプローチのギャップを埋めることができます。

Adversarial Autoencoderの実装

AAEの実用的な理解を提供するために、TensorFlowを使用したPythonの実装について詳しく見ていきましょう。この例では、データのノイズ除去に焦点を当て、AAEがノイズのある入力からクリーンなデータを復元する際に優れた性能を発揮する方法を紹介します。

(注意:以下のコードを実行する前に、TensorFlowと関連する依存関係がインストールされていることを確認してください。)

import tensorflow as tf

from tensorflow.keras.layers import Input, Dense, Flatten, Reshape

from tensorflow.keras.models import Model

from tensorflow.keras.optimizers import Adam

from tensorflow.keras.losses import MeanSquaredError

from tensorflow.keras.datasets import mnist

import numpy as np

# Adversarial Autoencoderのアーキテクチャを定義する

def build_adversarial_autoencoder(input_dim, latent_dim):

input_layer = Input(shape=(input_dim,))

# エンコーダー

encoder = Dense(128, activation='relu')(input_layer)

encoder = Dense(latent_dim, activation='relu')(encoder)

# デコーダー

decoder = Dense(128, activation='relu')(encoder)

decoder = Dense(input_dim, activation='sigmoid')(decoder)

# Autoencoderを構築し、コンパイルする

autoencoder = Model(input_layer, decoder)

autoencoder.compile(optimizer=Adam(), loss=MeanSquaredError())

# Adversaryを構築し、コンパイルする

adversary = Model(input_layer, encoded)

adversary.compile(optimizer=Adam(), loss='binary_crossentropy')

return autoencoder, adversary

# MNISTデータセットをロードして前処理する

(input_train, _), (input_test, _) = mnist.load_data()

input_train = input_train.astype('float32') / 255.0

input_test = input_test.astype('float32') / 255.0

input_train = input_train.reshape((len(input_train), np.prod(input_train.shape[1:])))

input_test = input_test.reshape((len(input_test), np.prod(input_test.shape[1:])))

# AAEのパラメータを定義する

input_dim = 784

latent_dim = 32

# AAEを構築し、コンパイルする

autoencoder, adversary = build_adversarial_autoencoder(input_dim, latent_dim)

# AAEを訓練する

autoencoder.fit(input_train, input_train,

epochs=50,

batch_size=256,

shuffle=True,

validation_data=(input_test, input_test))

# ノイズ除去された画像を生成する

denoised_images = autoencoder.predict(input_test)ハイパーパラメータの調整

ハイパーパラメータの調整は、Adversarial Autoencoder(AAE)を含む任意の機械学習モデルの訓練において重要です。ハイパーパラメータは、モデルの訓練中の振る舞いを決定する設定です。これらのハイパーパラメータを適切に調整することは、生成されたサンプルの収束速度、安定性、品質に大きな影響を与えることができます。いくつかの重要なハイパーパラメータには、学習率、訓練エポック数、バッチサイズ、潜在次元、正則化強度などがあります。ここでは、訓練エポック数とバッチサイズの2つのハイパーパラメータを調整します。

# ハイパーパラメータの調整

epochs = 50

batch_size = 256

# AAEを訓練する

autoencoder.fit(input_train, input_train,

epochs=epochs,

batch_size=batch_size,

shuffle=True,

validation_data=(input_test, input_test))

# ノイズ除去された画像を生成する

denoised_images = autoencoder.predict(input_test)評価指標

AAEから生成されたデータの品質を評価することは、モデルが意味のある結果を生成することを確認するために重要です。以下によく使用されるいくつかの評価指標を示します:

- 再構築損失:生成されたサンプルが元のデータにどれだけうまく再構築できるかを測定します。再構築損失が低いほど、生成されたサンプルの品質が高いことを示します。

- Inceptionスコア:Inceptionスコアは、生成された画像の品質と多様性を測定します。実データでトレーニングされた補助分類器を使用して生成されたサンプルを評価します。Inceptionスコアが高いほど、多様性と品質が高いことを示します。

- Frechet Inception距離(FID):FIDは、Inceptionモデルの特徴空間で実データと生成データの特徴分布の距離を計算します。低いFID値は、生成されたサンプルが統計的に実データに近いことを示します。

- 生成データの精度と再現率:情報検索の分野のメトリックを生成データに適用することもできます。精度は高品質な生成サンプルの割合を測定し、再現率は高品質な実データのサンプルのうち、正しく生成された割合を測定します。

- 目視検査:定量的なメトリックではありませんが、生成されたサンプルを目視で検査することで、品質と多様性についての洞察を得ることができます。

# 評価指標

def compute_inception_score(images, inception_model, num_splits=10):

scores = []

splits = np.array_split(images, num_splits)

for split in splits:

split_scores = []

for img in split:

img = img.reshape((1, 28, 28, 1))

img = np.repeat(img, 3, axis=-1)

img = preprocess_input(img)

pred = inception_model.predict(img)

split_scores.append(pred)

split_scores = np.vstack(split_scores)

p_y = np.mean(split_scores, axis=0)

kl_scores = split_scores * (np.log(split_scores) - np.log(p_y))

kl_divergence = np.mean(np.sum(kl_scores, axis=1))

inception_score = np.exp(kl_divergence)

scores.append(inception_score)

return np.mean(scores), np.std(scores)結論

生成AIが研究者や実践者を魅了し続ける中で、Adversarial Autoencodersは生成ファミリーの独特で多目的なメンバーとして現れています。オートエンコーダの再構成能力とGANの敵対的なダイナミクスを組み合わせることで、AAEsはデータ生成と潜在空間の正則化という微妙なバランスを取ります。ノイズ除去、スタイル変換、ラベル付きおよびラベルなしデータの強力な活用能力により、AAEsはクリエイティブAIの武器庫の中で必須のツールセットとなっています。今回の旅が終わるにつれて、Adversarial Autoencodersは生成AIの新たな次元を開放し、制御とイノベーションを見事に融合させたデータ合成への道を切り拓くように私たちを誘うのです。

- Adversarial Autoencoders(AAEs)は、オートエンコーダと敵対的ネットワークを統合してデータを再構成し、潜在空間を正則化します。

- AAEsは異常検知、データのノイズ除去、スタイル変換、半教師あり学習などの応用があります。

- AAEsの敵対的なコンポーネントは、潜在空間の分布の遵守を強制する批評者ネットワークを導入し、創造性と制御をバランスさせます。

- AAEsの実装には、深層学習の概念、敵対的トレーニング、オートエンコーダのアーキテクチャの組み合わせが必要です。

- Adversarial Autoencodersの領域を探索することで、生成AIに対する独自の視点が提供され、新しいデータ変換と正則化のパラダイムが開かれることになります。

よくある質問

この記事に表示されるメディアはAnalytics Vidhyaの所有ではなく、著者の裁量で使用されています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles