Learn more about Search Results SFT

- You may be interested

- 「線形代数からディープラーニングまで 7...

- 「機械学習アルゴリズムとGAN」

- 2023年に使用するための11つのAIビデオジ...

- 大規模言語モデルに関するより多くの無料...

- 第四次産業革命:AIと自動化

- Concrete MLと出会ってください:プライバ...

- リシ・スナック、新しいグローバルAI安全...

- 学習されたプラズマ制御を通じて融合科学...

- 「MITのインドの学生が声を必要としない会...

- 「ChatGPTを使用してデータサイエンスのポ...

- 「DIRFAは、オーディオクリップをリアルな...

- Mixtral-8x7B スパースなエキスパートの混...

- 「シームレスM4Tに出会ってください:Meta...

- 「限られた訓練データで機械学習モデルは...

- AIコンテンツ検出機はどのように機能する...

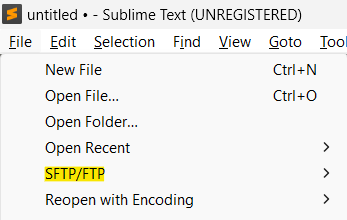

ファイル管理の効率化:サーバーまたはサーバー上で実行されているDockerコンテナーにおけるファイルの接続と変更をSFTPを使用してSublime Textで行うためのガイド

現在、多くの学術機関、研究所、およびクラウドサービスプロバイダーは、人々が実験を実行するためにアクセスできるGPU搭載サーバーを提供していますたとえば、私の大学は...

アップステージがSolar-10.7Bを発表:一回の会話用に深いアップスケーリングと微調整された精度を持つ先駆的な大規模言語モデルを実現

韓国のAI企業、Upstageの研究者たちは、言語モデルのパフォーマンスを最大化し、パラメータを最小化するという課題に取り組んでいます。モデルのサイズがパフォーマンスと関連している大規模言語モデル(LLM)において、Upstageは10.7兆の重み付けを持つ画期的なモデル、「Solar-10.7B」を導入しました。この革新は、3000億以上のパラメータを持つモデルにおけるモデルのサイズとパフォーマンスの間に生じる相反関係に対処しています。 既存のツールと異なり、UpstageのSolar-10.7Bは、Llama 2アーキテクチャを採用し、Upstage Depth Up-Scalingという新しい技術を使用しています。この方法は、Mistral 7BからアップスケーリングされたレイヤーにMistral 7Bの重み付けを統合し、包括的な事前学習を行います。Solar-10.7Bのコンパクトな設計と優れたパフォーマンスは、Mixtral 8X7Bなどのより大きなモデルすらも上回ります。さまざまな言語のタスクにおいて適応性と堅牢性を実証するための微調整と展示に理想的なモデルです。 さらに、Upstageはシングルターンの対話に特化したファインチューニング版「SOLAR-10.7B-Instruct-v1.0」も提供しています。監視付きファインチューニング(SFT)や直接的な意志最適化(DPO)など、最新のインストラクションのファインチューニング手法を活用し、多様なデータセットをトレーニングに使用しました。このファインチューニングモデルは、驚異的なModel H6スコア74.20を達成し、シングルターンの対話シナリオにおける効果を誇示しています。 Solar-10.7Bのパフォーマンスは、その洗練されたアーキテクチャとトレーニング戦略に根ざしています。Llama 2アーキテクチャを基にしたDepth Up-Scaling技術により、30兆パラメータまでのモデルを凌駕することができます。Mistral 7Bの重み付けをアップスケーリングされたレイヤーに統合することは、その素晴らしいパフォーマンスに貢献し、Mixtral 8X7Bモデルさえも上回ります。評価結果は、Solar-10.7Bの能力を示し、Model H6スコア74.20を記録しており、自然言語処理においてさらなるパフォーマンス最適化の追求を証明しています。 ファインチューニングされたSOLAR-10.7B-Instruct-v1.0は、他のモデルに比べて優れたModel H6スコア74.20でシングルターンの対話シナリオで優れたパフォーマンスを発揮しています。教授ベースのトレーニングのために慎重に選別されたデータセットを活用するこのファインチューニングアプローチは、その適応性とパフォーマンスの向上を一層強調しています。 まとめると、Solar-10.7Bおよびそのファインチューニング版は、大規模言語モデルの領域における重要な進歩を表しています。モデルのサイズとパフォーマンスのバランスを取るという課題に取り組むために、Upstageの研究者たちは戦略的にこれらのモデルを設計し、ファインチューニングして最先端の結果を提供しています。革新的なDepth Up-Scaling技術とMistral 7Bの統合は、適応性と効率性を示しています。研究者たちが言語モデルの開発の限界を押し広げ続ける中で、Solar-10.7Bとそのファインチューニング版は、自然言語処理におけるパフォーマンス最適化の追求の証となっています。 UpstageがSolar-10.7Bを発表:Depth Up-Scalingとファインチューニングされた精度によるシングルターン対話における大規模言語モデルの先駆的な取り組み は、MarkTechPostで最初に公開されました。

「QLoRAを使ってLlama 2を微調整し、AWS Inferentia2を使用してAmazon SageMakerに展開する」

この記事では、パラメータ効率の良いファインチューニング(PEFT)手法を使用してLlama 2モデルを微調整し、AWS Inferentia2上でファインチューニングされたモデルを展開する方法を紹介します AWS Neuronソフトウェア開発キット(SDK)を使用してAWS Inferentia2デバイスにアクセスし、その高性能を活用しますその後、[…]の動力を得るために、大きなモデル推論コンテナを使用します

ミストラルの最先端言語モデル、Mixtral 8x7bをご紹介しますGPT-3.5を超えるオープンアクセスAIです

大容量の言語モデルの領域は、Mixtral 8x7bの登場により、大きな進歩を遂げました。 Mistral AIは、印象的な機能と独自のアーキテクチャを持つこの新しいモデルを開発しました。このモデルは、Transformerモデルにおいて革新的なアプローチであるフィードフォワードレイヤーをスパースなエキスパート混合 (MoE) レイヤーで置き換えています。 Mixtral 8x7bは、1つのフレームワーク内に8つのエキスパートモデルを持つモデルです。このモデルはMixture of Experts(MoE)であり、Mixtralは卓越したパフォーマンスを実現できます。 エキスパートの混合は、モデルが著しく少ない計算能力で事前学習されることを可能にします。これにより、モデルやデータセットのサイズを大幅に拡大することができるため、計算予算を増やさずに行うことができます。 MoEレイヤーにはルーターネットワークが組み込まれており、どのエキスパートがどのトークンを効率的に処理するかを選択します。12Bパラメータの密なモデルよりも4倍のパラメータを持っているにもかかわらず、Mixtralのモデルは、各タイムステップごとに2つのエキスパートが選択されるため、高速でデコードできます。 Mixtral 8x7bは32,000トークンのコンテキスト長の容量を持ち、Llama 2 70Bを上回り、さまざまなベンチマークでGPT3.5と比較可能または優れた結果を示しています。研究者は、このモデルがさまざまなアプリケーションに対して柔軟に対応できると述べています。それは多言語対応であり、英語、フランス語、ドイツ語、スペイン語、イタリア語で流暢さを示しています。また、コーディングの能力も優れており、HumanEvalテストで40.2%のスコアを獲得し、包括的な自然言語処理ツールであることが確認されました。 Mixtral Instructは、MT-BenchやAlpacaEvalなどの業界標準でのパフォーマンスを示しました。MT-Benchでは、他のどのオープンアクセスモデルよりも優れたパフォーマンスを発揮します。また、7,000,000,000のパラメータを持っているにもかかわらず、このモデルは8つのアンサンブルのように機能します。56,000,000,000のスケールには達しませんが、総パラメータ数はおよそ45,000,000,000です。また、Mixtral Instructはインストラクションやチャットモデルの領域で優れた性能を発揮し、その支配的な地位を確立しています。 Mixtral Instructのベースモデルには、他のベースモデルと整合する特定のプロンプト形式がありません。この柔軟性により、ユーザーは入力シーケンスをスムーズに信憑性のある継続に拡張したり、ゼロショット/フューショットの推論に利用したりすることができます。 ただし、事前トレーニングのデータセットの寸法、構成、および前処理方法についての完全な情報はまだ不明です。同様に、Mixtral InstructモデルのDPO(ドメイン提供目的)およびSFT(いくつかのファインチューニング)に使用されるファインチューニングデータセットと関連するハイパーパラメータも不明です。 要約すると、Mixtral…

『UC BerkeleyがAIフィードバックから強化学習を使って訓練されたオープンなLLMを発表』

新しいレポートでは、UCバークレーの研究者がReinforcement Learning from AI Feedback(RLAIF)を使って作成された革命的な大規模言語モデルであるStarling-7Bを紹介しています研究者たちは、このモデルが最先端の技術と手法を取り入れ、自然言語処理の領域を再定義する助けになることを期待しています研究者たちは、...

「ハグフェース上のトップ10大きな言語モデル」

イントロダクション Hugging Faceは、自然言語処理の愛好家や開発者にとって宝庫となり、さまざまなアプリケーションに簡単に統合できる事前学習済み言語モデルの幅広いコレクションを提供しています。Large Language Models(LLM)の世界で、Hugging Faceは頼りになるプラットフォームとして際立っています。この記事では、Hugging Faceで利用可能なトップ10のLLMモデルを紹介し、言語理解と生成の進化する景色に貢献します。 さあ、始めましょう! Mistral-7B-v0.1 Mistral-7B-v0.1は、70億のパラメータを誇る大規模言語モデル(LLM)です。これは事前学習済みの生成テキストモデルとして設計されており、Llama 2 13Bが検証されたドメインで設定したベンチマークを上回ることで知られています。このモデルは、グループ化されたクエリアテンションやスライディングウィンドウアテンションなどの注意機構に特定の選択を行ったトランスフォーマーアーキテクチャに基づいています。Mistral-7B-v0.1は、Byte-fallback BPEトークナイザーも組み込んでいます。 ユースケースとアプリケーション テキスト生成:Mistral-7B-v0.1は、コンテンツ作成、創造的な文章作成、または自動ストーリーテリングなど、高品質のテキスト生成を必要とするアプリケーションに適しています。 自然言語理解:高度なトランスフォーマーアーキテクチャと注意機構を備えたこのモデルは、感情分析やテキスト分類などの自然言語理解を必要とするタスクに適用することができます。 言語翻訳:生成能力と大規模なパラメータサイズを考慮すると、このモデルはニュアンスのある文脈に即した正確な翻訳が重要な言語翻訳タスクで優れたパフォーマンスを発揮するかもしれません。 研究開発:研究者や開発者は、さまざまな自然言語処理プロジェクトでのさらなる実験や微調整のためにMistral-7B-v0.1をベースモデルとして活用することができます。 このLLMにはこちらでアクセスできます。 Starling-LM-11B-alpha この大規模言語モデル(LLM)は、110億のパラメータを持ち、NurtureAIから生まれました。このモデルは、その基盤としてOpenChat 3.5モデルを利用し、AIのフィードバックからの強化学習(RLAIF)によるfine-tuningを経ています。このアプローチでは、ヒトによってラベル付けされたランキングのデータセットを利用してトレーニングプロセスを誘導します。 ユースケースとアプリケーション Starling-LM-11B-alphaは、マシンとの対話方法を革新する潜在的な大規模言語モデルであり、オープンソースの性質、優れたパフォーマンス、多様な機能を備えており、研究者、開発者、クリエイティブプロフェッショナルにとって貴重なツールです。…

ハグ顔(Hugging Face)での最新技術の組み合わせであるミクストラル(Mixtral)へようこそ

Mixtral 8x7bは、ミストラルが本日リリースした刺激的な大型言語モデルで、オープンアクセスモデルの最新技術基準を上回り、多くのベンチマークでGPT-3.5を凌駕しています。私たちは、MixtralをHugging Faceエコシステムに包括的に統合してのローンチをサポートすることに興奮しています🔥! 本日リリースされる機能と統合には以下があります: ハブ上のモデル、モデルカードとライセンス(Apache 2.0) 🤗 Transformers統合 推論エンドポイントとの統合 高速で効率的な本番推論のためのテキスト生成推論との統合 🤗 TRLを使用した単一のGPUでのMixtralの微調整の例 目次 Mixtral 8x7bとは何ですか 名前について プロンプト形式 分からないこと デモ 推論 🤗 Transformersを使用する テキスト生成推論を使用する 🤗…

「OpenAIやLM Studioに頼らずにAutoGenを使用する方法」

イントロダクション OpenAIやLMスタジオに頼らずに、あなた自身のAIチームを作成する準備はできていますか?もはや銀行を荒らすことも、アプリをダウンロードすることもありません。llama-cpp-pythonの設定から、autogenフレームワークのヘルプを借りてローカルLLMのパワーを探求するまで。OpenAI APIに依存せず、Autogenのフルポテンシャルを引き出す準備をしましょう。 学習目標 詳細に入る前に、この記事の主な学習目標を概説しましょう: さまざまなAIライブラリとツールを評価・比較する方法を学ぶ。 llama-cpp-pythonがOpenAI APIの代替として提供できる方法を探索する。 2つの現実世界の使用例で獲得した知識を適用する: アルゴリズムメンターチームの構築と金融チャート生成の自動化。 AutoGenの改善されたユーザーエクスペリエンスを探索し、統合されたIPythonを通じて即時のコード実行結果を得る。 この記事はData Science Blogathonの一環として公開されました。 ツール紹介: llama-cpp-python、AutoGen、およびローカルLLM しかし、このテックツールキットの特別な点は何でしょうか? llama-cpp-pythonは、LLMAのような有名なモデルを含めて、ローカルでLLMを実行するためのゲートウェイです。コンピュータ上にAIのスーパースターがいるようなもので、さまざまなBLASバックエンドのサポートにより、速度は驚異的です! AutoGen AutoGenは、基盤モデルを使用するための高レベルな抽象化として機能する統一されたマルチエージェント会話フレームワークです。LLM、ツール、および人間の参加者を統合し、自動化されたチャットを通じて能力のある、カスタマイズ可能で会話形式のエージェントを結合します。エージェント同士が自律的にコミュニケーションして共同作業を行うことができ、複雑なタスクを効率的に進めることやワークフローを自動化することが可能です。 もしAutoGenの機能をより深く探求し、戦略的なAIチームビルディングをどのように支援するかを調べることに興味があるなら、当社の専用ブログ「Strategic AI Team Building…

AI2とワシントン大学の研究者が、LLMsの表面的な性質を明らかにし、チューニングフリーの新しい方法であるURIALを紹介した

ラージランゲージモデル(LLMs)は、人工知能(AI)やディープラーニングの分野での最近の革新です。GPT、PaLM、LLaMaなどのよく知られたLLMは、コンテンツの生成において非常に高いポテンシャルを示しています。質問応答やテキスト要約から言語翻訳やコード補完まで、これらのモデルは多くのことができます。ChatGPTを含むこれらのモデルは、広範な非監督テキストコーパスでの事前トレーニングを経ています。しかし、最近の研究は、従来のファインチューニングの採用方法が以前に考えられていたほど重要ではない可能性があると示唆しています。 オープンドメインのAIアシスタントとしての基本LLMの改善プロセスであるアライメントチューニングは業界標準と認められています。これには、人間のフィードバックからの強化学習(RLHF)や監視付きファインチューニング(SFT)が含まれます。この標準は、LIMAという研究によって問われ、SFTのためのわずか1,000のサンプルでも意味のあるアライメントパフォーマンスを達成することができると示されました。 LIMAが提案したスーパーフィシャルアライメント仮説では、基本LLMの振る舞いを根本的に変えるのではなく、特定のデータ形式を選択するようにトレーニングすることで、アライメントチューニングが行われる可能性があります。これにより、わずかな例でも高品質なアライメントモデルが監視付きファインチューニングによって生成されることが示されました。 スーパーフィシャルアライメント理論に確かな支持を見つけるための研究が不十分であるため、Allen Institute for Artificial Intelligenceおよびワシントン大学の研究チームは、最近の論文でアライメントチューニングの広く使用されている技術に取り組み、基本LLMを有用なオープンドメインのAIアシスタントにする方法を提案しています。選好チューニングは人間のフィードバックからの強化学習によって実現され、指導学習は監視付きファインチューニングによって実現されています。 チームは、基本LLMとそのアライメントされたバージョン(例:Llama-2およびLlama-2-chat)のトークン分布の変化を調査し、アライメント調整の影響を研究しました。彼らは、基本LLMとそのアライメントされたバージョンが上位ランクされたトークンを共有し、ほとんどのトークン位置でデコーディングにおいてほぼ同じパフォーマンスを発揮することを発見しました。ディスコースマーカーやセーフティディスクレイマーなどのスタイルトークンは、最も分布の変動を経験しています。この研究は、アライメント調整が主にAIアシスタントの言語スタイルを同化することに焦点を当てており、基本LLMがユーザーの問い合わせに応えるために必要な情報を提供しているという仮説の説得力のある証拠を提供しています。 チームはまた、SFTやRLHFなしで基本LLMをどの程度アラインできるかという研究トピックを提示しました。彼らは、URIAL(調整を必要としないLLMとコンテキスト内アライメント)というアライメント技術を提案しました。わずか3つの連続スタイルの例とシステムのプロンプトだけで、URIALは基本LLMとのコンテキスト内学習(ICL)のみを通じて効果的なアラインメントを達成します。 チームは、Mistral-7b-Instruct(SFTで調整されたLLM)やSFT+RLHF(Llama-2-70b-chat)でアラインされたLLMsと同等またはそれ以上のパフォーマンスを提供するURIALを持つ基本LLMの詳細で理解しやすい分析を提供する、just-eval-instructと呼ばれる一連のインスタンスで、チューニングフリーおよびチューニングベースのアライメント戦略のギャップを劇的に縮小することが示されました。 結論として、評価結果は浅いアライメントチューニングを強調し、基本LLMの言語スタイルの導入と既存の知識に委ねられることを示しています。

「大規模言語モデルの微調整方法:ステップバイステップガイド」

2023年、アルパカ、ファルコン、ラマ2、およびGPT-4のような大規模言語モデル(LLM)の台頭は、人工知能の民主化の傾向を示しています

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.