「AIセキュリティへの6つのステップ」

6 Steps to AI Security

ChatGPTの登場に伴い、すべての企業がAI戦略を考えようとしており、その作業にはすぐにセキュリティの問題が浮かび上がります。新しい技術のセキュリティを確保することに圧倒されるかもしれませんが、現在のポリシーとプラクティスは優れた出発点を提供しています。

実際には、エンタープライズとクラウドセキュリティの既存の基盤を拡張することが前進の道です。以下の6つのステップで要約できる旅です:

- 脅威の分析を拡大する

- 対応メカニズムを広げる

- データ供給チェーンを保護する

- AIを使用して取り組みを拡大する

- 透明性を持たせる

- 持続的な改善を作り出す

展望を広げる

最初のステップは、新しい状況に慣れることです。

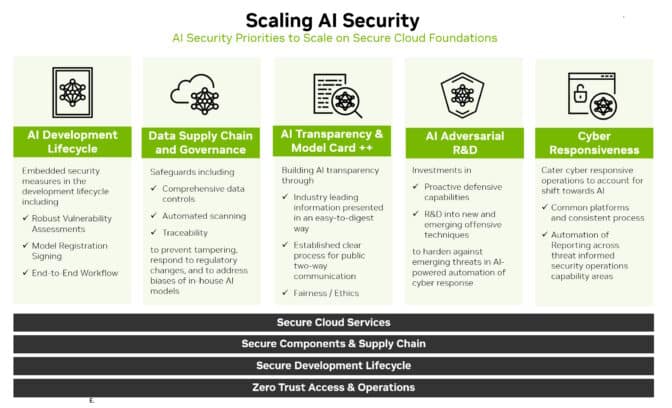

セキュリティは、AIの開発ライフサイクルもカバーする必要があります。これには、トレーニングデータ、モデル、それらを使用する人々とプロセスなど、新しい攻撃対象が含まれます。

既知の脅威のタイプから推測し、新たに現れる脅威を特定するために展開します。たとえば、攻撃者は、クラウドサービスでモデルのトレーニング中にデータにアクセスしてAIモデルの振る舞いを変更しようとするかもしれません。

過去に脆弱性を調査したセキュリティ研究者やレッドチームは、再び素晴らしいリソースとなります。彼らはAIシステムとデータへのアクセスが必要であり、新たな脅威を特定し対処するだけでなく、データサイエンススタッフとの堅固な協力関係の構築にも役立ちます。

防御を広げる

脅威の全体像が明確になったら、それに対抗する方法を定義します。

AIモデルのパフォーマンスを密接にモニタリングします。それはドリフトする可能性があり、新たな攻撃対象を開く可能性があることを前提として、従来のセキュリティ防御が侵害されることも前提としています。

また、既に存在するPSIRT(製品セキュリティインシデント対応チーム)のプラクティスを基に構築します。

たとえば、NVIDIAはAIポートフォリオを包括する製品セキュリティポリシーを公開しました。Open Worldwide Application Security Projectなどのいくつかの組織は、従来のITの脅威を特定するために使用される共通脆弱性列挙法など、主要なセキュリティ要素のAI向け実装をリリースしています。

ネットワークの制御とデータプレーンを分離する

既存の保護策を拡張する

AIモデルのトレーニングに使用されるデータセットを保護します。それらは貴重であり、脆弱です。

ここでも、企業は既存のプラクティスを活用できます。ソフトウェアのチャネルを保護するために作成されたセキュアなデータ供給チェーンを作成します。トレーニングデータのアクセス制御を確立することは重要です。

一部のギャップを埋める必要があるかもしれません。現在、セキュリティ専門家は、アプリケーションのハッシュファイルを使用して、コードが改ざんされていないことを確認します。このプロセスは、AIトレーニングに使用されるペタバイト規模のデータセットに対してスケーリングすることは難しいかもしれません。

良いニュースは、研究者がその必要性に気付いており、それに対処するためのツールを開発しているということです。

AIでセキュリティを拡大する

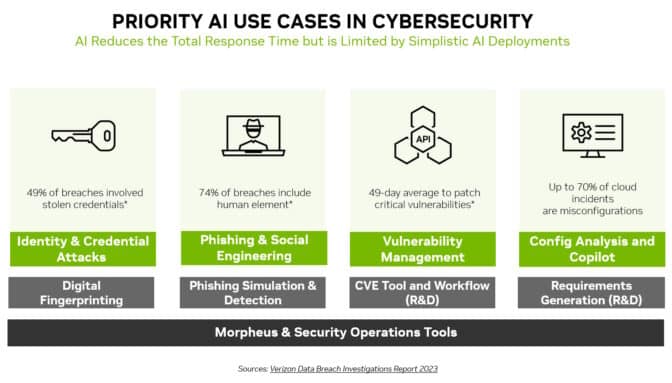

AIは防御する新たな攻撃領域だけでなく、新たな強力なセキュリティツールでもあります。

機械学習モデルは、ネットワークトラフィックの山に人間が見ることのできない微細な変化を検出することができます。これにより、AIはアイデンティティ盗難、フィッシング、マルウェア、ランサムウェアなど、最も広く使用される攻撃の多くを防ぐための理想的なテクノロジーとなります。

サイバーセキュリティフレームワークであるNVIDIA Morpheusは、多くの種類の脅威をスキャンするデジタルフィンガープリントを作成、読み取り、更新するAIアプリケーションを構築することができます。さらに、生成AIとMorpheusは、スピアフィッシングの試みを検出するための新しい方法を可能にすることができます。

セキュリティは明確さを好む

透明性はセキュリティ戦略の重要な要素です。新しいAIセキュリティポリシーや実践について顧客に知らせましょう。

たとえば、NVIDIAは加速ソフトウェアのハブであるNGCのAIモデルに関する詳細を公開しています。モデルカードと呼ばれるこれらの詳細は、AI、トレーニングに使用されたデータ、使用の制約などを説明する貸付行為に似たものです。

NVIDIAは、ユーザーがニューラルネットワークを本番環境に導入する前に、そのネットワークの歴史と制限が明確になるよう、拡張されたフィールドを使用しています。これにより、セキュリティの向上、信頼の確立、およびモデルの堅牢性が確保されます。

目的地ではなく、旅を定義する

これらの6つのステップは、旅の始まりに過ぎません。このようなプロセスやポリシーは進化する必要があります。

たとえば、機密コンピューティングの新しい実践では、AIモデルが頻繁に訓練および本番実行されるクラウドサービス全体にセキュリティを拡張しています。

業界では既にAIモデル用の基本的なコードスキャナーが見られるようになっています。これらは今後の兆候です。チームは、到着するベストプラクティスやツールに対して常に注視する必要があります。

途中で、コミュニティは学んだことを共有する必要があります。最近のジェネレーティブレッドチームチャレンジでは、それが優れた例として示されました。

結局のところ、共同防衛を作り上げることが重要です。私たちは皆、AIセキュリティの旅を一歩ずつ共に進んでいます。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles