「機械に学習させ、そして彼らが私たちに再学習をさせる:AIの構築の再帰的性質」

機械学習と再学習:AI構築の再帰的性質

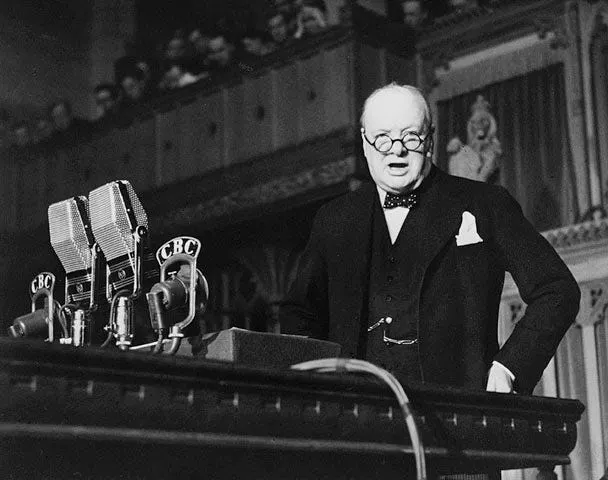

1941年5月10日、ドイツの爆弾によって、伝説的なイギリスの庶民院は燃え盛る廃墟と化しました。この有名なゴシック復古様式の建物は、200年以上にわたって激しい政治的討論の舞台となってきましたが、今やこの建築の象徴は灰となってしまいました。煙の中で、ひとつの切実な問いが浮かび上がりました。過去と同じように再建するか、海外で見られるような大胆なデザインに取り組むか。ウィンストン・チャーチルにとって、答えは明確でした。彼は1943年のスピーチで、「私たちは建物を形作り、その後建物が私たちを形作る」と述べ、古い議場の対立的な親密さがイギリスの民主主義の騒々しい魂に織り込まれていると信じていました。

広大な外国の立法府空間(米国議会議事堂の半円形の配置など)とは異なり、古い庶民院は427の席を狭い通路に詰め込み、対立する派閥を顔を合わせて向かい合わせに配置しました。直接的な対立によって駆り立てられた民主主義の精神は、責任を追求することにつながりました。騒々しいし、混沌としているかもしれませんが、それは真正性を持っていました。機能的な改善は可能であったとしても、チャーチルはこのアリーナの復元を推進しました。破壊されたにもかかわらず、数世紀にわたる騒々しい討論の場を保存することが優先されました。

建物のデザインが集団生活を形作るというチャーチルの感情は、建築設計を超えて広がっています。この考え方は、「建築決定論」と呼ばれることもあり、私たちの建築環境が人間の行動に深い影響を与えるというものです。都市計画家は、都市の大通りに沿って歩行者活動を促進するために歩道を広げるなど、これらの原則を意図的に適用します。また、風光明媚な小さな一車線の川の上に架かる橋を考えてみてください。その狭さは、運転手が順番を待つ間に忍耐と協力を促進します。

- 『Photoshopを越えて:Inst-Inpaintが拡散モデルでオブジェクト除去を揺るがす』

- 「トランスフォーマーの単純化:あなたが理解する言葉を使った最先端の自然言語処理(NLP)— パート1 — イントロ」

- テキストからビデオ生成 ステップバイステップガイド

デジタル時代においては、建築決定論は、大規模な言語モデルが社会に浸透することによって、AIシステムの構築において具現化されます。

私たちのアシスタントを形作る:人間のフィードバックを通じたAIの教育

OpenAIが2019年にGPT-2を発表した際、この自然言語モデルは大きな進歩を表していました。40 GBのインターネットテキストを教師なし学習で訓練された1,500万のパラメータを持つGPT-2は、驚くほど一貫した文章を生成することができました。しかし、一貫性にはまだ問題がありました。人間のガイダンスがない場合、GPT-2の印象的であるが目的を持たない能力は、有用な情報と同じくらい頻繁に冗長な迷走を生み出しました。

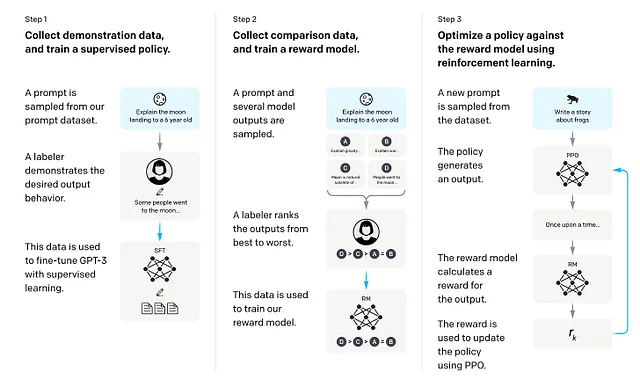

OpenAIは、自分たちの創造物を洗練するために、新しいアプローチを開拓しました。人間のフィードバックによる強化学習(RLHF)という技術です。論文「人間のフィードバックからの言語モデルの微調整」で詳しく説明されているこの技術は、人間の直感とAIを組み合わせてモデルを「有用な」振る舞いに導くものです。

この方法の動作は次のとおりです。GPT-2のようなベースモデルを出発点として、人間のトレーナーがシステムと対話し、ユーザーとAIの両方を演じます。この対話によって、人間の好みを反映したデータセットが作成されます。トレーナーは、モデルのサンプル応答をランキング付けすることでモデルをさらに形作り、品質に基づいて出力をスコアリングする「報酬モデル」を開発します。AIは報酬を最大化するようにモデルを微調整することで、徐々に改善され、人間の価値観により一致したテキストを生成するようになります。フィードバックと改善のサイクルを繰り返すことで、RLHFは一度はばらつきのあったモデルをより役立つ、的確なパートナーに仕上げます。

このアプローチの成果は、2022年にChatGPTで実現しました。RLHFを使用してトレーニングされたChatGPTは、思慮深く対話的な応答でユーザーを魅了しました。

人間の知恵の高いコスト

ChatGPTの突破後、他のAI研究所も迅速に人間のフィードバックによる強化学習(RLHF)を採用しました。DeepMind、Anthropic、Metaなどの企業は、Sparrow、Claude、LLaMA-2-chatなどのアシスタントを作成するためにRLHFを活用しました。

しかし、効果的である一方で、RLHFには膨大なリソースが必要です。各ラウンドでは、人間のトレーナーが対話を生成し、応答を評価し、大規模なガイダンスを提供する必要があります。GPT-3では、OpenAIはこの手間のかかるプロセスをケニアの契約業者に外部委託しました。この「非営利団体」の財政的支援により、この人間パワーのアプローチが可能になりましたが、そのようなコストは多くの人々にとってアクセスが制限される要因となっています。

![Anthropicの論文「[2204.05862] Training a Helpful and Harmless Assistant with Reinforcement Learning from Human Feedback」からのトレーニングシステム](https://miro.medium.com/v2/resize:fit:640/format:webp/0*RKcXOghubZb_Zzzi.png)

一部の組織は、この障壁を乗り越えるために創造的な方法を模索しています。Open Assistant Projectでは、一般の方々にクラウドソーシングプラットフォームを通じて直接モデルのトレーニングに貢献してもらうよう招待しています。DataBricksは内部でこのプロセスをゲーム化し、5,000人の従業員に楽しいウェブインターフェースを通じてサンプルの相互作用を評価するよう促しました。これにより、彼らは自社のアシスタントであるDollyのデータセットを迅速に構築することができました。Scale AIなどのスタートアップ企業も、RLHFに必要な人間の注釈を管理するためのサービスを提供しています。

クラスメートのコピー:LLMsを使ってお互いをブートストラップする

RLHFの高額な価格が多くの人々を妨げるため、一部の研究者は他の言語モデルの出力で人間のフィードバックを置き換えることでコストを削減しています。

スタンフォード大学のHuman-Centered AIグループは、このショートカットを実証しました。Metaの70億パラメータLLaMAをChatGPTのようなより能力のあるアシスタントに再構築するために、彼らは175のシードタスクを作成し、OpenAIのDaVinciモデルを使用してたった500ドルで52,000の例のデータセットを生成しました。煩雑な人間の注釈ではなく、ダヴィンチは自動的にラベル付けされたデータを生成しました。この合成データセットでLLaMAを微調整することで、合計600ドルで優れたアシスタントであるAlpaca-7Bが作成されました。

UCバークレーの研究者たちは協力して、ShareGPT(人々がChatGPTのスレッドを共有するウェブサイト)からスクレイピングした70,000の会話を使用して130億パラメータのVicunaモデルをトレーニングしました。Vicunaは、コストの一部でデータをトレーニングしたChatGPTの性能の90%に達しました。

一方、マイクロソフトと北京大学は、LLMを使用してシードデータを指数関数的に増やす革新的な方法であるEvol-Instructを開発しました。その結果として生まれたWizardLMは、特定のスキルでGPT-4をも上回り、合成データセットの力を示しています。

RedPajamaの1.2兆トークンのLLaMAのレプリカなど、オープンソースのデータセットもモデルのトレーニングを民主化することを目指しています。

私たちは見たものになる。私たちはツールを形作り、そしてツールが私たちを形作る

チャーチルは何世紀も前に、構築された空間が集団の規範を形作るという洞察を得ました。LLMsが合成トレーニングループを通じて急速に広まるにつれて、その初期モデルで行われた建築上の選択肢は、その出力が新しい世代をトレーニングする際に伝播します。初期の欠陥やバイアスは、微妙に連鎖的に伝わり、議論そのものを形作ります。

LLMsが毎日何百万人に読まれるテキストを生成すると、その特異性は人間の表現に浸透します。魅力的なチャットのために最適化されたモデルが作家にアドバイスすると、その傾向は公開されるコンテンツに浸透します。私たちのツールは私たちの価値観を反映し、時間の経過とともに私たち自身をそのイメージに作り変えます。

しかし、創造者と創造物の間のこのダンスは異常ではありません-それは人類の進歩の物語です。印刷機からテレビまで、発明品は常にその製作者に影響を与えるために循環してきました。LLMsは、私たちによって形作られる社会を形作る最新の発明品に過ぎません。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「Transformerベースの拡散モデルによる画像生成の革新的なアーキテクチャイノベーションを実現するDiffusion Transformers(DiTs)」

- LangChain + Streamlit + Llama ローカルマシンに会話型AIをもたらす

- 「転移学習の非合理的な効果」

- 「教師付き機械学習と集合論を通じた現実世界の時系列異常検出」

- 「Tabnine」は、ベータ版のエンタープライズグレードのコード中心のチャットアプリケーション「Tabnine Chat」を導入しましたこれにより、開発者は自然言語を使用してTabnineのAIモデルと対話することができます

- 効率化の解除:Amazon SageMaker Pipelinesでの選択的な実行の活用

- 「AIプロジェクトはどのように異なるのか」