「DreamPose」というAIフレームワークを使用して、ファッション画像を見事な写真のようなビデオに変換します

使用AIフレームワーク「DreamPose」でファッション画像を写真のようなビデオに変換します

ファッション写真は、ソーシャルメディアやEコマースのウェブサイトなど、オンラインプラットフォームで広く使われています。しかし、静止画としては、衣類に関する包括的な情報を提供する能力に制限があります。特に、衣類がどのように体にフィットし、動くかという点に関しては限られています。

一方、ファッションビデオはより完全かつ没入型の体験を提供し、生地の質感やドレープ、流れる様子など、静止画では難しい重要なディテールを見せることができます。

ファッションビデオは、消費者が情報を元に購買の意思決定をする際に貴重なリソースとなります。服の実際の動きをより詳しく見ることで、ショッパーは自身のニーズや好みに合うかどうかをより良く評価することができます。しかしながら、これらの利点にもかかわらず、ファッションビデオは比較的一般的ではなく、多くのブランドや小売業者は主に写真を使用して製品を紹介しています。より魅力的で情報量の多いコンテンツへの需要が増え続ける中、業界全体で高品質なファッションビデオの制作が増えることが予想されます。

- 遺伝的アルゴリズムを使用したPythonによるTV番組スケジューリングの最適化

- 「MACTAに会いましょう:キャッシュタイミング攻撃と検出のためのオープンソースのマルチエージェント強化学習手法」

- 「クラスタリング解放:K-Meansクラスタリングの理解」

これらの課題に対処する画期的な方法は、人工知能(AI)から生まれました。その名はDreamPoseであり、ファッション写真をリアルでアニメーション化したビデオに変換する新しいアプローチを提供します。

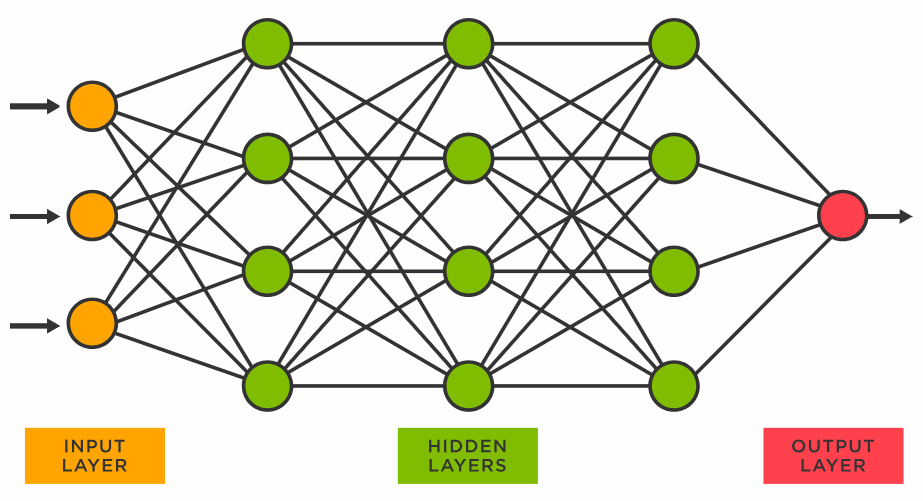

この手法は、Stable Diffusionをベースに構築された拡散ビデオ合成モデルを使用しています。人間の1つまたは複数の画像とそれに対応するポーズシーケンスを提供することで、DreamPoseは被写体のリアルで高忠実度のある動画を生成することができます。そのワークフローの概要は以下のように描かれています。

画像から高品質でリアルなビデオを生成するタスクには、いくつかの課題があります。画像拡散モデルは、品質と忠実度の点で印象的な結果を示していますが、同じことはビデオ拡散モデルには言えません。このようなモデルは、単純な動きやカートゥーンのようなビジュアルを生成するにとどまることが多いです。さらに、既存のビデオ拡散モデルには、時間的な一貫性の欠如、モーションの揺れ、現実味の欠如、およびターゲットビデオのモーションに対する制御の限定などの問題があります。これらの制約は、既存のモデルがテキストを主に条件としているため、他の信号(例:モーション)によって細かな制御が提供される場合でも一部原因となっています。

一方、DreamPoseは画像とポーズの条件付けスキームを活用して、外観の忠実度とフレーム間の一貫性を向上させています。このアプローチにより、既存のビデオ拡散モデルの多くの制約を克服することができます。さらに、入力された被写体の動きと外観を正確に捉えた高品質なビデオの制作が可能になります。

このモデルは、自然画像の分布を効果的にモデリングすることができる事前学習済みの画像拡散モデルからファインチューニングされます。このようなモデルを使用することで、画像のアニメーション化のタスクを、条件付け信号と一致する自然画像の部分空間を特定することにより簡略化することができます。そのために、Stable Diffusionのアーキテクチャが変更され、エンコーダと条件付けメカニズムが再設計され、アラインされた画像と非アラインのポーズの条件付けをサポートするようになっています。

さらに、入力画像を使用してUNetとVAEのコンポーネントをファインチューニングする2段階のプロセスが含まれています。このアプローチにより、入力被写体の外観と動きを正確に捉えた、リアルで高品質なビデオの生成にモデルが最適化されます。

この論文の著者によって報告された生成結果のいくつかの例が以下の図に示されています。さらに、この図にはDreamPoseと最先端の技術との比較も含まれています。

これが、単一の入力画像から写真のようなファッションビデオを合成する画期的なAIフレームワークであるDreamPoseの概要でした。興味がある方は、以下のリンクでこの技術についてさらに学ぶことができます。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- 「夢を先に見て、後で学ぶ:DECKARDは強化学習(RL)エージェントのトレーニングにLLMsを使用するAIアプローチです」

- 「トランスフォーマベースのLLMがパラメータから知識を抽出する方法」

- 「TR0Nに会ってください:事前学習済み生成モデルに任意のコンディショニングを追加するためのシンプルで効率的な方法」

- 「合成キャプションはマルチモーダルトレーニングに役立つのか?このAI論文は、合成キャプションがマルチモーダルトレーニングにおけるキャプションの品質向上に効果的であることを示しています」

- 「もしも、視覚のみのモデルを、わずかな未ラベル化画像を使って線形層のみを訓練することで、ビジョン言語モデル(VLM)に変換できたらどうでしょうか? テキストから概念へ(そしてその逆)のクロスモデルアラインメントによる、Text-to-Conceptの紹介」

- 「LogAIとお会いしましょう:ログ分析と知能のために設計されたオープンソースライブラリ」

- 「最も適応能力の高い生存者 コンパクトな生成型AIモデルは、コスト効率の高い大規模AIの未来です」