「ミット、ハーバード、ノースイースタン大学による『山に針を見つける』イニシアチブは、Sparse Probingを用いてニューロンを見つける」

ミット、ハーバード、ノースイースタン大学の『山に針を見つける』イニシアチブは、Sparse Probingを使ってニューロンを見つける

ニューラルネットワークは、初期の生の入力から適切な表現を徐々に洗練して学習する、適応型の「特徴抽出器」として考えられることが一般的です。そのため、次の疑問が生じます:どのような特性が表現され、どのように表現されているのでしょうか?高レベルで人間に解釈可能な特徴がLLM(Large Language Models)のニューロン活性化にどのように記述されているのかをよりよく理解するために、マサチューセッツ工科大学(MIT)、ハーバード大学(HU)、ノースイースタン大学(NEU)の研究チームは、スパースプロービングという技術を提案しています。

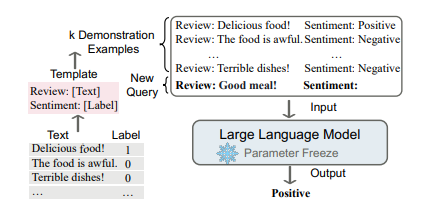

通常、研究者は、モデルの内部活性化を用いて基本的な分類器(プローブ)をトレーニングし、入力の特性を予測してから、ネットワークを調べて、質問された特徴がどこでどのように表現されているかを確認します。提案されたスパースプロービング法は、100以上の変数をプローブして関連するニューロンを特定するための手法です。この手法は、従来のプロービング手法の制約を克服し、LLMの複雑な構造に光を当てます。この手法では、プローブの予測にk個以下のニューロンしか使用しないように制限し、kの値は1から256の間で変動します。

研究チームは、最先端の最適スパース予測技術を使用して、kスパース特徴選択の副問題の小さなk最適性を実証し、ランキングと分類精度の混同を解決しています。彼らはスパース性を帰納バイアスとして使用し、プローブが強力な単純性の事前知識を保持し、詳細な検証のための重要なニューロンを特定できるようにしています。さらに、この手法は、興味のある特徴の相関パターンを記憶することを防ぐ容量不足により、特定の特性が明示的に表現され、後続で使用されているかどうかについて、より信頼性の高い信号を生成することができます。

- 「Prompt Diffusionを紹介する:拡散ベースの生成モデルにおけるコンテキスト内学習を可能にするAIフレームワーク」

- 「LLMはiPhone上でネイティブに動作できるのか? MLC-LLMとは、GPUアクセラレーションを備えた広範なプラットフォームに直接言語モデル(LLM)を導入するためのオープンフレームワークです」

- 「機械学習モデルからの情報漏洩を分析し、制約するための新しいAIの理論的枠組み」

研究グループは、自己回帰トランスフォーマーLLMsを実験に使用し、さまざまなk値でプローブをトレーニングした分類結果を報告しています。研究から以下のような結論を得ています:

- LLMsのニューロンは解釈可能な構造の豊富さを持ち、スパースプロービングはそれらを(重ね合わせでも)特定する効率的な方法であるが、厳密な結論を得るためには注意して使用し、分析を追加する必要がある。

- 初めのレイヤーの多くのニューロンが関連のないn-gramやローカルパターンのために活性化される場合、特徴は多義的なニューロンのスパースな線形組み合わせとしてエンコードされます。重みの統計やおもちゃのモデルから得られる洞察も、完全に接続されたレイヤーの最初の25%が重ね合わせを広範に使用していると結論付ける手がかりとなります。

- 一義性に関する決定的な結論は方法論的に到達できないが、特に中間層の一義的なニューロンは、より高いレベルの文脈的および言語的な特性(例:is_python_code)をエンコードする。

- モデルが大きくなるにつれて表現のスパース性が上昇する傾向があるが、全体的には一貫していない。モデルが大きくなると、一部の特徴は専用のニューロンとして現れ、他の特徴はより細かい特徴に分割され、他の特徴は変化せずにランダムに到着する。

スパースプロービングのいくつかの利点

- 単一のニューロンを調査する際に、分類の品質とランキングの品質を混同するリスクをさらに軽減するために、最適性を保証するプローブが利用可能である。

- また、スパースプローブは低いストレージ容量を持つように意図されているため、プローブがタスクを単独で学習できる可能性についての心配が少なくなります。

- プローブには監視されたデータセットが必要ですが、一度構築すれば、任意のモデルを解釈するために使用できます。これにより、学習した回路の普遍性や自然な抽象化仮説などの研究の可能性が広がります。

- 主観的な評価に頼る代わりに、異なるアーキテクチャの選択が多義的な要素と重ね合わせの発生にどのように影響を与えるかを自動的に調べるために使用することができます。

スパースプロービングには制限があります

- プロービング実験データからの強力な推論は、特定のニューロンの同定の追加の二次的な調査とともに行われる必要があります。

- プロービングは実装の詳細、異常、誤った指定、プロービングデータセットの誤解を受けることに対して感度があり、因果関係については限定的な洞察しか提供しません。

- 特に解釈性の観点からは、スパースプローブは複数のレイヤーを超えて構築された特徴を認識することができず、重ね合わせと多数の異なるより細かい特徴の和として表現される特徴を区別することもできません。

- スパースプロービングがプロービングデータセットの冗長性により一部の重要なニューロンを見逃す場合、すべての有意なニューロンを特定するために反復的な剪定が必要になる場合があります。複数のトークン特性を使用するには、一般に集約を使用した特殊な処理が必要であり、その結果の特異性がさらに低下する可能性があります。

革命的な疎なプロービング技術を使用して、私たちの研究はLLM(Language Model)において、豊富で人間に理解しやすい構造を明らかにします。科学者たちは、AIの助けを借りて、バイアス、正義、安全性、高リスクの意思決定に特に関連する詳細を記録する、広範なプロービングデータセットのリポジトリを構築する予定です。彼らは他の研究者にもこの「野心的な解釈可能性」の探求に参加することを奨励し、自然科学に似た実証的なアプローチが通常の機械学習の実験ループよりも生産的であると主張しています。広範で多様な教師付きデータセットを持つことで、AIの進歩に遅れを取らないために必要な次世代の教師なし解釈可能性技術の改善評価が可能になるだけでなく、新しいモデルの評価を自動化することも可能になります。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- PaLM AI | Googleの自家製生成AI

- 「TxGNN(テキストジーノーディープラーニング)にお会いしましょう:ジオメトリックディープラーニングとヒューマンセンタードAIを活用して、17,080の疾患の広範な範囲にわたる治療利用のゼロショット予測を行う新しいモデル」

- 「P+にお会いしましょう:テキストから画像生成における拡張テキスト反転のための豊かな埋め込み空間」

- 「日常的な言葉で説明された最も一般的な機械学習用語10選」

- MLflowを使用して機械学習の実験を追跡し、可視化する方法

- Googleの提供する無料のジェネレーティブAI学習パス

- ドリームブースと出会う:主体駆動型テキストから画像生成のためのAI技術