「ChatGPTなどの大規模言語モデル(LLM)がファインチューニングにおいて教師あり学習ではなく強化学習を使用する理由」の5つの理由

「ChatGPTなどの大規模言語モデル(LLM)のファインチューニングにおいて強化学習を使用する5つの理由」

過去数ヶ月間でのGenerative Artificial Intelligenceの大成功により、Large Language Modelsは絶えず進化と改善を遂げています。これらのモデルは、いくつかの注目に値する経済的および社会的変革に貢献しています。OpenAIが開発した人間と同様に有意義なテキストを生成できる自然言語処理モデルであるChatGPTは、質問に答えたり、長い段落を要約したり、コードやメールを作成したりすることができます。Pathways Language Model(PaLM)、Chinchillaなどの他の言語モデルも、人間を模倣する上で優れたパフォーマンスを示しています。

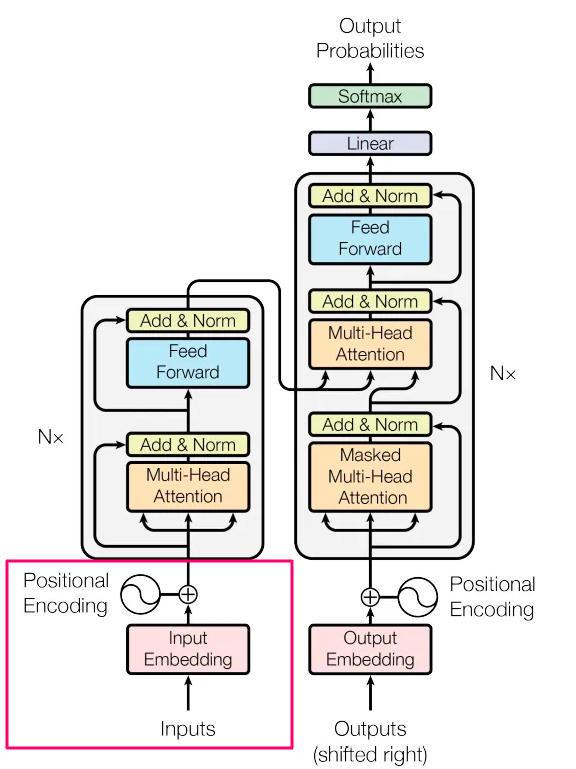

Large Language Modelsは、fine-tuningに強化学習を使用しています。強化学習は、報酬システムに基づくフィードバック駆動の機械学習手法です。エージェントは、特定のタスクを完了し、その行動の結果を観察することで、環境でのパフォーマンスを学習します。エージェントは、良いタスクごとに正のフィードバックを受け取り、悪い行動ごとにペナルティを受けます。ChatGPTのようなLLMは、強化学習のおかげで優れたパフォーマンスを発揮しています。

ChatGPTは、モデルのバイアスを最小化するためにHuman Feedbackからの強化学習(RLHF)を使用しています。しかし、なぜ教師あり学習ではなく強化学習を使用するのでしょうか?基本的な強化学習のパラダイムは、モデルをトレーニングするために使用されるラベルで構成されています。しかし、なぜこれらのラベルを教師あり学習のアプローチで直接使用できないのでしょうか?AIおよびMLの研究者であるSebastian Raschkaは、なぜ教師あり学習の代わりにfine-tuningに強化学習が使用されるのかについて、いくつかの理由を彼のツイートで共有しています。

- 「はい!OpenTelemetryはシステムのセキュリティを確保するための重要な要素です」

- 「さまざまな深層学習を用いた天気予測モデルに関する研究」

- 「CutLER(Cut-and-LEaRn):人間の注釈なしで物体検出とインスタンスセグメンテーションモデルをトレーニングするためのシンプルなAIアプローチによる出会い」

- 教師あり学習を使用しない最初の理由は、それがランクのみを予測するためです。それは整合性のある応答を生成しないだけでなく、モデルはトレーニングセットに似た応答に高いスコアを与えることを学習します。一方、RLHFはランキングスコアだけでなく、生成された応答の品質を推定するように訓練されます。

- Sebastian Raschkaは、教師あり学習を使用してタスクを制約最適化問題として再定式化するアイデアを共有しています。損失関数は、出力テキストの損失と報酬スコアの項を組み合わせます。これにより、生成された応答とランクの品質が向上します。ただし、このアプローチは、正しく質問-回答のペアを生成することを目的とする場合にのみ成功します。しかし、ユーザーとChatGPTの間で整合性のある会話を可能にするためには、累積報酬も必要であり、これは教師あり学習では提供できません。

- 教師あり学習は、トークンレベルの損失を最適化するためにクロスエントロピーを使用します。テキストパッセージのトークンレベルでは、応答の個々の単語を変更しても全体の損失にはほとんど影響がありませんが、整合性のある会話を生成するという複雑なタスクでは、単語が否定されると文脈が完全に変わる可能性があります。したがって、文脈と一貫性を考慮するためには、教師あり学習に頼ることは十分ではなく、RLHFが必要です。

- 教師あり学習はモデルをトレーニングするために使用できますが、経験的にはRLHFの方が優れたパフォーマンスを発揮することがわかっています。2022年の論文「Learning to Summarize from Human Feedback」は、RLHFがSLよりも優れた性能を発揮することを示しています。その理由は、RLHFが整合性のある会話の累積報酬を考慮する一方、SLはトークンレベルの損失関数のために捉えることができないためです。

- InstructGPTやChatGPTなどのLLMは、教師あり学習と強化学習の両方を使用しています。この2つの組み合わせは、最適なパフォーマンスを得るために重要です。これらのモデルでは、モデルはまずSLを使用して基本的な構造と内容を学習し、その後RLを使用してさらに更新されます。SLステージでは、モデルはタスクの基本的な構造と内容を学習しますが、RLHFステージでは、モデルの応答をより正確に洗練します。

この記事はMarkTechPostで最初に掲載されました。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles