「ジェネレーティブAIを正しくする責任は誰にあるのか?」

「ジェネレーティブAIの責任は誰にあるのか?」

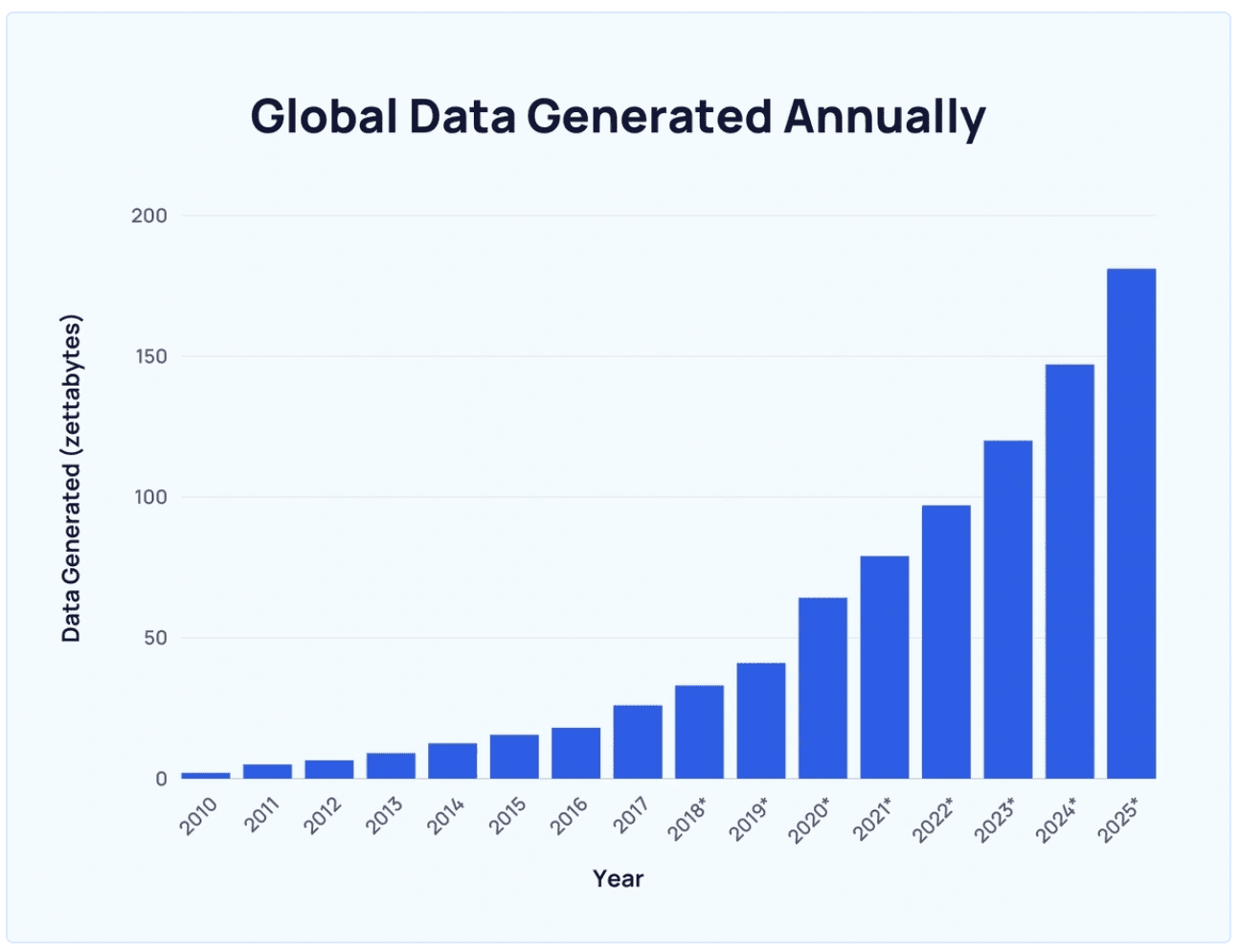

過去数年間にデータが作成された割合は指数関数的に増加しており、主にデジタル世界の普及の増加を示しています。

推定では、世界のデータの90%が過去2年間に生成されたとされています。

テキストメッセージの送信、動画の共有、音楽の作成など、インターネットとさまざまな形でやり取りするほど、私たちはGenerative AI(GenAI)技術を活用するためのトレーニングデータのプールに貢献しています。

- 「Pandasのスケーリング入門」

- 「MLパイプラインアーキテクチャのデザインパターン(10の実世界の例を使用)」

- 「トランスフォーマーと位置埋め込み:マスタリーのためのステップバイステップのNLPチュートリアル」

原則として、私たちのデータはこれらの先進的なAIアルゴリズムの入力として使用され、新しいデータを学習・生成します。

GenAIのもう一つの側面

初めは興味深く聞こえるかもしれませんが、現実が浮かび上がるとさまざまな形でリスクを引き起こすようになります。

これらの技術のもう一つの側面は、デマ情報、誤用、情報ハザード、深刻な偽造、炭素排出量など、さまざまな問題を引き起こします。

さらに、これらのモデルが多くの仕事を不要にするという影響も重要です。

Mckinseyの最近の報告書「Generative AI and the future of work in America」によれば、反復的なタスク、データ収集、基本的なデータ処理が含まれる仕事は、廃れるリスクが高まっています。

報告書は、基本的な認知能力や手作業スキルの需要の低下の原因の一つとして、自動化(GenAIを含む)を引用しています。

さらに、GenAI時代以前から続く重要な懸念であるデータプライバシーも課題となっています。GenAIモデルの核となるデータは、われわれのアイデンティティの一部であるインターネットから収集されます。

あるLLMは、本、記事、ウェブサイト、投稿などのデータをスクレイピングしてトレーニングされたと主張されています。問題なのは、私たちがその収集、利用、使用について気づいていなかったことです。

MIT Technology Reviewは、OpenAIがデータ保護のルールに従うことが「ほぼ不可能」と結論づけています。

オープンソースは解決策か?

私たち全員がこのデータの部分的な貢献者であることから、アルゴリズムをオープンソース化し、誰もが理解できるようにすることが期待されています。

オープンアクセスモデルは、コード、トレーニングデータ、モデルの重み、アーキテクチャ、評価結果など、必要なすべての詳細を提供します。

しかし、ほとんどの人がそれを理解できるでしょうか?おそらくそうではありません!

そのため、これらの重要な詳細を適切なフォーラムで共有する必要があります。それは、政策立案者、実践者、政府などの専門家委員会です。

この委員会は人類のために最善の選択をすることができます。それは、今日の個々のグループ、政府、または組織だけでは決定できないことです。

その主な目的は、社会的、経済的、政治的な視点を超えて、社会への影響を考慮し、GenAIの効果を評価することです。

ガバナンスはイノベーションを妨げるものではない

データの側面を置いておくと、このような巨大なモデルの開発者は、これらのモデルを構築するためのコンピューティングパワーを提供するために莫大な投資を行っています。したがって、彼らはこれらの投資に対する収益を得ることを望んでいます。そこで混乱が生じます。

AIパワードアプリケーションの開発とリリースを規制できるガバナンス機関を持つことは、イノベーションを阻害したりビジネスの成長を妨げるものではありません。

その代わりに、その主な目的は、より責任あるアプローチを促進しながら、ビジネスの成長を促進するためのガードレールやポリシーを構築することです。

では、責任の割合は誰が決め、その統括機関はどのようにして形成されるのでしょうか?

責任あるフォーラムの必要性

研究者、学界の専門家、企業、政策立案者、政府/国家の専門家からなる独立した組織が存在するべきです。独立とは、利益相反の可能性があるプレーヤーによる資金提供を受けていないことを意味します。

その唯一の目的は、この世界の80億人を代表して考え、合理化し、行動し、高い責任基準を持って判断することです。

これは大きな声明であり、このグループは焦点を絞り、任された課題をどのような副次的なものとも考えずに取り組まなければならないことを意味します。世界は、このような重要なミッションに取り組む意思決定者を「ある程度のもの」として、または付帯のプロジェクトとして扱う余裕はありません。また、彼らは十分に資金提供されなければなりません。

このグループは、技術から得られる利益を損なうことなく、害を解決するための計画と戦略を実行する責任が与えられています。

以前に行ったことがあります

AIはしばしば核技術と比較されています。その先端的な発展により、それに伴うリスクを予測することが困難になりました。

Rumman氏のWiredの記事に引用されたように、国際原子力機関(IAEA)は、政府や企業との関係を持たない独立した組織として形成され、核技術の遠大な影響と seemingly infinite capabilities に対する解決策を提供してきました。

過去には、世界が一致団結して混沌を秩序に変えるために取り組んだ例があります。私は確信していますが、我々はいずれそこに辿り着くことが重要です。ただし、展開の急速な進展についていくために、早急に収束しガードレールを形成することが重要です。

人類は、責任ある開発と展開を望む企業の自主的な措置に頼ることはできません。 Vidhi Chughは、AI戦略家であり、デジタルトランスフォーメーションのリーダーです。彼女は製品、科学、エンジニアリングの交差点でスケーラブルな機械学習システムを構築するために活動しています。彼女は受賞歴のあるイノベーションリーダー、著者、国際的なスピーカーです。彼女は機械学習の民主化とジャーゴンの壁を打破し、誰もがこの変革の一部になることを使命としています。

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles