Learn more about Search Results Adam - Page 9

- You may be interested

- 2023年のMLOpsの景色:トップのツールとプ...

- このAI研究により、チップデザインに適し...

- 「脳と体をモニターするイヤホン」

- AIOpsの力を解き放つ:最適化されたITオペ...

- MAmmoTHとは、一般的な数学問題解決に特化...

- トップ40+の生成AIツール(2023年10月)

- 「MITの新しい機械学習の研究では、階層的...

- 「リトリーバル増強生成によるジェネラテ...

- 「Sierra DivisionがNVIDIA Omniverseを使...

- メイヨークリニックのAI研究者たちは、拡...

- 「ZoomがAIトレーニングのために顧客デー...

- 「InstagramがAIによって生成されたコンテ...

- 非常に大規模な言語モデルとその評価方法

- 「みんなのためのLLM:ランニングLangChai...

- 「ジョンズ・ホプキンス大学の研究者たち...

「物理データを使用してコンピュータビジョンを再焦点化する」

「物理ベースのセンサーやシステムから収集されたメタデータを用いて従来のコンピュータビジョンデータを補完する方法を探索する」

「Adversarial Autoencoders オートエンコーダーとGANの間のギャップを埋める」

イントロダクション 機械学習のダイナミックな領域において、2つの強力な技術を組み合わせることで、Adversarial Autoencoders(AAEs)として知られる多目的なモデルが生まれました。オートエンコーダーとGenerative Adversarial Networks(GANs)の特徴をシームレスに組み合わせることで、AAEsはデータ生成、表現学習などの強力なツールとして登場しました。本記事では、AAEsの本質、アーキテクチャ、トレーニングプロセス、応用について探求し、理解を深めるためのPythonコードの実例を提供します。 この記事はData Science Blogathonの一部として公開されました。 オートエンコーダーの理解 AAEsの基盤となるオートエンコーダーは、データの圧縮、次元削減、特徴抽出のために設計されたニューラルネットワーク構造です。このアーキテクチャは、入力データを潜在空間の表現にマッピングするエンコーダーと、この圧縮された表現から元のデータを再構築するデコーダーから構成されています。オートエンコーダーは、画像のノイズ除去、異常検知、潜在空間の可視化など、さまざまな分野で重要な役割を果たしてきました。 オートエンコーダーは、効率的な次元削減を可能にしながら、データから意味のある特徴を抽出することができるニューラルネットワークの基本的なクラスです。エンコーダーは入力データを低次元の潜在表現に圧縮し、デコーダーはこの圧縮された形式から元の入力を再構築します。オートエンコーダーは、画像処理、自然言語処理などの領域を含むさまざまなタスクにおいて、ノイズ除去、異常検知、表現学習などの目的で使用されます。コンパクトで情報量のある表現を学習することにより、オートエンコーダーは複雑なデータセットの潜在的な構造に対する貴重な洞察を提供します。 Adversarial Autoencodersの紹介 Adversarial Autoencoders(AAEs)は、オートエンコーダーとGenerative Adversarial Networks(GANs)を巧みに組み合わせた革新的なモデルです。このハイブリッドモデルでは、エンコーダーが入力データを潜在空間にマッピングし、デコーダーが再構築します。AAEsの特徴的な要素は、生成されたデータサンプルの品質を評価するディスクリミネーターが存在する敵対的なトレーニングの統合です。この生成器とディスクリミネーターの間の敵対的な相互作用により、潜在空間が洗練され、高品質なデータ生成が促進されます。 AAEsは、データ合成、異常検知、教師なし学習などさまざまな応用で、堅牢な潜在表現を提供します。その多様性は、画像合成、テキスト生成などのさまざまな領域で有望なアプローチを提供しています。AAEsは、生成モデルの向上や人工知能の進歩に貢献する可能性があるため、注目を集めています。 オートエンコーダーとGANの潜在空間の探索を組み合わせることにより、Adversarial Autoencodersは生成モデリングに革新的な次元を加えます。オートエンコーダーの潜在空間の探索能力とGANの敵対的なトレーニングメカニズムの利点をバランスさせることで、AAEsはデータ生成の向上と潜在空間でのより意味のある表現を実現します。 AAEのアーキテクチャ AAEsのアーキテクチャの設計図は、エンコーダー、ジェネレーター、ディスクリミネーターの3つの重要な要素を中心に展開されています。エンコーダーは入力データを圧縮された表現に変換し、ジェネレーターはこれらの圧縮された表現から元のデータを再構築します。ディスクリミネーターは実際のデータと生成されたデータサンプルを区別することを目指した敵対的な要素を導入します。 AAEのトレーニング AAEsのトレーニングは、エンコーダー、ジェネレーター、ディスクリミネーターの3つの要素の反復的なダンスです。エンコーダーとジェネレーターは、再構築エラーを最小化するために協力し、生成されたデータが元の入力に似ていることを保証します。同時に、ディスクリミネーターは実際のデータと生成されたデータの区別能力を磨きます。この敵対的な相互作用により、洗練された潜在空間と改善されたデータ生成品質が実現されます。…

AWS Inferentiaでのディープラーニングトレーニング

この投稿のトピックは、AWSの自社開発AIチップ、AWS Inferentia、より具体的には第2世代のAWS Inferentia2ですこれは、昨年のAWS Trainiumに関する私たちの投稿の続編であり、...

「現代の好み引き出しにおける回帰とベイズ手法」

「線形回帰は予測モデリングの主力と考えられることが多いですが、その応用は単純な予測タスクを超えていますこの記事では、対話を豊かにすることを目指しています...」

大規模言語モデル(LLM)のファインチューニング入門ガイド

はじめに 人工知能の進化と自然言語処理(NLP)の驚異的な進歩をたどる旅に出ましょう。AIは一瞬で急速に進化し、私たちの世界を形作っています。大規模言語モデルの微調整の地殻変動的な影響は、NLPを完全に変革し、私たちの技術的な相互作用を革命化しました。2017年にさかのぼり、「Attention is all you need」という画期的な「Transformer」アーキテクチャが生まれたという節目の瞬間を思い起こしてみてください。このアーキテクチャは現在、NLPの基盤となるものであり、有名なChatGPTを含むすべての大規模言語モデルのレシピに欠かせない要素です。 GPT-3のようなモデルを使って、連続性のある文脈豊かなテキストを簡単に生成することを想像してみてください。チャットボット、翻訳、コンテンツ生成のためのパワーハウスとして、その輝きはアーキテクチャと事前学習と微調整の緻密なダンスによって生まれます。私たちの今回の記事では、これらの変革的な手法の魅力に迫り、大規模言語モデルをタスクに活用するための事前学習と微調整のダイナミックなデュエットを巧みに扱う芸術を明らかにします。一緒にこれらの変革的な手法を解き明かす旅に出ましょう! 学習目標 LLMアプリケーションを構築するさまざまな方法を理解する。 特徴抽出、レイヤーの微調整、アダプターメソッドなどの技術を学ぶ。 Huggingface transformersライブラリを使用して、下流タスクでLLMを微調整する。 LLMの始め方 LLMは大規模言語モデルの略です。LLMは、人間のようなテキストの意味を理解し、感情分析、言語モデリング(次の単語の予測)、テキスト生成、テキスト要約など、さまざまなタスクを実行するために設計されたディープラーニングモデルです。これらのモデルは膨大なテキストデータで訓練されます。 私たちは、これらのLLMをベースにしたアプリケーションを日常的に使っていますが、それに気づいていないことがあります。GoogleはBERT(Bidirectional Encoder Representations for Transformers)を使用して、クエリの補完、クエリの文脈の理解、より関連性の高く正確な検索結果の出力、言語翻訳など、さまざまなアプリケーションで使用しています。 これらのモデルは、深層学習の手法、複雑なニューラルネットワーク、セルフアテンションなどの高度な技術を基に構築されています。これらのモデルは、言語のパターン、構造、意味を学ぶために膨大なテキストデータで訓練されます。 これらのモデルは広範なデータセットで訓練されているため、それらを訓練するには多くの時間とリソースがかかり、ゼロから訓練することは合理的ではありません。特定のタスクにこれらのモデルを直接使用する方法があります。それでは、詳細について説明しましょう。 LLMアプリケーションを構築するさまざまな方法の概要 私たちは日常生活で興味深いLLMアプリケーションをよく見ます。LLMアプリケーションを構築する方法について知りたいですか?以下はLLMアプリケーションを構築するための3つの方法です: ゼロからLLMを訓練する…

「LLMガイド、パート1:BERT」 LLMガイド、パート1:BERTについてのガイドです

2017年は、Transformerモデルが初めて登場した機械学習の歴史的な年でした多くのベンチマークで驚くべきパフォーマンスを発揮し、さまざまな用途に適しているようです...

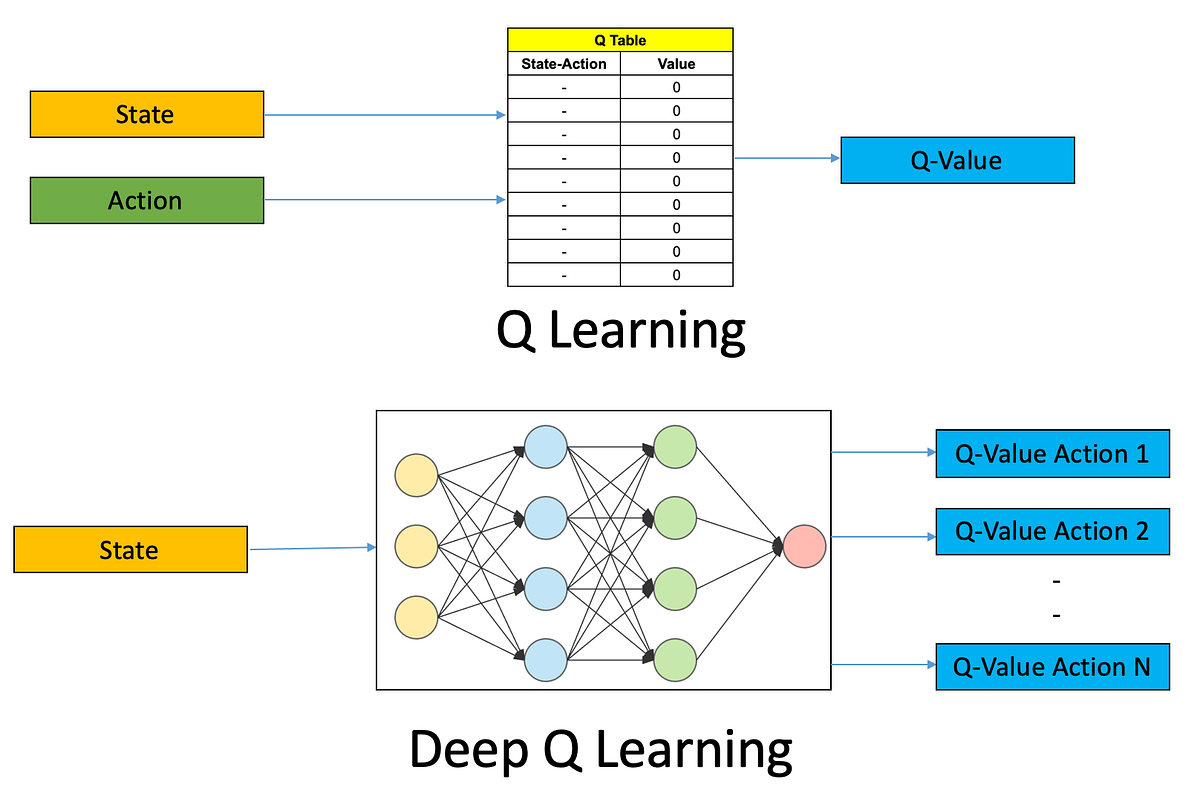

初めてのDeep Q学習ベースの強化学習エージェントをトレーニングする:ステップバイステップガイド

強化学習(RL)は、人工知能(AI)の魅力的な領域であり、機械が環境との相互作用を通じて学習し、意思決定を行うことができるようにしますRLエージェントを訓練する...

銀行の苦情に関する架空のデータ

この記事は、架空の顧客クレームを模倣した新しい架空のデータセットを紹介しています一般的な消費者銀行で顧客サービスマネージャーとして働いていると想像してください

Siameseネットワークの導入と実装

イントロダクション シャムネットワークは、たった1つの例に基づいて正確な画像分類を可能にする興味深いアプローチを提供します。これらのネットワークは、データセット内の画像のペアの類似性を測定するためにコントラスティブロスと呼ばれる概念を使用します。画像の内容を解読する従来の方法とは異なり、シャムネットワークは画像間の変動と類似点に集中しています。この独特な学習方法は、限られたデータのシナリオにおいても強さを発揮し、ドメイン固有の知識なしでも性能を向上させます。 この記事では、シャムネットワークのレンズを通して署名の検証の魅力的な領域に深く入り込みます。PyTorchを使用して機能的なモデルを作成する方法について、洞察と実装手順を提供します。 学習目標 シャムネットワークの概念と双子のサブネットワークを含むユニークなアーキテクチャの理解 シャムネットワークで使用されるロス関数(バイナリクロスエントロピー、コントラスティブロス、トリプレットロス)の違いを理解する シャムネットワークが効果的に使用できる実世界のアプリケーション(顔認識、指紋認識、テキストの類似性評価など)を特定し説明する シャムネットワークの1ショット学習、汎用性、ドメインに依存しないパフォーマンスに関する利点と欠点をまとめる この記事はデータサイエンスブログマラソンの一部として公開されました。 シャムネットワークとは何ですか? シャムネットワークは、ワンショット分類のために2つの同じ構造のサブネットワークを使用するネットワークのカテゴリに属しています。これらのサブネットワークは、異なる入力を受け入れながら、同じセットアップ、パラメータ、重みを共有します。シャムネットワークは、複数のクラスを予測するために豊富なデータで訓練される従来のCNNとは異なり、類似性関数を学習します。この関数により、少ないデータを使用してクラスを識別することができるため、ワンショット分類に非常に効果的です。このユニークな能力により、これらのネットワークは多くの場合、1つの例で正確に画像を分類することができます。 シャムネットワークの実世界の応用例として、顔認識や署名の検証のタスクがあります。例えば、会社が自動顔認識に基づいた出席システムを導入するとします。従来のCNNでは、各従業員の1枚の画像しか利用できないため、正確に何千人もの従業員を分類するのは困難です。そこでシャムネットワークが登場し、このようなシナリオで優れた性能を発揮します。 フューショットラーニングの探求 フューショットラーニングでは、モデルは限られた数の例に基づいて予測を行うためのトレーニングを行います。これは、従来のアプローチとは対照的で、トレーニングには大量のラベル付きデータが必要です。フューショットモデルのアーキテクチャは、わずかな数のサンプル間の微妙な違いを活用し、わずかな数やたった1つの例に基づいて予測を行うことができます。シャムネットワーク、メタラーニングなどのさまざまな設計フレームワークが、この機能を可能にします。これらのフレームワークは、モデルが意味のあるデータ表現を抽出し、それを新しい、未知のサンプルに使用することができるようにします。 フューショットラーニングが活躍する実用例には、以下のものがあります: 監視カメラにおける物体検出: フューショットラーニングは、物体の検出において、それらの物体の例がわずかしかない場合でも効果的に識別することができます。わずかなラベル付きの例を使ってモデルをトレーニングした後、それらの物体を新しい映像で検出することができます。 2. 個別のヘルスケア: 個別のヘルスケアでは、医療専門家は患者の医療記録の限られたセットを持っている場合があります。これにはCTスキャンや血液検査の少数の例が含まれます。フューショットラーニングモデルを使用すると、トレーニング用のわずかな例から、患者の将来の健康状態を予測することができます。これには、特定の疾患の発症の予測や特定の治療法への反応の予測などが含まれます。 シャムネットワークのアーキテクチャ Siameseネットワークの設計には、2つの同一のサブネットワークが含まれており、それぞれが入力の1つを処理します。最初に、入力は畳み込みニューラルネットワーク(CNN)を介して処理されます。このCNNは、提供された画像から有意な特徴を抽出します。その後、これらのサブネットワークはエンコードされた出力を生成し、通常は完全に接続された層を介して、入力データの縮約表現を生成します。 CNNは、2つのブランチと共有の特徴抽出コンポーネントで構成される、畳み込み、バッチ正規化、ReLU活性化、最大プーリング、およびドロップアウト層のレイヤーからなります。最後のセグメントでは、抽出された特徴を最終的な分類結果にマッピングするFC層が含まれています。関数は、線形層の後にReLU活性化のシーケンスと連続的な操作(畳み込み、バッチ正規化、ReLU活性化、最大プーリング、およびドロップアウト)の系列が続きます。フォワード関数は、入力をネットワークの両方のブランチに案内します。 差分層は、入力の類似性を特定し、異なるペア間の差を増幅するためにユークリッド距離関数を使用します:…

「エンティティ解決とグラフニューラルネットワークを用いた詐欺検知」

オンライン詐欺は、金融、電子商取引、およびその他の関連産業にとってますます深刻な問題ですこの脅威に対応するため、組織は機械学習と…に基づく詐欺検知メカニズムを使用します

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.