Learn more about Search Results Discord - Page 8

- You may be interested

- 「OpenAI WhisperとHugging Chat APIを使...

- 「このように考えて私に答えてください:...

- 動くAI

- 「DEHBを使用したXGBoostとPythonを使った...

- データは「何を」教えてくれますが、私た...

- 「RBIは、Conversational AIとオフライン...

- 「OceanBaseを使用して、ゼロからLangchai...

- Azure Machine Learningにおける生成AI:A...

- アリババAI研究所が提案する「Composer」...

- 「知っておくべきトップBERTの応用事例」

- 「回答付きのトップ50のAIインタビューの...

- 新しいAIの研究は、事前学習済みおよび指...

- 「LLMの解読:PythonでスクラッチからTran...

- 『Stack OverflowがOverflowをリリース:...

- AIコンテンツ検出機はどのように機能する...

実践的な3Dアセット生成:ステップバイステップガイド

イントロダクション 生成AIは、ゲーム開発の芸術的なワークフローの重要な一部となっています。しかし、私の以前の記事で詳しく説明したように、テキストから3Dへの変換は2Dに比べて実用性が劣っています。しかし、これは変わり始めています。今日は、3Dアセット生成の実用的なワークフローを見直し、Generative AIをPS1スタイルの3Dワークフローに統合する方法をステップバイステップで見ていきます。 なぜPS1スタイルなのか?現在のテキストから3Dモデルへの変換の低保真度に対して非常に寛容であり、できるだけ少ない努力でテキストから使用可能な3Dアセットに変換することができるからです。 前提条件 このチュートリアルでは、BlenderとマテリアルやUVマッピングなどの3Dの基本的な知識があることを前提としています。 ステップ1:3Dモデルを生成する まず、ここまたは下にあるShap-E Hugging Face Spaceを訪れてください。このスペースでは、オープンソースのShap-Eモデルを使用して、テキストから3Dモデルを生成します。 プロンプトに「Dilapidated Shack」と入力し、「Generate」をクリックしてください。モデルに満足したら、次のステップのためにダウンロードしてください。 ステップ2:モデルをインポートしてダウンサンプリングする 次に、Blender(バージョン3.1以上)を開いてください。ファイル -> インポート -> GLTF 2.0に移動し、ダウンロードしたファイルをインポートしてください。多くの実用的なアプリケーション(ゲームなど)に推奨されるよりも多くのポリゴンを持っていることに気付くかもしれません。 ポリゴン数を削減するには、モディファイアに移動して、「Decimate」モディファイアを選択します。比率を低い数値(例:0.02)に調整します。これはあまり見栄えがしないかもしれません。しかし、このチュートリアルでは低保真度を受け入れることにします。 ステップ3:Dream Texturesをインストールする モデルにテクスチャを追加するために、Blender用の安定した拡散テクスチャ生成ツールであるDream…

「ODSC West Bootcampプログラムから期待できること」

データサイエンスのキャリアをスタートする際、どの道を選ぶか迷うことがあります不確実性のある状況から出発する際には、従来のブートキャンプの費用(時間とお金)を正当化するのは難しいですODSC Westのミニブートキャンプでは、10月30日から11月2日まで、...

このAIニュースレターは、あなたが必要なもの全てです#58

今週、私たちはNLPの領域外でAIの2つの新しい進展を見ることに興奮しましたMeta AIの最新の開発では、彼らのOpen Catalystシミュレーターアプリケーションの発表が含まれています

あなたの製品の開発者学習のためのLLM(大規模言語モデル)

「LLM(Large Language Models)とLLMアプリを活用して、効果的かつ効率的な開発者教育を進め、製品の活用を促進する方法を探求してください」

「OpenLLMの紹介:LLMのためのオープンソースライブラリ」

「大規模言語モデル(LLM)を本番環境で操作するためのユーザーフレンドリーなプラットフォームで、ファインチューニング、サービング、デプロイメント、および任意のLLMのモニタリングなどの機能が備わっています」

「2023年の最高の人工知能AIベースのアート生成器」

Dream by Wombo 夢Womboによると、他のAI画像生成器とは異なり、追加費用なしで連続的な画像合成が可能です。予算が限られているか、初めて始める場合には、このAI生成器が素晴らしい選択肢です。夢Womboは非常に使いやすいです。始める前にサインアップし、いくつかのコンテンツを作成し、画像スタイルを選択する必要があります。生成されたビジョンのタイプが気に入らない場合は、常に新たに始めることができます。 DALL-E 2 OpenAIは2021年にDALL-Eという名前の新しいバージョンの画像生成AIモデルDALL-E 2をリリースしました。DALL-E 2は、前作と同様に、テキスト入力に応じてプロの水準の画像を生成するように設計されています。DALL-E 2は、より高品質でより洗練された画像を生成する能力を含む、いくつかの点で前作を改善しています。DALL-E 2は、より洗練されたテキスト信号を処理し、さまざまな視覚的表現に応答することができます。また、特定の主題や場所の画像を撮る場合など、特定の用途や分野に適応することもできます。 Midjourney Midjourneyは、その広範な能力と非常に高速な合成速度のため、おそらく最高の人工知能(AI)画像生成器です。MidjourneyにSMSコマンドを送信すると、残りの作業を引き受けてくれます。多くのクリエイティブプロフェッショナルは、自分の作品のインスピレーションとなる画像を生成するためにMidjourneyを使用しています。Midjourneyで作られた人工知能の作品「Théâtre d’Opéra Spatial」は、コロラド州の州博覧会の美術部門で20人の他の画家を抑えて1位を獲得しました。ただし、現時点では、MidjourneyはDiscordサーバー上で見つけることができます。MidJourney Discordサーバーに参加し、ボットのコマンドを使用して画像を作成する必要があります。ただし、それは簡単で、すぐに作業を開始できます。 Dream Studio(Stable Diffusion) Dream Studio、またはStable Diffusionとしても知られる、人気のあるテキストから画像へのAI生成器です。無料で利用できるパブリックモデルであり、テキストの提案を即座に視覚化することができます。写真、イラスト、3Dモデル、さらにはロゴまで、Dream Studioは可能な創造物の範囲内で作成することができます。ユーザーがアップロードした画像と書かれた説明を組み合わせることで、写真のような写実的な作品が作成されます。 Craiyon…

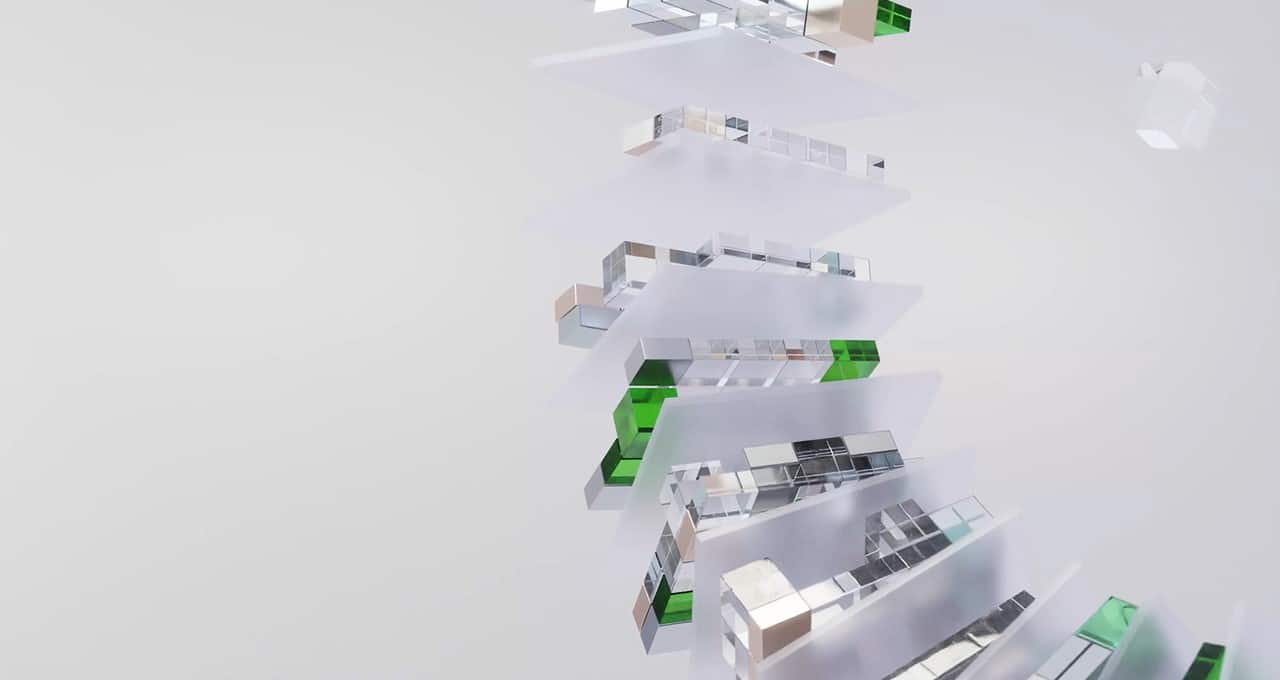

「AIと産業のデジタル化の時代に、開かれたUSDに開発者が注目」 Note OpenUSD refers to an open-source software library called USD (Universal Scene Description), which is commonly used in computer graphics and animation.

スマートファクトリーから次世代の鉄道システムまで、世界中の開発者と企業は、あらゆるスケールで産業のデジタル化の機会を追いかけています。 その鍵となるのは、オープンソースのUniversal Scene Description(USD)フレームワークであるOpenUSDと、AIによって駆動されたメタバースアプリケーションです。 OpenUSDは、元々ピクサーが大規模な映画パイプラインのために開発したもので、高品質な3Dワールドに強力なエンジンを提供するだけでなく、AIとメタバースの時代に対応した広範なエコシステムも提供しています。自動車、医療、製造など、さまざまな産業で、OpenUSDがさまざまなアプリケーションに採用されています。 開発者がOpenUSDを使用する方法 開発者はOpenUSDの拡張性を活用して、最新のAIツールやトップのデジタルコンテンツ作成ソリューションをカスタムの3Dワークフローとアプリケーションに統合することができます。 BMW Groupなどの企業では、社内の開発者がデジタルツインのユースケースを最適化し、相互作用するためのカスタムアプリケーションを開発しています。この自動車メーカーは、NVIDIA Omniverseを使用した仮想工場上でのリアルタイムの協力を可能にするアプリケーションを開発しました。NVIDIA Omniverseは、3Dツールを構築し接続するためのOpenUSD開発プラットフォームです。 Move.ai、SmartCow、ipologなどのスタートアップもOpenUSDを使用して画期的なメタバース技術を開発しています。Omniverseのモジュラー開発プラットフォームでUSDを使用することにより、スタートアップや中小企業は簡単にメタバース向けの新しいツールを立ち上げ、大企業が使用できるようにすることができます。 さらに、Esri、Bentley Systems、Vectorworksなどの主要な3Dソリューションプロバイダーは、OpenUSDと連携して新しい能力をメタバースに提供し、より多くの顧客にアプローチしています。OpenUSDを活用することで、彼らのアプリケーションは産業メタバースの進化するニーズに連続的に拡大することができます。 「USDのおかげで、3D設計プロセスにおいて顧客により柔軟性を提供することができます」と、VectorworksのシニアディレクターであるDave Donleyは述べています。「USDを受け入れることで、Vectorworksとそのユーザーは建築、景観デザイン、エンターテイメントなどの産業で、より協力的で革新的な未来を牽引することができます。」 開発者がOpenUSDを使用する理由 かつては、3Dコンテンツの作成では直線的で孤立したワークフローが一般的でした。今日、企業は多様で分散した高度なスキルを持つチームを統合し、競争力を維持するためにオファリングを拡大する必要があります。特に、生成型AIにおいてはそうです。 このためには、柔軟なデザインの共同作業が重要であり、開発者がオープンでモジュール化された拡張性のあるフレームワークで作業する能力も重要です。AIとメタバースのイノベーションのペースが加速するにつれて、閉じた環境で新機能や機能を構築しようとする企業は遅れを取る可能性があります。 メタバースの3Dワールドは、デザイン、シミュレーション、AIの進歩をもたらす新しい時代を迎えていますが、スケーラビリティと相互接続を可能にする共通のフレームワークが必要です。2Dウェブと同様に、メタバースの成功はオープンスタンダードとプロトコルによって規定される相互運用性に依存します。 OpenUSDは、拡張性とオブジェクトの定義とレンダリングのためのさまざまなプロパティをサポートする能力により、多様なメタバースアプリケーションに適しています。単なるファイルフォーマット以上のものであるこのインターチェンジフレームワークは、クリエイティブと開発者のツールのロバストなエコシステムを結びつけています。 3D地理空間ワークフローのプラットフォームであるCesiumは、建設、ロボット工学、シミュレーション、気候変動のためのデジタルツインなど、産業メタバースアプリケーションを構築するためにUSDを使用しています。 「USDの相互運用性を3D TilesとglTFと組み合わせることで、Bentley…

AIアートのマスタリング:中間の旅とプロンプトエンジニアリングへの簡潔なガイド

Midjourneyのマスタリングに最適な初心者向けガイドに飛び込んでみてくださいAI画像生成、高度なプロンプト、革新的な機能を簡単で分かりやすいステップで探索してくださいAI芸術の力を活用したい愛好家やプロフェッショナルに最適です

2023年の最高のAIゲームジェネレーター

AIゲームジェネレータは、AIアルゴリズムを使用して完全なビデオゲームを作成することができます。これらのゲームは、単純なカードゲームから複雑な戦術競技まで何でもあります。 AIゲームジェネレータは、デザイナーが自分自身でコードを書かずに、楽しくて挑戦的なゲームをプレーヤーに提供することができるため、ますます人気が高まっています。 AIゲームジェネレータを使用することの主な利点は、より速い反復時間、より厳密な品質保証、より没入型のゲームプレイ、およびより優れたプラットフォームの移植性です。さらに、AIゲームジェネレータは、より従来的な作成方法では不可能な完全に新しい体験を作成するために利用することができます。 シナリオ シナリオは、ビデオゲームの視覚化のためのさまざまなオプションを備えた人工知能駆動のプログラムです。その目的は、ゲームデザイナーがゲームの全体的な美学に合ったオリジナルで高品質なゲームアートを作成するのを支援することです。シナリオの微調整可能性は、最も印象的な特徴の1つです。この機能を使用すると、AIモデルに自分の美学を模倣するように教えることができます。トレーニングデータをアップロードし、AIがそれを分析し、再発するテーマ、色、デザインを学習することができます。AIがトレーニングされた後、あなたの美的嗜好を反映した新しい画像を作成できます。 Promethean AI Promethean AIは、ビデオゲームの仮想世界を作成する際に早期に採用されました。このプログラムはAIを使用して3Dセッティングの作成を効率化し、ゲームデザイナーが広範で没入感のある世界を作成することを容易にしました。 Promethean AIの特徴は、最小限の入力で新しいセットを構築できる能力です。 Promethean AIを使用すると、密集した森林や未来都市など、夢の世界を迅速かつ簡単に作成することができます。 Ludo.ai 楽しくて興味深いゲームを作る場合、Ludo.aiはルールを完全に変えます。人工知能がプレーヤーのアクションを監視し、ゲームを個々のプレーヤーの能力、好み、プレースタイルに合わせて調整します。 Ludo.aiは、競技者の行動について有益な情報も提供するため、競争相手についてより多くのことを学び、より上手にプレイすることができます。 Rosebud.ai Rosebudは、キャラクターの作成方法を再定義することによってゲーム業界を変革しています。このAIパワードのアプリケーションは、パラメータに基づいて写真のようなキャラクターを開発し、一-of-a-kindで高品質なキャラクターを簡単に作成することができます。 Rosebudを使用すると、髪の色や目の色などの細かいディテールに至るまで、キャラクターの作成において最大限の創造的な自由を持つことができます。 Layer.ai 人工知能を使用して、Layerはビデオゲームの世界で使用するための複雑な3Dレイヤーを構築することができます。これは、ゲームデザイナーが没入感のある世界を作成するのを容易にするために作られています。 Layerは、地形や植生など、さまざまな3Dレイヤーを構築する柔軟なプログラムです。これは、より複雑なレベルの設定からゲームのコンポーネントの効率を向上させるためにまで、さまざまなことに使用することができます。 Hotpot.ai Hotpot.aiは、創造的な取り組みをサポートするためのさまざまなAI駆動の機能を備えた柔軟なプログラムです。このプラットフォームは、ゲームデザイナー、マーケター、アーティストがすべて利益を得ることができます。プラットフォームのAIアートジェネレータは、それだけで十分です。…

「テキストゥアをご紹介します:3Dメッシュのテキストゥアリングのための新しい人工知能(AI)フレームワーク」

テキストから画像を生成することは、人工知能(AI)の分野における新しい興味深い研究領域であり、テキストの説明に基づいて現実的な画像を生成することを目指しています。テキストから画像を生成する能力は、アートからエンターテイメントまでさまざまな応用があります。本や映画、ビデオゲームの視覚的な要素を作成するために使用することができます。 テキストから画像を生成する応用の一つは、テクスチャイメージです。これは、布地や表面、素材など、さまざまな種類のテクスチャを表現する画像を作成することを意味します。テクスチャイメージは、コンピュータグラフィックス、アニメーション、仮想現実などで重要な応用があり、リアルなテクスチャはユーザーの没入体験を向上させることができます。 AIの研究のもう一つの興味深い分野は、3Dテクスチャの転送です。これは、3D環境でのオブジェクト間でテクスチャ情報を転送することを意味します。このプロセスにより、ソースオブジェクトからターゲットオブジェクトへのテクスチャ情報の転送によって、真実味のある3Dモデルが作成されます。このアプローチは、製品の視覚化などの分野で利用することができます。 ディープラーニングの技術は、テキストから画像を生成する分野を革新し、高度にリアルで詳細な画像を作成することが可能となりました。深層ニューラルネットワークを使用することで、研究者はテキストの説明に合わせて画像を生成したり、3Dオブジェクト間でテクスチャを転送したりするモデルを訓練することができます。 最近の言語ガイドモデルに関する研究では、よく知られたテキストから画像を生成するモデルである安定拡散を利用してスコア蒸留を行っています。この技術は、大規模なネットワークから小さなネットワークに知識を蒸留することを意味します。小さなネットワークは、最初のネットワークから画像に割り当てられたスコアを予測するために訓練されます。 これらのモデルは以前に使用されていた技術と比べて大幅な改良をもたらしていますが、2Dの対応物に比べて3Dテクスチャの転送プロセスで達成される品質にはまだ十分ではありません。 3Dテクスチャの転送の精度を向上させるために、新しいAIフレームワークであるTEXTureが提案されています。 パイプラインの概要を以下に示します。 出典:https://texturepaper.github.io/TEXTurePaper/static/paper.pdf 上記のアプローチとは異なり、TEXTureは深度条件付きの拡散モデルを利用してレンダリングされた画像に完全なノイズ除去処理を適用します。 テクスチャを適用する3Dメッシュが与えられた場合、核心となるアイデアは、異なる視点から反復的にレンダリングし、深度に基づいたペイントスキームを適用し、アトラスに再投影することです。 ただし、このプロセスを単純に適用するリスクは、生成プロセスの確率的な性質により、非現実的なまたは一貫性のないテクスチャリングが生成されることです。 この問題に対処するために、選択された3Dメッシュは、「保持」「改善」「生成」の領域に分割されます。 「生成」の領域は、地面から塗りつぶす必要のあるオブジェクトの部分を指します。「改善」は、異なる視点からテクスチャを適用し、新しい視点に合わせて調整する必要があるオブジェクトの部分を指します。「保持」は、塗りつぶされたテクスチャを保持する行為を表します。 著者によれば、これらの3つの技術を組み合わせることで、わずか数分で高度にリアルな結果を生成することができます。 著者によって提示された結果は、以下に報告され、最先端の手法と比較されています。 出典:https://texturepaper.github.io/TEXTurePaper/static/paper.pdf これは、TEXTureという新しいAIフレームワークの要約であり、3Dメッシュのテキストガイドテクスチャリングに使用されます。 もし興味がある場合やこのフレームワークについてもっと学びたい場合、論文とプロジェクトページへのリンクがあります。 以下の論文、コード、プロジェクトページをチェックしてください。この研究に関するすべてのクレジットは、このプロジェクトの研究者に帰属します。また、最新のAI研究ニュース、素晴らしいAIプロジェクトなどを共有している、私たちの26k+のML SubReddit、Discordチャンネル、およびメールニュースレターにも参加することを忘れないでください。 効果的な転移学習のためのTensorLeapの活用: ドメインのギャップの克服 この記事「TEXTure:…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.