Learn more about Search Results 大規模な言語モデル - Page 8

- You may be interested

- 「Pythonで簡単に実装するマルチクラスSVM」

- ジェンスン・ファンのNvidiaがA.I. 革命を...

- 「ポーズマッピング技術によって、脳性麻...

- 「ADHDを持つ思春期の若者において、この...

- リアルタイムで命を救うビッグデータ:IoV...

- タイム100 AI:最も影響力のあるもの?

- このAI論文は、「Vary」という新しいアプ...

- 「ドバイ、ロボタクシーの試験を開始する...

- 「ドローンがニューヨークのビーチでサメ...

- Amazon SageMakerの自動モデルチューニン...

- 「バイオニックハンドが女性の神経、骨、...

- 人間の脳血管のアトラスは、アルツハイマ...

- 「Appleの次の動き:『Apple GPT』の開発...

- システムデザインのチートシート:Elastic...

- VoAGIニュース、6月14日:あなたの無料の...

北京大学の研究者は、FastServeを紹介しました:大規模な言語モデルLLMsのための分散推論サービスシステム

大規模言語モデル(LLM)の改善により、さまざまな分野での機会が生まれ、新しい波の対話型AIアプリケーションがインスピレーションを与えています。最も注目すべきものの1つはChatGPTで、ソフトウェアエンジニアリングから言語翻訳までの問題を解決するために、人々がAIエージェントと非公式にコミュニケーションを取ることを可能にします。 ChatGPTは、その驚異的な能力のために、史上最も急成長しているプログラムの1つです。MicrosoftのNew Bing、GoogleのBard、MetaのLLaMa、StanfordのAlpaca、DatabricksのDolly、UC BerkeleyのVicunaなど、多くの企業がLLMやChatGPTのような製品をリリースするトレンドに追従しています。 LLMの推論は、ResNetなどの他の深層ニューラルネットワーク(DNN)モデルの推論とは異なる特徴を持っています。LLM上に構築された対話型AIアプリケーションは、機能するために推論を提供する必要があります。これらのアプリの対話的なデザインは、LLM推論のジョブ完了時間(JCT)を迅速に行う必要があり、ユーザーエクスペリエンスを魅力的にするためです。たとえば、データをChatGPTに送信した場合、消費者は即座の応答を期待しています。ただし、LLMの数と複雑さのため、推論サービングインフラは大きな負荷を受けています。企業は、LLM推論操作を処理するために、GPUやTPUなどのアクセラレータを備えた高価なクラスタを設置しています。 DNNの推論ジョブは通常、確定的で非常に予測可能です。つまり、モデルとハードウェアが推論ジョブの実行時間を大部分に決定します。たとえば、同じResNetモデルを特定のGPU上で使用しても、さまざまな入力写真の実行時間はわずかに異なります。一方、LLMの推論位置はユニークな自己回帰パターンを持っています。LLMの推論作業は複数のラウンドを経ます。各イテレーションは1つの出力トークンを生成し、それが次のイテレーションでの次のトークンに追加されます。初めには不明な出力の長さは、実行時間と入力の長さの両方に影響を与えます。ResNetなどの決定論的モデル推論タスクの大部分は、ClockworkやShepherdのような既存の推論サービングシステムによって対応されています。 これらのシステムは、正確な実行時間のプロファイリングに基づいてスケジューリングの決定を行いますが、実行時間が可変のLLM推論には効果的ではありません。LLM推論の最も先進的な方法はOrcaです。Orcaはイテレーションレベルのスケジューリングを提案し、各イテレーション後に現在の処理バッチに新しいジョブを追加するか、完了したジョブを削除することができます。ただし、Orcaは先入れ先出し(FCFS)を使用して推論ジョブを処理します。スケジュールされたタスクは完了するまで連続して実行されます。推論ジョブの制約されたGPUメモリ容量と低いJCT要件のため、処理バッチを任意の数の入力関数で拡張することはできません。完了まで実行されるまでのブロックの問題はよく知られています。 LLMはサイズが大きく、絶対的な意味で実行に時間がかかるため、LLM推論操作ではこの問題が特に深刻です。特に出力の長さが長い場合、大規模なLLM推論ジョブは完了に時間がかかり、後続の短いジョブを妨げます。北京大学の研究者たちは、FastServeと呼ばれるLLM向けの分散推論サービングソリューションを開発しました。FastServeは、LLM推論のイテレーションレベルのスケジューリングと自己回帰パターンを利用して、各出力トークンのレベルで事前処理を可能にします。FastServeは、キュー内の別のジョブによって予定されたタスクを続行するか、中断するかを選択できます。これにより、FastServeはJCTと先行ブロッキングを削減し、先制的なスケジューリングを介しています。 FastServeの基盤となるのは、ユニークなスキップジョインのマルチレベルフィードバックキュー(MLFQ)スケジューラです。MLFQは、情報がない環境で平均JCTを最小化するためのよく知られた手法です。各作業は最も高い優先度キューで開始され、一定の時間内に完了しない場合は次の優先度キューに降格されます。LLM推論は、セミ情報が無関係であり、出力の長さが事前にはわからないということを意味します。これがLLM推論と従来の状況の主な違いです。入力の長さは、初期の出力トークンを作成するための実行時間を決定し、LLM推論の自己回帰パターンのため、その実行時間は後続のトークンよりもはるかに長くかかる場合があります。 入力が長く、出力が短い場合、初期の出力トークンの実行時間が大部分を占めます。彼らは、この特性を伝統的なMLFQにスキップジョインを追加するために使用します。到着タスクは、最初の出力トークンの実行時間をラインの降格閾値と比較して、適切なキューに参加します。常に最も高い優先度キューに入るのではなく、参加したキューよりも優先度の高いキューはバイパスされ、降格が最小限に抑えられます。MLFQによる先制的なスケジューリングは、中断されたが完了していないジョブを一時的な状態で保持するため、追加のメモリオーバーヘッドを加えます。LLMは、各Transformerレイヤーごとにキー値キャッシュを保持し、中間状態を保存します。バッチサイズが超過しない限り、FCFSキャッシュにはスケジュールされたジョブの中間状態を保持する必要があります。ただし、MLFQで開始された追加のジョブは、優先度の低いキューに降格されます。MLFQの中断されたが完了していないすべてのジョブは、キャッシュによって保持される中間状態を持つ必要があります。LLMのサイズとGPUの制限されたメモリスペースを考慮すると、キャッシュがオーバーフローする可能性があります。キャッシュがいっぱいの場合、スケジューラは新しいジョブの開始を単純に遅延させることができますが、これにより再び先行ブロッキングが発生します。 代わりに、彼らは生産的なGPUメモリ管理システムを開発し、スケジュールされたときに低優先度のキュー内のプロセスの状態を前もってアップロードし、キャッシュがほぼいっぱいになったときに状態をオフロードします。効率を高めるために、パイプライン処理と非同期メモリ操作を使用しています。FastServeは、テンソルとパイプライン並列処理などの並列化技術を使用して、1つのGPUに収まらない巨大なモデルのために多数のGPUを使用した分散推論サービスを提供します。パイプラインのブロックを減らすために、スケジューラは同時に複数のジョブのバッチを実行します。キーと値のキャッシュは、キーと値のキャッシュマネージャによって組織化され、GPUとホストメモリの間のメモリスワッピングの管理も行います。彼らは、NVIDIA FasterTransformerをベースにしたFastServeシステムのプロトタイプを実際に実装しました。結果は、FastServeが最先端のOrcaソリューションと比較して、平均およびテールのジョブ完了時間をそれぞれ最大5.1と6.4向上させることを示しています。

非常に大規模な言語モデルとその評価方法

大規模な言語モデルは、Evaluation on the Hubを使用してゼロショット分類タスクで評価することができます! ゼロショット評価は、大規模な言語モデルの性能を測定するための研究者の人気のある方法であり、明示的にラベル付けされた例を示すことなくトレーニング中に能力を学習することが示されています。Inverse Scaling Prizeは、大規模なゼロショット評価を実施し、より大きなモデルがより小さなモデルよりも性能が低いタスクを発見するための最近のコミュニティの取り組みの一例です。 ハブ上での言語モデルのゼロショット評価の有効化 Evaluation on the Hubは、コードを書かずにHub上の任意のモデルを評価するのに役立ち、AutoTrainによって動作します。今では、Hub上の任意の因果言語モデルをゼロショットで評価することができます。ゼロショット評価は、トレーニングされたモデルが与えられたトークンセットを生成する可能性を測定し、ラベル付けされたトレーニングデータを必要としないため、研究者は高価なラベリング作業を省略することができます。 このプロジェクトのために、AutoTrainのインフラストラクチャをアップグレードし、大規模なモデルを無償で評価することができるようにしました 🤯!ユーザーがカスタムコードを書いてGPU上で大規模なモデルを評価する方法を見つけるのは高価で時間がかかるため、これらの変更により、660億のパラメータを持つ言語モデルを2000の文長のゼロショット分類タスクで評価するのに3.5時間かかり、コミュニティ内の誰でも実行できるようになりました。Evaluation on the Hubでは現在、660億のパラメータまでのモデルの評価をサポートしており、より大きなモデルのサポートも今後提供される予定です。 ゼロショットテキスト分類タスクは、プロンプトと可能な補完を含むデータセットを受け取ります。補完はプロンプトと連結され、各トークンの対数確率が合計され、正しい補完と比較するために正規化され、タスクの正確性が報告されます。 このブログ記事では、WinoBiasという職業に関連するジェンダーバイアスを測定する共参照タスクにおいて、ゼロショットテキスト分類タスクを使用してさまざまなOPTモデルを評価します。WinoBiasは、モデルが職業を言及する文章においてステレオタイプな代名詞を選ぶ可能性が高いかどうかを測定し、結果はモデルのサイズに関して逆のスケーリング傾向を示していることがわかります。 事例研究:WinoBiasタスクへのゼロショット評価 WinoBiasデータセットは、補完の選択肢が分類オプションであるゼロショットタスクとしてフォーマットされています。各補完は代名詞によって異なり、対象は職業に対して反ステレオタイプ的な補完に対応します(例:「開発者」は男性が主導するステレオタイプ的な職業なので、「彼女」が反ステレオタイプ的な代名詞になります)。例はこちらをご覧ください: 次に、Evaluation on the…

大規模な言語モデルによるレッドチーミング

警告: この記事はレッドチーミングについてであり、そのためモデル生成の例が不快または不快なものである可能性があります。 大量のテキストデータで訓練された大規模な言語モデル(LLM)は、現実的なテキストを生成するのに非常に優れています。しかし、これらのモデルは、個人情報(社会保障番号など)の公開や誤情報、偏見、憎悪、有害なコンテンツの生成など、望ましくない振る舞いをしばしば示します。たとえば、GPT3の以前のバージョンは、性差別的な振る舞い(以下参照)やムスリムに対する偏見を示すことが知られていました。 LLMを使用する際にこのような望ましくない結果を発見した場合、Generative Discriminator Guided Sequence Generation(GeDi)やPlug and Play Language Models(PPLM)などの戦略を開発してそれらからそれを逸らすことができます。以下は、同じプロンプトを使用してGPT3の生成を制御するためにGeDiを使用した例です。 最近のGPT3のバージョンでも、プロンプトインジェクションによる攻撃を受けると同様に不快なテキストが生成され、その結果、下流のアプリケーションのセキュリティ上の懸念となる可能性があります。このブログで説明されています。 レッドチーミングは、望ましくない振る舞いを引き起こす可能性のあるモデルの脆弱性を引き出す評価の形式です。ジェイルブレイキングは、LLMがそのガードレールから逸脱するように操作されるレッドチーミングの別の言葉です。MicrosoftのチャットボットTay(2016年)やより最近のBingのチャットボットシドニーは、レッドチーミングを使用して基礎となるMLモデルの徹底的な評価の欠如がどれほど壊滅的な結果をもたらすかの実際の例です。レッドチームのアイデアの起源は、軍隊によって実施された対抗者シミュレーションやウォーゲームに遡ることができます。 レッドチーミングの目標は、モデルが有害なテキストを生成する可能性が高いテキストを生成するようにするプロンプトを作成することです。レッドチーミングは、MLのより一般的に知られた評価形式である敵対的攻撃といくつかの類似点と相違点を共有しています。その類似点は、レッドチーミングと敵対的攻撃が実際のユースケースで望ましくないコンテンツを生成するためにモデルを「攻撃」または「だます」という共通の目標を持っていることです。ただし、敵対的攻撃は人間には理解しにくい場合があります。たとえば、各プロンプトに「aaabbbcc」という文字列を接頭辞として付けると、モデルのパフォーマンスが低下するためです。Wallace et al.、’19では、さまざまなNLP分類および生成タスクにおけるそのような攻撃の多くの例が議論されています。一方、レッドチーミングのプロンプトは通常、通常の自然言語のプロンプトと似ています。 レッドチーミングは、ユーザーの不快な体験を引き起こしたり、悪意を持つユーザーによる暴力やその他の違法な活動を支援する可能性があるモデルの制限を明らかにすることができます。レッドチーミングからの出力(敵対的攻撃と同様)は、一般にモデルを訓練して、有害な結果を引き起こす可能性を低くするか、またはそれから逸らすために使用されます。 レッドチーミングは、可能なモデルの障害物の創造的な考えを必要とするため、リソースを消費する問題です。回避策として、与えられたプロンプトにオフェンシブな生成を引き起こす可能性のあるトピックやフレーズを予測するために訓練された分類器をLLMに追加することができます。このような戦略は慎重な方向に進むでしょう。しかし、それは非常に制限的であり、モデルを頻繁に回避的にする原因となります。したがって、モデルが役立つこと(指示に従うこと)と無害であること(少なくとも有害な行動を引き起こしにくいこと)の間には緊張があります。 レッドチームは、ハードループ内の人間または有害な出力をテストするために別のLMをテストしているLMです。安全性とアライメントのためにファインチューニングされたモデルに対してレッドチーミングプロンプトを作成するには、Ganguli et al.、’22で説明されているような悪意のあるキャラクターとして振る舞うようにLLMに指示する役割プレイ攻撃の形で創造的な思考が必要です。モデルに自然言語の代わりにコードで応答するように指示することも、モデルの学習バイアスを明らかにすることができます。 さらなる例については、このツイートスレッドをご覧ください。 ChatGPT自体によるLLMのジェイルブレイキングのアイデアのリストは次のとおりです。…

スタンフォードの研究者たちは、Parselという人工知能(AI)フレームワークを紹介しましたこのフレームワークは、コードの大規模な言語モデル(LLMs)を使用して、複雑なアルゴリズムの自動実装と検証を可能にします

最近の大規模言語モデル(LLM)の推論の進歩にもかかわらず、LLMは洗練されたプログラムを開発するなど、階層的な多段階の推論タスクには依然として難しさを抱えています。他のトークン生成器とは異なり、人間のプログラマーは(通常)難しいタスクを管理可能なコンポーネントに分解し、単独で動作する(モジュール化)コンポーネントと共同で動作する(構成的)コンポーネントを学習しています。さらに、人間が生成したトークンが関数に問題を引き起こす場合、そのソフトウェアの他の部分に影響を与えずにソフトウェアのその部分を書き直すことが可能であるべきです。対照的に、コードLLMはエラーのないトークンのシーケンスを生成することが望まれます。 これにより、最近のスタンフォード大学の研究では、LLMを問題の分解と構成的な解決策の構築に使用することが検討されました。彼らはParselというコンパイラを提案しており、関数の説明と実装された関数の望ましい動作を定義する制約を含む仕様を受け入れます。Parselを使用することで、コーダーはプレーンな言語でプログラムを記述し、競技レベルのコーディング問題に取り組むことができ、従来のSoTAを75%以上上回るパフォーマンスを発揮します。 コードLLMには、関数の説明と依存する関数のシグネチャが与えられ、関数の実装を生成するように求められます。制約が追加されると、コンパイラは動作する実装の組み合わせを探索し、可能な組み合わせを見つけるまで繰り返します。 従来の研究では、人間とは異なり、コード言語モデルは連続的に多数の小さなタスクを実行するプログラムを開発することができませんでした。Parselは分解と実装のプロセスを分割することでこの問題を解消します。自然言語のコーディングを可能にすることを目的としていたが、LLMもParselコーディングで優れたパフォーマンスを発揮することがわかりました。 抽象的な計画を自動的に解決できるように分解することは、人間の推論の一般的なパターンであり、Parselの生成と実装に反映されています。この構成的な構造は言語モデルにも有用です。この研究では、チームはLLMがわずかな数のインスタンスからParselを作成できることを示し、APPSデータセットの競技レベルの問題においてSoTAの方法よりも優れた解を提供することを実証しています。Parselを使用してLLMによって書かれたプランは、高レベルのジョブからステップバイステップのロボットプランを生成するという興奮を伴う結果として、ゼロショットプランナーベースラインの約2/3の精度を持っています。 Parselの効果を評価するために、経験豊富な競技プログラマーであるGabriel Poesia氏は、通常コーディングの競技で見られるAPPSの多くのチャレンジを解決するためにParselを使用しました。彼は6時間で10問のうち5問の解答を見つけましたが、その中にはGPT-3が以前に失敗した3問も含まれています。 研究者らは、Parselを一般的なフレームワークとして定式化することで、定理証明やアルゴリズムの推論を必要とする他の活動にも利用できることを示しています。 彼らは近い将来、自律的なユニットテストの生成を実装する予定です。特殊な状況を探し、既存のすべてのテストで合意している関数のグループが新しいテストでも合意しているかどうかを調べるアプローチが一つの方法です。指数的な実装の組み合わせの発展を回避し、自動的な分解を可能にすることができるでしょう。また、より重要なプログラムやプログラムのセクションでは、説明を明確かつ簡潔にする必要があるため、言語モデルの「信頼度のしきい値」を調整することも目指しています。

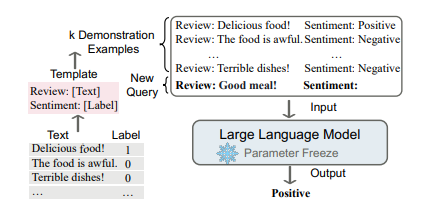

大規模な言語モデルにおけるコンテキストに基づく学習アプローチ

言語モデリング(LM)は、単語のシーケンスの生成的な尤度をモデル化することを目指し、将来の(または欠損している)トークンの確率を予測します言語モデルは自然言語処理の世界を革新しました...

「注目メカニズムの解読:トランスフォーマーモデルにおける最大幅解法に向けて」

アテンションメカニズムは、自然言語処理と大規模な言語モデルにおいて重要な役割を果たしてきました。アテンションメカニズムによって、トランスフォーマーデコーダは入力シーケンスの最も関連性の高い部分にフォーカスすることができます。このメカニズムは、入力トークン間のソフトマックス類似度を計算し、アーキテクチャの基礎的なフレームワークとしての役割を果たすことで、重要な役割を果たしています。ただし、アテンションメカニズムによってモデルが最も関連性の高い情報に集中することができることはよく知られていますが、この最も関連性の高い入力部分にフォーカスするプロセスの複雑性や具体的なメカニズムはまだ不明です。 そのため、アテンションメカニズムを理解するためには多くの研究が行われています。ミシガン大学の研究チームによる最近の研究では、トランスフォーマーモデルが使用するメカニズムを探求しています。研究者たちは、トランスフォーマーが多くの人気のあるチャットボットのバックボーンアーキテクチャである隠れ層を利用して、サポートベクターマシン(SVM)に似たアテンションメカニズムを利用していることを発見しました。これらの分類器は、データ内の境界を引くことで2つのカテゴリー(関連する情報と関連しない情報)を識別するために学習します。 研究者たちは、トランスフォーマーがデータを関連する情報と関連しない情報に分類するために、サポートベクターマシン(SVM)に似た昔ながらの手法を利用していることを強調しています。例えば、チャットボットに対して長い記事の要約を依頼する場合を考えてみましょう。トランスフォーマーはまずテキストをトークンと呼ばれる小さな部分に分割します。そして、対話中にアテンションメカニズムは各トークンに重みを割り当てます。テキストの分割や重みの割り当ては反復的に行われ、進化する重みに基づいて応答を予測し形成します。 会話が進むにつれて、チャットボットは全体の対話を再評価し、重みを調整し、繊細なコヒーレントな文脈に基づいた返答を行います。要するに、トランスフォーマーのアテンションメカニズムは多次元の数学を実行します。この研究は、アテンションメカニズム内での情報検索の基本的なプロセスを説明しています。 この研究は、トランスフォーマーアーキテクチャ内のアテンションメカニズムがどのように機能するかを理解するための重要な一歩です。この研究は、長く複雑なテキスト入力に対してチャットボットがどのように応答するかの謎を解明しました。この研究に基づいて、大規模な言語モデルをより効率的かつ解釈可能にすることができる可能性があります。研究者たちは、この研究の結果を利用してAIの効率とパフォーマンスを向上させることを目指しており、NLPや関連分野においてアテンションメカニズムを洗練させる可能性が開かれています。 まとめると、この研究はアテンションメカニズムの動作について議論し、解明するだけでなく、効果的かつ解釈可能なAIモデルの将来的な開発にも希望を抱かせます。アテンションメカニズムがSVMのようなメカニズムを適用していることを示すことで、自然言語処理の分野での進歩だけでなく、アテンションが重要な役割を果たす他のAIアプリケーションの進歩も約束しています。

RAGを使用したLLMパワードアプリケーションの開始ガイド

ODSCのウェビナーでは、PandataのNicolas Decavel-Bueff、そして私(カル・アル・ドーバイブ)とData Stack AcademyのParham Parviziが協力し、エンタープライズグレードの大規模な言語モデル(LLM)の構築から学んだ教訓と、データサイエンティストとデータエンジニアが始めるためのヒントを共有しました最大の...

2024年にフォローするべきデータサイエンスのトップ12リーダー

データサイエンスの広がりを見据えると、2024年の到来は、革新を牽引し、分析の未来を形作る一握りの著名人にスポットライトを当てる重要な瞬間として迎えられます。『Top 12 Data Science Leaders List』は、これらの個人の卓越した専門知識、先見のリーダーシップ、および分野への重要な貢献を称えるビーコンとして機能します。私たちは、これらの画期的なマインドの物語、プロジェクト、そして先見の見通しをナビゲートしながら、データサイエンスの進路を形作ると約束された航跡を探求します。これらの模範的なリーダーたちは単なるパイオニアにとどまることはありません。彼らは無類のイノベーションと発見の時代へと私たちを導く先駆者そのものです。 2024年に注目すべきトップ12データサイエンスリーダーリスト 2024年への接近とともに、データサイエンスにおいて傑出した専門知識、リーダーシップ、注目すべき貢献を示す特異なグループの人々に焦点を当てています。『Top 12 Data Science Leaders List』は、これらの個人を認識し、注目することで、彼らを思想リーダー、イノベーター、およびインフルエンサーとして認め、来年重要なマイルストーンを達成することが予想されます。 さらに詳細に突入すると、これらの個人の視点、事業、イニシアチブが、さまざまなセクターを横断する複雑な課題に対するメソッドとデータの活用方法を変革することが明らかになります。予測分析の進展、倫理的なAIの実践の促進、または先進的なアルゴリズムの開発など、このリストでハイライトされた個人たちが2024年にデータサイエンスの領域に影響を与えることが期待されています。 1. Anndrew Ng 「AIのゲームにおいて、適切なビジネスコンテキストを見つけることが非常に重要です。私はテクノロジーが大好きです。それは多くの機会を提供します。しかし結局のところ、テクノロジーはコンテクスト化され、ビジネスユースケースに収まる必要があります。」 Dr. アンドリュー・エングは、機械学習(ML)と人工知能(AI)の専門知識を持つ英米のコンピュータ科学者です。AIの開発への貢献について語っている彼は、DeepLearning.AIの創設者であり、Landing AIの創設者兼CEO、AI Fundのゼネラルパートナー、およびスタンフォード大学コンピュータサイエンス学科の客員教授でもあります。さらに、彼はGoogle AIの傘下にある深層学習人工知能研究チームの創設リードでありました。また、彼はBaiduのチーフサイエンティストとして、1300人のAIグループの指導や会社のAIグローバル戦略の開発にも携わりました。 アンドリュー・エング氏は、スタンフォード大学でMOOC(大規模オープンオンラインコース)の開発をリードしました。また、Courseraを創設し、10万人以上の学生に機械学習のコースを提供しました。MLとオンライン教育の先駆者である彼は、カーネギーメロン大学、MIT、カリフォルニア大学バークレー校の学位を保持しています。さらに、彼はML、ロボット工学、関連する分野で200以上の研究論文の共著者であり、Tiime誌の世界で最も影響力のある100人のリストに選ばれています。…

ミキストラル-8x7B + GPT-3 + LLAMA2 70B = 勝利者

「誰もがGoogle Geminiのリリースに注目している中、Mixtral-8 x 7 Billionは静かにオープンソースモデルをリリースしましたそこで、この記事では最新のAIについて深く掘り下げていきます...」

「キナラがAra-2プロセッサを発表:パフォーマンス向上のためのオンデバイスAI処理を革命化」

Kinaraは、エネルギー効率の高いエッジAIのパイオニアであるAra-2プロセッサを発表しました。それは、前任者と比べて8倍の高性能を誇り、デバイス内で大規模な言語モデル(LLMs)とさまざまな生成AIモデルを強力にサポートする能力を備えています。 Kinaraのイノベーションへの執念から生まれたAra-2プロセッサは、プロセッサのラインアップの大きな進歩を表しており、顧客にはパフォーマンスとコストのオプションのスペクトラムが用意されています。チームはこの新しい追加の重要性を強調し、Ara-1とAra-2プロセッサの役割を詳細に説明しました。Ara-1はスマートカメラやエッジAIデバイスが2-8のビデオストリームを処理するのに優れている一方、Ara-2はエッジサーバー、ノートパソコン、高性能カメラに向けた16-32+のビデオストリームを素早く処理する能力を示しました。 チームはさらに、Ara-2の変革的な可能性について詳述し、物体検出、認識、トラッキングの向上におけるその重要な役割を強調しました。このプロセッサは、高度なコンピューティングエンジンを活用し、高解像度の画像を迅速かつ驚くほど高い精度で処理することに優れています。また、Generative AIモデルの処理能力は、Stable Diffusionに対して1枚の画像あたり10秒の速度を達成し、LLaMA-7Bに対しては秒間数十のトークンを生成できることで示されています。 Ara-1の後継として設計されたAra-2チップは、前任者と比べて5〜8倍もの大幅なパフォーマンス向上を約束しています。Kinaraは、Ara-2チップがさまざまなモデルで高コストで高消費電力のグラフィックスプロセッサを置き換える潜在能力を持つと主張しています。特に大規模な言語モデル(LLMs)のニーズに対応しています。 2024年1月のConsumer Electronics Show(CES)で発表される予定のAra-2プロセッサは、複数のバリエーションで提供されます。スタンドアロンチップ、単一チップのUSBおよびM.2モジュール、4つのAra-2チップを並列動作させるPCI Expressアドインボードとして利用できます。Kinaraはリリースを予想しながらも、価格の詳細を開示しておらず、愛好家や消費者がこの技術の驚異を探求することを待ち望んでいます。 まとめると、KinaraのAra-2プロセッサは、切り込んだパフォーマンス、多様性、効率を併せ持つオンデバイスAI処理の新時代を告げる存在です。CESでの近い展示は、エッジAI技術の領域を再定義する可能性のある変革的なツールを暗示して、産業界全体で興味を引き起こしています。 この投稿は、KinaraがAra-2プロセッサを発表:パフォーマンス向上のためのオンデバイスAI処理を革新の投稿最初に現れました。MarkTechPostより。

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.