Learn more about Search Results OPT - Page 86

- You may be interested

- 機械学習におけるXGBoostの詳細な理解

- 「エンジニアたちが、心臓の右室のロボッ...

- 「MITとハーバードの研究者が革命的なAIベ...

- チャットボットは何と言うのか?

- Amazon SageMakerで@remoteデコレータを使...

- 非教師あり学習シリーズ:階層クラスタリ...

- 「OpenAIのWebクローラーとFTCのミスステ...

- PDFの変換:PythonにおけるTransformerを...

- 「北極の画像の新しいデータセットが人工...

- ワビとトロント大学の研究者が、オートラ...

- 「グローバルAIガバナンスの制度探求」

- DeepMindのロボキャットに会ってください...

- このAI論文では、これらの課題に対処しな...

- 「PostgreSQLとOpenAI埋め込みを使用した...

- 「物理学と流体力学に応用されたディープ...

GPTQによる4ビット量子化

「この記事では、GPTQアルゴリズムがLLMの重みを4ビット精度で効率的に量子化する方法と、AutoGPTQを使用して実装する方法について説明します」

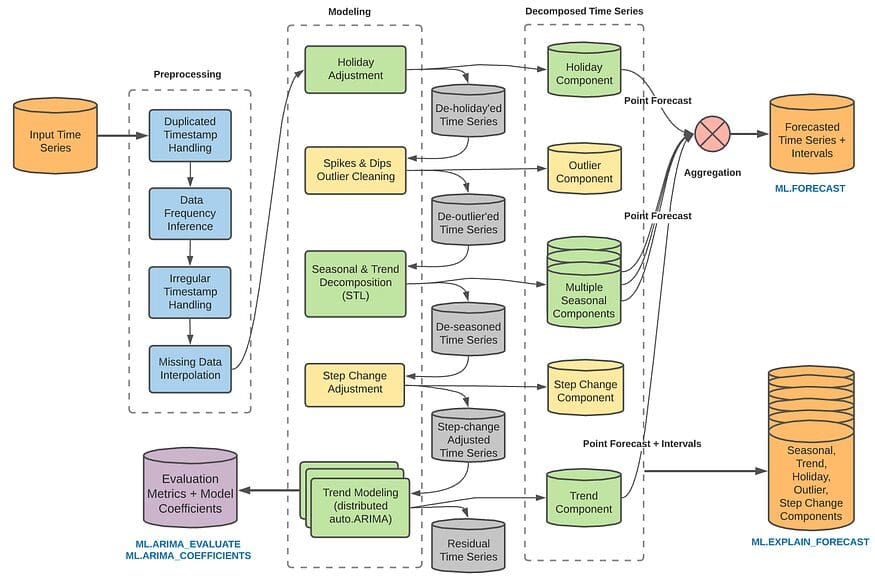

BQMLを使用した多変量時系列予測

GoogleのBQMLは、時系列モデルを作成するために使用することができます最近、マルチバリエート時系列モデルを作成するためにアップデートされましたこの記事では、シンプルなコードを使用してマルチバリエート時系列の予測方法を紹介し、単変量時系列モデルよりも強力な性能を発揮することができます

Pythonを使用した探索的データ分析(EDA)の実践ガイド

データを読み込むために、Pandasのread_csv関数を使用しますread_csv関数は、CSVファイルへのパスを第1引数として取ります私たちの直感によれば、人の結果は...

「フューショットラーニングの力を解き放つ」

はじめに 少数のラベル付きの例だけでタスクを征服し、データのオッズに挑む機械の領域へようこそ。このガイドでは、少数のラベル付き例で偉業を達成するための賢いアルゴリズムがどのように偉大さを実現するかについて探求します。人工知能の新たな可能性を開く少数のデータでのアプローチの概念や、従来の機械学習との違い、データが少ないシナリオでのこのアプローチの重要性について学びましょう。 学習目標 技術的な詳細に入る前に、このガイドの学習目標を概説しましょう: 概念を理解し、従来の機械学習との違い、データが少ないシナリオでのアプローチの重要性を理解する 少数のデータ学習に使用されるさまざまな手法やアルゴリズム、メトリックベースの手法、モデルベースのアプローチ、およびその基本原理を探索する さまざまなシナリオでの少数のデータ学習の技術の適用方法を理解する。効果的なトレーニングと評価のためのベストプラクティスを理解する 少数のデータ学習の現実世界の応用を発見する 少数のデータ学習の利点と制限を理解する さあ、ガイドの各セクションについて探求して、これらの目標を達成する方法を理解しましょう。 この記事はデータサイエンスブログマラソンの一部として公開されました。 Few Shot Learningとは何ですか? Few Shot Learningは、クラスまたはタスクごとに限られた数のラベル付き例からモデルを訓練して認識と一般化を行う機械学習のサブフィールドです。Few Shot Learningは、データに飢えたモデルの従来の概念に挑戦します。大量のデータセットに頼る代わりに、Few Shot Learningはわずかなラベル付きサンプルから学習することを可能にします。限られたデータから一般化する能力は、広範なラベル付きデータセットを入手することが実践的または高価でないシナリオでの驚くべき可能性を開くものです。 新しい概念を素早く把握し、オブジェクトを認識し、複雑な言語を理解し、限られたトレーニング例でも正確な予測を行うモデルを想像してみてください。Few Shot Learningはまさにそれを可能にし、さまざまなドメインでのさまざまな課題へのアプローチ方法を変えています。Few…

「Keras 3.0 すべてを知るために必要なこと」

「Keras 3.0でAIの協力力を解放しましょう!TensorFlow、JAX、PyTorchの間をシームレスに切り替え、深層学習プロジェクトを革新しましょう今すぐ読んで、AIの世界で先を行きましょう」

「BI-LSTMを用いた次の単語予測のマスタリング:包括的なガイド」

はじめに 次の単語を特定することは、次の単語の予測、または言語モデリングとしても知られています。自然言語処理のベンチマークタスクの一つは、言語モデリングです。基本的な形式では、特定の単語の後に続く単語を、それらに基づいて最も起こりやすいものとして選ぶことを意味します。言語モデリングは、さまざまな分野でさまざまな応用があります。 学習目標 統計分析、機械学習、データサイエンスで使用される多くのモデルの基本的なアイデアと原則を認識する。 回帰、分類、クラスタリングなどの予測モデルを作成し、データに基づいて正確な予測とタイプを生成する方法を学ぶ。 過剰適合と適合不足の原則を理解し、精度、適合率、再現率などの指標を使用してモデルのパフォーマンスを評価する方法を学ぶ。 データの前処理とモデリングに関連する特性を特定する方法を学ぶ。 グリッドサーチと交差検証を使用して、ハイパーパラメータを調整し、モデルを最適化する方法を学ぶ。 この記事はData Science Blogathonの一部として公開されました。 言語モデリングの応用 以下は言語モデリングの注目すべき応用例です。 モバイルキーボードのテキスト推奨 スマートフォンのキーボードには、モバイルキーボードのテキスト推奨、予測テキスト、またはオートサジェストと呼ばれる機能があります。入力すると、単語やフレーズを提案します。これにより、タイピングがより速く、エラーが少なくなり、より正確で文脈に適した推奨が行われます。 また読む:コンテンツベースのレコメンデーションシステムの構築 Google検索の自動補完 Googleなどの検索エンジンを使用して何かを検索するたびに、多くのアイデアが表示され、フレーズを追加すると、推奨がより良く、現在の検索に関連性が高くなります。それはどのように実現されるのでしょうか? 自然言語処理(NLP)技術が可能にします。ここでは、自然言語処理(NLP)を使用して、双方向LSTM(長短期記憶)モデルを利用して、文の残りの単語を予測する予測モデルを作成します。 さらに詳しくはこちら:LSTMとは? 長短期記憶の紹介 必要なライブラリとパッケージのインポート 次の単語の予測モデルを作成するために、双方向LSTMを使用するために必要なライブラリとパッケージをインポートするのが最も良いでしょう。一般的に必要なライブラリの一部を以下に示します: import…

適切なバランスを取る:機械学習モデルにおける過学習と過小適合の理解

機械学習の問題に取り組むすべての人は、自分のモデルができるだけ最適に動作することを望んでいますしかし、望むほどモデルが最適に動作しない場合もありますそれは、以下のいずれかの理由による可能性があります...

「会話型AIのLLM:よりスマートなチャットボットとアシスタントの構築」

イントロダクション 言語モデルは、技術と人間が自然な会話を行う魅力的なConversational AIの世界で中心的な役割を果たしています。最近、Large Language Models(LLMs)という注目すべきブレークスルーがありました。OpenAIの印象的なGPT-3のように、LLMsは人間のようなテキストを理解し生成するという非凡な能力を示しています。これらの素晴らしいモデルは、特によりスマートなチャットボットやバーチャルアシスタントの作成において、ゲームチェンジャーとなりました。 このブログでは、LLMsがConversational AIにどのように貢献しているかを探求し、その潜在能力を示すための理解しやすいコード例を提供します。さあ、LLMsが仮想的なインタラクションをより魅力的で直感的にする方法を見てみましょう。 学習目標 Large Language Models(LLMs)の概念と、Conversational AIの能力向上における重要性を理解する。 LLMsがチャットボットやバーチャルアシスタントが人間のようなテキストを理解し生成することを可能にする方法を学ぶ。 プロンプトエンジニアリングの役割を探求し、LLMベースのチャットボットの動作をガイドする。 伝統的な方法に比べてLLMsの優位性を認識し、チャットボットの応答を改善する。 LLMsを活用したConversational AIの実用的な応用を発見する。 この記事はData Science Blogathonの一部として公開されました。 Conversational AIの理解 Conversational AIは、人工知能の革新的な分野であり、自然で人間らしい方法で人間の言語を理解し応答する技術の開発に焦点を当てています。自然言語処理や機械学習などの高度な技術を使用して、Conversational…

「4つの方法で、生成AIがフィールドサービスオペレーションを革新する:潜在的な利用方法の探索」

「生成AI(GAI)は、今年の大半にわたり、テックおよびビジネスメディアの着目の的となってきましたこれは、Open AIがChatGPTとGPT-4をリリースしたことによって大いに促進されたものですどちらも、深層学習が可能な強力な多モーダル言語モデルですこの新しい技術の人気とそれに続く採用は、予想通りのものです他のウイルス性の技術とは異なり、...」

「MLOpsの考え方:常に本番準備完了」

「プロジェクトの最初からMLのプロダクションマインドセットが欠如していると、特にプロダクション時に驚きが生じ、再モデリングや市場投入までの時間の遅延を引き起こす可能性があります」

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.