Learn more about Search Results MPT - Page 82

- You may be interested

- LLM説明性への道:なぜ私のモデルはこの出...

- 「どのオンラインデータサイエンスコース...

- PyRCAをご紹介します:AIOpsにおけるRoot ...

- 「OpenAIのGPT Builderが壊れたのは誰のお...

- 「Rで複数のファイルを自動的にインポート...

- 水中探査の革命:ブラウン大学のプリオボ...

- 「Pythonにおけるデータクリーニング」

- 「あなたは専門家です」というAIのプロン...

- このAI論文では、LLMsの既存のタスクの新...

- 「タンパク質設計の革命:ディープラーニ...

- ホワイトハウス、AI安全への懸念に対処す...

- SEER:セルフスーパーバイズドコンピュー...

- ウィザードコーダー:最高のコーディング...

- 「Llama 2によるトピックモデリング」

- ジェイソン・アーボン:「100万年後、超強...

中間旅程のタトゥープロンプト

次のタトゥーのインスピレーションを探している場合は、Midjourneyを使用してみてください

PyTorchモデルのパフォーマンス分析と最適化—Part2

これは、GPU上で実行されるPyTorchモデルの分析と最適化に関する一連の投稿の第二部です最初の投稿では、プロセスとその重要な可能性を示しました...

あなたのLLMアプリケーションは公開に準備ができていますか?

大規模言語モデル(LLM)は、現代の自然言語処理アプリケーションにおいてパンとバターとなり、固有表現認識モデルなどのより専門的なツールの多様性を多くの面で置き換えています

LLM-Blenderに会いましょう:複数のオープンソース大規模言語モデル(LLM)の多様な強みを活用して一貫して優れたパフォーマンスを達成するための新しいアンサンブルフレームワーク

大規模言語モデルは、さまざまなタスクにおいて驚異的なパフォーマンスを発揮しています。ユニークでクリエイティブなコンテンツの生成や回答の提供から、言語の翻訳や文章の要約まで、LLMは人間のまねをすることに成功しました。GPT、BERT、PaLMなどのよく知られたLLMは、正確に指示に従い、大量の高品質データにアクセスすることで、話題になっています。GPT4やPaLMのようなモデルはオープンソースではないため、アーキテクチャやトレーニングデータを理解することができない人がいるのに対して、Pythia、LLaMA、Flan-T5などのオープンソースLLMの存在により、研究者がカスタム指示データセットでモデルを微調整し、改善する機会を提供しています。これにより、Alpaca、Vicuna、OpenAssistant、MPTなどのより小型で効率的なLLMの開発が可能になります。 市場をリードするオープンソースLLMはひとつではありません。多様な例において最高のLLMは大きく異なるため、これらのLLMを動的にアンサンブルすることは、改良された回答を継続して生み出すために必要不可欠です。さまざまなLLMの独自の貢献を統合することで、バイアス、エラー、不確実性を低減し、人間の好みにより近い結果を得ることができます。この問題に対処するため、人工知能アレン研究所、南カリフォルニア大学、浙江大学の研究者らは、複数のオープンソース大規模言語モデルの多くの利点を利用して、常に優れたパフォーマンスを発揮するアンサンブルフレームワークであるLLM-BLENDERを提案しました。 LLM-BLENDERは、PAIRRANKERとGENFUSERの2つのモジュールで構成されています。これらのモジュールは、異なる例に対して最適なLLMが大きく異なることを示しています。最初のモジュールであるPAIRRANKERは、潜在的な出力の微小な変化を特定するために開発されました。これは、元のテキストと各LLMからの2つの候補出力を入力として、高度なペアワイズ比較技術を使用します。入力と候補ペアを共にエンコードするために、RoBERTaなどのクロスアテンションエンコーダを使用し、PAIRRANKERはこのエンコードを使用して2つの候補の品質を決定することができます。 2番目のモジュールであるGENFUSERは、上位ランクに入った候補を統合して改善された出力を生成することに焦点を当てています。GENFUSERは、選択されたLLMの利点を最大限に活用しつつ、欠点を最小限に抑えることを目的としています。GENFUSERは、さまざまなLLMの出力を統合することで、1つのLLMの出力よりも優れた出力を開発することを目指しています。 評価には、MixInstructというベンチマークデータセットが提供されており、Oracleペアワイズ比較を組み合わせ、さまざまな指示データセットを組み合わせています。このデータセットでは、11の人気のあるオープンソースLLMを使用して、各入力に対して複数の候補を生成し、さまざまな指示に従うタスクを実行します。自動評価のためにOracle比較が使用されており、候補出力に対するグランドトゥルースランキングが与えられているため、LLM-BLENDERや他のベンチマーク技術のパフォーマンスを評価することができます。 実験結果は、LLM-BLENDERが個別のLLMやベースライン技術よりも優れたパフォーマンスを発揮することを示しています。LLM-BLENDERのアンサンブル手法を使用することで、単一のLLMやベースライン方法を使用する場合と比較して、より高品質な出力が得られることが示されています。PAIRRANKERの選択は、参照ベースのメトリックやGPT-Rankにおいて、個別のLLMモデルを上回っています。GENFUSERは、PAIRRANKERのトップピックを利用して、効率的な融合を通じて応答品質を大幅に改善しています。 LLM-BLENDERは、Vicunaなどの個別のLLMを上回り、アンサンブル学習を通じてLLMの展開と研究を改善する可能性を示しています。

I/O 2023 で発表した100のこと

Google I/O 2023はニュースとローンチで満ち溢れていましたここではI/Oで発表された100のことを紹介します

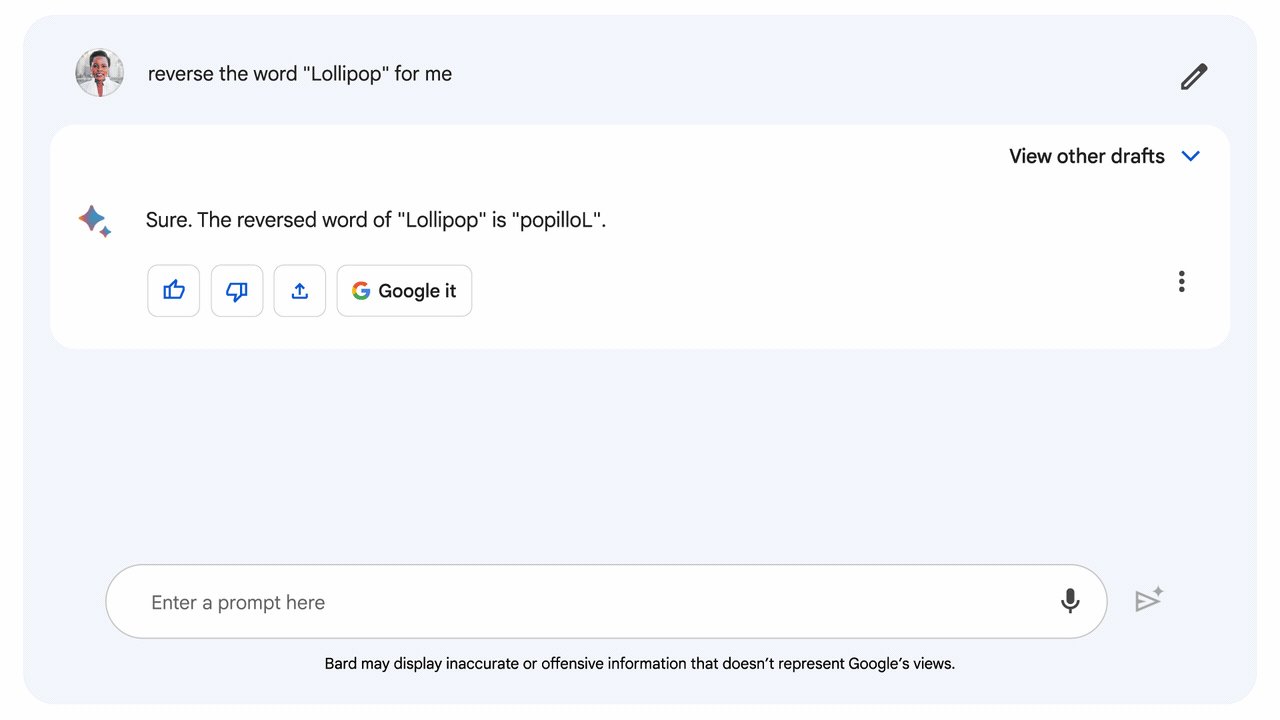

バードは論理と推論力においてますます上達しています

精度の高い回答を得るための2つの改善点と、Google Sheetsへのエクスポートに向けた改善点がBardに導入されます

欠陥が明らかにされる:MLOpsコース作成の興味深い現実

不完全なものが明らかにされる舞台裏バッチ特徴ストアMLパイプラインMLプラットフォームPythonGCPGitHub ActionsAirflowMLOpsCI/CDコース

RedPajamaプロジェクト:LLMの民主化を目指すオープンソースイニシアチブ

アクセス可能な大規模言語モデルを通じてコミュニティを強化するプロジェクトのリーダーシップを担っています

AIの変革の道:OpenAIのGPT-4を通してのオデッセイ

ソフトウェア開発者は、OpenAIのGPT-4を使用して複数のアプリケーションを生成し、時間の節約、コストの削減、パーソナライズの向上により、アプリ開発を革新します

AIのマスタリング:プロンプトエンジニアリングソリューションの力

私と一緒にAIプロンプトエンジニアリングの素晴らしさを発見しましょう!ユーモアのある効果的なプロンプトの制作によって、AIモデルのフルポテンシャルを引き出すことができます

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.