Learn more about Search Results 大規模な言語モデル - Page 76

- You may be interested

- 究極の可視化アシスタント

- AIによる安全な自転車ヘルメット、そして...

- AIを活用した空中監視:UCSBイニシアチブ...

- 「ジェネラティブAIが語りの技術を変革す...

- 「Javaアプリケーションのレイテンシー削減」

- AWSにおける生成AIとマルチモーダルエージ...

- 「パンダとPythonでデータの整理をマスタ...

- エッジでの視覚品質検査のためのエンド・...

- ランダムウォークタスクにおける時差0(Tem...

- AIを活用したエネルギー効率:今日の電気...

- Pythonを使用したデータのスケーリング

- トップ5のデータ分析の認定資格

- 「AIが空中戦にロボットの相棒をもたらす」

- Python Enumerate():カウンターを使用...

- 「マイクロソフトのシニアデータサイエン...

I/O 2023 で発表した100のこと

Google I/O 2023はニュースとローンチで満ち溢れていましたここではI/Oで発表された100のことを紹介します

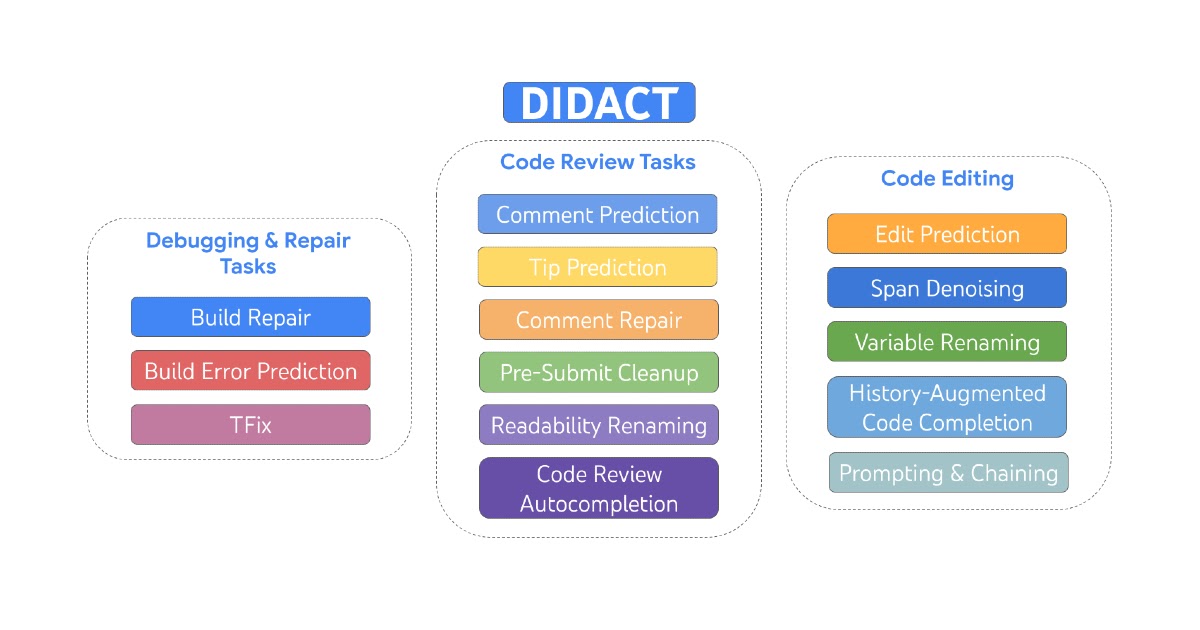

ソフトウェア開発活動のための大規模シーケンスモデル

Google の研究科学者である Petros Maniatis と Daniel Tarlow が投稿しました。 ソフトウェアは一度に作られるわけではありません。編集、ユニットテストの実行、ビルドエラーの修正、コードレビューのアドレス、編集、リンターの合意、そしてより多くのエラーの修正など、少しずつ改善されていきます。ついには、コードリポジトリにマージするに十分な良い状態になります。ソフトウェアエンジニアリングは孤立したプロセスではなく、人間の開発者、コードレビュワー、バグ報告者、ソフトウェアアーキテクト、コンパイラ、ユニットテスト、リンター、静的解析ツールなどのツールの対話です。 今日、私たちは DIDACT(Dynamic Integrated Developer ACTivity)を説明します。これは、ソフトウェア開発の大規模な機械学習(ML)モデルをトレーニングするための方法論です。 DIDACT の新規性は、完成したコードの磨き上げられた最終状態だけでなく、ソフトウェア開発のプロセス自体をトレーニングデータのソースとして使用する点にあります。開発者が作業を行う際に見るコンテキストと、それに対するアクションを組み合わせて、モデルはソフトウェア開発のダイナミクスについて学び、開発者が時間を費やす方法により合わせることができます。私たちは、Google のソフトウェア開発の計装を活用して、開発者活動データの量と多様性を以前の作品を超えて拡大しました。結果は、プロのソフトウェア開発者にとっての有用性と、一般的なソフトウェア開発スキルを ML モデルに注入する可能性という2つの側面で非常に有望です。 DIDACT は、編集、デバッグ、修復、およびコードレビューを含む開発活動をトレーニングするマルチタスクモデルです。 私たちは DIDACT Comment…

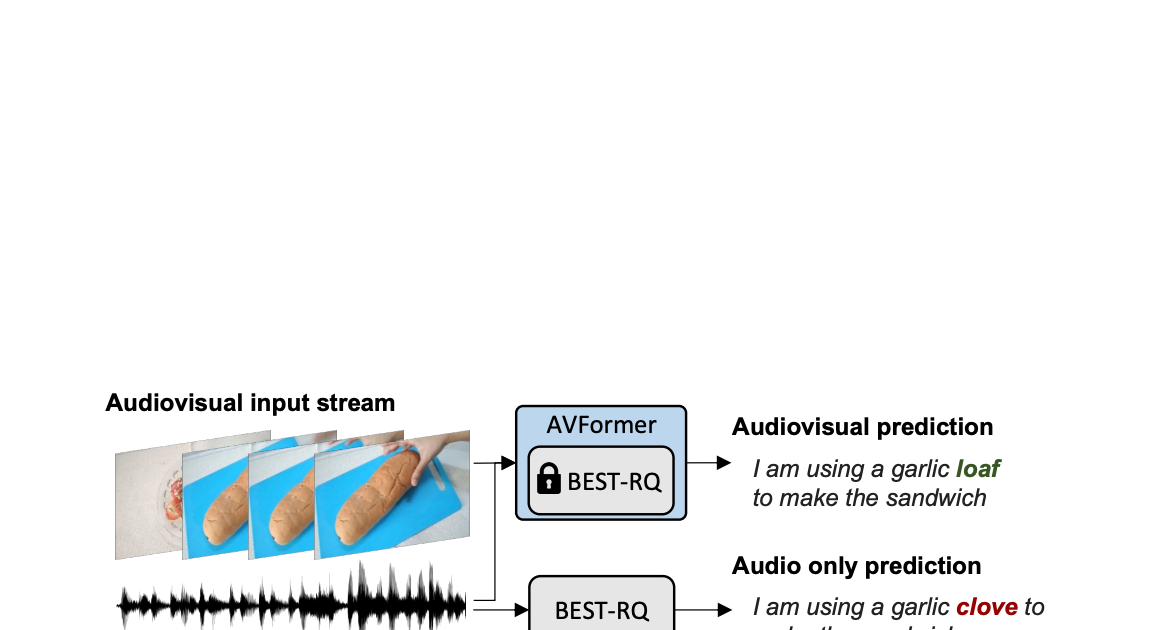

AVFormer:凍結した音声モデルにビジョンを注入して、ゼロショットAV-ASRを実現する

Google Researchの研究科学者、Arsha NagraniとPaul Hongsuck Seoによる投稿 自動音声認識(ASR)は、会議通話、ストリームビデオの転写、音声コマンドなど、さまざまなアプリケーションで広く採用されている確立された技術です。この技術の課題は、ノイズのあるオーディオ入力に集中していますが、マルチモーダルビデオ(テレビ、オンライン編集ビデオなど)の視覚ストリームはASRシステムの堅牢性を向上させる強力な手がかりを提供することができます。これをオーディオビジュアルASR(AV-ASR)と呼びます。 唇の動きは音声認識に強力な信号を提供し、AV-ASRの最も一般的な焦点であるが、野外のビデオで口が直接見えないことがよくあります(例えば、自己中心的な視点、顔のカバー、低解像度など)ため、新しい研究領域である拘束のないAV-ASR(AVATARなど)が誕生し、口の領域だけでなく、ビジュアルフレーム全体の貢献を調査しています。 ただし、AV-ASRモデルをトレーニングするためのオーディオビジュアルデータセットを構築することは困難です。How2やVisSpeechなどのデータセットはオンラインの教育ビデオから作成されていますが、サイズが小さいため、モデル自体は通常、ビジュアルエンコーダーとオーディオエンコーダーの両方から構成され、これらの小さなデータセットで過剰適合する傾向があります。それにもかかわらず、オーディオブックから取得した大量のオーディオデータを用いた大規模なトレーニングによって強く最適化された最近リリースされた大規模なオーディオモデルがいくつかあります。LibriLightやLibriSpeechなどがあります。これらのモデルには数十億のパラメータが含まれ、すぐに利用可能であり、ドメイン間で強い汎化性能を示します。 上記の課題を考慮して、私たちは「AVFormer:ゼロショットAV-ASRの凍結音声モデルにビジョンを注入する」と題した論文で、既存の大規模なオーディオモデルにビジュアル情報を付加するシンプルな方法を提案しています。同時に、軽量のドメイン適応を行います。AVFormerは、軽量のトレーニング可能なアダプタを使用して、視覚的な埋め込みを凍結されたASRモデルに注入します(Flamingoが大規模な言語モデルに視覚テキストタスクのためのビジュアル情報を注入する方法と似ています)。これにより、最小限の追加トレーニング時間とパラメータで弱くラベル付けられた少量のビデオデータでトレーニング可能です。トレーニング中のシンプルなカリキュラムスキームも紹介し、オーディオとビジュアルの情報を効果的に共同処理できるようにするために重要であることを示します。その結果、AVFormerモデルは、3つの異なるAV-ASRベンチマーク(How2、VisSpeech、Ego4D)で最新のゼロショットパフォーマンスを達成し、同時に伝統的なオーディオのみの音声認識ベンチマーク(LibriSpeechなど)のまともなパフォーマンスを保持しています。 拘束のないオーディオビジュアル音声認識。軽量モジュールを使用して、ビジョンを注入して、オーディオビジュアルASRのゼロショットを実現するために、Best-RQ(灰色)の凍結音声モデルにビジョンを注入します。AVFormer(青)というパラメーターとデータ効率の高いモデルが作成されます。オーディオ信号がノイズの場合、視覚的なパンの生成トランスクリプトでオンリーミステイク「クローブ」を「ローフ」に修正するのに役立つ視覚的なパンが役立つ場合があります。 軽量モジュールを使用してビジョンを注入する 私たちの目標は、既存のオーディオのみのASRモデルにビジュアル理解能力を追加しながら、その汎化性能を各ドメイン(AVおよびオーディオのみのドメイン)に維持することです。 このために、既存の最新のASRモデル(Best-RQ)に次の2つのコンポーネントを追加します:(i)線形ビジュアルプロジェクター、および(ii)軽量アダプター。前者は、オーディオトークン埋め込みスペースにおける視覚的な特徴を投影します。このプロセスにより、別々に事前トレーニングされたビジュアル機能とオーディオ入力トークン表現を適切に接続することができます。後者は、その後最小限の変更で、ビデオのマルチモーダル入力を理解するためにモデルを変更します。その後、これらの追加モジュールを、HowTo100Mデータセットからのラベル付けされていないWebビデオとASRモデルの出力を擬似グラウンドトゥルースとして使用してトレーニングし、Best-RQモデルの残りを凍結します。このような軽量モジュールにより、データ効率と強力なパフォーマンスの汎化が可能になります。 我々は、AV-ASRベンチマークにおいて、モデルが人手で注釈付けされたAV-ASRデータセットで一度もトレーニングされていないゼロショット設定で、拡張モデルを評価しました。 ビジョン注入のためのカリキュラム学習 初期評価後、私たちは経験的に、単純な一回の共同トレーニングでは、モデルがアダプタとビジュアルプロジェクタの両方を一度に学習するのが困難であることがわかりました。この問題を緩和するために、私たちは、これら2つの要因を分離し、ネットワークを順序良くトレーニングする2段階のカリキュラム学習戦略を導入しました。最初の段階では、アダプタパラメータが全くフィードされずに最適化されます。アダプタがトレーニングされたら、ビジュアルトークンを追加し、トレーニング済みのアダプタを凍結したまま第2段階でビジュアルプロジェクションレイヤーのみをトレーニングします。 最初の段階は、音声ドメイン適応に焦点を当てています。第2段階では、アダプタが完全に凍結され、ビジュアルプロジェクタは、ビジュアルトークンをオーディオ空間に投影するためのビジュアルプロンプトを生成することを学習する必要があります。このように、私たちのカリキュラム学習戦略は、モデルがAV-ASRベンチマークでビジュアル入力を統合し、新しい音声ドメインに適応することを可能にします。私たちは、交互に適用する反復的な適用では性能が低下するため、各段階を1回だけ適用します。 AVFormerの全体的なアーキテクチャとトレーニング手順。アーキテクチャは、凍結されたConformerエンコーダー・デコーダーモデル、凍結されたCLIPエンコーダー(グレーのロックシンボルで示される凍結層を持つ)、および2つの軽量トレーニング可能なモジュールで構成されています。-(i)ビジュアルプロジェクションレイヤー(オレンジ)およびボトルネックアダプタ(青)を有効にし、多モーダルドメイン適応を可能にします。私たちは、2段階のカリキュラム学習戦略を提案しています。最初に、アダプタ(青)をビジュアルトークンなしでトレーニングします。その後、ビジュアルプロジェクションレイヤー(オレンジ)を調整し、他のすべての部分を凍結したままトレーニングします。 下のプロットは、カリキュラム学習なしでは、AV-ASRモデルがすべてのデータセットでオーディオのみのベースラインよりも劣っており、より多くのビジュアルトークンが追加されるにつれてその差が拡大することを示しています。一方、提案された2段階のカリキュラムが適用されると、AV-ASRモデルは、オーディオのみのベースラインよりも遥かに優れたパフォーマンスを発揮します。 カリキュラム学習の効果。赤と青の線はオーディオビジュアルモデルであり、ゼロショット設定で3つのデータセットに表示されます(WER%が低い方が良いです)。カリキュラムを使用すると、すべての3つのデータセットで改善します(How2(a)およびEgo4D(c)では、オーディオのみのパフォーマンスを上回るために重要です)。4つのビジュアルトークンまで性能が向上し、それ以降は飽和します。 ゼロショットAV-ASRでの結果 私たちは、How2、VisSpeech、Ego4Dの3つのAV-ASRベンチマークで、zero-shotパフォーマンスのために、BEST-RQ、私たちのモデルの音声バージョン、およびAVATARを比較しました。AVFormerは、すべてのベンチマークでAVATARとBEST-RQを上回り、BEST-RQでは600Mパラメータをトレーニングする必要がありますが、AVFormerはわずか4Mパラメータしかトレーニングせず、トレーニングデータセットのわずか5%しか必要としません。さらに、音声のみのLibriSpeechでのパフォーマンスも評価し、AVFormerは両方のベースラインを上回ります。 AV-ASRデータセット全体におけるゼロショット性能に対する最新手法との比較。音声のみのLibriSpeechのパフォーマンスも示します。結果はWER%(低い方が良い)として報告されています。 AVATARとBEST-RQはHowTo100Mでエンドツーエンド(すべてのパラメータ)で微調整されていますが、AVFormerは微調整されたパラメータの少ないセットのおかげで、データセットの5%でも効果的に機能します。…

ビジュアルキャプション:大規模言語モデルを使用して、動的なビジュアルを備えたビデオ会議を補完する

Google Augmented Realityのリサーチサイエンティスト、Ruofei DuとシニアスタッフリサーチサイエンティストのAlex Olwalが投稿しました。 ライブキャプションやノイズキャンセリングなどの機能により、ビデオ会議の最近の進歩により、リモートビデオ通信は大幅に改善されました。しかし、複雑で微妙な情報をより良く伝えるために、動的な視覚的拡張が役立つ場面があります。たとえば、日本食レストランで何を注文するか話し合う場合、友達があなたが「すき焼き」を注文することに自信を持つのに役立つビジュアルを共有することができます。また、最近の家族旅行について話しているときに、個人的なアルバムから写真を見せたい場合があります。 ACM CHI 2023 で発表された「Visual Captions: Augmenting Verbal Communication With On-the-fly Visuals」では、私たちは、口頭の手がかりを使用してリアルタイムのビジュアルを使って同期ビデオ通信を拡張するシステムを紹介します。私たちは、この目的のためにキュレーションしたデータセットを使用して、オープンボキャブラリーの会話で関連するビジュアルを積極的に提案するために、大規模な言語モデルを微調整しました。私たちは、実時間の転写とともに拡張されたコミュニケーションの急速なプロトタイピングに設計されたARChatプロジェクトの一部としてVisual Captionsをオープンソース化しました。 Visual Captionsは、リアルタイムのビジュアルで口頭コミュニケーションを容易にします。このシステムは、リアルタイムの音声からテキストへの転写でよく見られる誤りにも対応しています。たとえば、文脈から外れて、転写モデルは「pier」という単語を「pair」と誤解しましたが、Visual Captionsはそれでもサンタモニカのピアの画像を推奨します。 動的なビジュアルで口頭コミュニケーションを拡張するための設計空間 私たちは、ソフトウェアエンジニア、研究者、UXデザイナー、ビジュアルアーティスト、学生など、様々な技術的および非技術的なバックグラウンドを持つ10人の内部参加者を招待し、潜在的なリアルタイムビジュアル拡張サービスの特定のニーズと欲求を議論しました。2つのセッションで、私たちは想定されるシステムの低保守性のプロトタイプを紹介し、その後、既存のテキストから画像へのシステムのビデオデモを示しました。これらの議論により、以下のようにD1からD8とラベル付けされた8つの次元の設計空間が生まれました。 ビジュアル拡張は、会話と同期または非同期に行われる場合があります(D1:時間)、話題の表現と理解の両方に使用できる場合があります(D2:主題)、さまざまなビジュアルコンテンツ、ビジュアルタイプ、ビジュアルソースを使用して適用できる場合があります(D3:ビジュアル)。このような視覚的拡張は、ミーティングの規模(D4:スケール)や、共同設置またはリモート設定でミーティングが行われているかどうか(D5:スペース)によって異なる場合があります。これらの要因はまた、ビジュアルが個人的に表示されるべきか、参加者間で共有されるべきか、あるいはすべての人に公開されるべきかを決定するのにも影響します(D6:プライバシー)。参加者はまた、会話をしながらシステムとやり取りするさまざまな方法を特定しました(D7:起動)。たとえば、人々は「プロアクティブ」の異なるレベルを提案しました。これは、ユーザーがモデルがイニシアチブを取る程度を示します。最後に、参加者は、入力に音声やジェスチャーを使用するなど、異なる相互作用方法を想定しました(D8:相互作用)。…

エンジニアからDeclarative MLを使ったMLエンジニアになろう

機械学習の宣言的アプローチを用いて、わずか数行のコードでAIモデルを簡単に構築し、独自のLLMをカスタマイズする方法を学んでください

AI:大規模言語&ビジュアルモデル

この記事では、AIにおける大規模言語モデルと視覚モデルの重要性、それらの能力、潜在的なシナジー、データバイアスや倫理的懸念といった課題、そして市場への影響について論じ、人工知能分野を前進させる可能性を強調しています

OpenAIのAI安全性へのアプローチ

OpenAIのCEOであるSam Altmanが新しい技術に関する懸念事項について証言した後、AIシステムの安全アプローチはどうなるでしょうか?

AWS Inferentia2は、AWS Inferentia1をベースにしており、スループットが4倍に向上し、レイテンシが10倍低減されています

機械学習モデル(MLモデル)のサイズ、特に生成AIにとって、大規模言語モデル(LLM)やファウンデーションモデル(FM)のサイズは年々急速に増加しており、これらのモデルにはより高速で強力なアクセラレータが必要ですAWS Inferentia2は、LLMや生成AIの推論のコストを下げつつ、より高いパフォーマンスを提供するように設計されましたこの[...]

データ体験の再発明:生成的AIと現代的なデータアーキテクチャを使用して、洞察を解き放つ

現代的なデータアーキテクチャを実装することで、異なるソースからのデータを統合するためのスケーラブルな方法が提供されますインフラストラクチャではなくビジネスドメインによってデータを組織化することにより、各ドメインは自分たちのニーズに合ったツールを選択することができます絶え間ない革新を続けながら、ジェネレーティブAIソリューションによって現代的なデータアーキテクチャの価値を最大化することができます自然言語の機能は、[…]

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.