Learn more about Search Results OPT - Page 71

- You may be interested

- 「データの視覚化を即座に改善する4つの簡...

- 「生成AIにおけるLLMエージェントのデコー...

- ホームブリューや仮想マシンなしでMacBook...

- データ、アーキテクチャ、または損失:マ...

- スコルテックとAIRIの研究者は、ニューラ...

- QLoRAを使用して、Amazon SageMaker Studi...

- 「DeepMindによるこのAI研究は、シンプル...

- シャージャ大学の研究者たちは、アラビア...

- 「テンソル量子化:語られなかった物語」

- OpenAIのLLMの支配を覆すことを目指す挑戦...

- アシストされた生成:低遅延テキスト生成...

- 公的機関によるAI調達のための標準契約条...

- 「生成AIの組織化:データサイエンスチー...

- 「IBM、HuggingFace、そしてNASAがWatsonx...

- 「ゴミを入れればゴミが出る」という言葉...

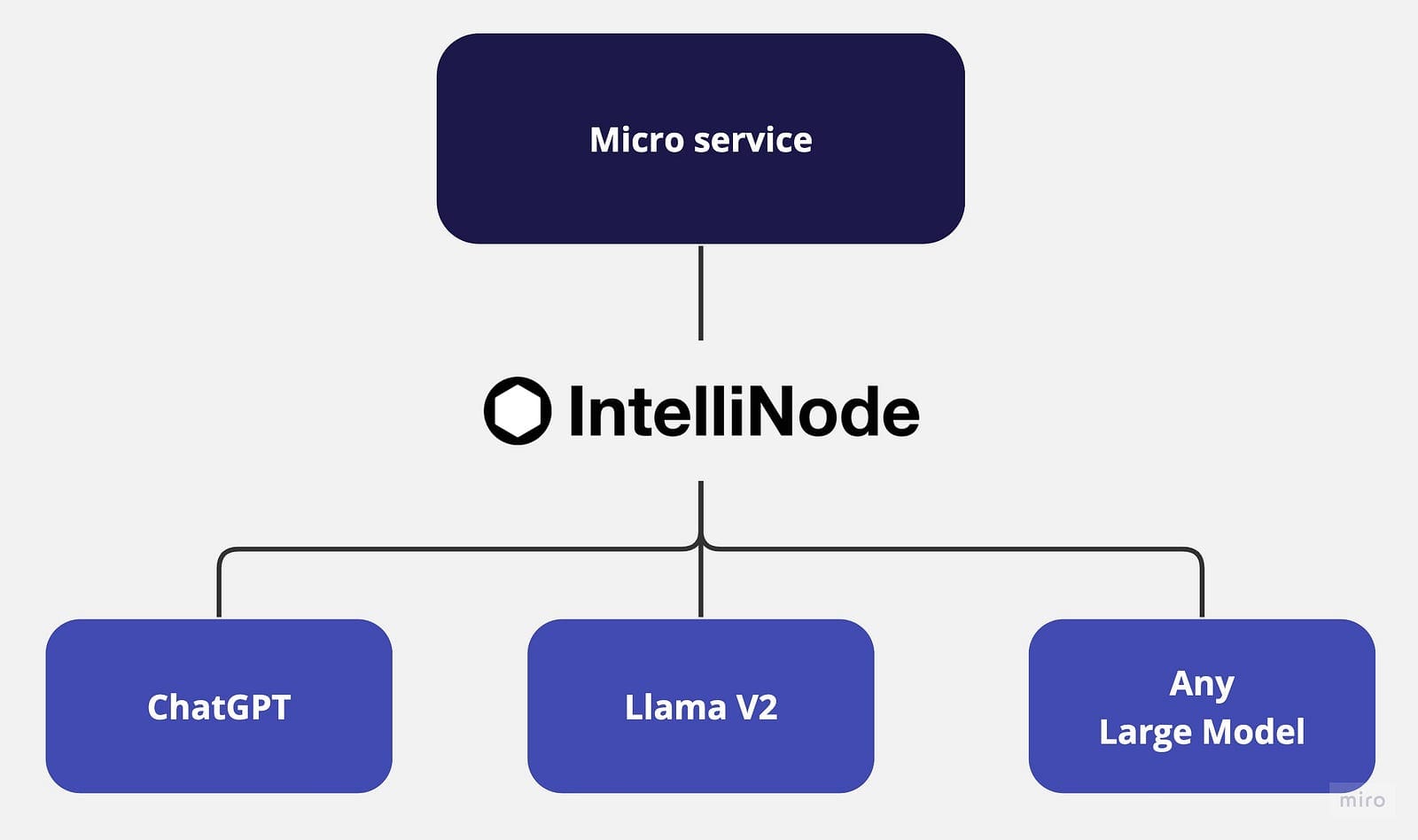

ラマとChatGPTを使用してマルチチャットバックエンドのマイクロサービスを構築する

LLM(Language Model)が進化し続けるにつれて、複数のモデルを統合したり、それらを切り替えることはますます困難になっていますこの記事では、モデルの統合をビジネスアプリケーションから分離し、プロセスを単純化するために、マイクロサービスアプローチを提案しています

「HuggingFaceを使用したLlama 2 7B Fine-TunedモデルのGPTQ量子化」

前の記事では、Meta AIが最近リリースした新しいLlama 2モデルを使用して、わずか数行のコードでPythonコードジェネレータを構築する方法を紹介しました今回は、...と説明します

「生成モデルを活用して半教師あり学習を強化する」

はじめに 機械学習のダイナミックな世界では、限られたラベル付きデータのフルポテンシャルを引き出すという一つの課題が常に存在します。それに対応するために、半教師あり学習という領域が存在します。この半教師あり学習は、少量のラベル付きデータと大量のラベルなしデータを組み合わせるという独創的なアプローチです。本記事では、変分オートエンコーダ(VAEs)や生成対抗ネットワーク(GANs)といった生成モデルを活用するという、ゲームチェンジングな戦略を探求します。魅力的な旅の終わりには、これらの生成モデルが半教師あり学習アルゴリズムの性能を劇的に向上させる方法を理解していただけるでしょう。まるでドキドキするストーリーの巧妙な展開のように、これらの生成モデルが半教師あり学習に深い影響を与えることに驚かされることでしょう。 出典: researchgate.net 学習目標 まず、半教師あり学習について探求し、なぜそれが重要であり、実際の機械学習シナリオでどのように使用されるのかを理解します。 次に、VAEsやGANsといった魅力的な生成モデルの世界に入ります。これらのモデルが半教師あり学習をどのように強化するのかを見ていきます。 実践的な側面についてご案内します。データの準備からモデルの訓練まで、これらの生成モデルを実世界の機械学習プロジェクトに統合する方法を学びます。 モデルの一般化やコスト削減といったメリットを強調します。さらに、このアプローチが異なる分野にどのように適用されるかを紹介します。 すべての旅には課題がありますが、それらを乗り越えていきます。また、生成モデルを半教師あり学習に責任を持って使用するために重要な倫理的考慮事項についても見ていきます。 この記事はデータサイエンスブログマラソンの一環として公開されました。 半教師あり学習への入門 機械学習の広大な領域において、ラベル付きデータの取得は困難な場合があります。データの注釈付けには時間とコストがかかることが多く、教師あり学習のスケーラビリティを制限する可能性があります。そこで登場するのが半教師あり学習です。このアプローチは、ラベル付きデータとラベルなしデータの領域とをつなぐ知恵です。ラベル付きデータは非常に重要ですが、未ラベルのデータの広大なプールはしばしば眠っており、活用されることを待っています。 例えば、画像中のさまざまな動物をコンピュータに認識させるという課題が与えられたとしましょう。しかし、それぞれの動物にラベルを付けることは困難な作業です。ここで半教師あり学習が登場します。小さなバッチのラベル付き画像と大量のラベルなし画像を組み合わせて機械学習モデルの訓練に使用することを提案します。このアプローチにより、モデルは未ラベルデータの潜在能力にアクセスし、パフォーマンスと適応性を向上させることができます。まるで情報の銀河系を航海する際の少数の導きの星のようなものです。 出典: festinais.medium.com 半教師あり学習を通じて、その重要性、基本原理、そして革新的な戦略を探求し、特にVAEsやGANsなどの生成モデルがその能力をいかに高めるかに焦点を当てます。生成モデルと手を取り合って、半教師あり学習の力を解き放ちましょう。 生成モデル:半教師あり学習の強化 魅力的な機械学習の世界において、生成モデルは半教師あり学習に新たな息吹を与える本当のゲームチェンジャーとして登場します。これらのモデルは、データの複雑さを理解するだけでなく、それを学んだ内容と鏡像する新しいデータを生成するというユニークな才能を持っています。この領域で最も優れたパフォーマンスを示すのは、変分オートエンコーダ(VAEs)と生成対抗ネットワーク(GANs)です。これらの生成モデルが半教師あり学習の限界を押し広げる触媒となる方法を探求する旅に出かけましょう。 VAEsはデータ分布の本質を捉えることに優れています。これは、入力データを隠れた空間にマッピングし、それを念入りに再構築することで実現されます。この能力は、半教師あり学習において意味のある簡潔なデータ表現をモデルに抽出するために大きな役割を果たします。これらの表現は、豊富なラベル付きデータの必要性を排除することなく、限られたラベル付き例に直面しても改善された一般化の鍵となります。一方、GANsは魅力的な対抗的なダンスを演じます。ここでは、生成器が実データと区別できないデータを作り出すことを目指し、識別器が厳しい批評家の役割を果たします。このダイナミックなデュエットにより、データの拡張が行われ、完全に新しいデータの生成への道が開かれます。VAEsとGANsがスポットライトを浴びるのは、この魅力的なパフォーマンスを通じて、半教師あり学習の新たな時代を切り拓くからです。 実践的な実装手順 理論的な側面を探求した後は、袖をまくってジェネレーティブモデルを用いた半教師あり学習の実践的な実装に入りましょう。ここで魔法が起こります。アイデアを現実の解決策に変える場所です。以下は、このシナジーを実現するために必要な手順です: 出典:google-cloud.com ステップ1:データの準備…

「Pandas 2.1の新機能」

pandas 2.1は2023年8月30日にリリースされましたこのリリースで導入された内容と、pandasのワークロード改善にどのように役立つのかを見てみましょう多数の改善が含まれていますが、…

Amazon SageMakerのマルチモデルエンドポイントを使用して、TorchServeを使ってGPU上で複数の生成AIモデルを実行し、推論コストを最大75%節約できます

最近、生成AIアプリケーションは広範な注目と想像力を引きつけています顧客はGPU上で生成AIモデルを展開したいと思っていますが、同時にコストにも気を使っていますSageMaker MMEはGPUインスタンスをサポートしており、このようなタイプのアプリケーションには最適なオプションです本日は、TorchServeがSageMaker MMEをサポートすることをお知らせしますこの新しいモデルサーバーサポートにより、TorchServeの顧客が最も馴染みのあるサービングスタックを使用しながら、MMEのすべての利点を活用することができますこの記事では、Stable DiffusionやSegment Anything Modelなどの生成AIモデルをTorchServeを使用してSageMaker MME上でホストし、アーティストやコンテンツクリエーターが作品をより速く開発し、イテレーションするための言語による編集ソリューションの構築方法を示します

「カナダでウェブサイトを立ち上げる方法」

ウェブサイトを立ち上げることは、カナダでオンラインプレゼンスを確立しようとする個人、企業、組織にとって重要なステップですこのガイドでは、カナダ市場でウェブサイトを成功裏に立ち上げるための必須ステップについて明らかにしますドメイン登録からウェブサイトのホスティング、コンテンツのローカライズ、法的要件の遵守まで、包括的な情報がこちらにあります... カナダでウェブサイトを立ち上げる方法の詳細については»

大規模言語モデルのコード解読:Databricksが教えてくれたこと

「ファインチューニング、フラッシュアテンション、LoRa、AliBi、PEFTなどの技術を使用して、カスタムモデルを開発することにより、自分自身のエンドツーエンドのプロダクションレディなLLMワークフローの構築を学びましょう」

自然言語処理のための高度なガイド

イントロダクション 自然言語処理(NLP)の変革的な世界へようこそ。ここでは、人間の言語の優雅さが機械の知能の正確さと出会います。NLPの見えない力は、私たちが頼りにしているデジタルのインタラクションの多くを支えています。このナチュラルランゲージプロセッシングガイドは、あなたの質問に応答するチャットボット、意味に基づいて結果を調整する検索エンジン、声のアシスタントがリマインダーを設定するなど、さまざまなアプリケーションで使用されます。 この包括的なガイドでは、ビジネスを革新しユーザーエクスペリエンスを向上させる、最先端のNLPの応用について掘り下げていきます。 文脈埋め込みの理解: 単語は単なる分離された単位ではありません。文脈によってその意味が変わります。Word2Vecのような静的な埋め込みから文脈を必要とする対話型な埋め込みまで、埋め込みの進化について見ていきます。 トランスフォーマーとテキスト要約の技術: 要約は単なるテキストの切り詰めを超える難しい仕事です。トランスフォーマーアーキテクチャとT5などのモデルについて学び、成功する要約の基準がどのように変わっているかを理解しましょう。 深層学習の時代には、層や複雑さのために感情を分析することは困難です。特にトランスフォーマーアーキテクチャに基づく深層学習モデルは、これらの複雑な層を解釈することに長けており、より詳細な感情分析を提供します。 有用な洞察を得るために、Kaggleのデータセット ‘Airline_Reviews’ を使用します。このデータセットには実世界のテキストデータが含まれています。 学習目標 ルールベースのシステムから深層学習アーキテクチャへの移行を認識し、特に転換の重要な瞬間に重点を置きます。 Word2Vecなどの静的単語表現から動的な文脈埋め込みへのシフトについて学び、言語理解における文脈の重要性を強調します。 トランスフォーマーアーキテクチャの内部構造と、T5などのモデルがテキスト要約を革新している方法について詳しく学びます。 特にトランスフォーマーベースのモデルなどの深層学習を活用して、テキストの感情に具体的な洞察を提供できるかを発見します。 この記事はデータサイエンスブログマラソンの一部として公開されました。 NLPの深い探求 自然言語処理(NLP)は、機械に人間の言語を理解し、解釈し、応答することを教える人工知能の分野です。この技術は、人間とコンピュータをつなげ、より自然なインタラクションを可能にします。スペルチェックやキーワード検索などの簡単なタスクから、機械翻訳、感情分析、チャットボットの機能などのより複雑な操作まで、さまざまなアプリケーションでNLPを使用できます。これにより、音声アクティベーションされた仮想アシスタント、リアルタイム翻訳サービス、さらにはコンテンツ推奨アルゴリズムなどが機能することが可能になります。自然言語処理(NLP)は、言語学、コンピュータサイエンス、機械学習の知識を結集し、テキストデータを理解できるアルゴリズムを作成することで、現代のAIアプリケーションの基盤となっています。 NLPの技術の進化 NLPはこれまでに大きく進化し、ルールベースのシステムから統計モデル、そして最近では深層学習へと進化してきました。言語の特異性を捉えるための旅は、従来の袋状モデルからWord2Vec、そして文脈埋め込みへの変化によって見ることができます。計算能力とデータの利用可能性が向上するにつれて、NLPは言語の微妙なニュアンスを理解するために洗練されたニューラルネットワークを使用するようになりました。現代の転移学習の進歩により、モデルは特定のタスクを改善し、実世界のアプリケーションでの効率と正確性を確保することができます。 トランスフォーマーの台頭 トランスフォーマーは、多くの最先端NLPモデルの基盤となる一種のニューラルネットワークアーキテクチャです。トランスフォーマーは、再帰的または畳み込み層に重点を置いた従来のモデルと比較して、入力と出力の間のグローバルな依存関係を引き出すための “アテンション”…

自己対戦を通じて単純なゲームをマスターするエージェントのトレーニング

「完全情報ゲームで優れるために必要なすべてがゲームのルールにすべて見えるというのはすごいことですね残念ながら、私のような凡人には、ゲームのルールを読むことさえ…」

「機械学習のための現実世界のデータ収集ガイド」

「データサイエンスに完全に初めてであるか、大規模な組織のチーフデータサイエンティストであるかに関わらず、おそらくあなたは完璧に作りこまれたデータセットを使って、おもちゃの機械学習の問題を解決するために遊んだことがあるでしょうたぶん…」

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.