Learn more about Search Results A - Page 702

- You may be interested

- 機械学習における再現性の重要性

- JAXを使用して研究を加速化する

- 「Stack Overflowは、OverflowAIによって...

- 自己学習のためのデータサイエンスカリキ...

- 新しい量子コンピューティングアーキテク...

- デット (物体検出用トランスフォーマー)

- 赤い猫&アテナAIは夜間視認能力を備え...

- 「MITの研究者が、デバイス内の意味的セグ...

- 「Ai X ビジネスおよびイノベーションサミ...

- T5:テキスト対テキスト変換器(パート1)

- Rによるディープラーニング

- 「PUGに会ってください:メタAIによるアン...

- 「SynthIDを使ったAI生成画像の識別」

- 「セマンティック-SAMに会ってください:...

- このAIニュースレターはあなたが必要なも...

「P-値:統計的有意性の理解を平易な言葉で」

今日は、統計の面白い探求をしましょう familar でありながらよく誤解される概念である「逃げることのできないけれども常に存在するP値」について取り組みますもし自分自身を見つけたとしても心配しないでください...

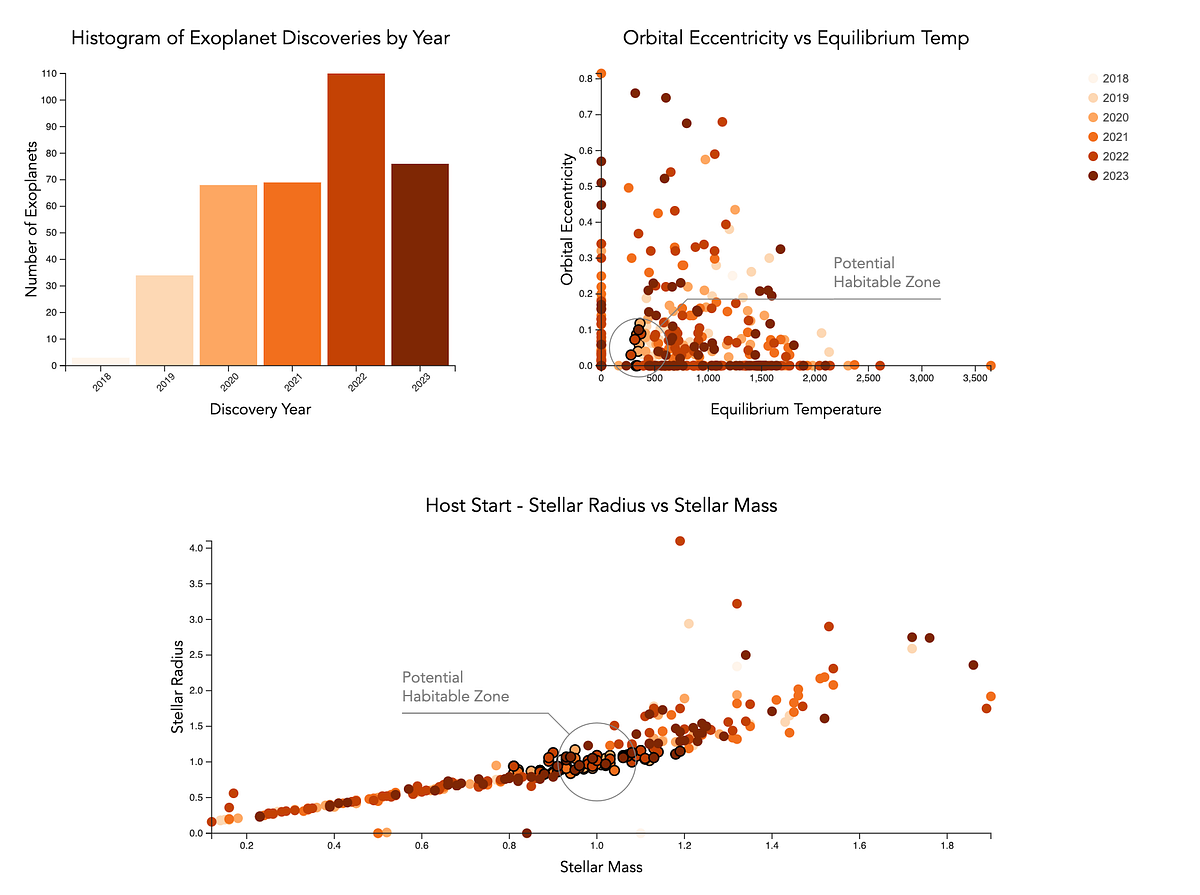

「説明的なデータの可視化の技術を取り入れる」

データの可視化は、読者に複雑なデータを表現するための強力なツールですさらに一歩進んで、ナラティブの可視化は情報を一連の物語に変換するデータストーリーを作り出すことを可能にします…

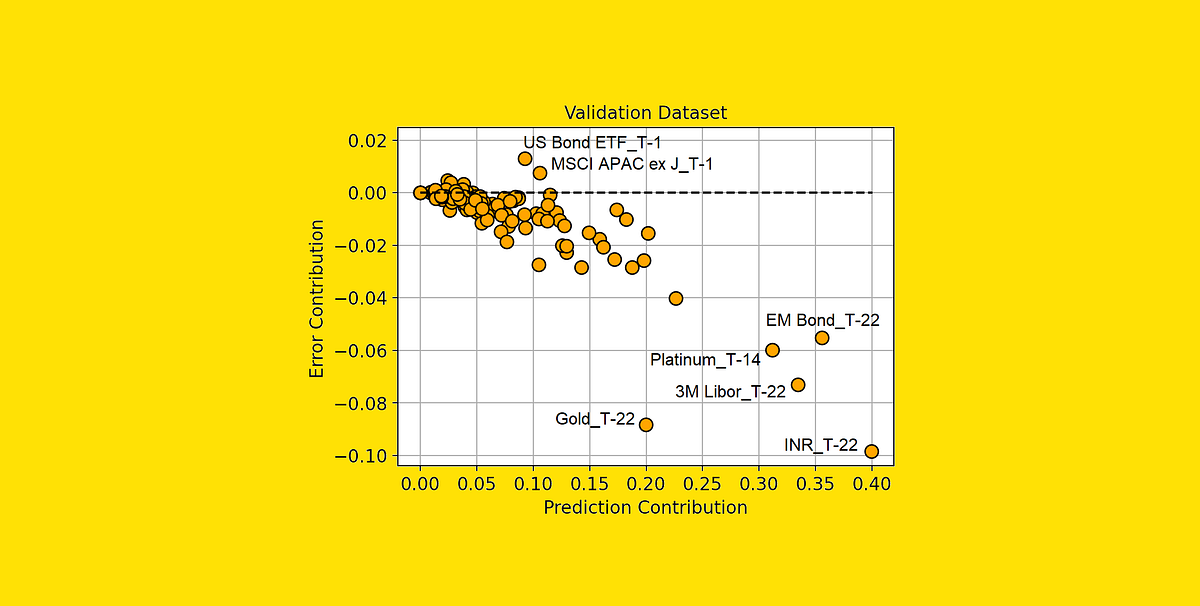

あなたの特徴は重要ですか?それが良いということではありません

「特徴の重要性」という概念は、機械学習において最も基本的なモデルの説明性として広く使用されています例えば、再帰的特徴削減(RFE)では、反復的に使用されます...

データサイエンティストにとって使いやすい空間連続性を定量化するためのバリオグラムチュートリアル

バリオグラムは、空間データの距離に基づく変動性を示すために使用されますバリオグラムを使用して空間の連続性を理解し、モデル化することは重要ですなぜなら、バリオグラムはポイントの推定に使用されるからです…

「IID 初心者のための意味と解釈」

「統計学、データ分析、機械学習の話題では、IIDという概念が基本的な仮定や条件として頻繁に登場しますIIDは「独立かつ同一分布」という意味であり、…」

増強と生産性のための人工知能

「MITシュワルツマンコンピュータ科学大学院は、AIを活用したマネジメントを探求する7つの学際プロジェクトに対してシードグラントを授与します」

組合せ最適化によるニューラルネットワークの剪定

Posted by Hussein Hazimeh、Athenaチームの研究科学者、およびMITの大学院生であるRiade Benbakiによる投稿 近代的なニューラルネットワークは、言語、数学的推論、ビジョンなど、さまざまなアプリケーションで印象的なパフォーマンスを達成しています。しかし、これらのネットワークはしばしば大規模なアーキテクチャを使用し、多くの計算リソースを必要とします。これにより、特にウェアラブルやスマートフォンなどのリソース制約のある環境では、このようなモデルをユーザーに提供することが実用的ではありません。事前学習済みネットワークの推論コストを軽減するための広く使用されている手法は、いくつかの重みを削除することによる枝刈りですが、これはネットワークの有用性にほとんど影響を与えない方法で行われます。標準的なニューラルネットワークでは、各重みは2つのニューロン間の接続を定義します。したがって、重みが剪定された後、入力はより小さな一連の接続を介して伝播し、より少ない計算リソースを必要とします。 元のネットワークと剪定されたネットワークの比較。 枝刈り手法は、ネットワークのトレーニングプロセスのさまざまな段階で適用できます。トレーニング後、トレーニング中、またはトレーニング前(つまり、重みの初期化直後)に適用できます。この投稿では、トレーニング後の設定に焦点を当てています。つまり、事前学習済みネットワークが与えられた場合、どの重みを剪定すべきかをどのように決定できるかという問題です。最も一般的な手法の1つは、マグニチュード剪定です。この手法では、最も小さい絶対値を持つ重みを削除します。効率的ではありますが、この手法は重みの削除がネットワークのパフォーマンスに与える影響を直接考慮しません。もう1つの一般的な手法は、最小化された損失関数に対する重みの影響度に基づいて重みを削除する最適化ベースの剪定です。概念的には魅力的ですが、既存の最適化ベースの手法の多くは、パフォーマンスと計算要件の間に深刻なトレードオフがあるようです。粗い近似を行う手法(例:対角ヘッシアン行列を仮定する)はスケーラブル性が高く、パフォーマンスは比較的低いです。一方、より少ない近似を行う手法はパフォーマンスが向上する傾向がありますが、スケーラブル性ははるかに低いようです。 「Fast as CHITA: Neural Network Pruning with Combinatorial Optimization」は、ICML 2023で発表された論文で、事前学習済みニューラルネットワークの剪定において、スケーラビリティとパフォーマンスのトレードオフを考慮した最適化ベースのアプローチを開発した方法について説明しています。CHITA(「Combinatorial Hessian-free Iterative Thresholding Algorithm」の略)は、高次元統計、組合せ最適化、およびニューラルネットワークの剪定など、いくつかの分野の進歩を活用しています。たとえば、CHITAはResNetの剪定において最先端の手法よりも20倍から1000倍高速であり、多くの設定で精度を10%以上向上させることができます。 貢献の概要 CHITAには、人気のある手法に比べて2つの注目すべき技術的改善点があります:…

「超伝導デバイスは、コンピューティングや他のアプリケーションにおいてエネルギー使用量を劇的に削減することができる可能性があります」

「MITの研究者によって開発されたシンプルな超伝導デバイスは、高出力コンピューティングシステムのエネルギー使用量を大幅に削減し、量子コンピューティング技術を改善する可能性があります」

コンテンツモデレーションからゼロショット分類へ

もし、追加情報や文脈がない小さなテキストを分析し、自分自身のデータを定義するために最も妥当なラベルを取得したい場合、どうすればよいでしょうか?

「ファクトテーブルとディメンションテーブルの違い」

広範なデータセットを簡単にアクセスできる構造に整理することは重要です。スター・スキーマは、事実テーブルと次元テーブルの2つの要素からなる効果的なアプローチです。次元テーブルは中央の事実テーブルを取り囲んでおり、スターまたはスノーフレークの形状を作り出します。これらのコンポーネントの明確な区別には、それぞれの概念と役割の包括的な理解が必要であり、それぞれの特定の目的をしっかりと理解することが求められます。では、それぞれの違いについて探ってみましょう! 事実テーブル vs 次元テーブル パラメーター 事実テーブル 次元テーブル 基本 ビジネスイベントに関する数量データを含む 事実テーブルのデータに対する説明的なコンテキストと属性を提供する 作成順序 次元テーブルの後に作成される 最初に作成される コンポーネント 事実、メトリック、測定値 説明的な属性 コンポーネントの数 属性が少なく、レコードが多い レコードが少なく、属性が多い 特徴 粒度または原子レベル 単語、完全性、詳細レベル 階層 なし…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.