Learn more about Search Results GLUE - Page 6

- You may be interested

- フランス国立科学研究センター(CNRS)に...

- 「オープンソースAI」の神話

- 「LLMの内部構造:言語モデルアーキテクチ...

- ロコムジョコに会おう:厳格な評価と比較...

- AlphaDevは、より高速なソートアルゴリズ...

- 「集団行動のデコード:アクティブなベイ...

- 「二つの頭を持つ分類器の使用例」

- メタAIのハンプバック!LLMの自己整列と指...

- 「新たなホワイトハウスの協定に基づき、A...

- 「世界最大の広告主がAIの力を受け入れる...

- 「科学者たちが歴史的なコードを解読し、...

- 「ソフトウェア開発者のための機械学習フ...

- Salesforceは、データ駆動型のAIとCRMを通...

- 「Pythonを使用した地理空間データの分析...

- 「UVeyeの共同設立者兼CEO、アミール・ヘ...

「AWS上のPySparkを使用したビッグデータでの機械学習の活用」

編集者注:Suman Debnathさんは、8月22日から23日にかけて開催されるODSC APACのスピーカーです彼のトーク、「AWS上でSparkを使用して分類と回帰モデルを構築する」をぜひチェックしてください!データサイエンスの絶え間なく変化する競技場では、適切なツールを見極めて適用することが結果の大きく形成される要素となります...

「Advanced Reasoning Benchmark(ARB)に会いましょう:大規模な言語モデルを評価するための新しいベンチマーク」

自然言語処理は近年、特に洗練された言語モデルの作成によって大きく進化しています。翻訳や推論を含むほとんどの自然言語タスクで、GPT 3.5、GPT 4、BERT、PaLMなどの有名なモデルの性能が著しく向上しています。これらのAIの分野での進展を評価するために、いくつかのベンチマークが使用されています。ベンチマークは、言語モデルの能力をテストするために作成された標準化されたタスクの集合です。 最初のいくつかの言語理解ベンチマークであるGLUEとSuperGLUEベンチマークを考慮すると、BERTやGPT-2などのモデルはより難解でした。これらのベンチマークを超えるように言語モデルが進化しているため、モデルの開発とベンチマークの難易度の間で競争が発生しています。モデルを大きくし、大規模なデータセットでトレーニングすることが性能向上のカギです。LLM(言語モデル)は、知識と数量的推論の能力を測定するさまざまなベンチマークで優れたパフォーマンスを示していますが、これらのモデルが現在の基準で高得点を取ると、これらのベンチマークはモデルの能力を評価するためにはもはや有用ではないことが明らかです。 これらの制限に対処するため、研究者チームはARB(Advanced Reasoning Benchmark)という新しいユニークなベンチマークを提案しました。ARBは数学、物理学、生物学、化学、法律など、さまざまな主題領域でより難解な問題を伝えるために作成されています。ARBは、以前のベンチマークとは異なり、複雑な推論問題に焦点を当ててLLMのパフォーマンスを向上させることを目指しています。チームはまた、ARBの一部として、洗練された象徴的思考と深い専門知識を要する数学と物理学の問題のセットを導入しました。これらの問題は非常に困難であり、現在のLLMの範囲外です。 チームは、GPT-4やClaudeなどの新しいモデルをARBベンチマークで評価しました。これらのモデルは、ARBに含まれるより困難なタスクにおいて50%未満のスコアで対応することが困難であることを示す結果が示されています。チームはまた、評価プロセスを改善するための評価基準に基づいた評価アプローチを示しました。この戦略を使用することで、GPT-4はARBの問題を解決しようとする際に自身の中間推論プロセスを評価することができます。これにより、レビュープロセスの範囲が広がり、モデルの問題解決戦略が明らかになります。 ARBの象徴的なサブセットは人間のレビューも受けています。人間の注釈者は問題を解決し、独自の評価を提供するように求められました。人間の評価者とGPT-4の評価基準に基づいた評価スコアとの間には有望な一致があり、モデルの自己評価が人間の判断と合理的に一致していることを示しています。数百の専門的な推論を必要とする問題があり、これまでにLLMが通常苦労してきた量的分野で、新しいデータセットは以前のベンチマークを大幅に上回っています。 過去のベンチマークの多肢選択問題とは異なり、多くの問題は短答えや自由回答の形式で構成されており、LLMの評価がより困難になります。専門レベルの推論タスクと現実的な問題形式の組み合わせにより、モデルが複雑な現実世界の問題を処理する能力をより正確に評価することが可能になります。

メリーランド大学の新しいAI研究は、1日で単一のGPU上で言語モデルのトレーニングをするためのクラミングの課題を調査しています

自然言語処理の多くの領域では、言語解釈や自然言語合成を含む機械学習モデルの大規模トレーニングにおいて、トランスフォーマーのトポロジーを利用した画期的な進展が生まれています。これらのシステムの広く認識されている特性は、モデルのパラメータ数やデータのボリュームが増えるにつれて安定的にスケーリングするか、さらなる性能向上を続ける能力です。 ほとんどの研究は、極端な計算の限界を押し上げる新しい方法を見つけることに焦点を当てていますが、メリーランド大学の研究チームは、言語モデルのトレーニングを縮小する最善の方法とそのトレードオフについて調査しています。 研究者たちは、スケールの力が引き起こした非常に大きなモデルを構築する競争のために、言語モデルのトレーニングが可能であると考えています。初期のBERTモデルは、自然言語処理の多くの実世界アプリケーションで使用されています。ただし、このモデルをトレーニングするには、かなりの計算が必要でした。 比較的限られたリソースで、BERTと同等の性能を持つ言語モデルをトレーニングすることが可能であり、それにはいくつかの興味深い結果があります。その1つは、大規模モデルでは現在難しい追加の学術的な問い合わせを可能にし、スケールダウンしたモデルの事前トレーニングが大規模な計算の事前トレーニングの有望な相互対応関係であるかどうかを明確にすることです。研究者によると、公共のデータでトレーニングされた、出所の疑わしいモデルが受け入れられるかどうかは法的な問題があります。 メリーランド大学の研究者による新しい研究は、「Cramming」というチャレンジに取り組んでいます。つまり、試験の前日に言語モデル全体を学習することです。彼らの研究は、この制約のある状況でも、パフォーマンスが大規模な計算環境で見つかるスケーリングルールに密接に従うことを証明しています。この研究では、トレーニングパイプラインの変更がスケールダウンした状況でのパフォーマンス向上につながるかどうかを調査しています。 スケールダウンは困難です。モデルのサイズを小さくすることで、より高速な勾配計算が可能になりますが、時間の経過に伴うモデルの改善率はほぼ一定です。ただし、スケーリング法則を利用するトレーニングレシピの変更により、モデルのサイズを減少させることなく、勾配計算の効果的な速度を増加させることで、利益を生み出すことができます。最終的に、チームは予算の制約の中でモデルをトレーニングし、尊敬できるパフォーマンスを提供し、GLUEタスクでBERTに頻繁に迫り、時には超えることもありました。 チームは、トランスフォーマーベースの言語モデルが非常に限られた計算環境に収まる状況でのパフォーマンスを評価しています。彼らは、さまざまな変更要素がGLUEでの尊敬できる下流パフォーマンスをもたらすことを発見しました。チームは、この研究が「Cramming」の問題に関する調査の出発点となり、さまざまな改善策や戦略にさらなる洞察をもたらすことを期待しています。

新しいAI研究が、転移学習のためのマルチタスクプロンプトチューニング(MPT)を紹介します

事前学習済み言語モデル(PLMs)は、フィネチューニングにより多くの下位NLPタスクで大幅に改善されています。現在のPLMsは数億のパラメータを含むことができますが、タスクごとのフルフィネチューニング(FT)の従来のパラダイムは、多数のタスクに拡張することが困難です。包括的なフィネチューニングに必要なより少ないパラメータを学習する必要性から、「パラメータ効率」のモデルチューニングに関する研究が急増しています。 PLMsを使用したパラメータ効率の高い転移学習において、最近はプロンプトチューニング(PT)が潜在的なオプションとして登場しています。PTは、トレーニング前に入力に調整可能な連続プロンプトベクトルを追加することで機能します。PLMの設定は固定され、PTは各タスクに対して限られた数のプロンプトベクトルのみを学習します。しかし、その驚異的な性能にもかかわらず、瞬間的なチューニングと完全なフィネチューニングの間にはまだ大きな差があります。また、この方法は初期化に非常に敏感であり、通常のフィネチューニング手続きよりも長いトレーニング時間を必要とします。 最近の研究では、他のジョブからプロンプトベクトルを再利用することでこれらの問題を解決する方法が提案されています。これらの戦略は、さまざまなソースタスクでソフトプロンプトをトレーニングすることから始まります。次に、これらの事前学習されたプロンプトを、(おそらく学習された)類似性尺度を使用してターゲットタスクのプロンプトのファインチューニングの出発点として使用します。 オハイオ州立大学、MIT-IBMワトソンAI研究所、マサチューセッツ工科大学の研究者は、マルチタスクプロンプトチューニング(MPT)を導入することで、この研究の一環をさらに発展させています。MPTは、マルチタスクデータを利用して、効率的にターゲットアクティビティに伝達できる単一のプロンプトを学習します。 共有プロンプト空間を学習するアイデアは簡単ですが、実際には非常に難しいことがあります。これは、さまざまなソースタスク間の類似性を習得しながら、その干渉を同時に減らす必要があるためです。研究者は、単にすべてのタスクでプロンプト行列を共有するのではなく、各ソースタスクのソフトプロンプトを共有行列と低ランクタスク固有行列の積として分解する方が成功すると見つけました。分解は、一貫したプロンプトチューニングを通じて獲得したソフトプロンプトからの情報を蒸留することによって教えられます。彼らは共通プロンプト行列に対して低ランクの乗算修正を実行し、ジョブ間を切り替えます。 様々なタスクの23のNLPデータセットに対する包括的なテストでは、提案された手法が最新のプロンプト転送手法を上回ることが示されています。T5-Baseを使用したMPTは、最も競争力のあるマルチタスクプロンプト転送ベースラインに比べて、SuperGLUEベンチマークで16.3%の改善を達成しています。一部の性能指標では、MPTはフルフィネチューニングを上回りますが、ジョブごとにわずか0.035%の設定可能なパラメータのみを使用しています。また、ターゲットタスクごとに4-32のラベルがある場合、MPTは少量のデータでも非常に成功することがわかっています。

‘Perceiver IO どんなモダリティにも対応するスケーラブルな完全注意モデル’

TLDR 私たちはPerceiver IOをTransformersに追加しました。これは、テキスト、画像、音声、ビデオ、ポイントクラウドなど、あらゆる種類のモダリティ(それらの組み合わせも含む)に対応した最初のTransformerベースのニューラルネットワークです。以下のスペースをご覧いただくと、いくつかの例をご覧いただけます。 画像間のオプティカルフローの予測 画像の分類。 また、いくつかのノートブックも提供しています。 以下に、モデルの技術的な説明をご覧いただけます。 はじめに Transformerは、元々Vaswaniらによって2017年に紹介され、機械翻訳の最先端(SOTA)の結果を改善するというAIコミュニティでの革命を引き起こしました。2018年には、BERTがリリースされ、トランスフォーマーエンコーダ専用のモデルで、自然言語処理(NLP)のベンチマーク(特にGLUEベンチマーク)を圧倒的に上回りました。 その後まもなくして、AI研究者たちはBERTのアイデアを他の領域にも適用し始めました。以下にいくつかの例を挙げます。 Facebook AIのWav2Vec2は、このアーキテクチャをオーディオに拡張できることを示しました。 Google AIのVision Transformer(ViT)は、このアーキテクチャがビジョンに非常に適していることを示しました。 最近では、Google AIのVideo Vision Transformer(ViViT)もこのアーキテクチャをビデオに適用しました。 これらのすべての領域で、大規模な事前トレーニングとこの強力なアーキテクチャの組み合わせにより、最先端の結果が劇的に改善されました。 ただし、Transformerのアーキテクチャには重要な制約があります。自己注意機構により、計算およびメモリの両方でスケーリングが非常に悪くなります。各レイヤーでは、すべての入力をクエリとキーの生成に使用し、ペアごとのドット積を計算します。したがって、高次元データに自己注意を適用するには、ある形式の前処理が必要です。たとえば、Wav2Vec2では、生の波形を時間ベースの特徴のシーケンスに変換するために、特徴エンコーダを使用してこの問題を解決しています。Vision Transformer(ViT)は、画像を重ならないパッチのシーケンスに分割し、「トークン」として使用します。Video Vision Transformer(ViViT)は、ビデオから重ならない時空間の「チューブ」を抽出し、「トークン」として使用します。Transformerを特定のモダリティで動作させるためには、通常はトークンのシーケンスに離散化する必要があります。…

TransformersとRay Tuneを使用したハイパーパラメータの検索

Anyscale チームの Richard Liaw によるゲストブログ投稿 最先端の研究実装や数千ものトレーニング済みモデルへの簡単なアクセスが可能な Hugging Face transformers ライブラリは、自然言語処理の成功と成長において重要な存在となっています。 良いパフォーマンスを達成するために、ほとんどのユーザーはパラメータのチューニングを行う必要があります。しかし、ほとんどの人はハイパーパラメータのチューニングを無視するか、小さな探索空間で簡素なグリッドサーチを行うことを選択します。 しかし、簡単な実験でも高度なチューニング手法の利点を示すことができます。以下は、Hugging Face transformers の BERT モデルを RTE データセットで実行した最近の実験結果です。PBT のような遺伝的最適化手法は、標準的なハイパーパラメータ最適化手法と比較して大幅なパフォーマンス向上を提供できます。 アルゴリズム 最高の検証精度 最高のテスト精度 合計…

パートナーシップ:Amazon SageMakerとHugging Face

この笑顔をご覧ください! 本日、私たちはHugging FaceとAmazonの戦略的パートナーシップを発表しました。これにより、企業が最先端の機械学習モデルを活用し、最新の自然言語処理(NLP)機能をより迅速に提供できるようになります。 このパートナーシップを通じて、Hugging Faceはお客様にサービスを提供するためにAmazon Web Servicesを優先的なクラウドプロバイダーとして活用しています。 共通のお客様に利用していただくための第一歩として、Hugging FaceとAmazonは新しいHugging Face Deep Learning Containers(DLC)を導入し、Amazon SageMakerでHugging Face Transformerモデルのトレーニングをさらに簡単にする予定です。 Amazon SageMaker Python SDKを使用して新しいHugging Face DLCにアクセスし、使用する方法については、以下のガイドとリソースをご覧ください。 2021年7月8日、私たちはAmazon SageMakerの統合を拡張し、Transformerモデルの簡単なデプロイと推論を追加しました。Hugging…

インターネット上でのディープラーニング:言語モデルの共同トレーニング

Quentin LhoestさんとSylvain Lesageさんの追加の助けを得ています。 現代の言語モデルは、事前学習に多くの計算リソースを必要とするため、数十から数百のGPUやTPUへのアクセスなしでは入手することが不可能です。理論的には、複数の個人のリソースを組み合わせることが可能かもしれませんが、実際には、インターネット上の接続速度は高性能GPUスーパーコンピュータよりも遅いため、このような分散トレーニング手法は以前は限定的な成功しか収めていませんでした。 このブログ記事では、参加者のネットワークとハードウェアの制約に適応することができる新しい協力的な分散トレーニング方法であるDeDLOCについて説明します。私たちは、40人のボランティアを使ってベンガル語の言語モデルであるsahajBERTの事前学習を行うことで、実世界のシナリオでの成功を示します。ベンガル語の下流タスクでは、このモデルは数百の高級アクセラレータを使用したより大きなモデルとほぼ同等のクオリティを実現しています。 オープンコラボレーションにおける分散深層学習 なぜやるべきなのか? 現在、多くの高品質なNLPシステムは大規模な事前学習済みトランスフォーマーに基づいています。一般的に、その品質はサイズとともに向上します。パラメータ数をスケールアップし、未ラベルのテキストデータの豊富さを活用することで、自然言語理解や生成において類を見ない結果を実現することができます。 残念ながら、これらの事前学習済みモデルを使用するのは、便利なだけではありません。大規模なデータセットでのトランスフォーマーのトレーニングに必要なハードウェアリソースは、一般の個人やほとんどの商業または研究機関には手の届かないものです。例えば、BERTのトレーニングには約7000ドルかかると推定され、GPT-3のような最大のモデルでは、この数は1200万ドルにもなります!このリソースの制約は明らかで避けられないもののように思えますが、広範な機械学習コミュニティにおいて事前学習済みモデル以外の代替手段は本当に存在しないのでしょうか? ただし、この状況を打破する方法があるかもしれません。解決策を見つけるために、周りを見渡すだけで十分かもしれません。求めている計算リソースは既に存在している可能性があるかもしれません。たとえば、多くの人々は自宅にゲームやワークステーションのGPUを搭載したパワフルなコンピュータを持っています。おそらく、私たちがFolding@home、Rosetta@home、Leela Chess Zero、または異なるBOINCプロジェクトのように、ボランティアコンピューティングを活用することで、彼らのパワーを結集しようとしていることはお分かりいただけるかもしれませんが、このアプローチはさらに一般的です。たとえば、いくつかの研究所は、自身の小規模なクラスタを結集して利用することができますし、低コストのクラウドインスタンスを使用して実験に参加したい研究者もいるかもしれません。 疑い深い考え方をすると、ここで重要な要素が欠けているのではないかと思うかもしれません。分散深層学習においてデータ転送はしばしばボトルネックとなります。複数のワーカーから勾配を集約する必要があるためです。実際、インターネット上での分散トレーニングへの単純なアプローチは必ず失敗します。ほとんどの参加者はギガビットの接続を持っておらず、いつでもネットワークから切断される可能性があるためです。では、家庭用のデータプランで何かをトレーニングする方法はどうすればいいのでしょうか? 🙂 この問題の解決策として、私たちは新しいトレーニングアルゴリズム、Distributed Deep Learning in Open Collaborations(またはDeDLOC)を提案しています。このアルゴリズムの詳細については、最近公開されたプレプリントで詳しく説明しています。では、このアルゴリズムの中核となるアイデアについて見てみましょう! ボランティアと一緒にトレーニングする 最も頻繁に使用される形態の分散トレーニングにおいては、複数のGPUを使用したトレーニングは非常に簡単です。ディープラーニングを行う場合、通常はトレーニングデータのバッチ内の多くの例について損失関数の勾配を平均化します。データ並列の分散DLの場合、データを複数のワーカーに分割し、個別に勾配を計算し、ローカルのバッチが処理された後にそれらを平均化します。すべてのワーカーで平均勾配が計算されたら、モデルの重みをオプティマイザで調整し、モデルのトレーニングを続けます。以下に、実行されるさまざまなタスクのイラストを示します。 多くの場合、同期の量を減らし、学習プロセスを安定化させるために、ローカルのバッチを平均化する前にNバッチの勾配を蓄積することができます。これは実際のバッチサイズをN倍にすることと同等です。このアプローチは、最先端の言語モデルのほとんどが大規模なバッチを使用しているという観察と組み合わせることで、次のようなシンプルなアイデアに至りました。各オプティマイザステップの前に、すべてのボランティアのデバイスをまたいで非常に大規模なバッチを蓄積しましょう!この方法は、通常の分散トレーニングと完全に等価であり、簡単にスケーラビリティを実現するだけでなく、組み込みの耐障害性も持っています。以下に、それを説明する例を示します。 共同の実験中に遭遇する可能性のあるいくつかの故障ケースを考えてみましょう。今のところ、最も頻繁なシナリオは、1人または複数の参加者がトレーニング手続きから切断されることです。彼らは不安定な接続を持っているか、単に自分のGPUを他の用途に使用したいだけかもしれません。この場合、トレーニングにはわずかな遅れが生じますが、これらの参加者の貢献は現在蓄積されているバッチサイズから差し引かれます。しかし、他の参加者が彼らの勾配でそれを補ってくれるでしょう。また、さらに多くの参加者が加わる場合、目標のバッチサイズは単純により速く達成され、トレーニング手続きは自然にスピードアップします。これを以下のビデオでデモンストレーションしています。…

ハグフェイスでの夏

夏は公式に終わり、この数か月はHugging Faceでかなり忙しかったです。Hubの新機能や研究、オープンソースの開発など、私たちのチームはオープンで協力的な技術を通じてコミュニティを支援するために一生懸命取り組んできました。 このブログ投稿では、6月、7月、8月のHugging Faceで起こったすべてのことをお伝えします! この投稿では、私たちのチームが取り組んでいるさまざまな分野について取り上げていますので、最も興味のある部分にスキップすることを躊躇しないでください 🤗 新機能 コミュニティ オープンソース ソリューション 研究 新機能 ここ数か月で、Hubは10,000以上のパブリックモデルリポジトリから16,000以上のモデルに増えました!コミュニティの皆さんが世界と共有するために素晴らしいモデルをたくさん共有してくれたおかげです。そして、数字の背後には、あなたと共有するためのたくさんのクールな新機能があります! Spaces Beta ( hf.co/spaces ) Spacesは、ユーザープロファイルまたは組織hf.coプロファイルに直接機械学習デモアプリケーションをホストするためのシンプルで無料のソリューションです。GradioとStreamlitの2つの素晴らしいSDKをサポートしており、Pythonで簡単にクールなアプリを構築することができます。数分でアプリをデプロイしてコミュニティと共有することができます! 🚀 Spacesでは、シークレットの設定、カスタム要件の許可、さらにはGitHubリポジトリから直接管理することもできます。ベータ版にはhf.co/spacesでサインアップできます。以下はいくつかのお気に入りです! Chef Transformerの助けを借りてレシピを作成 HuBERTを使用して音声をテキストに変換…

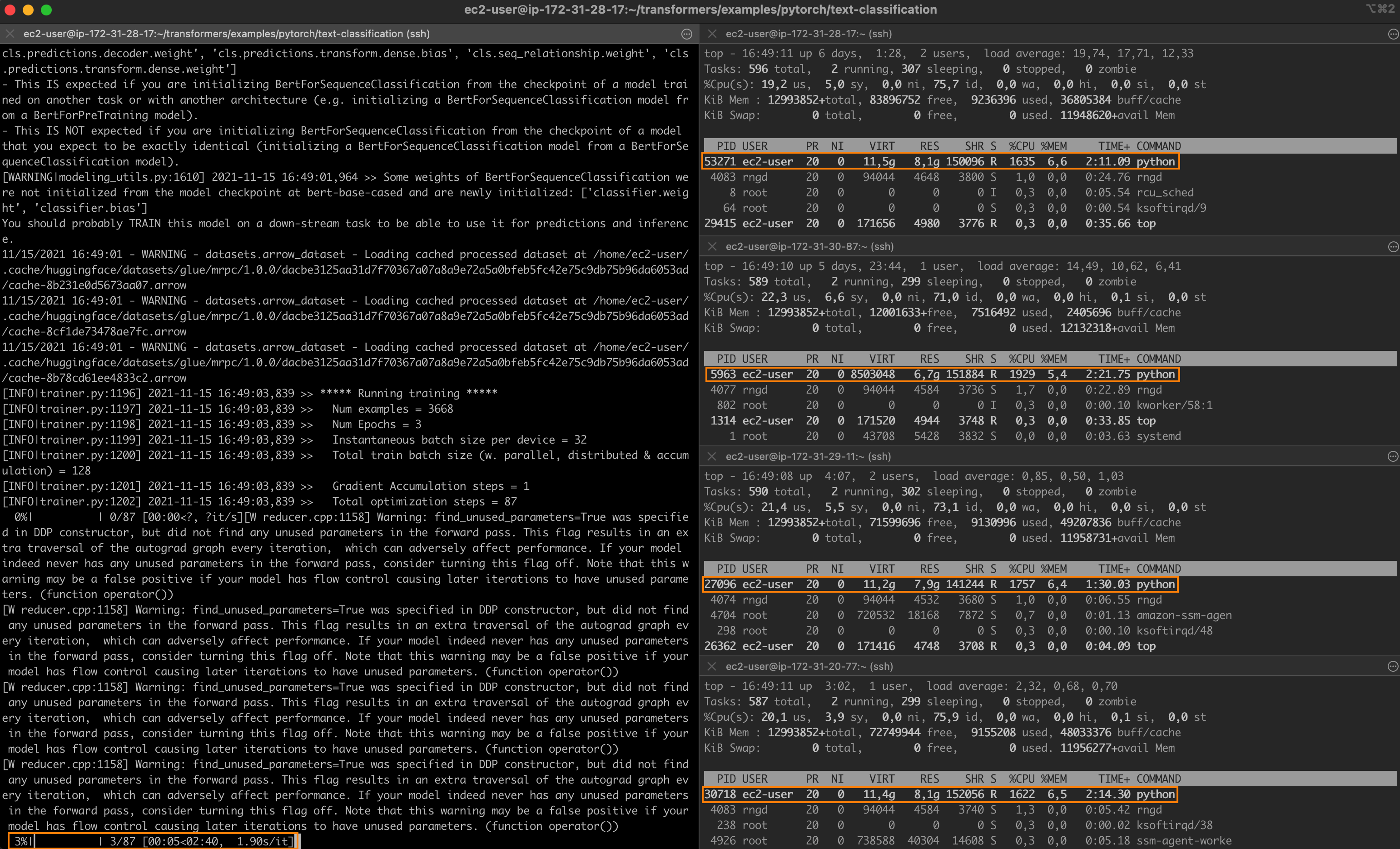

Intelのテクノロジーを使用して、PyTorchの分散ファインチューニングを高速化する

驚異的なパフォーマンスを持つ最先端のディープラーニングモデルでも、トレーニングには長い時間がかかることがよくあります。トレーニングジョブを高速化するために、エンジニアリングチームは分散トレーニングに頼っています。これは、クラスタ化されたサーバーがそれぞれモデルのコピーを保持し、トレーニングセットのサブセットでトレーニングを行い、結果を交換して最終的なモデルに収束するという分割統治技術です。 グラフィックプロセッシングユニット(GPU)は、ディープラーニングモデルのトレーニングにおいて長い間デファクトの選択肢でした。しかし、転移学習の台頭により、状況が変化しています。モデルは今や巨大なデータセットからゼロからトレーニングされることはほとんどありません。代わりに、特定の(より小さい)データセットで頻繁に微調整され、特定のタスクに対してベースモデルよりも精度の高い専用モデルが構築されます。これらのトレーニングジョブは短いため、CPUベースのクラスタを使用することは、トレーニング時間とコストの両方を管理するための興味深いオプションとなります。 この投稿の内容 この投稿では、インテル Xeon Scalable CPUサーバのクラスタ上でPyTorchのトレーニングジョブを分散して高速化する方法について説明します。Ice Lakeアーキテクチャを搭載し、パフォーマンス最適化されたソフトウェアライブラリを実行する仮想マシンを使用して、クラスタをゼロから構築します。クラウドまたはオンプレミスの環境で、簡単にデモを自身のインフラストラクチャに複製することができるはずです。 テキスト分類ジョブを実行し、MRPCデータセット(GLUEベンチマークに含まれるタスクの1つ)でBERTモデルを微調整します。MRPCデータセットには、ニュースソースから抽出された5,800の文のペアが含まれており、各ペアの2つの文が意味的に同等であるかどうかを示すラベルが付いています。このデータセットはトレーニング時間が合理的であり、他のGLUEタスクを試すのはパラメーターさえ変更すれば可能です。 クラスタが準備できたら、まずは単一のサーバーでベースラインのジョブを実行します。その後、2つのサーバーや4つのサーバーにスケールアップして、スピードアップを計測します。 途中で以下のトピックについて説明します: 必要なインフラストラクチャとソフトウェアのビルディングブロックのリストアップ クラスタのセットアップ 依存関係のインストール 単一ノードのジョブの実行 分散ジョブの実行 さあ、作業を始めましょう! インテルサーバの使用 最高のパフォーマンスを得るために、Ice Lakeアーキテクチャに基づいたインテルサーバを使用します。これには、Intel AVX-512やIntel Vector Neural Network…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.