Learn more about Search Results エージェント - Page 6

- You may be interested

- 「7/8から13/8までの週のトップ重要なコン...

- AIにおける複雑さと本質のトレードオフ:...

- 「無料のeBookでデータサイエンスのための...

- 「粒子群最適化:探索手順、ビジュアライズ」

- 「UMass Amherstのコンピュータ科学者がAI...

- 「リンカーン研究所の4つの技術が2023年の...

- 『Photoshopを越えて:Inst-Inpaintが拡散...

- サークルブームのレビュー:最高のAIパワ...

- 「ビジネスを拡大するための25のChatGPTプ...

- AIとハリウッドのストライキ – つな...

- 「VoAGI 30 for 30 Giveaway with O’Reill...

- ハイカーディナリティのカテゴリカル変数...

- 20/11〜26/11の間におけるコン...

- 「LLMアプリケーション開発のための実践的...

- 「AIによる完全自律戦争の未来がここにある」

自己対戦を通じて単純なゲームをマスターするエージェントのトレーニング

「完全情報ゲームで優れるために必要なすべてがゲームのルールにすべて見えるというのはすごいことですね残念ながら、私のような凡人には、ゲームのルールを読むことさえ…」

『チュートリアルを超えて LangChainのPandasエージェントでデータ分析を学ぶ』

「Pandasは、豊富なAPIと直感的なデータ構造により、データ処理と分析においてPythonのデファクトライブラリとなりましたしかし、まだ学習のハードルが高いです」

「RecMindと出会ってください:推薦タスクのための推論、行動、およびメモリを組み合わせた大規模言語モデル技術によって駆動される自律型の推薦エージェント」

人工知能とディープラーニングの人気が高まるにつれて、ほぼすべてのアプリケーションがAIの能力を利用して作業を進めています。DNN(深層ニューラルネットワーク)は、推薦システムの近代化に不可欠な存在となっています。推薦システムは、検索エンジン、ECサイト、ソーシャルメディアネットワーク、映画や音楽のストリーミングサービスなど、多くのオンラインプラットフォームで重要な役割を果たしています。その主な役割は、ユーザーが過去にプラットフォーム上でどのように製品を利用し、相互作用してきたかを調べ、その情報をもとに、ユーザーが将来的に相互作用する可能性のある製品を提案することです。これにより、ユーザーの関与と体験が向上します。 過去には、推薦システムはさまざまなアルゴリズムや手法を利用してきましたが、最近ではディープニューラルネットワーク(DNN)の導入により、その性能が大幅に向上しました。DNNは、人々や物事、連続的なユーザーの行動の複雑な表現やパターンを把握するのに優れています。この発展により、推薦はより正確で個別化されるようになりましたが、まだ特定の制限があります。特に、CNN(畳み込みニューラルネットワーク)、LSTM(長短期記憶)、BERTなど、DNNを利用して構築された既存の推薦システムの多くは、ユーザーやアイテムに関するテキストデータを効率的に取得するための支援が必要です。さらに、推薦タスクに特化したRS技術の多くは、他の未知の推薦タスクにうまく適用できない可能性があります。 これらの課題に対処するため、研究者チームが、大規模言語モデル技術に基づく自律推薦エージェント「RecMind」を紹介しました。このエージェントは、戦略的な計画、知識の取得のための外部ツール、個別化されたデータを活用して、正確なパーソナライズされた推薦を行うことに優れています。RecMindで導入された主要なイノベーションの1つは、自己インスパイアリングアルゴリズムです。このアルゴリズムは、LLMベースのエージェントの計画能力を向上させるために設計されています。LLMは、中間的な計画フェーズごとにこのアプローチを使用して次の計画手段を決定する際に、これまでに探索されたすべての状態を考慮に入れるため、自動的に「自己インスパイア」します。この方法により、モデルは推薦を形成する際に、過去の計画データを効率的に把握し利用する能力が大幅に向上します。LLMを利用した推薦システムの領域において、この自己インスパイアリング機能は重要な発展です。 RecMindの効果は、評価されたシナリオの範囲内で徹底的に評価されており、以下のようになります。 評価予測 – 特定のものを消費者がどのように評価するかを予測します。 順次推薦 – ユーザーの好みに基づいて特定の順序で商品を推薦します。 直接推薦 – ユーザーに直接アイテムを推薦します。 説明生成 – 特定の推薦の理由を説明します。 レビュー要約 – 特定の製品に関するユーザーコメントをまとめます。 評価結果によれば、チームは、RecMindがさまざまなタスクベースの推薦において、現在のゼロ・フューショットLLMベースの推薦技術を凌駕していることを共有しています。このモデルは、推薦タスクに特化した徹底的な事前トレーニング手順を必要とするモデル「P5」を凌駕しています。 以下に、主な貢献をまとめます。 この研究は、LLMを活用した自律推薦エージェントの開発を先駆けて行っています。RecMindは、推薦タスクに対して推論、行動、メモリを統合したエージェントフレームワークです。 複数の推論パスを統合することで、チェーンオブソウツやツリーオブソウツなどの人気のある手法を上回る、自己インスパイアリングの計画技術が提案されました。 RecMindの効果は、推薦シナリオの5つの場面で評価され、驚くべき結果を示しました。

「ChatGPTは本当に中立なのか?AIによる対話エージェントの政治的バイアスに関する実証的研究」

イギリスとブラジルの研究者による最近の調査は、OpenAIが開発した人気のあるAI言語モデルであるChatGPTの客観性に関する懸念を明らかにしました。研究者たちは、ChatGPTの応答には明らかな政治的なバイアスがあり、政治的スペクトルの左側に傾いていることを発見しました。彼らはこのバイアスが、従来のメディアに存在する既存のバイアスを持続させ、政策立案者、メディア機関、政治団体、教育機関などの様々な利害関係者に影響を与える可能性があると主張しています。 現在、ChatGPTは入力プロンプトに基づいて人間らしいテキストを生成するために使用される主要なAI言語モデルの一つです。さまざまなアプリケーションにおける多目的なツールとしての実績を示していますが、応答におけるバイアスの出現は重要な課題を提起しています。以前の研究ではAIモデルのバイアスに関する懸念が指摘され、公正でバランスの取れた出力を確保するためにこれらのバイアスを緩和することの重要性が強調されています。 ChatGPTの特定のバイアスに対応するため、イギリスとブラジルの研究者チームが、ChatGPTが政治的なコンパスの質問や、AIモデルが民主党員と共和党員の両方の人物像を演じるシナリオに対する応答を分析することを目的とした研究を発表しました。 研究者たちはChatGPTの政治的な傾向を測定するために経験的な手法を採用しました。彼らはアンケートを使用してAIモデルの政治的な問題や文脈に対するスタンスを評価しました。さらに、ChatGPTが平均的な民主党員と共和党員の人物像を演じる場面も調査しました。研究の結果は、バイアスが機械的な結果ではなく、AIモデルの出力に意図的な傾向があることを示唆しています。研究者たちは、トレーニングデータとアルゴリズムの両方を調査し、観察されたバイアスに両方の要素が寄与していると結論づけました。 研究の結果は、ChatGPTの応答におけるかなりのバイアスを示し、特に民主党寄りの視点を好む傾向があることを示しました。このバイアスは米国にとどまらず、ブラジルやイギリスの政治的文脈に関連する応答でも明らかになりました。この研究は、バイアスのあるAI生成コンテンツが様々な利害関係者に与える潜在的な影響を明らかにし、バイアスの源についてさらなる調査が必要であることを強調しています。 AIによるChatGPTなどのツールの影響力の増大を考えると、この研究は公正で偏りのないAI技術を確保するための警鐘となります。AIモデルのバイアスに対処することは、既存のバイアスを持続させずに客観性と中立性の原則を守るために重要です。AI技術がさまざまなセクターに進化し拡大するにつれて、開発者、研究者、利害関係者がバイアスを最小限に抑え、倫理的なAI開発を推進するために共同で取り組むことが不可欠となります。ChatGPT Enterpriseの導入は、AIツールが効率的だけでなく、バイアスのない信頼性のあるものであることを確保するための堅牢な手段の必要性をさらに強調しています。 論文をご覧ください。この研究に関するすべてのクレジットは、このプロジェクトの研究者に帰属します。また、最新のAI研究ニュース、クールなAIプロジェクトなどを共有している29k+ ML SubReddit、40k+ Facebook コミュニティ、Discord チャンネル、およびメールニュースレターにぜひ参加してください。 もし私たちの活動が好きなら、ニュースレターも気に入るでしょう。 この記事は、AI駆動型の会話エージェントにおける政治的バイアスに関する経験的な研究についてのものです。MarkTechPostに最初に掲載されました。

FuncReAct OpenAIの関数呼び出しを利用したReActエージェント

「もしまだプロンプティングが何かわからないのであれば、おそらくあなたは岩の下に住んでいるか、昏睡から目覚めたばかりですLLMsと生成AIに関連して、プロンプティングとは…」

DevOpsGPTとは、LLMとDevOpsツールを組み合わせたマルチエージェントシステムであり、自然言語の要件を動作するソフトウェアに変換するものです

DevOpsGPTは、大規模な言語モデル(LLM)とDevOpsツールを組み合わせて、ソフトウェア開発のためのAIによる自動化ソリューションを提供します。DevOpsGPTは、自然言語で表現された要件をこの画期的なアプローチを使用して機能的なソフトウェアに変換することができ、効率を向上させ、サイクル時間を短縮し、コミュニケーション費用を削減することができます。 DevOpsGPTの動作原理 DevOpsGPTは、自然言語で記述されたユーザーのニーズを処理し始めます。テキスト、音声、コードなど、さまざまな方法でこれらの仕様を入力することができます。DevOpsGPTは、仕様が受け入れられた後、LLMを活用して仕様に準拠したコードを生成します。その後、DevOpsの技術を使用して作成されたコードをエラーチェックし、ユーザーのニーズを満たすことを確認します。詳細については、GitHubページをご覧ください。 主な特徴 DevOpsGPTは、以下の利点だけでなく、次の特典と機能も提供します。 DevOpsGPTは、Python、Java、C++などの複数のプログラミング言語をサポートし、コードを生成することができます。 DevOpsGPTは柔軟性があり、いかなるビジネスの固有の要件に合わせることができます。 DevOpsGPTのスケーラビリティは、大規模な企業でソフトウェアの作成を自動化するために使用することができます。 DevOps-GPTの利点 DevOpsGPTは、要件収集、ドキュメンテーション、コード生成など、多くのソフトウェア開発プロセスを自動化する能力により、生産性を向上させます。これにより、開発の生産性が大幅に向上し、開発者がより創造的で戦略的な活動に取り組む時間を確保することができます。 開発を遅らせる原因となる手順の多くを自動化することで、DevOpsGPTは開発サイクルを短縮するのに役立ちます。その結果、新しいソフトウェアの機能や製品がより迅速に消費者に届くことが可能になります。 自然言語のニーズをコードに変換するプロセスを自動化するDevOpsGPTの能力により、コミュニケーション費用を削減することができます。その結果、開発プロセス中の混乱や誤解を避けることがより容易になります。 DevOpsGPTの自動コード検査機能は、ソフトウェアのデリバリープロセス全体の品質に貢献します。これにより、開発の早い段階で欠陥を見つけて修正することができ、より品質の高いソフトウェアを製造し、製品のリスクを低減することができます。 制限事項 DevOpsGPTには多くの利点がありますが、同時にいくつかの制約もあります。 DevOpsGPTは進行中のプロジェクトです。そのため、要件が進化するにつれて正確性が変わる可能性があります。 DevOpsGPTは、人間の開発者ほど創造的ではありません。したがって、新しい問題を解決するために助けが必要な場合があります。 DevOpsGPTは慎重に使用する必要があります。悪意のあるコードを作成するために悪用される可能性があります。 DevOpsGPTは、開発の生産性を向上させ、反復時間を短縮し、コミュニケーション費用を削減するのに役立つ最先端の新しいソリューションです。DevOpsGPTによって、プログラマーは繰り返しの操作を自動化することで、戦略的で創造的な活動により多くの時間を費やすことができます。これにより、ソフトウェアのデリバリーの品質が向上し、新しい機能や製品を市場に投入するまでの時間が短縮されます。

ChatGPTを超えて;AIエージェント:労働者の新たな世界

産業と私たちの日常的なやり取りを再定義しているAIエージェントの世界を探検してくださいAIワーカーの進化、Auto-GPTやBabyAGIの機能、そして興味深いWestworldシミュレーションまで、AIによる未来の可能性と課題に深く没頭してください

「Auto-GPT&GPT-Engineer:今日の主要なAIエージェントについての詳細ガイド」

「ChatGPTとAuto-GPT&GPT-Engineerなどの自律型AIエージェントの包括的な分析に没入してください機能、セットアップガイドを探索し、労働市場への影響を理解してください」

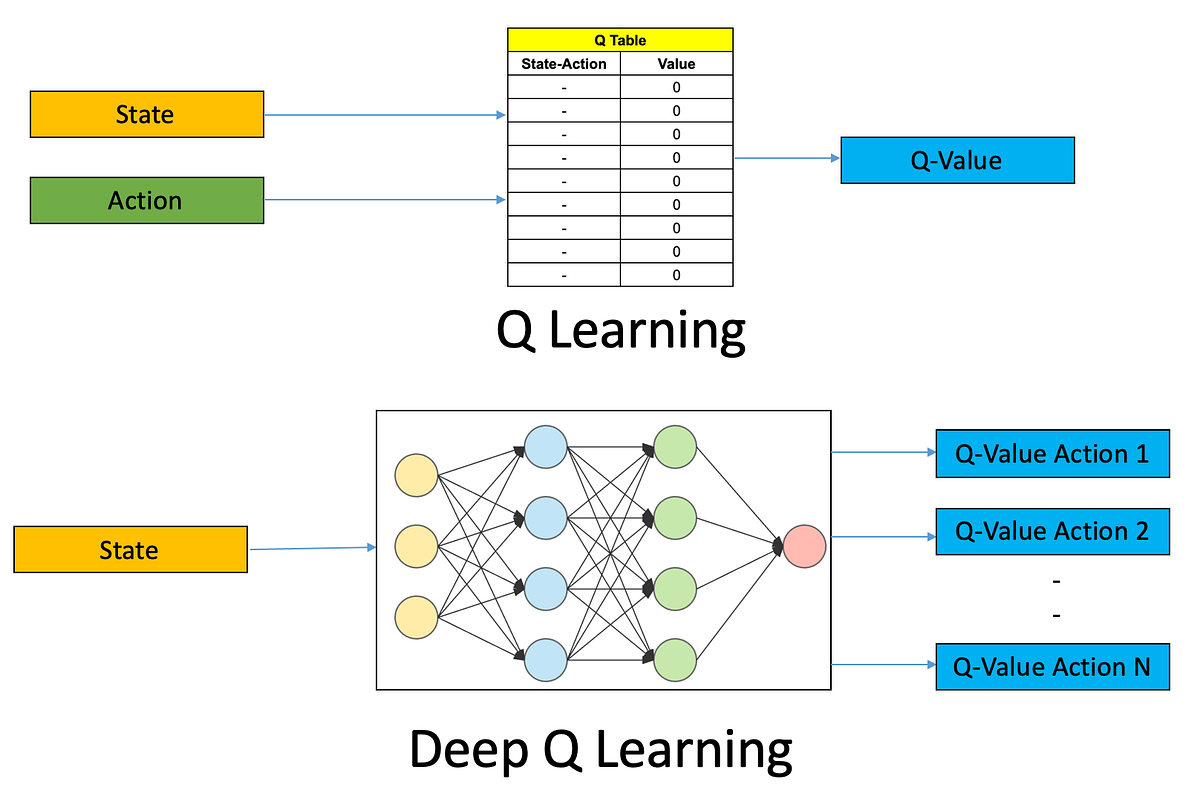

初めてのDeep Q学習ベースの強化学習エージェントをトレーニングする:ステップバイステップガイド

強化学習(RL)は、人工知能(AI)の魅力的な領域であり、機械が環境との相互作用を通じて学習し、意思決定を行うことができるようにしますRLエージェントを訓練する...

「このGSAi中国のAI論文は、LLMベースの自律エージェントの包括的な研究を提案しています」

自律エージェントは、さまざまな程度の独立性を示す自己操作システムを表します。最近の研究では、広範なトレーニングデータセットと多数のモデルパラメータの組み合わせによって、LLMが人間の知能を模倣する驚異的な能力を持っていることが強調されています。この研究論文では、LLMを利用した自律エージェントのアーキテクチャの側面、構築技術、評価方法、および関連する課題について包括的な研究を提供しています。 https://arxiv.org/abs/2308.11432v1 LLMは、人間の意思決定プロセスを再現し、人工知能システムを強化するための中核的なオーケストレータとして使用されています。上記の画像は、LLMを基盤とした自律エージェントの成長トレンドを示しています。3番目のポイント以降、X軸が年から月に切り替わることに注目すると興味深いです。これらのLLMベースのエージェントは、受動的な言語システムから積極的で目標志向の推論能力を持つエージェントへと進化していることがわかります。 LLMベースの自律エージェントの構築 人間のような能力を効果的に示すために、次の2つの重要な側面に注意する必要があります: アーキテクチャ設計:最適なアーキテクチャを選択することは、LLMの能力を最適に活用するために重要です。既存の研究は体系的に統合され、包括的かつ統一的なフレームワークの開発につながりました。 学習パラメータの最適化:アーキテクチャの性能を向上させるために、次の3つの広く採用されている戦略が登場しました: 例から学習:注意深く選ばれたデータセットを使用してモデルを微調整する方法です。 環境フィードバックから学習:リアルタイムの相互作用と観察を活用してモデルの能力を向上させる方法です。 人間のフィードバックから学習:モデルの応答を改善するために人間の専門知識と介入を活用する方法です。 LLMベースの自律エージェントの応用 さまざまな分野でのLLMベースの自律エージェントの応用は、問題解決、意思決定、およびイノベーションのアプローチに根本的な変化をもたらします。これらのエージェントは、言語理解、推論、適応性を持ち、優れた洞察力、サポート、および解決策を提供することにより、大きな影響を与えます。このセクションでは、LLMベースの自律エージェントが社会科学、自然科学、およびエンジニアリングの3つの異なる領域でどのように変革的な影響を与えているかについて詳しく説明します。 LLMベースの自律エージェントの評価 LLMベースの自律エージェントの効果を評価するために、主観的評価と客観的評価の2つの評価戦略が導入されました。 主観的評価:エージェントの知能やユーザビリティなどの潜在的な特性は、定量的なメトリックでは測定できません。したがって、主観的評価は現在の研究において不可欠です。 客観的評価:客観的評価を利用することには、人間の評価と比較して多くの利点があります。定量的なメトリックは、さまざまなアプローチの簡単な比較や時間の経過による進歩のモニタリングを容易にします。包括的な自動テストの実施の実現可能性により、わずかな数ではなく、多くのタスクの評価が可能となります。 最後に、これまでの研究は多くの有望な方向性を示してきましたが、この分野はまだ初期段階にあり、役割プレイ能力、一般化された人間の調整、プロンプトの堅牢性などのさまざまな課題が存在しています。結論として、この調査はLLMベースの自律エージェントに関するすべての知識を詳細に研究し、体系的なまとめを提供します。

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.