Learn more about Search Results ダウンロード - Page 67

- You may be interested

- 新技術における公共の利益の定義

- 「50以上の最新AIツール(2023年8月)」

- 「忙しい?これが拡散モデルのブラックボ...

- 「教室外での、オンライン試験による無指...

- 「エキサイティングなローンチ:無料のGen...

- 2023年の最高のAIテキスト生成ツール

- ピンクのローバーが赤い惑星に取り組む、...

- 「データ駆動の旅路の解読:Paisabazaarの...

- 「MicrosoftのAI研究者が誤って大量のデー...

- PyTorchを使用してx86 CPU上で推論速度を...

- 「学生向けの最高のAIツール(2023年9月)」

- どのようにして、どんなチームサイズにも...

- 「Google ResearchがMediaPipe FaceStyliz...

- 画像中のテーブルの行と列をトランスフォ...

- 内部の仕組みを明らかにする:BERTのアテ...

単一のGPUでChatgptのようなチャットボットをROCmで実行する

はじめに ChatGPTは、OpenAIの画期的な言語モデルであり、人工知能の領域で影響力のある存在となり、様々なセクターでAIアプリケーションの多様な活用を可能にしています。その驚異的な人間のようなテキストの理解力と生成力により、ChatGPTは顧客サポートから創造的な文章作成まで、さまざまな産業を変革し、貴重な研究ツールとしても使われています。 OPT、LLAMA、Alpaca、Vicunaなど、大規模な言語モデルのオープンソース化にはさまざまな取り組みが行われていますが、その中でもVicunaはAMD GPU上でROCmを使用してVicuna 13Bモデルを実行する方法を説明します。 Vicunaとは何ですか? Vicunaは、UCバークレー、CMU、スタンフォード、UCサンディエゴのチームによって開発された13兆パラメータを持つオープンソースのチャットボットです。Vicunaは、LLAMAベースモデルを使用して、ShareGPT.comからの約70,000件のユーザー共有会話を収集し、公開APIを介してファインチューニングしました。GPT-4を参照とした初期の評価では、Vicuna-13BはOpenAI ChatGPTと比較して90%以上の品質を実現しています。 それはわずか数週間前の4月11日にGithubでリリースされました。Vicunaのデータセット、トレーニングコード、評価メトリック、トレーニングコストはすべて公開されており、一般のユーザーにとって費用対効果の高いソリューションとなっています。 Vicunaの詳細については、https://vicuna.lmsys.org をご覧ください。 なぜ量子化されたGPTモデルが必要なのですか? Vicuna-13Bモデルをfp16で実行するには、約28GBのGPU RAMが必要です。メモリの使用量をさらに減らすためには、最適化技術が必要です。最近発表された研究論文「GPTQ」では、低ビット精度を持つGPTモデルの正確な事後トレーニング量子化が提案されています。以下の図に示すように、パラメータが10Bを超えるモデルの場合、4ビットまたは3ビットのGPTQはfp16と同等の精度を実現することができます。 さらに、これらのモデルの大きなパラメータは、GPTトークン生成が計算(TFLOPsまたはTOPs)そのものよりもメモリ帯域幅(GB/s)によって制約されるため、GPTのレイテンシに深刻な影響を与えます。そのため、メモリに制約のある状況下では、量子化モデルはトークン生成のレイテンシを低下させません。GPTQの量子化の論文とGitHubリポジトリを参照してください。 この技術を活用することで、Hugging Faceからいくつかの4ビット量子化されたVicunaモデルが利用可能です。 ROCmを使用してAMD GPUでVicuna 13Bモデルを実行する AMD GPUでVicuna 13Bモデルを実行するには、AMD GPUの高速化のためのオープンソースソフトウェアプラットフォームであるROCm(Radeon…

大規模なネアデデュープリケーション:BigCodeの背後に

対象読者 大規模な文書レベルの近似除去に興味があり、ハッシュ、グラフ、テキスト処理のいくつかの理解を持つ人々。 動機 モデルにデータを供給する前にデータをきちんと扱うことは重要です。古い格言にあるように、ゴミを入れればゴミが出てきます。データ品質があまり重要ではないという幻想を作り出す見出しをつかんでいるモデル(またはAPIと言うべきか)が増えるにつれて、それがますます難しくなっています。 BigScienceとBigCodeの両方で直面する問題の1つは、ベンチマークの汚染を含む重複です。多くの重複がある場合、モデルはトレーニングデータをそのまま出力する傾向があることが示されています[1](ただし、他のドメインではそれほど明確ではありません[2])。また、重複はモデルをプライバシー攻撃に対しても脆弱にする要因となります[1]。さらに、重複除去の典型的な利点には以下があります: 効率的なトレーニング:トレーニングステップを少なくして、同じかそれ以上のパフォーマンスを達成できます[3][4]。 データ漏洩とベンチマークの汚染を防ぐ:ゼロでない重複は評価を信用できなくし、改善という主張が偽りになる可能性があります。 アクセシビリティ:私たちのほとんどは、何千ギガバイトものテキストを繰り返しダウンロードまたは転送する余裕がありません。固定サイズのデータセットに対して、重複除去は研究、転送、共同作業を容易にします。 BigScienceからBigCodeへ 近似除去のクエストに参加した経緯、結果の進展、そして途中で得た教訓について最初に共有させてください。 すべてはBigScienceがすでに数ヶ月前に始まっていたLinkedIn上の会話から始まりました。Huu Nguyenは、私のGitHubの個人プロジェクトに気付き、BigScienceのための重複除去に取り組むことに興味があるかどうか私に声をかけました。もちろん、私の答えは「はい」となりましたが、データの膨大さから単独でどれだけの努力が必要になるかは全く無知でした。 それは楽しくも挑戦的な経験でした。その大規模なデータの研究経験はほとんどなく、みんながまだ信じていたにもかかわらず、何千ドルものクラウドコンピュート予算を任せられるという意味で挑戦的でした。はい、数回マシンをオフにしたかどうかを確認するために寝床から起きなければならなかったのです。その結果、試行錯誤を通じて仕事を学びましたが、それによってBigScienceがなければ絶対に得られなかった新しい視点が開かれました。 さらに、1年後、私は学んだことをBigCodeに戻して、さらに大きなデータセットで作業をしています。英語向けにトレーニングされたLLMに加えて、重複除去がコードモデルの改善につながることも確認しました[4]。さらに、はるかに小さなデータセットを使用しています。そして今、私は学んだことを、親愛なる読者の皆さんと共有し、重複除去の視点を通じてBigCodeの裏側で何が起こっているかを感じていただければと思います。 興味がある場合、BigScienceで始めた重複除去の比較の最新バージョンをここで紹介します: これはBigCodeのために作成したコードデータセット用のものです。データセット名が利用できない場合はモデル名が使用されます。 MinHash + LSHパラメータ( P , T , K…

Hugging FaceとIBMは、AIビルダー向けの次世代エンタープライズスタジオであるwatsonx.aiにおいてパートナーシップを結成しました

すべてのハイプを置いておくと、AIが社会とビジネスに与える深い影響を否定するのは難しいです。スタートアップから企業まで、公共部門まで、私たちが話すすべての顧客は、大規模な言語モデルと生成的AIを実験し、最も有望なユースケースを特定し、徐々に本番環境に導入することに忙しいと言っています。 顧客から最もよくいただくコメントは、1つのモデルがすべてを支配するわけではないということです。彼らは、各ユースケースに最適なモデルを構築し、企業データに最大の関連性を持たせながら、計算予算を最適化する価値を理解しています。もちろん、プライバシーと知的財産も最優先の関心事であり、顧客は完全な制御を確保したいと考えています。 AIがすべての部門やビジネスユニットに浸透するにつれて、顧客は多くの異なるモデルのトレーニングと展開の必要性も認識しています。大規模な多国籍組織では、いつでも何百、何千ものモデルを実行することがあります。AIの革新のペースに応じて、より新しいパフォーマンスの高いモデルアーキテクチャは、顧客が予想よりも早くモデルを置き換えることになります。そのため、新しいモデルを迅速かつシームレスに本番環境にトレーニングおよび展開する必要性が強まります。 これは、標準化と自動化のみで実現できます。組織は、新規プロジェクトのためにモデル、ツール、およびインフラをゼロから構築する余裕はありません。幸いなことに、ここ数年間ではいくつかの非常にポジティブな進展がありました: モデルの標準化:Transformerアーキテクチャは、自然言語処理、コンピュータビジョン、音声、音響などのDeep Learningアプリケーションにおいて事実上の標準となりました。今では、多くのユースケースで優れたパフォーマンスを発揮するツールやワークフローを構築することが容易になりました。 事前学習済みモデル:何十万もの事前学習済みモデルがすぐに利用可能です。Hugging Face上で直接発見し、テストでき、プロジェクトに向けてすぐに有望なモデルを選定することができます。 オープンソースライブラリ:Hugging Faceのライブラリを使用すると、1行のコードで事前学習済みモデルをダウンロードし、数分でデータを試すことができます。トレーニングから展開、ハードウェアの最適化まで、顧客はコミュニティ主導の一貫したツールセットに頼ることができます。これらのツールは、彼らのノートパソコンから本番環境まで、どこでも同じように動作します。 さらに、私たちのクラウドパートナーシップにより、顧客はHugging Faceのモデルとライブラリをインフラストラクチャのプロビジョニングや技術環境の構築に心配することなく、任意のスケールで使用することができます。これにより、高品質なモデルを迅速に提供することが容易になり、車輪の再発明をする必要がありません。 AWSとのAmazon SageMaker、およびMicrosoftとのAzure Machine Learningとのコラボレーションに続いて、私たちはIBMとも協力して、彼らの新しいAIスタジオ、watsonx.aiでの作業に興奮しています。watsonx.aiは、従来のMLと新しい生成的AIの能力の両方をトレーニング、検証、チューニング、および展開するための次世代のエンタープライズスタジオです。これらの能力は、ファウンデーションモデルによって強化されます。 IBMは、watsonx.aiのコアにオープンソースを採用することを決定しました。私たちも同じ意見です!watsonx.aiは、RedHat OpenShift上に構築され、クラウドとオンプレミスの両方で利用できます。これは、厳格なコンプライアンスルールによりクラウドを使用できない顧客や、機密データをインフラストラクチャ上で扱うことにより快適な顧客にとって、素晴らしいニュースです。これまで、これらの顧客はしばしば社内で独自のMLプラットフォームを構築する必要がありました。しかし、彼らは今や、標準のDevOpsツールを使用して展開および管理されるオープンソースの代替品を手に入れることができます。 watsonx.aiの内部では、transformers(10万以上のGitHubスター!)、accelerate、peft、およびText Generation Inferenceサーバーなど、Hugging Faceのオープンソースライブラリが多数統合されています。私たちはIBMと協力し、watsonx AIおよびデータプラットフォームに取り組んでいます。これにより、Hugging Faceの顧客は、Hugging…

Hugging Faceは、Microsoftとの協力により、Azure上でHugging Faceモデルカタログを開始します

本日、Hugging FaceはMicrosoftとの協力を拡大し、Hugging Face HubからオープンソースモデルをAzure Machine Learningにもたらすことを発表しました。私たちが共同で新しいHugging Face Hubモデルカタログを作成し、Azure Machine Learning Studio内で直接利用できるようにしました。このカタログには、Hugging Face Hubからの最も人気のあるTransformersモデルが数千点含まれています。この新しい統合により、数クリックでHugging Faceモデルを管理されたエンドポイントにデプロイし、安全かつスケーラブルなAzureインフラ上で実行することができます。 この新しいエクスペリエンスは、昨年Azure Marketplaceで新しい管理アプリとしてAzure Machine Learning Endpointsを立ち上げた際に発表した戦略的パートナーシップを拡大しています。以前のマーケットプレースのソリューションは有望な初期段階でしたが、Azure Machine Learning内でのネイティブな統合を通じてのみ克服できる制約がありました。これらの課題に対処し、お客様のエクスペリエンスを向上させるために、私たちはMicrosoftと協力して、Azure Machine Learning Studio内のHugging…

ファルコンはHugging Faceのエコシステムに着陸しました

イントロダクション ファルコンは、アブダビのテクノロジーイノベーション研究所が作成し、Apache 2.0ライセンスの下で公開された最新の言語モデルの新しいファミリーです。 特筆すべきは、Falcon-40Bが多くの現在のクローズドソースモデルと同等の機能を持つ、初めての「真にオープンな」モデルであることです 。これは、開発者、愛好家、産業界にとって素晴らしいニュースであり、多くのエキサイティングなユースケースの扉を開くものです。 このブログでは、ファルコンモデルについて詳しく調査し、まずそれらがどのようにユニークであるかを説明し、その後、Hugging Faceのエコシステムのツールを使ってそれらの上に構築することがどれほど簡単かを紹介します。 目次 ファルコンモデル デモ 推論 評価 PEFTによるファインチューニング 結論 ファルコンモデル ファルコンファミリーは、2つのベースモデルで構成されています:Falcon-40Bとその弟であるFalcon-7Bです。 40Bパラメータモデルは現在、Open LLM Leaderboardのトップを占めており、7Bモデルはそのクラスで最高のモデルです 。 Falcon-40BはGPUメモリを約90GB必要としますが、それでもLLaMA-65Bよりは少なく、Falconはそれを上回します。一方、Falcon-7Bは約15GBしか必要とせず、推論やファインチューニングは一般的なハードウェアでも利用可能です。 (このブログの後半では、より安価なGPUでもFalcon-40Bを利用できるように、量子化を活用する方法について説明します!) TIIはまた、モデルのInstructバージョンであるFalcon-7B-InstructとFalcon-40B-Instructを提供しています。これらの実験的なバリアントは、命令と会話データに適応された調整が行われているため、人気のあるアシスタントスタイルのタスクに適しています。 モデルを素早く試してみたい場合は、これらが最適な選択肢です。…

Hugging Face Hubへ、fastText をようこそお迎えください

fastTextは、テキストの表現と分類の効率的な学習のためのライブラリです。Meta AIによって2016年にオープンソース化され、fastTextは過去数十年間の自然言語処理と機械学習において影響力のあるキーワードを統合しています。具体的には、文を単語の袋とn-gramの袋を使用して表現し、サブワード情報を利用し、クラス間で情報を共有するための隠れた表現を使用します。 計算を高速化するために、fastTextはクラスの不均衡な分布を活用した階層的なソフトマックスを使用します。これらの技術により、ユーザーはテキストの表現と分類のためのスケーラブルなソリューションを提供します。 Hugging Faceは、現在、157か国のすべての言語と最新の言語識別モデルの公式ミラーをホストしています。これは、Hugging Faceを使用することで、数回のコマンドでモデルを簡単にダウンロードして使用できることを意味します。 モデルの検索 157か国の言語の単語ベクトルと言語識別モデルは、Meta AIのorgで見つけることができます。例えば、こちらで英語の単語ベクトルのモデルページを見つけることができます。また、こちらで言語識別モデルを見つけることができます。 ウィジェット この統合には、テキスト分類と特徴抽出のウィジェットのサポートが含まれています。こちらで言語識別ウィジェットを試してみることができます。また、こちらで特徴抽出ウィジェットを試してみることができます。 使用方法 以下は、事前学習済みのベクトルを読み込んで使用する方法です: >>> import fasttext >>> from huggingface_hub import hf_hub_download >>> model_path =…

ギャラリー、図書館、アーカイブ、博物館向けのHugging Face Hub

ギャラリー、図書館、アーカイブ、博物館のためのハギングフェイスハブ ハギングフェイスハブとは何ですか? Hugging Faceは、高品質な機械学習を誰にでもアクセス可能にすることを目指しています。この目標は、広く使われているTransformersライブラリなどのオープンソースのコードライブラリを開発すること、無料のコースを提供すること、そしてHugging Faceハブを提供することなど、さまざまな方法で追求されています。 Hugging Faceハブは、人々が機械学習モデル、データセット、デモを共有しアクセスできる中央リポジトリです。ハブには19万以上の機械学習モデル、3万3000以上のデータセット、10万以上の機械学習アプリケーションとデモがホストされています。これらのモデルは、事前学習済みの言語モデル、テキスト、画像、音声分類モデル、物体検出モデル、さまざまな生成モデルなど、さまざまなタスクをカバーしています。 ハブにホストされているモデル、データセット、デモは、さまざまなドメインと言語をカバーしており、ハブを通じて利用できる範囲を拡大するための定期的なコミュニティの取り組みが行われています。このブログ記事は、ギャラリー、図書館、アーカイブ、博物館(GLAM)セクターで働く人々がハギングフェイスハブをどのように利用して貢献できるかを理解することを目的としています。 記事全体を読むか、最も関連のあるセクションにジャンプすることができます! ハブが何か分からない場合は、「ハギングフェイスハブとは何ですか?」から始めてください。 ハブで機械学習モデルを見つける方法を知りたい場合は、「ハギングフェイスハブの使用方法:ハブで関連するモデルを見つける方法」から始めてください。 ハブでGLAMデータセットを共有する方法を知りたい場合は、「ウォークスルー:GLAMデータセットをハブに追加する方法」から始めてください。 いくつかの例を見たい場合は、「ハギングフェイスハブの使用例」をチェックしてください。 ハギングフェイスハブで何を見つけることができますか? モデル Hugging Faceハブは、さまざまなタスクとドメインをカバーする機械学習モデルへのアクセスを提供しています。多くの機械学習ライブラリがHugging Faceハブとの統合を持っており、これらのライブラリを介して直接モデルを使用したりハブに共有したりすることができます。 データセット Hugging Faceハブには3万以上のデータセットがあります。これらのデータセットには、テキスト、画像、音声、マルチモーダルなど、さまざまなドメインとモダリティがカバーされています。これらのデータセットは、機械学習モデルのトレーニングや評価に価値があります。 スペース Hugging Face…

Hugging Face SpacesでLivebookノートブックをアプリとしてデプロイする

エリクサーのコミュニティは、機械学習に向けて大きな進歩を遂げており、Hugging Faceはそれを実現するために重要な役割を果たしています。今日のエリクサーと機械学習で既に達成できることを示すために、私たちはLivebookを使用してWhisperベースのチャットアプリを構築し、それをHugging Face Spacesにデプロイしています。15分以内にすべて完了しますので、ぜひご覧ください: このチャットアプリでは、ユーザーはオーディオメッセージの送信のみでコミュニケーションを行い、Whisper機械学習モデルによって自動的にテキストに変換されます。 このアプリは、Livebookとエリクサーの機械学習エコシステムのいくつかの興味深い機能を紹介しています: Hugging Faceモデルとの統合 マルチプレイヤーの機械学習アプリ 並行して機械学習モデルを提供する(ボーナスポイント:モデルの提供をクラスタ上で簡単に分散させることもできます) Livebookがまだ知らない場合は、それはエリクサーでインタラクティブなコードノートブックを書くためのオープンソースツールであり、数値計算、データサイエンス、機械学習のエリクサーツールの成長するコレクションの一部です。 Hugging Faceとエリクサー エリクサーコミュニティは、機械学習の領域でHugging Faceプラットフォームとそのオープンソースプロジェクトを活用しています。以下にいくつかの例を示します。 Hugging Faceの事前学習済みニューラルネットワークモデルをエリクサーコミュニティにもたらした最初のポジティブな影響は、Bumblebeeライブラリでした。このライブラリはHugging Face Transformersからインスピレーションを受け、Hugging Face Hubを使用してモデルのパラメータをダウンロードしています。 もう1つの例は、tokenizersライブラリで、これはHugging Face Tokenizersのエリクサーバインディングです。…

iPhone、iPad、およびMacでのCore MLによる高速で安定した拡散

先週、WWDC’23(Apple Worldwide Developers Conference)が開催されました。キーノート中のVision Proの発表に焦点が当てられましたが、それだけではありません。毎年のように、WWDC週はAppleのオペレーティングシステムとフレームワークの新機能について深く掘り下げる200以上の技術セッションが詰まっています。今年は特に、圧縮と最適化のためのCore MLの変更に興奮しています。これらの変更により、Stable Diffusionなどのモデルの実行が高速化され、メモリ使用量も少なくなります!一例として、12月にiPhone 13で実行したテストと現在の6ビットパレット化を使用した速度の比較を考えてみましょう: 12月のiPhoneでのStable Diffusionと現在の6ビットパレット化 目次 新しいCore MLの最適化 量子化および最適化されたStable Diffusionモデルの使用 カスタムモデルの変換と最適化 6ビット未満の使用 結論 新しいCore MLの最適化 Core MLは、Appleのデバイス内で効率的に機械学習モデルを実行するための成熟したフレームワークであり、CPU、GPU、およびMLタスクに特化したニューラルエンジンなど、Appleデバイスのすべてのコンピューティングハードウェアを活用します。デバイス上での実行は、Stable Diffusionや大規模な言語モデルの人気によって引き起こされた非常に興味深い時期を迎えています。多くの人々がこれらのモデルをさまざまな理由でハードウェア上で実行したいと考えており、利便性やプライバシー、APIのコスト削減などがその理由です。自然に、多くの開発者がデバイス上でこれらのモデルを効率的に実行する方法を探求し、新しいアプリやユースケースを作成しています。この目標を達成するためのCore MLの改善は、コミュニティにとって大きなニュースです!…

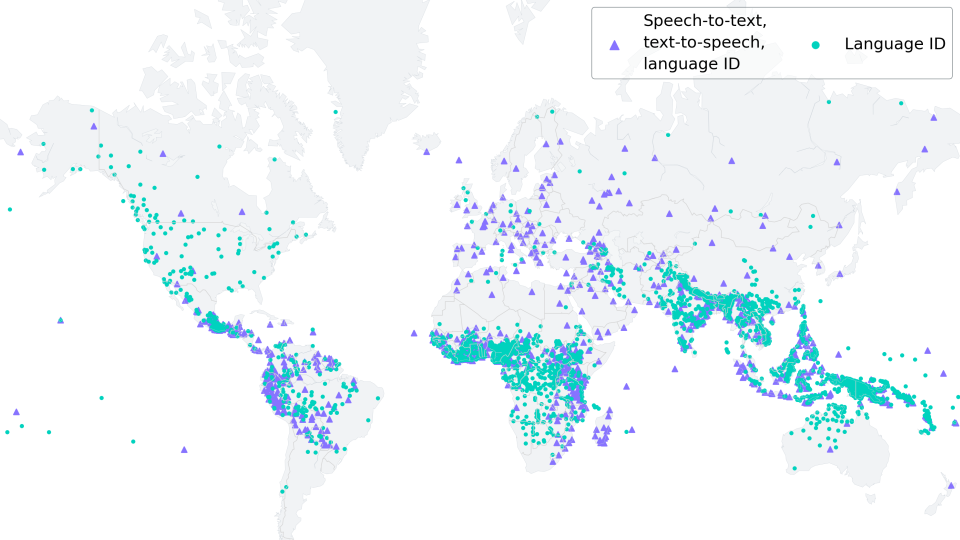

低リソースASRのためのMMSアダプターモデルの微調整

新しい(06/2023):このブログ記事は、「多言語ASRでのXLS-Rの微調整」に強く触発され、それの改良版として見なされるものです。 Wav2Vec2は、自動音声認識(ASR)のための事前学習モデルであり、Alexei Baevski、Michael Auli、およびAlex Conneauによって2020年9月にリリースされました。Wav2Vec2の強力なパフォーマンスが、ASRの最も人気のある英語データセットであるLibriSpeechで示された直後、Facebook AIはWav2Vec2の2つのマルチリンガルバージョンであるXLSRとXLM-Rを発表しました。これらのモデルは128の言語で音声を認識することができます。XLSRはクロスリンガル音声表現を意味し、モデルが複数の言語で有用な音声表現を学習する能力を指します。 Meta AIの最新リリースであるMassive Multilingual Speech(MMS)(Vineel Pratap、Andros Tjandra、Bowen Shiなどによる)は、マルチリンガル音声表現を新たなレベルに引き上げています。1,100以上の話されている言語が識別、転写、生成され、さまざまな言語識別、音声認識、テキスト読み上げのチェックポイントがリリースされます。 このブログ記事では、MMSのアダプタートレーニングが、わずか10〜20分の微調整後でも驚くほど低い単語エラーレートを達成する方法を示します。 低リソース言語の場合、私たちは「多言語ASRでのXLS-Rの微調整」と同様にモデル全体を微調整するのではなく、MMSのアダプタートレーニングの使用を強くお勧めします。 私たちの実験では、MMSのアダプタートレーニングはメモリ効率がよく、より堅牢であり、低リソース言語に対してはより優れたパフォーマンスを発揮することがわかりました。ただし、VoAGIから高リソース言語への場合は、Adapterレイヤーの代わりにモデル全体のチェックポイントを微調整する方が依然として有利です。 世界の言語多様性の保存 https://www.ethnologue.com/によると、約3000の「生きている」言語のうち、40%、つまり約1200の言語が、話者が減少しているために危機に瀕しています。このトレンドはますますグローバル化する世界で続くでしょう。 MMSは、アリ語やカイビ語など、絶滅危惧種である多くの言語を転写することができます。将来的には、MMSは、残された話者が母国語での記録作成やコミュニケーションをサポートすることで、言語を生き続けるために重要な役割を果たすことができます。 1000以上の異なる語彙に適応するために、MMSはアダプターを使用します。アダプターレイヤーは言語間の知識を活用し、モデルが別の言語を解読する際に役立つ役割を果たします。 MMSの微調整 MMSの非監視チェックポイントは、1400以上の言語で300万〜10億のパラメータを持つ、50万時間以上のオーディオで事前学習されました。 事前学習のためのモデルサイズ(300Mおよび1B)の事前学習のみのチェックポイントは、🤗 Hubで見つけることができます:…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.