Learn more about Search Results リポジトリ - Page 63

- You may be interested

- 8月14日から20日までのトップ記事:ChatGP...

- 「AI駆動の洞察:LangChainとPineconeを活...

- 「トップAIベースのアートインペインティ...

- テイクオーバー:AI共同パイロットがCスイ...

- Amazon ComprehendとLangChainを使用して...

- TRACE(トレース)に会おう:グローバル座...

- スタンフォード研究者がGLOWとIVESを使用...

- 「CMU研究者がニューラルネットワークの挙...

- リフレックスを使って、純粋なPythonでCha...

- 「Pythonクライアントを使用してMyScaleを...

- Google AIがSpectronを導入:スペクトログ...

- 「人工知能と画像生成の美学」

- スコア! チームNVIDIAが推薦システムでト...

- 「Microsoft AI Researchは、Pythonで直接...

- 「Microsoft Azureは、企業向けAIのための...

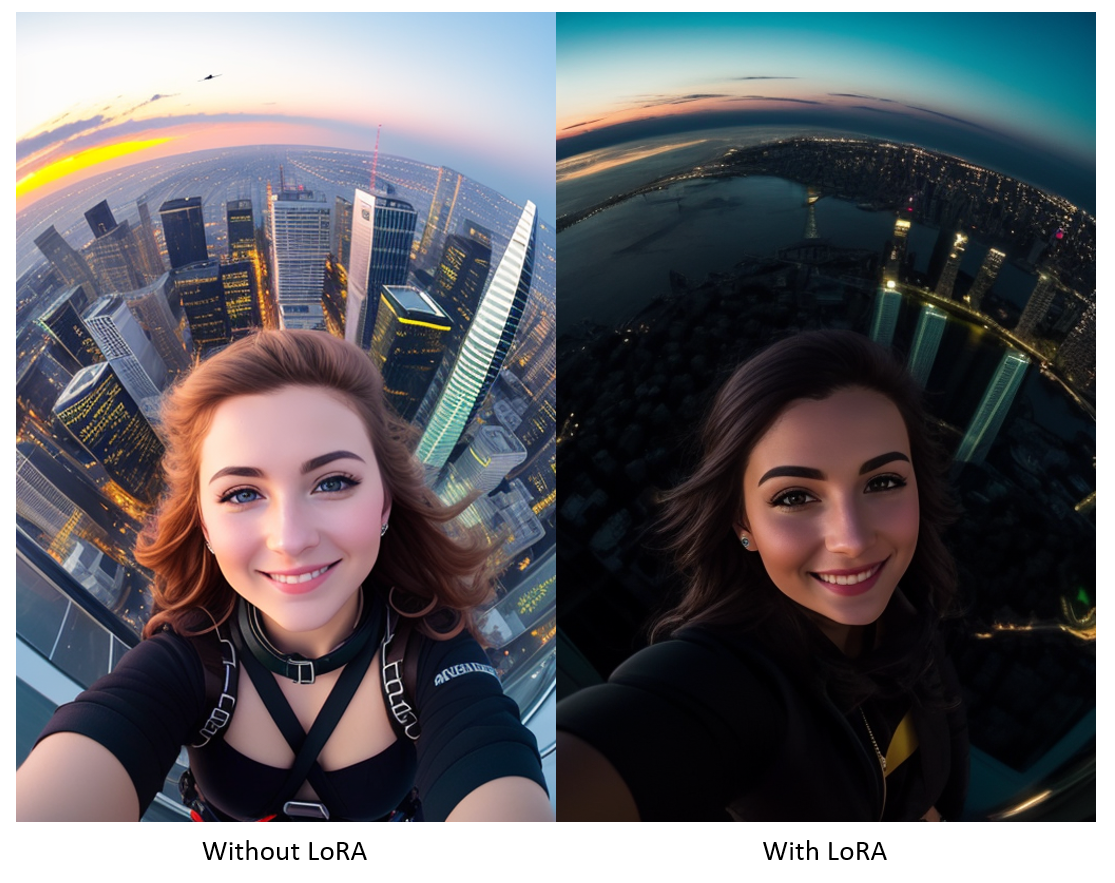

「Hugging Face Diffusersは、LoRAを正しくロードできるようになりました」

「Hugging FaceのDiffusersコードリポジトリから最新のコードを取得してみると、最新のコードの更新により、LoRAローディングに関連する部分が更新され、現在はMonkey-Patching LoRAローディングができるようになりましたLoRA...」

データサイエンス入門:初心者向けガイド

この記事は新しいデータサイエンティストのためのガイドであり、迅速に始めるのを助けるために設計されていますこれは出発点となるものですが、既に新しい仕事を探している場合は、この記事をもっと読むことをお勧めします

「LLMによる製品の発見:ハイブリッド検索を超えた進歩」

この急速に進化する最先端技術の時代において、世界は私たちの日常生活を革新する新しいアイデアを生み出すLLMの波に没入していますインターネットはさまざまな情報で溢れています...

「統計学習入門、Pythonエディション:無料の書籍」

「統計学習入門のPython版がついに登場しましたしかも無料で読むことができます!本書に関するすべての情報をご紹介します」

「LangChainを使用したLLMアプリケーションのためのプロンプトエンジニアリングのマスタリング」

イントロダクション デジタル時代において、言語ベースのアプリケーションは、チャットボットや仮想アシスタントなどのさまざまなツールの動力として私たちの生活で重要な役割を果たしています。LangChainは、最先端のLLMパワードアプリケーションの作成を革新したオープンソースのPythonフレームワークであり、LLMアプリケーションのプロンプトエンジニアリングをマスターするための学習ツールです。このガイドは、LangChainを使用して動的でコンテキストに対応した言語アプリケーションを作成するための知識とツールを読者に提供することを目的としています。プロンプトの管理、追加のLLMおよび外部データの活用、高度な言語アプリケーションのためのチェイニングのマスタリングなどについて探求します。開発者でもAI愛好家でも、このガイドはLangChainを使って言語の力を解き放ち、LLMアプリケーションのアイデアを現実にするのに役立ちます。 学習目標 LangChainおよびそのアプリケーションの基本を理解する。 LLMパワードアプリケーションを向上させるための効果的なプロンプトエンジニアリング技術を学ぶ。 インテリジェントでコンテキストに対応した言語アプリケーションを作成するためのチェイニングの技術を修得する。 ガイド全体で得た知識を応用して、LangChainを使用して実世界の言語アプリケーションを作成する。 プロンプトエンジニアリングおよびLLMアプリケーションの最新の進歩と開発について常に最新情報を得る。 この記事は、データサイエンスブログマラソンの一環として公開されました。 大規模言語モデル(LLM)とは何ですか? 大規模言語モデルは、膨大な量のデータで訓練された深層学習アーキテクチャに基づく堅牢なAIシステムです。これらのモデルは、複雑な言語パターン、ニュアンス、および文脈を理解することができ、言語翻訳、テキスト生成、要約などの分野で優れた性能を発揮します。代表的なLLMの例としては、OpenAIのGPT(Generative Pre-trained Transformer)モデルがあります。 LangChainとは何ですか? LangChainは包括的なオープンソースプラットフォームであり、大規模言語モデル(LLM)によるアプリケーションの構築を簡素化するためのツール、コンポーネント、およびインターフェースを提供しています。このプラットフォームの主な目標は、開発者がゼロから始めることなく言語処理能力をアプリケーションにシームレスに統合できるようにすることです。LangChainは、LLMとの対話を管理し、さまざまなコンポーネントをシームレスにリンクし、APIやデータベースなどのリソースを組み込むためのユーザーフレンドリーで効率的なアプローチを提供します。 LangChainの応用 LangChainは、大規模言語モデル(LLM)によってパワードされるアプリケーションの開発を容易にするために設計されたオープンソースのフレームワークであり、自然言語処理(NLP)など、さまざまな領域で多くの応用可能性を提供します。以下に、LangChainの重要な応用例をいくつか示します。 チャットボットと仮想アシスタント:LangChainを使用することで、開発者はユーザーとの自然言語対話を行うインテリジェントなチャットボットや仮想アシスタントを作成することができます。これらのチャットボットは、さまざまなタスクをサポートし、質問に回答したり、カスタマーサポートを提供したり、個別の推奨事項を提供したりすることができます。 言語翻訳ユーティリティ:LangChainを使用することで、開発者は異なる言語間での円滑なコミュニケーションを可能にする言語翻訳ツールを構築することができます。ユーザーは一つの言語でテキストを入力し、アプリケーションは希望する目標言語で正確な翻訳を生成することができます。 感情分析ツール:LangChainを使用して、テキストで表現される感情や意見を評価する感情分析アプリケーションを開発することができます。企業はこのようなツールを利用して顧客のフィードバックを理解し、ソーシャルメディアの感情を分析し、ブランドの評判を監視することができます。 テキスト要約:開発者はLangChainを活用して、長いテキストの簡潔な要約を自動的に生成するテキスト要約アプリケーションを作成することができます。これらの要約ツールは、大量のテキストから重要な情報を素早く抽出するために役立ちます。 コンテンツ生成:LangChainを使用することで、指定されたプロンプトに基づいて創造的で一貫性のあるテキストを生成するコンテンツ生成アプリケーションを開発することができます。これはコンテンツマーケティング、クリエイティブライティング、パーソナライズドメッセージの生成などに役立ちます。 LangChainとOpenAIのPythonでのセットアップ pipを使用してインストール…

Macでの安定したDiffusion XLと高度なCore ML量子化

Stable Diffusion XLは昨日リリースされ、素晴らしいです。大きな(1024×1024)高品質の画像を生成することができます。新しいトリックにより、プロンプトへの適合性が向上しました。最新のノイズスケジューラの研究により、非常に暗いまたは非常に明るい画像を簡単に生成することができます。さらに、オープンソースです! 一方、モデルはより大きくなり、したがって一般的なハードウェアでの実行が遅くなり、困難になりました。Hugging Faceのdiffusersライブラリの最新リリースを使用すると、16 GBのGPU RAMでCUDAハードウェア上でStable Diffusion XLを実行できるため、Colabの無料層で使用することができます。 過去数か月間、人々がさまざまな理由でローカルでMLモデルを実行することに非常に興味を持っていることが明確になってきました。これにはプライバシー、利便性、簡単な実験、または利用料金がかからないことなどが含まれます。AppleとHugging Faceの両方でこの領域を探索するために、私たちは一生懸命取り組んできました。私たちはApple SiliconでStable Diffusionを実行する方法を示したり、Core MLの最新の進化を利用してサイズとパフォーマンスを改善するための6ビットのパレット化を紹介したりしました。 Stable Diffusion XLでは、次のようなことを行いました: ベースモデルをCore MLにポートし、ネイティブのSwiftアプリで使用できるようにしました。 Appleの変換および推論リポジトリを更新し、興味のあるファインチューニングを含むモデルを自分で変換できるようにしました。 Hugging Faceのデモアプリを更新し、Hubからダウンロードした新しいCore ML Stable…

「LangChainとOpenAI APIを使用した生成型AIアプリケーションの構築」

イントロダクション 生成AIは、現在の技術の最先端をリードしています。画像生成、テキスト生成、要約、質疑応答ボットなど、生成AIアプリケーションが急速に拡大しています。OpenAIが最近大規模な言語モデルの波を牽引したことで、多くのスタートアップがLLMを使用した革新的なアプリケーションの開発を可能にするツールやフレームワークを開発しました。そのようなツールの一つがLangChainです。LangChainは、LLMによるアプリケーションの構築を可能にする柔軟性と信頼性を備えたフレームワークです。LangChainは、世界中のAI開発者が生成AIアプリケーションを構築するための定番ツールとなっています。LangChainは、外部データソースと市場で利用可能な多くのLLMとの統合も可能にします。また、LLMを利用したアプリケーションは、後で取得するデータを格納するためのベクトルストレージデータベースが必要です。この記事では、OpenAI APIとChromaDBを使用してアプリケーションパイプラインを構築することで、LangChainとその機能について学びます。 学習目標: LangChainの基礎を学んで生成AIパイプラインを構築する方法を学ぶ オープンソースモデルやChromadbなどのベクトルストレージデータベースを使用したテキスト埋め込み LangChainを使用してOpenAI APIを統合し、LLMをアプリケーションに組み込む方法を学ぶ この記事は、データサイエンスブログマラソンの一環として公開されました。 LangChainの概要 LangChainは、最近大規模言語モデルアプリケーションのための人気のあるフレームワークになりました。LangChainは、LLM、外部データソース、プロンプト、およびユーザーインターフェースとの対話を提供する洗練されたフレームワークを提供しています。 LangChainの価値提案 LangChainの主な価値提案は次のとおりです: コンポーネント:これらは言語モデルで作業するために必要な抽象化です。コンポーネントはモジュール化されており、多くのLLMの使用例に簡単に適用できます。 既製のチェーン:特定のタスク(要約、Q&Aなど)を達成するためのさまざまなコンポーネントとモジュールの構造化された組み立てです。 プロジェクトの詳細 LangChainはオープンソースプロジェクトであり、ローンチ以来、54K+のGithubスターを集めています。これは、プロジェクトの人気と受け入れられ方を示しています。 プロジェクトのreadmeファイルでは、次のようにフレームワークを説明しています: 大規模言語モデル(LLM)は、以前は開発者ができなかったアプリケーションを作成するための変革的な技術として現れつつあります。ただし、これらのLLMを単独で使用するだけでは、本当に強力なアプリを作成するには不十分なことがしばしばあります。真のパワーは、他の計算ソースや知識と組み合わせるときに発揮されます。 出典:プロジェクトリポジトリ 明らかに、フレームワークの目的を定義し、ユーザーの知識を活用したアプリケーションの開発を支援することを目指しています。 LangChainコンポーネント(出典:ByteByteGo) LangChainには、LLMアプリケーションを構築するための6つの主要なコンポーネントがあります:モデルI/O、データ接続、チェーン、メモリ、エージェント、およびコールバック。このフレームワークは、OpenAI、Huggingface Transformers、Pineconeやchromadbなどのベクトルストアなど、多くのツールとの統合も可能にします。…

USCの研究者は、新しい共有知識生涯学習(SKILL)チャレンジを提案しましたこのチャレンジでは、分散型のLLエージェントの集団が展開され、各エージェントが個別に異なるタスクを順次学習し、全てのエージェントが独立かつ並行して動作します

研究者による画期的な取り組みにより、共有知識生涯学習(SKILL)の開発を通じて機械学習の新時代が到来しました。最近発表された「Transactions on Machine Learning Research」誌の論文で、研究者はこの革新的なアプローチがAIエージェントが複数のタスクから知識を継続的に学習し保持することを可能にする方法を示し、人工知能の変革的な進歩を提供しています。 従来の機械学習は、タスク学習の連続プロセスを伴い、遅くて時間のかかる結果になることが多かったです。しかし、SKILLは並列学習アルゴリズムを用いることにより、革新的な概念を導入しています。このアプローチでは、102のAIエージェントのそれぞれに特定のタスクが割り当てられます。それぞれが専門分野での専門知識を習得した後、彼らは他のエージェントと知識を共有し、効率的なコミュニケーションと知識の統合を通じて全体の学習時間を大幅に短縮します。 研究者たちは、SKILLが生涯学習の将来の進歩に非常に有望であると考えています。彼らの研究には多くの自然なタスクが含まれており、顕著なスケーラビリティのポテンシャルが示されています。彼らは、SKILLがまもなく何千、あるいは何百万ものタスクを包括することができ、日常生活を変革する可能性があると想像しています。 例えば、異なるAIシステムが医療分野の異なる疾患、治療、患者ケア技術、最新の研究などについて学習することができます。その知識を統合した後、これらのAIエージェントは医学のあらゆる領域で最新かつ最も正確な情報を提供し、医師に包括的な医療助手として役立ちます。SKILLの統合により、医療は前例のない高みに到達し、医療専門家に比類ないサポートと専門知識を提供することができるでしょう。 医学に限らず、SKILLの潜在的な応用範囲はさまざまな領域に及びます。新しい街を訪れる際、すべてのスマートフォンユーザーが現地の観光ガイドとして活躍する未来を想像してみてください。カメラとランドマーク、店舗、製品、地元の料理に関する豊富な情報を備えた状態で、各ユーザーは広範な知識のリポジトリに貢献します。このデータがSKILLネットワーク全体で共有されると、すべてのユーザーは先進的なデジタルツアーガイドを手のひらで利用できるようになります。 SKILLの能力は、単なる認識に基づくタスクを超えます。現実世界の問題の複雑さが増すにつれて、解決策には多様な分野の専門知識が必要とされることがよくあります。SKILLは、AIエージェントが協力し、独自の洞察力と知識を結集して多様な課題に取り組むことを可能にします。 SKILLのコンセプトはクラウドソーシングに似ており、集合的な取り組みが個々の能力を超えた解決策を生み出します。オンラインのレビューが多くの人々の知識を集約して有益な情報を提供するように、SKILLはAIエージェントが情報を共有し、より包括的かつ正確な結論に至ることを可能にします。 このAIの革新的なブレイクスルーは、機械の持続的な学習と適応の追求において重要な一歩です。共有知識を受け入れることにより、AIエージェントは限られた専門知識の壁に閉じ込められることなく、自らのタスクの枠組みを超えることができるのです。要するに、研究者たちは、AIエージェントが連携ネットワークとして働き、人類につながりのある、知識豊富な、効率的なグローバルコミュニティを提供する未来を育んでいます。機械の集合知が進歩とイノベーションを牽引する世界です。 研究が進むにつれて、調和して連携する相互接続されたAIエージェントの世界のビジョンはますます具体的になってきます。潜在的な利益は広範囲にわたり、多くの分野に触れ、技術とのインタラクションの方法を革新しています。SKILLを触媒として、AIは知識に制約がなくなり、協力がスマートかつ効率的な世界の基盤となる未来へと私たちを推進する準備が整っています。

マイクロソフトが「TypeChat」をリリース:型を使用して自然言語インターフェースを簡単に構築できるAIライブラリ

MicrosoftのTypeChatライブラリは、大規模な言語モデル(LLM)に基づいたタイプベースの自然言語インターフェースの作成を容易にする試みです。TypeChatは、TypeScriptと生成AIを通じてAPI、アプリケーションスキーマ、自然言語のギャップを埋めることを目指すGitHubプロジェクトです。TypeChatは、アプリケーションの型定義を使用して型安全な構造化AI応答を取得します。Microsoftの技術フェローであり、C#とTypeScriptのリードデベロッパーであるAnders Hejlsbergは、7月20日にTypeChatを紹介しました。これは、複雑な決定木を用いてユーザーの意図を推測し、必要なデータを収集してアクションを起こすアプリに対して自然言語インターフェースを作成するという課題に取り組むためのものです。 TypeChatは、型を使用してNLUの作成プロセスを簡略化するライブラリです。最近まで、自然言語とのインターフェースを持つアプリを開発することは困難でした。これらのアプリは、ユーザーの意図を推測し、さらなる処理のために関連するデータを収集するために、詳細な決定木を頻繁に使用していました。大規模な言語モデル(LLM)のおかげで、ユーザーの自然言語の入力を受け取り、その意図に一致させることははるかに簡単になりました。これにより、モデルの応答の妥当性を保証し、モデルの出力に必要な安全性制約を課すという新たな困難が生じました。ただし、プロンプトエンジニアリングの学習曲線は厳しく、目標はこれらの問題を修正することであっても、その成長とともにプロンプトの脆弱性も増していきます。 TypeChatの開発者は、この製品がスキーマエンジニアリングによってプロンプトエンジニアリングを効果的に代替できる可能性があると主張しています。自然言語アプリで使用できる意図は、開発者によって型として定義できます。これは、感情をラベル付けするシステムからデジタル音楽ストアのカテゴリセットまで、非常に基本的なものから洗練されたものまでです。 TypeChatは、開発者が定義した型を使用してLLMのプロンプトを構築し、そのプロンプトがスキーマに従っているかどうかを確認します。検証に失敗した場合は、言語モデルを再び対話して出力を修正し、それに従うようにします。TypeChatはまた、状況を要約し、それがユーザーの期待に一致しているかを確認します。 TypeChatの開発者は、最近のLLMに関する「興奮のラッシュ」について、多くの質問が出されていると述べています。これらのモデルの最も明らかなユースケースはチャットボットでした。ただし、従来のUIを自然言語インターフェースで補完したり、ユーザーのリクエストをアプリが処理できる形式に変換するためにAIを使用したりするなど、これらのモデルを既存のアプリインターフェースに組み込む方法についての質問が提起されています。TypeChatの目的は、これらの問題に対処することです。 この取り組みにおいて、あなたの意見とアイデアは非常に貴重です。寄付のほとんどにはContributor License Agreement(CLA)にサインする必要があり、貢献者が貢献を利用する権限を持っていることを明示します。詳細については、https://cla.opensource.microsoft.com/をご覧ください。 CLAが必要な場合、CLAボットは自動的にプルリクエストのスタイリング(ステータス、備考など)を更新してこれを反映します。ロボットが指示する通りに行ってください。CLAを使用する場合は、すべてのリポジトリに対して一度だけ行う必要があります。

「Amazon SageMaker StudioでAmazon SageMaker JumpStartを使用して安定したDiffusion XLを利用する」

「今日、私たちはお知らせすることを喜んでいますStable Diffusion XL 1.0(SDXL 1.0)がAmazon SageMaker JumpStartを通じて顧客に利用可能ですSDXL 1.0は、Stability AIからの最新の画像生成モデルですSDXL 1.0の改良点には、さまざまなアスペクト比でのネイティブな1024ピクセルの画像生成が含まれていますプロフェッショナルな使用を目的としており、高解像度に合わせてキャリブレーションされています...」

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.