Learn more about Search Results Discord - Page 4

- You may be interested

- 「2024年のデータサイエンティストにとっ...

- Python Enumerate():カウンターを使用...

- 潜在一貫性LoRAsによる4つのステップでのSDXL

- 「Googleとトロント大学の研究者が、ライ...

- クラウド移行のマスタリング:成功させる...

- 「2030年までに注目すべき7つの先駆的なAI...

- 「Pythonを学ぶための5つの無料大学講座」

- 投影ヘッドを使用した自己監督学習

- 「最初の原則から旅行セールスマン問題を...

- DeepMindのAIマスターゲーマー:2時間で26...

- このAIニュースレターは、あなたが必要な...

- AlluxioがAI最適化されたデータプラットフ...

- Hugging FaceとAMDは、CPUおよびGPUプラッ...

- Python におけるカテゴリカル変数の扱い方...

- ハギングフェイスにおけるコンピュータビ...

このAIニュースレターはあなたが必要なものです #68

今週は、マルチモーダルの能力を持つ GPT-4 に対抗する候補として、新しいオープンソースのマルチモーダルモデルである LLaVA v1.5 の登場を目撃しましたそれはシンプルな...

中途の旅行 vs 安定した拡散:AI画像生成器の戦い

「Midjourney vs Stable Diffusion、あなたにとって最適なのはどちら?両方のAI画像生成機の強みと弱みを探ってみましょう」

ミッドジャーニーV5:ミッドジャーニーの最新バージョン

最新のMidjourneyのインカネーションであるV5は、このアート生成人工知能の進化におけるマイルストーンを示しています

このAIニュースレターは、あなたが必要とするすべてです #66

AIの今週のトピックスでは、OpenAIが再び注目を浴びましたChatGPTに新たな音声と画像の機能を追加する計画が発表されたからですまた、LLMレースも熱を帯び続けており、Amazon...

「ゼロからLLMを構築する方法」

「これは、大規模言語モデル(LLM)を実践的に使用するシリーズの6番目の記事です以前の記事では、プロンプトエンジニアリングとファインチューニングを通じて事前学習済みのLLMを活用する方法について詳しく調査しましたこれらに対して…」

「オムニバースへ:Blender 4.0 アルファリリースが新しいOpenUSDアートの時代の幕開けを切る」

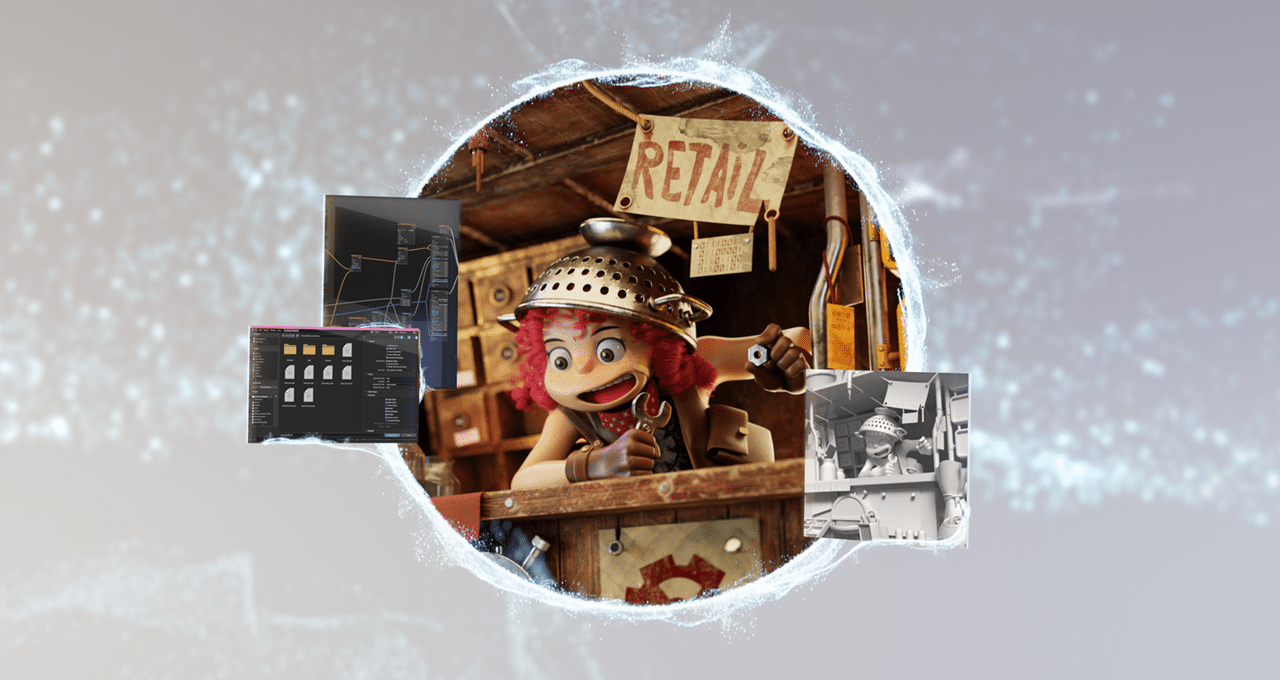

編集者の注:この記事は「Into the Omniverse」というシリーズの一部であり、アーティスト、開発者、エンタープライズが最新のOpenUSDとNVIDIA Omniverseの進歩を活用してワークフローを変革する方法に焦点を当てています。 経験豊富な3Dアーティストやデジタルクリエーション愛好家にとって、人気のある3DソフトウェアBlenderのアルファ版がクリエイティブな旅を高めています。 アップデートの機能には、複雑なシェーダーネットワークの作成や強化されたアセットエクスポート機能が含まれており、BlenderとUniversal Scene Descriptionフレームワーク(OpenUSD)を使用する開発コミュニティは、3Dの風景を進化させるのに役立っています。 NVIDIAのエンジニアは、BlenderのOpenUSDの機能を向上させるために重要な役割を果たしており、これによりNVIDIA Omniverseとの使用向上ももたらされています。NVIDIA Omniverseは、OpenUSDベースのツールやアプリケーションを接続して構築するための開発プラットフォームです。 Blenderワークフローのためのユニバーサルアップグレード Blender 4.0アルファでは、さまざまなユースケースに最適化されたOpenUSDワークフローにアクセスできるようになります。 たとえば、ミュンヘンのBMWグループテクノロジーオフィスのデザインインターンであるエミリー・ボーマーは、Omniverse、Blender、Adobe Substance 3D Painterの組み合わせのパワーを活用して、コンピュータビジョンAIモデルのトレーニングに使用するリアルなOpenUSDベースのアセットを作成しています。 ボーマーは、BMWグループが公開したAIデータセットであるSORDI.aiで使用するアセットを作成するために、チームと協力しました。このデータセットには80万枚以上の写真写実的な画像が含まれています。 工業用の木箱が仮想的に「経年変化」しているクリップ。 USDはボーマーのワークフローを最適化しました。「BlenderとSubstance 3D Painterの両方でUSDサポートが見られるのは素晴らしいことです」と彼女は言います。「USDを使用して3Dアセットを作成する際、それらが配置されるシーンで予想どおりの見た目と挙動をすることを確信できます。なぜなら、物理的な特性を追加できるからです。」 オーストラリアのアニメーター、マルコ・マトセヴィッチも、Blender、Omniverse、USDの組み合わせたパワーを3Dのワークフローで活用しています。…

オムニヴォアに会ってください:産業デザイナーがアートとOpenUSDを組み合わせて、AIトレーニング用の3Dアセットを作成します

編集者注:この投稿は、NVIDIA OmniverseとOpenUSDを使用して3Dワークフローを加速し、仮想世界を作成する個々のクリエイターと開発者を紹介するMeet the Omnivoreシリーズの一部です。 オーストラリアのクイーンズランド工科大学(QUT)の学生であるエミリー・ボーマーは、クリエイティブな芸術または科学を追求するか迷っていました。 そして彼女は産業デザインを見つけ、研究とコーディングに没頭しながら、スケッチ、アニメーション、3Dモデリングなどの可視化ワークフローを探求することができました。 今、ボーマーはドイツ・ミュンヘンのBMW Group Technology Officeでデザインインターンとして彼女のスキルを活かしています。チームはNVIDIA Omniverse(3Dツールとアプリケーションの開発および接続のためのプラットフォーム)およびUniversal Scene Description(OpenUSDとも呼ばれる)を使用して、合成データ生成パイプラインを強化しています。 ボーマーは、BMW Group、Microsoft、およびNVIDIAが公開したSORDI.aiと呼ばれる産業用合成オブジェクト認識データセットを使用して、リアルな3Dアセットを作成しています。SORDI.aiは開発者や研究者がAIの訓練を効率化し加速するためのものです。画像の自動生成を自動化するために、チームはOmniverse Replicatorに基づいた拡張機能を開発しました。Omniverse Replicatorは、カスタムの合成データ生成ツールを作成するためのソフトウェア開発キットです。 SORDI.aiチームの一員として、ボーマーはBlenderとAdobe Substance Painterを使用して、物理的な正確さと写実性の高い3Dアセットをデザインし、合成データが効率的にAIモデルの訓練に使用できるようにしています。 ボーマーが作成するすべてのアセットは、NVIDIA Isaac Simプラットフォームで自律ロボットのテストとシミュレーションに使用されます。NVIDIA Isaac…

このAIニュースレターは、あなたが必要とするすべてです#65

今週のAIでは、AI規制に関する進展がありましたエロン・マスクやマーク・ザッカーバーグなどのテックリーダーが60人以上の上院議員とAIについて話し合いましたが、彼らは皆同意しました-

「3Dガウシアンスプラッティング入門」

3Dガウススプラッティングは、小さな画像サンプルから学習したフォトリアルなシーンをリアルタイムでレンダリングするための技術であり、3Dガウススプラッティングによるリアルタイム放射輝度フィールドレンダリングに記載されています。この記事では、その動作原理とグラフィックスの未来について解説します。 ガウススプラッティングのシーンの例については、こちらのリモートガウスビューアーをご覧ください。 3Dガウススプラッティングとは何ですか? 3Dガウススプラッティングは、本質的にはラスタライゼーション技術です。つまり: シーンを説明するデータを持つ。 データを画面に描画する。 これは、コンピュータグラフィックスの三角形ラスタライゼーションに類似しており、画面上に多くの三角形を描画するために使用されます。 ただし、三角形ではなくガウス分布を使用します。以下は、境界を明確にするために描画された単一のガウス分布のラスタライズ例です。 ガウス分布は、次のパラメータで説明されます: 位置:どこにあるか(XYZ) 共分散:どのように伸縮されるか(3×3行列) 色:何色か(RGB) アルファ:どれくらい透明か(α) 実際には、複数のガウス分布が一度に描画されます。 これが三つのガウス分布です。では、700万個のガウス分布はどうでしょうか? 以下は、それぞれのガウス分布を完全に不透明にラスタライズしたものです。 これが3Dガウススプラッティングの概要です。次に、論文で説明されている手順を詳しく見ていきましょう。 動作原理 1. Structure from Motion 最初のステップは、Structure from…

「Würstchenの紹介:画像生成のための高速拡散」

Würstchenとは何ですか? Würstchenは、テキスト条件付きの成分が画像の高度に圧縮された擬似モデルです。なぜこれが重要なのでしょうか?データの圧縮により、トレーニングと推論の両方の計算コストを桁違いに削減することができます。1024×1024の画像でのトレーニングは、32×32の画像でのトレーニングよりも遥かに高価です。通常、他の研究では比較的小規模な圧縮(4倍から8倍の空間圧縮)を使用しますが、Würstchenはこれを極限まで高めました。新しいデザインにより、42倍の空間圧縮を実現しました!これは以前には見られなかったものです。なぜなら、一般的な手法では16倍の空間圧縮後に詳細な画像を忠実に再構築することができないからです。Würstchenは2段階の圧縮、ステージAとステージBを採用しています。ステージAはVQGANであり、ステージBはディフュージョンオートエンコーダーです(詳細は論文を参照)。ステージAとBはデコーダーと呼ばれ、圧縮された画像をピクセル空間に戻します。高度に圧縮された潜在空間で学習される第3のモデル、ステージCも存在します。このトレーニングでは、現在の最高性能モデルに比べてずっと少ない計算リソースが必要であり、より安価で高速な推論が可能です。ステージCを事前モデルと呼んでいます。 なぜ別のテキストから画像へのモデルが必要なのですか? それは非常に高速かつ効率的です。Würstchenの最大の利点は、Stable Diffusion XLなどのモデルよりもはるかに高速に画像を生成でき、メモリの使用量も少ないことです!A100が手元にない私たち全員にとって、これは便利なツールです。以下は、異なるバッチサイズでのSDXLとの比較です: さらに、Würstchenの大幅な利点として、トレーニングコストの削減があります。512×512で動作するWürstchen v1は、わずか9,000時間のGPUでトレーニングされました。これを、Stable Diffusion 1.4に費やされた150,000時間のGPUと比較すると、コストが16倍も削減されていることがわかります。これにより、研究者が新しい実験を行う際にだけでなく、より多くの組織がこのようなモデルのトレーニングを行うことができるようになります。Würstchen v2は24,602時間のGPUを使用しました。解像度が1536まで上がっても、これはSD1.4の6倍安価です。SD1.4は512×512でのみトレーニングされました。 詳しい説明ビデオは次のリンクでご覧いただけます: Würstchenの使用方法 こちらのデモを使用して試すこともできます: または、モデルはDiffusersライブラリを介して利用可能なため、既に慣れているインターフェースを使用することができます。例えば、AutoPipelineを使用して推論を実行する方法は次のとおりです: import torch from diffusers import AutoPipelineForText2Image from diffusers.pipelines.wuerstchen import…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.