Learn more about Search Results CPU - Page 44

- You may be interested

- 「Langchainとは何ですか?そして、大規模...

- エッジにおける生涯学習

- 地球は平らではなく、あなたのボロノイ図...

- NumPyを使用したゼロからの線形回帰

- 「OpenAI(Python)APIを解説する」

- Matplotlibを使用してインフォグラフィッ...

- 研究者は、解釈可能で効率的な量子風機械...

- 説明可能なAI:ブラックボックスモデルの解明

- 2023年のYouTuberに最適なAIツール

- 現代のデータエンジニアリング

- UCバークレーの研究者は、目的指向の対話...

- データサイエンスにおけるツールに依存し...

- あなたの製品の開発者学習のためのLLM(大...

- AIの付き添いロボットが、孤独感に苦しむ...

- データサイエンス入門:初心者向けガイド

科学ソフトウェアの開発

この記事では、このシリーズの最初の記事で示されたように、科学ソフトウェアの開発においてTDDの原則に従って、Sobelフィルタとして知られるエッジ検出フィルタを開発します

言語モデルの構築:ステップバイステップのBERTの実装ガイド

イントロダクション 言語処理を行う機械学習モデルの進歩は、ここ数年で急速に進んでいます。この進歩は、研究室を出て、いくつかの主要なデジタル製品の動力となり始めています。良い例として、BERTモデルがGoogle検索の重要な要素となったことが発表されたことがあります。Googleは、この進化(自然言語理解の進歩が検索に応用されること)は、「過去5年間で最大の進歩であり、検索の歴史上でも最大の進歩の1つ」と考えています。では、BERTとは何かについて理解しましょう。 BERTは、Bidirectional Encoder Representations from Transformersの略です。その設計では、未ラベルのテキストから左右の文脈の両方に依存して事前学習された深層双方向表現を作成します。我々は、追加の出力層を追加するだけで、事前学習されたBERTモデルを異なるNLPタスクに適用することができます。 学習目標 BERTのアーキテクチャとコンポーネントを理解する。 BERTの入力に必要な前処理ステップと、異なる入力シーケンスの長さを扱う方法を学ぶ。 TensorFlowやPyTorchなどの人気のある機械学習フレームワークを使用してBERTを実装するための実践的な知識を得る。 テキスト分類や固有表現認識などの特定の下流タスクにBERTを微調整する方法を学ぶ。 次に、「なぜそれが必要なのか?」という別の質問が出てきます。それを説明しましょう。 この記事は、データサイエンスブログマラソンの一環として公開されました。 なぜBERTが必要なのか? 適切な言語表現とは、機械が一般的な言語を理解する能力です。word2VecやGloveのような文脈非依存モデルは、語彙中の各単語に対して単一の単語埋め込み表現を生成します。例えば、”crane”という用語は、”crane in the sky”や”crane to lift heavy objects”といった文脈で厳密に同じ表現を持ちます。文脈モデルは、文内の他の単語に基づいて各単語を表現します。つまり、BERTはこれらの関係を双方向に捉える文脈モデルです。 BERTは、Semi-supervised…

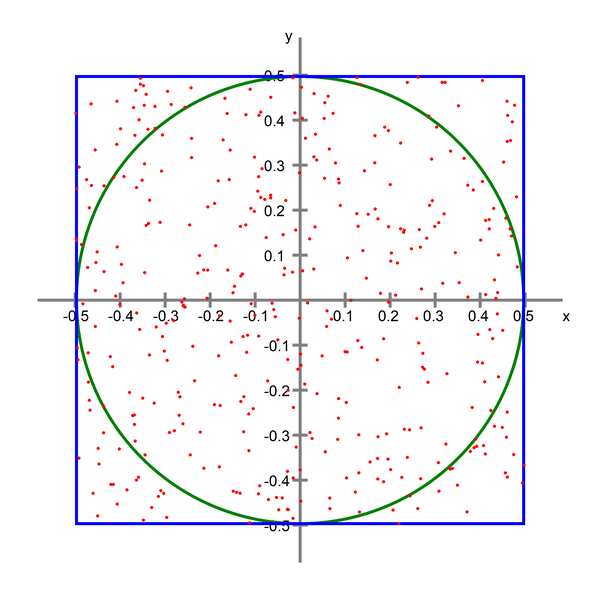

次元の呪いの真の範囲を可視化する

非常に多くの特徴を持つ観測の振る舞いを視覚化するために、モンテカルロ法を使用する

フィールドからフォークへ:スタートアップが食品業界にAIのスモーガスボードを提供

それは魔法のように機能しました。データセンターで実行されているコンピュータービジョンアルゴリズムが、インドの遠い小麦畑に病気が感染しようとしていることを検知しました。 16日後、現地の作業員が初めて感染の証拠を見つけました。 これは、Vinay Indragantiのような人々がデジタルトランスフォーメーションと呼ぶ魔法のようなものでした。彼は25年間、IngredionなどのFortune 500の食品原料メーカーでの過去12年間、その実践をしてきました。 このインドのプロジェクトは、Indragantiが共同創設したBlu Cocoon DigitalというスタートアップのNVIDIA Metropolisで動作する持続可能な農業向け製品スイートであるAGRi360の最初の大きなテストでした。 モバイルアプリがクラウドの知恵を利用 パイロットプログラムはシンプルで効果的でした。 農場の作業員は、モバイルアプリによって時間と位置情報が付与された植物の写真を撮影しました。それらはMicrosoft Azureクラウドに送信され、Blu Cocoonのカスタムモデルがパターンを見つけ、驚くべき予測を可能にしました。 業界での経験により、Indragantiはこのようなタイムリーな情報の価値を知っています。それは農場主やその全ての食品供給チェーンにとって豊作をもたらすことができます。 「それは広大な領域です。それがBlu Cocoonでの私たちのモットーである『食品のためのAI』になった理由です」と彼はコルカタに本社を置く同社のシカゴ郊外のオフィスでのインタビューで述べました。 畑の第三の目 AGRi360は「畑の第三の目のように機能します」とBlu Cocoon DigitalのR&D部門を率いる微生物学者のPinaki Bhattacharyaは言います。 AGRi360は農家の手にAIパワードのツールのダッシュボードを提供します。 パイロットプログラムでは、農家に対して病気を防ぐためにわずかな量の農薬を使用するように早期警告を出しました。農薬会社はその地域の状況について予め情報を得て、供給チェーンを管理するのに役立ちました。…

MosaicMLは、彼らのMPT-30BをApache 2.0の下でリリースしました

MosaicML-7Bの大成功の後、MosaicMLは再び以前に設定した基準を上回りました。新しい画期的なリリースでは、MosaicML-30Bを発表しました。 MosaicMLは非常に正確で強力な事前学習済みトランスフォーマーです。MosaicMLは、MosaicML-30BがChatGPT3よりもさらに優れていると主張しています。 MosaicML-30Bの発売前、MosaicML-7BはAI界を席巻しました。MPT-7B Base-instruct、base-chat、およびストーリーライティングは大成功でした。同社は、これらのモデルが世界中で300万回以上ダウンロードされたと主張しています。以前にリリースしたモデルへのコミュニティの熱狂がさらに優れたエンジンを求める最大の理由であり、Mosaic MLはMPT-30Bでそれを実現しました。 コミュニティがこれらのMPTエンジンを適応し、より調整されたものを構築して具体的なユースケースに役立てる姿は信じられないほどでした。興味深いケースの一部はLLaVA-MPTです。LLaVa-MPTは、事前学習済みMPT-7Bにビジョン理解を追加します。 同様に、GGMLはMPTエンジンをApple SiliconとCPUでより良く実行できるように最適化します。GPT4ALLは、MPTを基にしたGPT4のようなチャットオプションを実行できる別のユースケースです。 よく見ると、MosaicMLがより優れており、大企業に対して強力な競争力を持ち、比較的簡単な統合でさまざまなユースケースにモデルを適応させることができるというのは、彼らが提供する競争力のある機能のリストとモデルの適応性のおかげです。 このリリースでは、Mosaic MLはまた、ChatGPTが使用するパラメータのおよそ三分の一のMPT-30Bが、既存の生成ソリューションと比較して非常に軽量なモデルであると主張しています。 MosaicMLの既存のMPT-7Bよりも優れており、このMPT-30Bは商業ライセンスの下で即座に商業利用が可能です。 それだけでなく、MPT-30BにはMPT-30B-InstructとMPT-30B-Chatの2つの事前学習済みモデルも付属しており、1つの単一指示に影響を受けることができ、より長い時間のマルチターン会話を追うことができます。 その優れた点は続きます。MosaicMLはMPT-30Bをボトムアップのアプローチでより良く、より効率的に設計しました。MPT-30Bは8kトークンのコンテキストウィンドウでトレーニングされています。ALiBiを介してより長いコンテキストをサポートしています。 FlashAttentionの助けを借りて、トレーニングと推論のパフォーマンスを改善しました。MPT-30Bは、データの多様性によるより強力なコーディング能力を備えています。このモデルはNvidiaのH100上で8Kコンテキストウィンドウに拡張されました。同社は、これがH100で訓練された最初のLLMモデルであり、お客様にすぐに利用可能であると主張しています。 MosaicMLはまた、モデルを軽量に保ち、新興企業が運用コストを低く抑えるのに役立てています。 MPT-30Bのサイズも、単一のGPU上で簡単に展開できるように特別に選ばれました。1つのA100-80GB(16ビット精度)または1つのA100-40GB(8ビット精度)でシステムを実行できます。Falcon-40Bなどの他の比較可能なLLMは、より大きなパラメータ数を持ち、単一のデータセンターGPUではサービスできません(現在)。これには2つ以上のGPUが必要であり、最小の推論システムコストが増加します。

ビッグデータアプリケーションのクラウドストレージコストの管理

増加し続けるデータ量への依存度の高まりにより、現代の企業は高容量かつ高スケーラビリティのあるデータストレージソリューションにより、これまで以上に依存しています多くの企業にとって、これは...

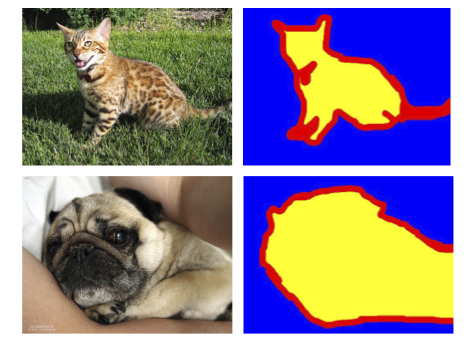

PyTorchを使った効率的な画像セグメンテーション:パート1

この4部作では、PyTorchを使用して深層学習技術を使った画像セグメンテーションをゼロから段階的に実装しますシリーズを開始するにあたり、必要な基本的なコンセプトとアイデアについて説明します

PyTorchを使用した効率的な画像セグメンテーション:パート3

この4部シリーズでは、PyTorchを使用して深層学習技術を使い、画像セグメンテーションをスクラッチからステップバイステップで実装しますこのパートでは、CNNベースラインモデルを最適化することに焦点を当てます

AIは精神疾患の検出に優れています

重症患者のせん妄検知は、患者のケアや回復に重要な影響を与える複雑なタスクです。しかし、人工知能(AI)と迅速な反応型脳波(EEG)の進歩により、せん妄検知が変革されています。Natureに掲載された研究によると、科学者たちはNVIDIA GPUの力を借りてAIを活用し、驚くべき精度でせん妄検知を実現しました。このブレイクスルーには、重症患者のケアを革新し、患者アウトカムを改善し、せん妄に関連する財政的負担を減らす可能性があります。この興味深い研究の詳細について見ていきましょう。 また読む:試行錯誤から精度へ:高血圧治療のAIの答え せん妄の理解 せん妄は、医療状態、精神活性物質、または複数の原因による急性の混乱状態です。数時間から数日で発症し、注意、意識、高次の認知障害を伴います。せん妄の人は、他の神経精神症状、例えば、心理運動活動の変化、睡眠覚醒周期、感情や知覚の障害を経験するかもしれません。ただし、これらは診断に必要ではありません。 せん妄検知の重要性 せん妄は、重症患者の間で広く見られる急性の混乱状態であり、早期に検出することで適切なケアを提供し、回復を促進し、長期にわたるスキルの必要な介護を減らすことができます。米国では、NIHによると、せん妄の財政的影響は年間1人あたり最大で64,000ドルになることがあります。 ブレークスルーの研究:AIとEEGによるせん妄検知 最近のNatureの出版物「Supervised deep learning with vision transformer predicts delirium using limited lead EEG」において、研究チームはせん妄検知に対する画期的なアプローチを紹介しました。NVIDIA GPUによって加速されたディープラーニングモデルであるVision Transformerを、迅速な反応型EEGデバイスと組み合わせることで、驚異的なテスト精度率97%を達成しました。このブレークスルーにより、認知症を予測し、予防や治療方法の評価を容易にし、患者ケアを改善する可能性があります。 また読む:ヘルスケアのMLの利用:予測分析と診断 NVIDIA…

グリーンAI:AIの持続可能性を向上させるための方法とソリューション

もし、あなたがこの記事を開いたのであれば、おそらく現在の大規模言語モデル(LLM)の安全性と信頼性に関する現在の論争について聞いたことがあるでしょう有名な人々によって署名された公開書簡...

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.