Learn more about Search Results ML - Page 358

- You may be interested

- AnomalyGPT:LVLMを使用して産業の異常を...

- 「あなたの携帯電話の画面をぼやけさせる...

- テストに合格する:NVIDIAがMLPerfベンチ...

- 「2024年のデータ管理の未来予想:トップ4...

- 「知っておくべき2つの興味深いPandasデー...

- 「40歳以上の方にオススメのAIツール(202...

- ソルボンヌ大学の研究者は、画像、ビデオ...

- 「なぜデータパイプラインには閉ループフ...

- このAI研究では、優れた画像分類のために...

- AIの検索アルゴリズム:最も人気のあるも...

- ChatGPTのバイアスを解消するバックパック...

- 「ロボットのセンシングと移動のためのア...

- サイバーセキュリティにおける生成AIの約...

- 「A.I. Doomerismの白熱の中心に入ってみ...

- Sudowriteのレビュー:AIが人間らしい小説...

ビジネス戦略において機械学習を使用する時と使用しない時の選択

それは明らかな質問ではありません初心者のデータサイエンティストにとっては、すぐに機械学習モデルを推進することは間違いです実際には、よりシンプルなルールベースのソリューションの方が効率的で実装が容易です...

私たちの新しいコンテンツガイドラインとポリシーをお知らせします

当社は、オープンで協力的かつ責任ある機械学習の推進を目指すコミュニティ主導のプラットフォームとして、私たちのコミュニティ全体に対して歓迎の場を維持しサポートすることを喜んでいます!この目標をサポートするために、私たちはコンテンツポリシーを更新しました。 完全なドキュメントに精通することをお勧めします。その間、このブログポストでは、私たちのコンテンツポリシーの更新の背景、理論の概要、および価値観について概説します。両方のリソースを参照することで、当社プラットフォームのコンテンツに対する期待と目標を包括的に理解することができます。 機械学習コンテンツのモデレーション 機械学習アーティファクトのモデレーションには新たな課題が生じます。静的なコンテンツよりも、人工知能システムやモデルの開発・展開に関連するリスクは、潜在的な損害を予測するために詳細な分析と包括的なアプローチが必要です。そのため、この新しいコンテンツポリシーの起草には、私たちの異なるメンバーや専門家からの努力が集約され、責任ある開発と展開をどのように実現するかについて明確化するために、全社的な視点と詳細な情報が必要とされています。 さらに、AIと機械学習の分野が拡大するにつれ、ユースケースとアプリケーションの多様性も増えています。これにより、最新の研究、倫理的考慮事項、ベストプラクティスについて常に最新情報にアップデートする必要があります。そのため、ユーザーの協力を促進することも、当社プラットフォームの持続可能性にとって重要です。具体的には、コミュニティタブなどのコミュニティ機能を通じて、リポジトリの著者、ユーザー、組織、および私たちのチームの間での協力的なソリューションを奨励・促進しています。 同意を基本とする価値観 機械学習システムの開発と使用において、人々の権利を尊重することを優先するため、技術と法律の進展に対応する前向きな視点を持ちます。機械学習によって可能になる情報処理の新たな方法は、AIの分野や規制の範囲で、人々の作業、イメージ、プライバシーに関する権利について全く新しい問題を提起しています。これらの議論の中心にあるのは、人々の権利をどのように具体化すべきかという点です。私たちはここで一つのアプローチを提供しています。 この変化し続ける法的状況の中で、害を引き起こすことを避けるために「同意」の本質的な価値を強調することがますます重要になっています。それにより、個人の主体性と主観的な経験に焦点を当てることができます。このアプローチは、同意に対する先見性とより共感的な理解をサポートするだけでなく、文化的および文脈的要素に対処するための積極的な措置を奨励します。特に、私たちのコンテンツポリシーは、ユーザーが見るコンテンツ、人々のアイデンティティと表現に関連する同意に対処することを目指しています。 このプラットフォームでの人々の同意と経験に対する配慮は、コミュニティコンテンツやユーザーの行動にも及びます。安全で歓迎する環境を維持するために、ユーザーやHugging Faceスタッフに対して攻撃的または嫌がらせの言葉を許容しません。ユーザーとリポジトリの著者の間の潜在的な紛争に対しては、必要な場合にのみ介入し、協力的な解決策の促進に重点を置いています。透明性を促進するために、私たちはコミュニティタブ内での公開討論を奨励しています。 私たちのアプローチは、私たちのユーザーの貴重な意見によって可能になり、改善を常に追求することを約束しています。ご質問やご心配事がある場合は、[email protected]までお問い合わせください。 オープンなAIとMLの協力を奨励する、友好的で支援的なコミュニティを築くために力を合わせましょう!皆さんとともに、誰もが歓迎される環境で大きな進歩を遂げることができます。

Hugging Face SpacesでLivebookノートブックをアプリとしてデプロイする

エリクサーのコミュニティは、機械学習に向けて大きな進歩を遂げており、Hugging Faceはそれを実現するために重要な役割を果たしています。今日のエリクサーと機械学習で既に達成できることを示すために、私たちはLivebookを使用してWhisperベースのチャットアプリを構築し、それをHugging Face Spacesにデプロイしています。15分以内にすべて完了しますので、ぜひご覧ください: このチャットアプリでは、ユーザーはオーディオメッセージの送信のみでコミュニケーションを行い、Whisper機械学習モデルによって自動的にテキストに変換されます。 このアプリは、Livebookとエリクサーの機械学習エコシステムのいくつかの興味深い機能を紹介しています: Hugging Faceモデルとの統合 マルチプレイヤーの機械学習アプリ 並行して機械学習モデルを提供する(ボーナスポイント:モデルの提供をクラスタ上で簡単に分散させることもできます) Livebookがまだ知らない場合は、それはエリクサーでインタラクティブなコードノートブックを書くためのオープンソースツールであり、数値計算、データサイエンス、機械学習のエリクサーツールの成長するコレクションの一部です。 Hugging Faceとエリクサー エリクサーコミュニティは、機械学習の領域でHugging Faceプラットフォームとそのオープンソースプロジェクトを活用しています。以下にいくつかの例を示します。 Hugging Faceの事前学習済みニューラルネットワークモデルをエリクサーコミュニティにもたらした最初のポジティブな影響は、Bumblebeeライブラリでした。このライブラリはHugging Face Transformersからインスピレーションを受け、Hugging Face Hubを使用してモデルのパラメータをダウンロードしています。 もう1つの例は、tokenizersライブラリで、これはHugging Face Tokenizersのエリクサーバインディングです。…

AIポリシー@🤗:AIの説明責任に関する米国NTIAのコメント依頼への回答

6月12日、Hugging Faceは米国商務省NTIAからのAI責任ポリシーに関する情報提供依頼に対して回答を提出しました。私たちの回答では、AIの責任プロセスを推進するために文書化と透明性の基準の役割を強調し、また、前例のない成長があらゆる質問を生み出しているこの技術の見通しに取り組むために、技術の多様な関係者の広範な専門知識、視点、スキルに頼る必要性を強調しました。 Hugging Faceの使命は、「良い機械学習を民主化すること」です。私たちは、この文脈での「民主化」という用語を、機械学習システムを開発・展開するだけでなく、多くの関係者が理解し、尋問し、批判できるようにすることを意味するものと理解しています。そのために、私たちは教育活動、文書化への焦点、コミュニティガイドラインや責任あるオープンなアプローチへの取り組みを通じて透明性と包括性を促進してきました。また、技術的なバックグラウンドのレベルに関わらず、すべての人々がMLデータセットとモデルを分析できるようにするためのノーコードおよびローコードツールの開発も行っています。これにより、MLシステムの制約をよりよく理解し、これらのシステムによって利用者と影響を受ける人々に安全に活用される方法をより良く理解することができます。これらのアプローチは、特に私たちが主催した大規模な多学際的研究プロジェクトでの責任促進において、既にその有用性を証明しています(プロジェクトの社会的な利害に関するブログシリーズを参照してください)。最近のBigCodeプロジェクト(そのガバナンスについてはこちらで詳述しています)も含め、 具体的には、以下のような責任機構の推奨事項を示します: 責任機構は、MLの開発プロセスのすべての段階に焦点を当てる必要があります。完全なAI対応システムの社会的影響は、完全に予測不可能な方法で開発の各段階での選択に依存しており、展開段階にのみ焦点を当てた評価は、表面的な準拠に対応するだけで深層の問題に対処することはありません。 責任機構は、内部要件と外部アクセスを組み合わせる必要があります。良い文書化のような内部要件は、より責任ある開発を形成し、開発者の責任を明確にし、より安全で信頼性の高い技術を提供します。内部プロセスと開発の選択に対する外部アクセスは、主張や文書化を検証し、技術の多くの利害関係者が開発チェーンの外にいるため、その進化を意味のある形で形作り、関与させるために必要です。 責任機構は、開発者だけでなく、多学際的な研究コミュニティ、提唱団体、政策立案者、ジャーナリストなど、可能な限り幅広い貢献者からの参加を求めるべきです。ML技術の急速な普及の変革的な影響を理解することは、任意の単一の組織の能力を超えた課題であり、広範な研究コミュニティとその直接の利用者や影響を受ける人々の幅広いスキルと専門知識を活用する必要があります。 これらの目標を達成するために、MLアーティファクト自体とその評価結果の両方で透明性を優先することが重要だと考えています。より詳細な回答は、こちらでご覧いただけます。

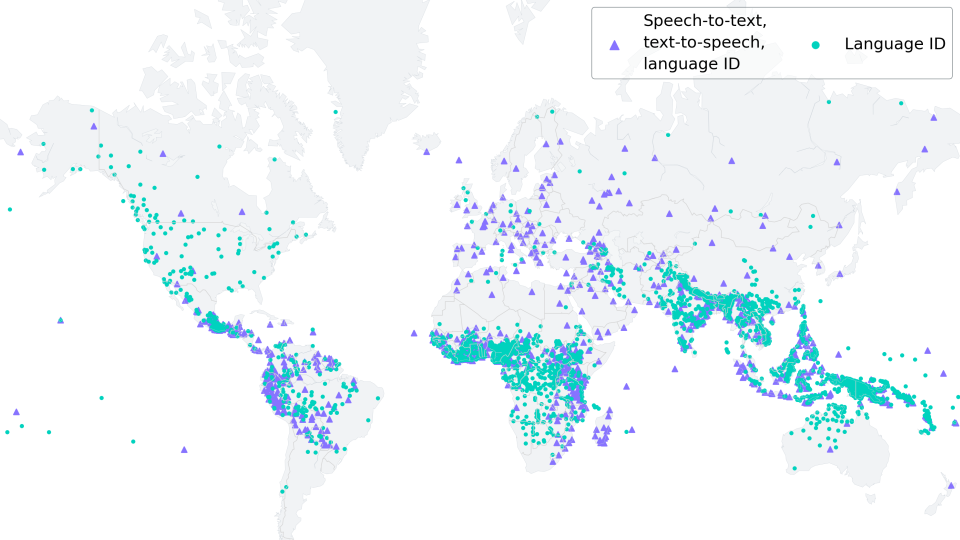

低リソースASRのためのMMSアダプターモデルの微調整

新しい(06/2023):このブログ記事は、「多言語ASRでのXLS-Rの微調整」に強く触発され、それの改良版として見なされるものです。 Wav2Vec2は、自動音声認識(ASR)のための事前学習モデルであり、Alexei Baevski、Michael Auli、およびAlex Conneauによって2020年9月にリリースされました。Wav2Vec2の強力なパフォーマンスが、ASRの最も人気のある英語データセットであるLibriSpeechで示された直後、Facebook AIはWav2Vec2の2つのマルチリンガルバージョンであるXLSRとXLM-Rを発表しました。これらのモデルは128の言語で音声を認識することができます。XLSRはクロスリンガル音声表現を意味し、モデルが複数の言語で有用な音声表現を学習する能力を指します。 Meta AIの最新リリースであるMassive Multilingual Speech(MMS)(Vineel Pratap、Andros Tjandra、Bowen Shiなどによる)は、マルチリンガル音声表現を新たなレベルに引き上げています。1,100以上の話されている言語が識別、転写、生成され、さまざまな言語識別、音声認識、テキスト読み上げのチェックポイントがリリースされます。 このブログ記事では、MMSのアダプタートレーニングが、わずか10〜20分の微調整後でも驚くほど低い単語エラーレートを達成する方法を示します。 低リソース言語の場合、私たちは「多言語ASRでのXLS-Rの微調整」と同様にモデル全体を微調整するのではなく、MMSのアダプタートレーニングの使用を強くお勧めします。 私たちの実験では、MMSのアダプタートレーニングはメモリ効率がよく、より堅牢であり、低リソース言語に対してはより優れたパフォーマンスを発揮することがわかりました。ただし、VoAGIから高リソース言語への場合は、Adapterレイヤーの代わりにモデル全体のチェックポイントを微調整する方が依然として有利です。 世界の言語多様性の保存 https://www.ethnologue.com/によると、約3000の「生きている」言語のうち、40%、つまり約1200の言語が、話者が減少しているために危機に瀕しています。このトレンドはますますグローバル化する世界で続くでしょう。 MMSは、アリ語やカイビ語など、絶滅危惧種である多くの言語を転写することができます。将来的には、MMSは、残された話者が母国語での記録作成やコミュニケーションをサポートすることで、言語を生き続けるために重要な役割を果たすことができます。 1000以上の異なる語彙に適応するために、MMSはアダプターを使用します。アダプターレイヤーは言語間の知識を活用し、モデルが別の言語を解読する際に役立つ役割を果たします。 MMSの微調整 MMSの非監視チェックポイントは、1400以上の言語で300万〜10億のパラメータを持つ、50万時間以上のオーディオで事前学習されました。 事前学習のためのモデルサイズ(300Mおよび1B)の事前学習のみのチェックポイントは、🤗 Hubで見つけることができます:…

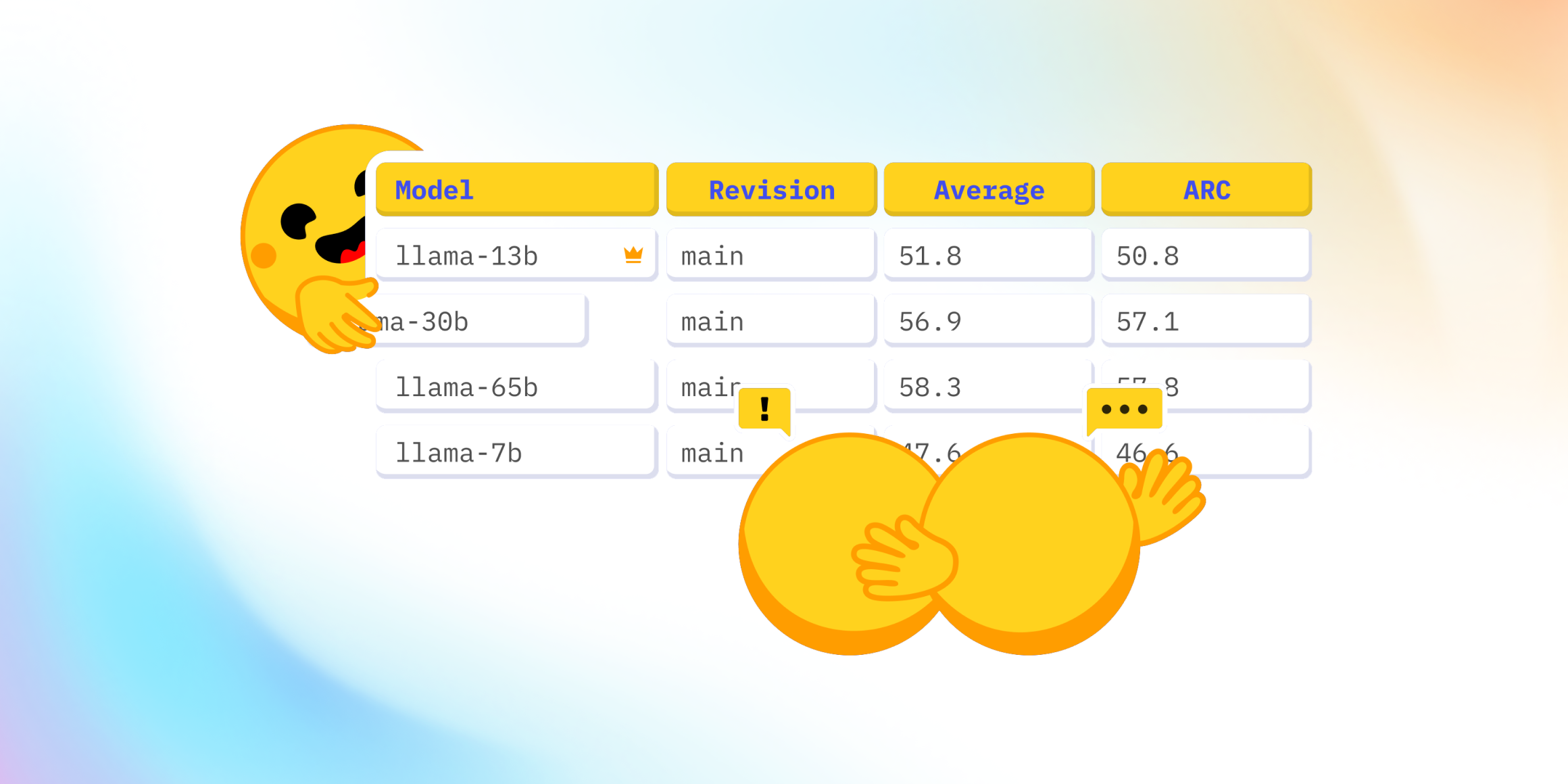

Open LLMのリーダーボードはどうなっていますか?

最近、Falcon 🦅のリリースおよびOpen LLM Leaderboardへの追加に関して、Twitter上で興味深い議論が起こりました。Open LLM Leaderboardは、オープンアクセスの大規模言語モデルを比較する公開のリーダーボードです。 この議論は、リーダーボードに表示されている4つの評価のうちの1つであるMassive Multitask Language Understanding(略称:MMLU)のベンチマークを中心に展開されました。 コミュニティは、リーダーボードの現在のトップモデルであるLLaMAモデル 🦙のMMLU評価値が、公開されたLLaMa論文の値よりも著しく低いことに驚きました。 そのため、私たちは何が起こっているのか、そしてそれを修正する方法を理解するために深堀りしました 🕳🐇 私たちとのこの冒険の旅において、私たちはLLaMAの評価に協力した素晴らしい@javier-m氏、そしてFalconチームの素晴らしい@slippylolo氏と話し合いました。もちろん、以下のエラーは彼らではなく、私たちに帰すべきです! この冒険の旅の中で、オンラインや論文で見る数値を信じるべきかどうか、モデルを単一の評価で評価する方法について多くのことを学ぶことができます。 準備はいいですか?それでは、シートベルトを締めましょう、出発します 🚀。 Open LLM Leaderboardとは何ですか? まず、Open LLM Leaderboardは、実際にはEleutherAI非営利AI研究所によって作成されたオープンソースのベンチマークライブラリEleuther…

倫理と社会ニュースレター#4:テキストから画像へのモデルにおけるバイアス

要約: テキストから画像へのモデルのバイアスを評価するためにより良い方法が必要です はじめに テキストから画像(TTI)生成は最近のトレンドであり、数千のTTIモデルがHugging Face Hubにアップロードされています。各モダリティは異なるバイアスの影響を受ける可能性がありますが、これらのモデルのバイアスをどのように明らかにするのでしょうか?このブログ投稿では、TTIシステムのバイアスの源泉、それらに対処するためのツールと潜在的な解決策について、私たち自身のプロジェクトと広範なコミュニティのものを紹介します。 画像生成における価値観とバイアスのエンコード バイアスと価値観には非常に密接な関係があります。特に、これらが与えられたテキストから画像モデルのトレーニングやクエリに埋め込まれている場合、この現象は生成された画像に大きな影響を与えます。この関係は、広範なAI研究分野で知られており、それに対処するためのかなりの努力が進行中ですが、特定のモデルで進化する人々の価値観を表現しようとする複雑さは依然として存在しています。これは、適切に明らかにし、対処するための持続的な倫理的な課題を提起します。 たとえば、トレーニングデータが主に英語である場合、それはおそらく西洋の価値観を伝えています。その結果、異なる文化や遠い文化のステレオタイプな表現が得られます。以下の例では、同じプロンプト「北京の家」に対してERNIE ViLG(左)とStable Diffusion v 2.1(右)の結果を比較すると、この現象が顕著に現れます: バイアスの源泉 近年、自然言語処理(Abidら、2021年)およびコンピュータビジョン(BuolamwiniおよびGebru、2018年)の両方の単一モダリティのAIシステムにおけるバイアス検出に関する重要な研究が行われています。MLモデルは人々によって構築されるため、すべてのMLモデル(そして技術全般)にはバイアスが存在します。これは、画像の中で特定の視覚的特性が過剰または過少に表現される(たとえば、オフィスワーカーのすべての画像にネクタイがある)ことや、文化的および地理的なステレオタイプの存在(たとえば、白いドレスとベールを着た花嫁のすべての画像、代表的な花嫁のイメージである赤いサリーの花嫁など)が現れることで現れます。AIシステムは広く異なるセクターやツール(例:Firefly、Shutterstock)に展開される社会技術的なコンテキストで展開されるため、既存の社会的なバイアスや不平等を強化する可能性があります。以下にバイアスの源泉の非徹底的なリストを示します: トレーニングデータのバイアス:テキストから画像への変換のための人気のあるマルチモーダルデータセット(たとえば、テキストから画像へのLAION-5B、画像キャプショニングのMS-COCO、ビジュアルクエスチョンアンサリングのVQA v2.0など)には、多数のバイアスや有害な関連が含まれていることが判明しています(Zhaoら、2017年、PrabhuおよびBirhane、2021年、Hirotaら、2022年)。これらのデータセットでトレーニングされたモデルには、画像生成の多様性の欠如や、文化やアイデンティティグループの共通のステレオタイプが永続化するという初期の結果がHugging Face Stable Biasプロジェクトから示されています。たとえば、CEO(右)とマネージャー(左)のDall-E 2の生成結果を比較すると、両方とも多様性に欠けていることがわかります: 事前トレーニングデータのフィルタリングにおけるバイアス:モデルのトレーニングに使用される前に、データセットに対して何らかの形のフィルタリングが行われることがよくあります。これにより、異なるバイアスが導入されます。たとえば、Dall-E 2の作者たちは、トレーニングデータのフィルタリングが実際にバイアスを増幅することを発見しました。これは、既存のデータセットが女性をより性的な文脈で表現するというバイアスや、使用されるフィルタリング手法の固有のバイアスに起因する可能性があると彼らは仮説を立てています。 推論におけるバイアス:Stable…

ビジョン言語モデルの高速化:Habana Gaudi2上のBridgeTower

Optimum Habana v1.6 on Habana Gaudi2 では、最新のビジョン言語モデルである BridgeTower のファインチューニングにおいて、A100 と比較してほぼ3倍の高速化を実現しています。ハードウェアアクセラレーションによるデータの読み込みと高速な DDP 実装の2つの新機能がパフォーマンス向上に寄与しています。 これらの技術は、データの読み込みに制約がある他のワークロードにも適用できます。これは、さまざまなタイプのビジョンモデルに頻繁に起こるケースです。この投稿では、BridgeTower のファインチューニングを Habana Gaudi2 と Nvidia A100 80GB で比較するために使用したプロセスとベンチマークを紹介します。また、トランスフォーマーベースのモデルでこれらの機能を簡単に活用する方法も示します。 BridgeTower 最近のビジョン言語(VL)モデルは、さまざまなVLタスクで非常に重要であり、優位性を示しています。最も一般的なアプローチは、それぞれのモダリティから表現を抽出するためにユニモーダルエンコーダを利用することです。その後、これらの表現は融合されるか、クロスモーダルエンコーダに供給されます。VL表現学習のパフォーマンス制約と制限を効果的に扱うために、BridgeTower は複数のブリッジ層を導入し、ユニモーダルエンコーダのトップ層とクロスモーダルエンコーダの各層との間に接続を構築します。これにより、クロスモーダルエンコーダ内の異なる意味レベルで視覚とテキストの表現の効果的なボトムアップのクロスモーダルの整合性と融合が可能になります。…

Hugging Faceの推論エンドポイントを使用してLLMをデプロイする

オープンソースのLLMであるFalcon、(オープン-)LLaMA、X-Gen、StarCoder、またはRedPajamaは、ここ数ヶ月で大きく進化し、ChatGPTやGPT4などのクローズドソースのモデルと特定のユースケースで競合することができるようになりました。しかし、これらのモデルを効率的かつ最適化された方法で展開することはまだ課題です。 このブログ投稿では、モデルの展開を容易にするマネージドSaaSソリューションであるHugging Face Inference EndpointsにオープンソースのLLMを展開する方法と、応答のストリーミングとエンドポイントのパフォーマンステストの方法を紹介します。さあ、始めましょう! Falcon 40Bの展開方法 LLMエンドポイントのテスト JavaScriptとPythonでの応答のストリーミング 始める前に、Inference Endpointsについての知識をおさらいしましょう。 Hugging Face Inference Endpointsとは何ですか Hugging Face Inference Endpointsは、本番環境での機械学習モデルの展開を簡単かつ安全な方法で提供します。Inference Endpointsを使用することで、開発者やデータサイエンティストはインフラストラクチャの管理をせずにAIアプリケーションを作成できます。展開プロセスは数回のクリックで簡略化され、オートスケーリングによる大量のリクエストの処理、ゼロスケールへのスケールダウンによるインフラストラクチャのコスト削減、高度なセキュリティの提供などが可能となります。 LLM展開における最も重要な機能のいくつかは以下の通りです: 簡単な展開: インフラストラクチャやMLOpsの管理を必要とせず、本番用のAPIとしてモデルを展開できます。 コスト効率:…

SQLクエリにおいてGPT-4よりも優れたもの:NSQL(完全なオープンソース)

ChatGPTや他のLLM(Language Model)を使用してSQLクエリを生成しようとしたことがある方は手を挙げてください私は試してみましたし、現在も試しています!しかし、新しいオープンソースのファミリーが登場したことをお伝えできるのがとても嬉しいです...

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.