Learn more about Search Results ML - Page 317

- You may be interested

- 「ChatGPT 3.5 Turboの微調整方法」

- 「10 最高のワークフロー自動化ツール」

- 「自律AIエージェントを使用してタスクを...

- フォトグラメトリとは何ですか?

- 「アメリカのトップ10のデータサイエンス...

- AI教授:ハーバード大学、ChatGPTのような...

- アマゾンの研究者たちは、「HandsOff」と...

- 「エンジニアリングは永遠に変わりました」

- 「RustコードのSIMDアクセラレーションの...

- カートゥーンキャラクターの中間プロンプト

- メタAIが効率的なSAMを紹介します:パラメ...

- 決定科学がデザインと出会う” (Kett...

- ゲーム業界の皆様へ!もう奇妙な鏡は不要...

- DLISファイルからLASファイル形式へのウェ...

- 「検索強化生成システムのパフォーマンス...

テキストのポテンシャルを引き出す:プリエンベッドテキストクリーニング方法の詳細な調査

テキストクリーニングの方法のデモンストレーションには、Kaggleから取得した「メタモルフォーシス」という名前のテキストデータセットを使用します上記のコードセルが機能するためには、ローカルディレクトリパスを指定する必要があります...

「フューショットラーニングの力を解き放つ」

はじめに 少数のラベル付きの例だけでタスクを征服し、データのオッズに挑む機械の領域へようこそ。このガイドでは、少数のラベル付き例で偉業を達成するための賢いアルゴリズムがどのように偉大さを実現するかについて探求します。人工知能の新たな可能性を開く少数のデータでのアプローチの概念や、従来の機械学習との違い、データが少ないシナリオでのこのアプローチの重要性について学びましょう。 学習目標 技術的な詳細に入る前に、このガイドの学習目標を概説しましょう: 概念を理解し、従来の機械学習との違い、データが少ないシナリオでのアプローチの重要性を理解する 少数のデータ学習に使用されるさまざまな手法やアルゴリズム、メトリックベースの手法、モデルベースのアプローチ、およびその基本原理を探索する さまざまなシナリオでの少数のデータ学習の技術の適用方法を理解する。効果的なトレーニングと評価のためのベストプラクティスを理解する 少数のデータ学習の現実世界の応用を発見する 少数のデータ学習の利点と制限を理解する さあ、ガイドの各セクションについて探求して、これらの目標を達成する方法を理解しましょう。 この記事はデータサイエンスブログマラソンの一部として公開されました。 Few Shot Learningとは何ですか? Few Shot Learningは、クラスまたはタスクごとに限られた数のラベル付き例からモデルを訓練して認識と一般化を行う機械学習のサブフィールドです。Few Shot Learningは、データに飢えたモデルの従来の概念に挑戦します。大量のデータセットに頼る代わりに、Few Shot Learningはわずかなラベル付きサンプルから学習することを可能にします。限られたデータから一般化する能力は、広範なラベル付きデータセットを入手することが実践的または高価でないシナリオでの驚くべき可能性を開くものです。 新しい概念を素早く把握し、オブジェクトを認識し、複雑な言語を理解し、限られたトレーニング例でも正確な予測を行うモデルを想像してみてください。Few Shot Learningはまさにそれを可能にし、さまざまなドメインでのさまざまな課題へのアプローチ方法を変えています。Few…

「ソフトウェア開発におけるAIの活用:ソリューション戦略と実装」

この記事では、プロセス、ツールの選択、課題の克服について触れながら、ソフトウェア開発にAIをシームレスに統合するための包括的なガイドを提供しています

「BI-LSTMを用いた次の単語予測のマスタリング:包括的なガイド」

はじめに 次の単語を特定することは、次の単語の予測、または言語モデリングとしても知られています。自然言語処理のベンチマークタスクの一つは、言語モデリングです。基本的な形式では、特定の単語の後に続く単語を、それらに基づいて最も起こりやすいものとして選ぶことを意味します。言語モデリングは、さまざまな分野でさまざまな応用があります。 学習目標 統計分析、機械学習、データサイエンスで使用される多くのモデルの基本的なアイデアと原則を認識する。 回帰、分類、クラスタリングなどの予測モデルを作成し、データに基づいて正確な予測とタイプを生成する方法を学ぶ。 過剰適合と適合不足の原則を理解し、精度、適合率、再現率などの指標を使用してモデルのパフォーマンスを評価する方法を学ぶ。 データの前処理とモデリングに関連する特性を特定する方法を学ぶ。 グリッドサーチと交差検証を使用して、ハイパーパラメータを調整し、モデルを最適化する方法を学ぶ。 この記事はData Science Blogathonの一部として公開されました。 言語モデリングの応用 以下は言語モデリングの注目すべき応用例です。 モバイルキーボードのテキスト推奨 スマートフォンのキーボードには、モバイルキーボードのテキスト推奨、予測テキスト、またはオートサジェストと呼ばれる機能があります。入力すると、単語やフレーズを提案します。これにより、タイピングがより速く、エラーが少なくなり、より正確で文脈に適した推奨が行われます。 また読む:コンテンツベースのレコメンデーションシステムの構築 Google検索の自動補完 Googleなどの検索エンジンを使用して何かを検索するたびに、多くのアイデアが表示され、フレーズを追加すると、推奨がより良く、現在の検索に関連性が高くなります。それはどのように実現されるのでしょうか? 自然言語処理(NLP)技術が可能にします。ここでは、自然言語処理(NLP)を使用して、双方向LSTM(長短期記憶)モデルを利用して、文の残りの単語を予測する予測モデルを作成します。 さらに詳しくはこちら:LSTMとは? 長短期記憶の紹介 必要なライブラリとパッケージのインポート 次の単語の予測モデルを作成するために、双方向LSTMを使用するために必要なライブラリとパッケージをインポートするのが最も良いでしょう。一般的に必要なライブラリの一部を以下に示します: import…

中国からの新しいAI研究が提案するSHIP:既存のファインチューニング手法を改善するためのプラグアンドプレイの生成AIアプローチ

この論文では、既存の微調整手法を改善するための SyntHesIzed Prompts (SHIP)という新しいアプローチについて取り上げています。 微調整:プレトレーニングの後、モデルはより小さなタスク固有のデータセットで微調整されます。これには新しいデータに対してトレーニングプロセスを継続することが含まれます。一般的な知識を特定のタスクに適用できるようにするために、プレトレーニングで獲得したモデルの知識を調整することが目的です。 研究者が取り組んでいる問題は、いくつかのクラスにデータがないシナリオです。彼らはクラス名を提供することで特徴を合成できる生成モデルをトレーニングすることを目指しました。これにより、データのないカテゴリの特徴を生成することが可能になります。 データのないカテゴリの特徴を生成するとは、トレーニングデータセットに存在しないクラスやカテゴリの表現を合成するプロセスを指します。これは、特定のクラスの実データを収集することが難しいまたは不可能なシナリオで特に有用です。 その後、研究者はオリジナルのラベル付きデータと新たに合成された特徴を使用してCLIPを微調整しました。しかし、生成モデルは通常、トレーニングに大量のデータを必要とするため、データの効率性とは相反する大きな障害です。彼らは、敵対的なトレーニングを必要とするモデルよりもトレーニングが容易で低データのシナリオで効果的な変分オートエンコーダ(VAE)をフレームワークとして利用することを提案しました。 GANとVAEは両方とも新しいデータサンプルを生成することができる生成モデルですが、アーキテクチャ、目標、トレーニング方法などが大きく異なります。GANは高品質でリアルなサンプルを生成する能力で知られていますが、トレーニングが難しい場合もあります。一方、VAEは確率的なフレームワークを提供し、特にデータが限られているシナリオでは取り扱いが容易ですが、GANほど鮮明またはリアルなサンプルを生成しないかもしれません。 CLIP(Contrastive Language–Image Pretraining)は、テキストの説明から画像を理解し生成するためのOpenAIによって開発されたモデルです。大規模なデータセットで事前トレーニングされ、視覚と言語の表現が整列しています。事前トレーニングされた言語エンコーダはよりリアルな特徴の生成を支援します。この論文は、合成データを利用してCLIPの微調整手法の性能を向上させることを目指して、ベースから新しい一般化、クロスデータセットの転移学習、および一般化されたゼロショット学習について包括的な実験を行い、最先端のパフォーマンスを達成しました。 提案されたモデルのアーキテクチャは、VAEフレームワークを利用して特徴をエンコードおよび生成し、CLIPを統合して画像特徴を抽出し再構築します。トレーニング中、モデルは特徴を潜在空間にエンコードし、それを再構築する方法を学習します。生成段階では、この学習されたエンコーディングを使用して新しいクラスの特徴を合成し、データのないクラスでもCLIPを微調整できるようにします。軽量なMLPと凍結されたCLIPテキストエンコーダからなる新しいCLIPベースのジェネレータは、潜在コードを変換し、特徴再構築用の最終的なプロンプトを構築する上で重要な役割を果たします。 研究者が観察した実験結果: ベースから新しい一般化:ImageNet、Caltech101、OxfordPets、StanfordCars、Flowers102、Food101、FGVCAircraft、SUN397、DTD、EuroSAT、UCF101を含む11の多様な画像分類データセットで実験が行われました。データセットはベースクラスと新しいクラスに分割され、ベースクラスでクラスごとに16のサンプルでトレーニングが行われました。評価はベースクラスと新しいクラスの両方で行われました。 一般化されたゼロショット設定:論文では、ベースから新しい一般化をより現実的な一般化されたゼロショット設定で評価しました。この設定では、ベースデータと新しいデータがテストデータセットで混在しています。結果は以前の手法では性能が著しく低下することを示しましたが、提案された方法であるSHIPは新しいクラスでの性能を改善し続けました。 他の手法との比較:CLIP、CoOp、CLIP-Adapter、Tip-Adapterなどの他の手法と比較されました。提案されたSHIP手法は、さまざまなデータセットで新たなクラスでの性能を向上させました。 結論: この論文では、既存のファインチューニング手法を改善するために、新しいSyntHesIzed Prompts (SHIP)アプローチを提案しました。特に一部のクラスにデータがないシナリオで、この手法はさまざまなタスクで最先端のパフォーマンスを達成しました。データのないカテゴリに対して特徴を合成し、元のラベル付き特徴と新たに合成された特徴の両方を使用してCLIPをファインチューニングすることで、この手法は優れた結果を得ることができました。論文は、追加のトレーニングコストを制約として認識し、将来の研究でSHIPの密な予測タスクへの適用可能性を探求する意図を表明しています。 全体として、この論文は、特定のクラスのデータの不足の課題に対処し、合成データを使用してCLIPのファインチューニング手法のパフォーマンスを向上させるという点で、この分野への重要な貢献を示しています。

「LG AI Researchが提案するQASA:新しいAIベンチマークデータセットと計算アプローチ」

人間は推論が得意であり、これが他の生物との違いです。推論には連想思考と論理的思考が含まれます。推論の一つの単純な方法は、何、いつ、どこ、なぜなどの質問をすることです。この推論によって、新たな発見や革新的なアイデアへと導かれることがあります。 さて、自分自身が自分自身の科学論文を書く際に行き詰まり、適切な好奇心のある質問をすることに困難を感じたと想像してください。科学論文や専門記事の量が増加しているため、従来のプロセスは時間がかかるため実現不可能となっています。科学論文を読むことで質問が生まれ、テストや深い質問が含まれることがありますが、これらはフルスタックの推論を必要とします。このような自然な高度な質問に答えるために、LGの研究者は科学論文に対する質問応答(QASA)アプローチを提案しています。これはフルスタックの認知推論を含んでいます。 研究者は、読者と著者が抽象的な部分だけでなく、科学論文全体を読みながら質問をするための3つのステップの手法を設計しました。最初は、読者が高度な表面的な質問、テスト、深い質問をすることを許可することです。次に、これらの質問と回答は、専門の読者が行った質問と比較されます。最後に、読者と著者は収集された質問に対して多面的な長文回答を提案するよう招待されます。 研究者によると、QASAにはAI/ML論文に関する1798の質問応答ペアが含まれています。平均して、各論文には15.1から29の質問があり、39.4%が深い推論レベルの質問です。彼らのQASAアプローチには、段落から関連情報を抽出するための連想的選択、各抽出段落から根拠のみを把握するための根拠生成、および根拠を包括的な回答に関連付けるための体系的な構成が含まれています。 現実的な質問を確保するために、質問者は自分の選んだ論文を選び、深い読書と呼ばれるすべてのセクションを読むか、スキム読書と呼ばれる特定のセクションを読むかを選択し、回答を含まない質問を準備することが許されています。回答者も、質問者が取り組んだ論文から関連する回答を提供するために論文を選ぶことができます。回答者は、選択した段落から自己生成された根拠に基づいて包括的な文章として回答するようにガイドされます。 研究者は、評価者が同じ質問に対して2つの回答を比較するペアワイズ評価手法を実施しました。評価者には、QASAスキームからの回答とInstructGPTからの回答の2つを提供しました。フルスタックのQAからの回答は、InstructGPTからの回答よりもより完全で根拠がある傾向があります。 QASAアプローチは、事前学習された言語モデル(LM)を使用して各サブタスクをモデリングします。公開および合成データは、科学論文と原稿におけるフルスタックの認知推論を提供するためのテストベッドとして機能することができます。これにより、有用な情報を手動で読み取り、再ランキングする労力が軽減されます。

「Google DeepMindと東京大学の研究者が、WebAgentを紹介:自然言語の指示に従って実際のウェブサイト上のタスクを完了できるLLM-Drivenエージェント」

論理演算、常識、論理的な推論、質問応答のタスク、テキスト生成、さらには対話的な意思決定タスクなど、多くの自然言語の活動は、大規模な言語モデル(LLM)を利用して解決することができます。HTMLの理解能力と多段階の推論を利用することで、LLMは最近、与えられた自然言語の命令を満たすために、コンピュータのアクションの連続を通じてエージェントがコンピュータを制御したり、インターネットを閲覧したりする自律的なウェブナビゲーションで優れた成功を示しています。事前に定義されたアクションスペースの欠如、シミュレータと比較してより長いHTMLの観測、およびLLMにおけるHTMLドメインの知識の欠如は、実世界のウェブナビゲーションに否定的な影響を与えています(図1)。 図1:実際のウェブナビゲーションの困難さ。現代の言語モデルエージェントは、事前に定義された操作を制御し、簡単に理解できるように簡略化されたHTMLテキストを受け取る仮想的なウェブサイトを探索することができます。エージェントがオープンエンドのタスクに対処し、多くのタスクに関係のない要素を含む長いHTMLテキストに対処する必要がある実際のウェブサイトをナビゲートする際には、言語モデルエージェントは引き続き苦労しています。 命令の複雑さとオープンエンドの実世界のウェブサイトのために、事前に適切なアクションスペースを選択することは容易ではありません。最新のLLMは、HTMLテキストの処理に最適な設計を持つことは稀であり、さまざまな研究では、命令の微調整や人間の入力からの強化学習がHTMLの理解とオンラインナビゲーションの精度を向上させると主張しています。多くのLLMは、一般的なタスクの汎用性とモデルのスケーラビリティを優先するため、実際のウェブページに見られる典型的なHTMLトークンよりも短い文脈の期間を優先し、テキスト-XPathの整列やテキスト-HTMLトークンの分離などの過去のアプローチを採用していません。 そうした長いテキストにトークンレベルのアラインメントを適用することは比較的安価です。WebAgentという、人間の命令に従って実際のウェブサイトでナビゲーションタスクを実行できるLLM駆動の自律エージェントを提供するために、プログラムスペースでカノニカルなウェブ操作をグループ化します。自然言語の命令をより小さなステップに分割することで、WebAgentは以下のことを行います: 各ステップのサブ命令を計画します。 サブ命令に基づいて長いHTMLページをタスクに関連するスニペットにまとめます。 実際のウェブサイトでサブ命令とHTMLスニペットを実行します。 この研究では、Google DeepMindと東京大学の研究者が、2つのLLMを組み合わせてWebAgentを作成しました。最近作成されたHTML-T5というドメインエキスパートの事前訓練言語モデルを使用して作業計画と条件付きHTML要約を行います。Flan-U-PaLMは、グラウンデッドコードの生成に使用されます。HTML-T5には、エンコーダにローカルとグローバルなアテンション手法を組み込むことで、長いHTMLページの構造の構文と意味をよりよく捉えるように特化させることができます。これは、長いスパンのノイズ除去目標を組み合わせたCommonCrawl1によって作成された大規模なHTMLコーパスで事前訓練された自己教師ありのモデルです。既存のLLM駆動のエージェントは、各タスクごとにさまざまな例を促すために単一のLLMを使用して意思決定タスクを完了することがよくあります。しかし、これはシミュレータの複雑さを超えるため、実世界のタスクには不十分です。 徹底的な評価によると、プラグイン言語モデルとの統合戦略により、HTMLの理解とグラウンディングが向上し、より高い汎化能力を持つことが示されています。詳細な研究によれば、タスク計画とHTML要約を専門の言語モデルでリンクさせることは、タスクのパフォーマンスにおいて重要であり、実世界のオンラインナビゲーションの成功率を50%以上向上させることができます。WebAgentは、QAの精度において単一のLLMに対して静的なウェブサイトの理解タスクで優れたパフォーマンスを発揮し、優れた基準と比較可能なパフォーマンスを持っています。さらに、HTML-T5はWebAgentの重要なプラグインとして機能し、ウェブベースのジョブで先端的な結果を独自に生み出します。MiniWoB++テストでは、HTML-T5は単純なローカルグローバルアテンションモデルやその命令微調整バリエーションよりも優れた成績を収め、以前の最良の技術よりも成功率が14.9%高い結果を達成しています。 彼らは主に以下の点に貢献しています: • 実用的なWebナビゲーションのために2つのLLMを組み合わせたWebAgentを提供しています。一般的な言語モデルは実行可能なプログラムを生成し、ドメインエキスパート言語モデルは計画とHTMLの要約を処理します。 • ローカルグローバルアテンションを採用し、大規模なHTMLコーパスを用いた長距離ノイズ除去の組み合わせによる事前トレーニングを行うことで、HTML-T5という新しいHTML特化言語モデルを提供しています。 • 実際のウェブサイトでは、HTML-T5は成功率を50%以上向上させ、MiniWoB++では従来のLLMエージェントを14.9%上回ります。

NLPの探求 – NLPのキックスタート(ステップ#3)

「以下は、特に単語の埋め込みについて、私が週間で学んだいくつかの概念です実際に手を動かして試してみましたので、その一部を近々シリーズとして共有します!ここで、サチン氏に感謝を述べたいと思います...」

NLPの探求- NLPのキックスタート(ステップ#4)

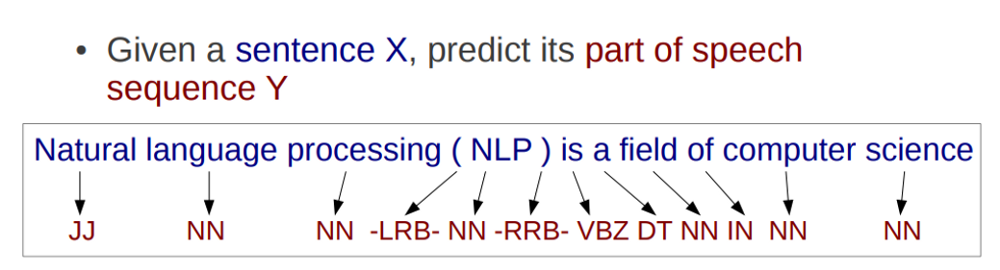

お帰りなさい!シリーズを続けて、今回は(主に)POSタギングについてのメモを共有します特に、CENのサチン・クマール・S氏(アムリタ・コインバトール)に感謝したいと思います...

「KafkaとDistributed Ray Serveのデプロイメントを統合する」

「Rayは、Pythonで簡単に分散アプリケーションを作成することができる、モダンなオープンソースフレームワークです単純なトレーニングパイプラインの作成、ハイパーパラメータのチューニング、データ処理などが可能です」

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.