Learn more about Search Results 15 - Page 309

- You may be interested

- メディアでの顔のぼかしの力を解き放つ:...

- 「サポートベクトルマシンの優しい入門」

- 「競合するアジェンダがオンラインコンテ...

- VRスーツはあなたがメタバース内で「感じ...

- ウェブコンテンツの選択肢と制御を進化さ...

- リアルタイムでデータを理解する

- 「Matplotlibのマスタリング:データ可視...

- 「ScyllaDB NoSQLを使用したAI/MLフィーチ...

- 「Amazon Bedrock と Amazon Location Ser...

- ジャーナリズムでのAIの受容 – ニュ...

- 「ビジョン・トランスフォーマーの内部機能」

- 変形ロボットが昆虫のように握り、登り、...

- インターネット上のトップ8逆電話検索ツール

- 「Pythonのitertoolsで無限イテレータを探...

- ChatGPTはチェスをプレイできますか?

Sealとは、大規模な3Dポイントクラウドに対して自己教示学習のための2Dビジョンファウンデーションモデルを活用し、「任意のポイントクラウドシーケンスをセグメント化する」AIフレームワークです

大規模言語モデル(LLMs)は、人工知能コミュニティで大きな話題となっています。 最近の影響力と驚異的なパフォーマンスは、ヘルスケア、ファイナンス、エンターテインメントなど、広範な産業に貢献しています。 GPT-3.5、GPT 4、DALLE 2、BERTなどのよく知られたLLMs、または基礎モデルは、短い自然言語プロンプトだけで独自のコンテンツを生成することにより、非常に優れたタスクを実行し、私たちの生活を簡素化しています。 SAM、X-Decoder、SEEMなどの最近のビジョン基礎モデル(VFMs)は、コンピュータビジョンの多くの進歩を遂げています。 VFMsは2D認識タスクで大きな進展を遂げていますが、3D VFM研究はまだ改善が必要です。 現在の2D VFMsを3D認識タスクに拡張することが必要であると研究者は提言しています。 重要な3D認識タスクの1つは、自動車用LiDARセンサによってキャプチャされたポイントクラウドのセグメンテーションであり、自動運転車の安全な運行に必要です。 既存のポイントクラウドセグメンテーション技術は、主にトレーニングのために注釈付けされた大規模なデータセットに依存しています。 ただし、ポイントクラウドのラベリングは時間がかかり、困難です。 すべての課題を克服するために、研究者チームは、自己教師あり表現学習をサポートするためにVFMsから意味的に豊かな知識を収集するSealというフレームワークを紹介しました。 クロスモーダル表現学習に着想を得て、Sealは、LiDARとカメラセンサの2D-3D関係を使用してクロスモーダル表現学習に高品質の対比的サンプルを開発することにより、自動車用ポイントクラウドでセルフサポート表現学習を実現します。 Sealには、拡張性、一貫性、汎用性の3つの重要な特性があります。 拡張性 – Sealは、VFMsを単にポイントクラウドに変換することで使用し、事前トレーニングの段階で2Dまたは3Dの注釈が必要なくなります。そのため、人間の注釈が必要な時間を削減するだけでなく、大量のデータを処理できます。 一貫性:アーキテクチャは、カメラからLiDARへのスペーシャルおよびテンポラルリンク、およびポイントからセグメントステージの両方でスペーシャルおよびテンポラルリンクを強制します。 Sealは、クロスモーダル相互作用をキャプチャすることにより、ビジョン、すなわちカメラとLiDARセンサのクロスモーダル相互作用を捕捉して、両モダリティから適切で一貫したデータを含む学習された表現を確実にします。 汎用性:Sealは、さまざまなポイントクラウドデータセットを含む下流アプリケーションに対する知識移転を可能にします。 それは、さまざまな解像度、サイズ、クリーン度、汚染レベル、実際のデータ、および人工データを持つデータセットを扱います。 研究チームが挙げた主な貢献のいくつかは次のとおりです。…

中間旅程のタトゥープロンプト

次のタトゥーのインスピレーションを探している場合は、Midjourneyを使用してみてください

マックス・プランク研究所の研究者たちは、MIME(3D人間モーションキャプチャを取得し、その動きに一致する可能性のある3Dシーンを生成する生成AIモデル)を提案しています

人間は常に周囲と相互作用しています。空間を移動したり、物に触れたり、椅子に座ったり、ベッドで寝たりします。これらの相互作用は、シーンの設定やオブジェクトの位置を詳細に示します。マイムは、そのような関係性の理解を利用して、身体の動きだけで豊かで想像力豊かな3D環境を作り出すパフォーマーです。彼らはコンピュータに人間の動作を模倣させて適切な3Dシーンを作ることができるでしょうか?建築、ゲーム、バーチャルリアリティ、合成データの合成など、多くの分野がこの技術に恩恵を受ける可能性があります。たとえば、AMASSなどの3D人間の動きの大規模なデータセットが存在しますが、これらのデータセットには収集された3D設定の詳細がほとんど含まれていません。 AMASSを使用して、すべての動きに対して信憑性の高い3Dシーンを作成できるでしょうか?そうであれば、AMASSを使用してリアルな人間-シーンの相互作用を考慮したトレーニングデータを作成できます。彼らは、MIME(Mining Interaction and Movement to infer 3D Environments)と呼ばれる新しい技術を開発しました。これは、3D人間の動きに基づいて信憑性の高い内部3Dシーンを作成して、このような問いに対応します。それを可能にするのは何でしょうか?基本的な仮定は次のとおりです。(1)空間を移動する人間の動きは、物の欠如を示し、実質的に家具のない画像領域を定義します。また、これにより、シーンに接触する場合の3Dオブジェクトの種類や場所が制限されます。たとえば、座っている人は椅子、ソファ、ベッドなどに座っている必要があります。 図1:人間の動きから3Dシーンを推定します。3D人間の動き(左)から推定された、動きが起こったリアルな3D設定を再現します。彼らの生成モデルは、人間-シーンの相互作用を考慮した、複数のリアリスティックなシナリオ(右)を生成できます。 ドイツのマックスプランク知能システム研究所とAdobeの研究者たちは、これらの直感を具体的な形で示すために、MIMEと呼ばれるトランスフォーマーベースの自己回帰3Dシーン生成技術を作成しました。空のフロアプランと人間の動きシーケンスが与えられると、MIMEは人間と接触する家具を予測します。さらに、人間と接触しないが他のオブジェクトにフィットし、人間の動作によって引き起こされる自由空間の制約に従う信憑性の高いアイテムを予測します。彼らは、人間の動きを接触と非接触のスニペットに分割して、3Dシーン作成を人間の動きに条件付けます。POSAを使用して接触可能なポーズを推定します。非接触姿勢は、足の頂点を地面に投影して、部屋の自由空間を確立し、2Dフロアマップとして記録します。 POSAによって予測された接触頂点は、接触ポーズと関連する3D人体モデルを反映した3D境界ボックスを作成します。接触と自由空間の基準を満たすオブジェクトは、トランスフォーマーへの入力として自己回帰的に期待されます。図1を参照してください。彼らは、3D-FRONTという大規模な合成シーンデータセットを拡張して、MIMEをトレーニングするための新しいデータセットである3D-FRONT HUMANを作成しました。彼らは、RenderPeopleスキャンからの静止接触ポーズと、AMASSからのモーションシーケンスを使用して、3Dシナリオに人を自動的に追加します(一連の歩行モーションと立っている人を含む非接触人と、座って、触れて、横たわっている人を含む接触人)。 MIMEは、3Dバウンディングボックスとして表される入力動作のリアルな3Dシーンレイアウトを推論時に作成します。彼らは、この配置に基づいて3D-FUTUREコレクションから3Dモデルを選択し、人間の位置とシーンの間の幾何学的制約に基づいて3D配置を微調整します。彼らの手法は、ATISSのような純粋な3Dシーン作成システムとは異なり、人間の接触と動きをサポートする3Dセットを作成し、自由空間に説得力のあるオブジェクトを配置することができます。Pose2Roomという最近のポーズ条件付け生成モデルとは異なり、個々のオブジェクトではなく完全なシーンを予測することができます。彼らは、PROX-Dのように記録された本物のモーションシーケンスに対して調整なしで彼らの手法が機能することを示しました。 まとめると、彼らが提供したものは以下の通りです: • 人と接触するものを自動的に生成し、運動定義された空きスペースを占有しないように自己回帰的に作成する、3Dルームシーンの全く新しい運動条件付き生成モデル。 • RenderPeopleの静止接触/立ち姿勢からの3Dモーションデータを用いて、人と自由空間にいる人々が相互作用する3Dシーンデータセットが、3D FRONTを埋めるように作成されました。 コードはGitHubで入手可能であり、ビデオデモとアプローチのビデオ解説も提供されています。

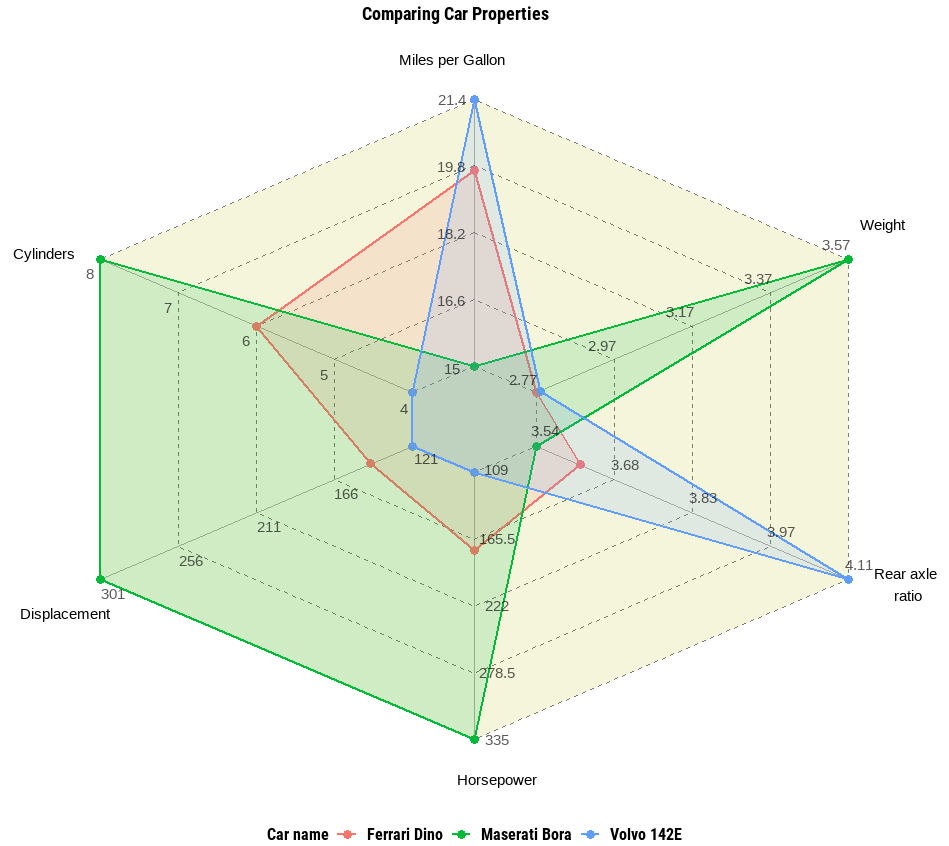

Rのggvancedパッケージを使用したスパイダーチャートと並列チャート

ggplot2パッケージの上に、スパイダーチャートや平行チャートなどの高度な多変数データ可視化を生成するためのパッケージ

PyTorchモデルのパフォーマンス分析と最適化—Part2

これは、GPU上で実行されるPyTorchモデルの分析と最適化に関する一連の投稿の第二部です最初の投稿では、プロセスとその重要な可能性を示しました...

データサイエンティストのための必須ガイド:探索的データ分析

データを完全に理解するためのベストプラクティス、技術、ツール

UCサンディエゴとクアルコムの研究者たちは「Natural Program」を公開しましたそれは自然言語での厳密な推論チェーンの容易な検証にとって強力なツールであり、AIにおける大きな転換点となります

人工知能の領域で最も驚くべき進歩の一つは、大規模言語モデル(LLM)の開発です。GPT 3.5とGPT 4アーキテクチャに基づくOpenAIが開発した非常に有名なChatGPTは、人間と同じようにコンテンツを生成し、質問に答えることで大いに役立っており、その創造的で正確なコンテンツ生成能力により、ほぼすべての産業における問題解決に取り組むことができます。Chain-of-Thought(CoT)プロンプティングの追加により、GPT 3.5の影響力は向上し、情報処理産業に大きな変革をもたらしました。CoTはLLMを強化し、中間段階でより包括的で詳細な推論プロセスを生成するのに役立ちます。 CoTには多くの利点がありますが、中間推論段階に重点を置くことで、幻覚や複雑化したエラーが発生することがあり、モデルが一貫した正確な推論プロセスを生成するのが困難になることがあります。人間が問題を解決するために故意の推論的論理推論手順に従う方法から着想を得て、LLMが明示的で厳密な演繹的推論を行うことを可能にするために、多くの努力が払われてきました。これらの課題に対処するため、研究者チームは、自然言語に基づく演繹的推論形式であるナチュラルプログラムを導入し、演繹的推論を達成するために自然言語の固有の力を利用する方法を提案しました。 チームは、このアプローチが推論検証プロセスをいくつかの連続したサブプロセスに分解することを示しました。各サブプロセスには、特定のステップに必要な文脈と前提条件のみが提供され、分解により検証プロセスがよりアプローチ可能になります。著者らは、OpenAIのGPT-3.5-turbo(175B)などの公開モデルを使用して、自然言語に基づく演繹的推論形式を実行するための算術および常識のデータセットのトライアルを実行し、その効果を示しました。アウトカムは、彼らの戦略が大規模言語モデルによって生成される推論プロセスの信頼性を高めるのにどのように優れているかを示しています。 ナチュラルプログラム形式により、言語モデルは正確な推論ステップを生成し、後続のステップがより厳密に前のステップに基づいていることを確認します。この構造を使用して、言語モデルはステップバイステップで推論自己検証を実行し、推論段階は各演繹的推論のレベルに検証手順が統合されているため、より厳密で信頼性が高くなります。 チームが述べた主な貢献のいくつかは次のとおりです。 ナチュラルプログラム形式の導入により、チームは、検証に適した厳密な演繹的推論のフレームワークを提案し、コンテキスト内学習により簡単に生成できるようにしました。 提案されたナチュラルプログラム形式で書かれた長大な演繹的推論プロセスは、必要な文脈と前提条件のみをカバーするステップバイステップのサブプロセスを使用して信頼性が高く自己検証できることが示されました。 実験により、フレームワークがLLMによる推論段階とソリューションの正確性、信頼性、解釈性をどのように効果的に向上させるかが示されました。 結論として、このフレームワークは、言語モデルの演繹的推論能力を向上させるために有望です。

2023年の最高のAI販売アシスタントツール

人工知能の営業アシスタントソリューションは、バーチャル営業アシスタントとしても知られ、様々な業務を自動化することで営業担当者を支援します。これらのAIパワードセールスツールを使用することで、セールスおよびマーケティングチームは日常業務に費やす時間を減らし、戦略的イニシアチブに集中することができます。これは、単にチャットを自動化することだけではなく、リードをスクリーニングすることも含みます。オンライン販売に向けたCovid-19の推進により、人工知能の営業アシスタントはますます重要になっています。 AI営業アシスタントと他の種類のセールス分析ツール、チャットボット、AIアプリケーションの機能には多少の重複がありますが、ルーチンのセールス手順を自動化する能力が向上しており、貴重な先見性を提供しています。ここでは、いくつかの人工知能の営業アシスタントアプリを確認してみましょう。 Warmer.ai 新規ビジネスリードや人材を見つけるために必要なのは、必要な人物にアプローチすることです。しかし、この見込み客に関する適切なデータを見つけ、効果的な最初のメールを書くことは課題です。この点で、Warmer.aiは優れています。AIの特徴を利用して、Warmer.aiは見込み客の栄誉、興味、職位などの推奨タッチポイントを補完することで、メールの個人化を支援します。これにより、レスポンス率、ミーティング予約、効率性が向上し、セールスチームは取引の完了により多くの時間を費やすことができます。 Drift Driftは、リードの資格判定プロセスを迅速化することでセールスサイクルを短縮するプラットフォームです。ユーザーがフォームを記入したり、返信を待ったりする必要はありません。代わりに、即時の対話に重点を置いています。チャットボットが営業アシスタントツールの中心にあり、顧客が質問に回答し、代表者とのアポイントメントを設定できるようにしています。他のマーケティングツールと統合し、訪問者ごとに体験をカスタマイズすることが重要な要素の1つです。 Dooly Dooly.aiは、広く使用されている顧客関係管理ツールであるSalesforceと統合してビジネスを支援します。Doolyは、アプリケーションの起動を待つ時間やタブを切り替える手間を省略することで、この手続きを簡素化します。複数のトランザクションを同時に変更するための便利な方法です。ミーティングノート、ノートテンプレート、パイプラインの更新、タスクマネージャーなどのキー機能があるため、取引とその発展を把握するのが簡単になります。 Troops Troopsは、SlackやMicrosoft Teamsと組み合わせて通知やその他のタスクを自動化するツールです。Salesforceなどの他のセールスツールとの通信にAIを使用しています。これにより、チームはシステム間を移動するのに最小限の時間しか費やさないことができます。シグナルは、収入に影響するアクションに関するリアルタイムメッセージで、重要な機能です。Deal Roomsは、Slackで顧客情報を集約し、チームのコラボレーションを向上させることができます。Commandを使用すると、すべての組み込みツールを1行のコードで編集できます。 TopOpps TopOppsは、トレーニングや開発、アクティビティの追跡、パイプライン管理、予測など、セールスプロセスの多くの側面にAIを使用しています。これにより、セールスチームが日常的に扱わなければならない多くの単調で繰り返しのタスクが省略されます。たとえば、正確なセールス予測により、管理者は重要なセールスKPIについての軽率な決断を回避できます。また、アポイントメントやその他の取引メトリクスなどの情報は自動的にキャプチャされ、リアルタイムでCRMにアップロードされます。 Exceed.ai Exceed.aiのAIインタラクションにより、リード資格判定が簡素化されます。ミーティングのスケジュールも自動化されます。これにより、ダウンロードを検索するために費やす時間を節約し、アカウントエグゼクティブが潜在的なクライアントとのミーティングにより良く準備できるようになります。各見込み客は、ある時点でAIボットによってインタラクトされます。あなたの好みに応じて、テキスト、メール、またはウェブサイトでメッセージを送信することができます。ミーティングが予定され、見込み客はあなたのセールスプレゼンテーションを聞く準備ができます。 Tact.ai Tact.aiの会話型インターフェイスは、WhatsAppを彷彿とさせ、どんなプラットフォームでも顧客とやり取りすることができます。これにより、CRMが、ビジネスと顧客の間の双方向コミュニケーションのインタラクティブなチャネルに変わることを望んでいます。彼らのサービスの1つであるTact Assistantは、代表者が顧客と直接やり取りする必要がなくなります。Tact Portalは、顧客があなたから受け取るサービスに合わせてビジネスとやり取りするオンラインハブです。 SalesDirector セールスチームは、定期的に多くのデータを記録する必要があります。AI営業アシスタントツールのSalesDirectorは、この情報を自動的に記録します。このシステムが提供する分析と洞察力により、管理者は情報に基づいた意思決定を行うことができます。Google Data Studioに加えて、Power…

オッターに会いましょう:大規模データセット「MIMIC-IT」を活用した最先端のAIモデルであり、知覚と推論のベンチマークにおいて最新の性能を実現しています

マルチファセットモデルは、書かれた言語、写真、動画などの様々なソースからのデータを統合し、さまざまな機能を実行することを目指しています。これらのモデルは、視覚とテキストデータを融合させたコンテンツを理解し、生成することにおいて、かなりの可能性を示しています。 マルチファセットモデルの重要な構成要素は、ナチュラルランゲージの指示に基づいてモデルを微調整する指示チューニングです。これにより、モデルはユーザーの意図をより良く理解し、正確で適切な応答を生成することができます。指示チューニングは、GPT-2やGPT-3のような大規模言語モデル(LLMs)で効果的に使用され、実世界のタスクを達成するための指示に従うことができるようになりました。 マルチモーダルモデルの既存のアプローチは、システムデザインとエンドツーエンドのトレーニング可能なモデルの観点から分類することができます。システムデザインの観点では、ChatGPTのようなディスパッチスケジューラを使用して異なるモデルを接続しますが、トレーニングの柔軟性が欠けているため、コストがかかる可能性があります。エンドツーエンドのトレーニング可能なモデルの観点では、他のモダリティからモデルを統合しますが、トレーニングコストが高く、柔軟性が制限される可能性があります。以前のマルチモーダルモデルにおける指示チューニングのデータセットには、文脈に沿った例が欠けています。最近、シンガポールの研究チームが提案した新しいアプローチは、文脈に沿った指示チューニングを導入し、このギャップを埋めるための文脈を持つデータセットを構築しています。 この研究の主な貢献は以下の通りです。 マルチモーダルモデルにおける指示チューニングのためのMIMIC-ITデータセットの導入。 改良された指示に従う能力と文脈的学習能力を持ったオッターモデルの開発。 より使いやすいOpenFlamingoの最適化実装。 これらの貢献により、研究者には貴重なデータセット、改良されたモデル、そしてより使いやすいフレームワークが提供され、マルチモーダル研究を進めるための貴重な資源となっています。 具体的には、著者らはMIMIC-ITデータセットを導入し、OpenFlamingoの文脈的学習能力を維持しながら、指示理解能力を強化することを目的としています。データセットには、文脈的関係を持つ画像とテキストのペアが含まれており、OpenFlamingoは文脈的例に基づいてクエリされた画像-テキストペアのテキストを生成することを目指しています。MIMIC-ITデータセットは、OpenFlamingoの指示理解力を向上させながら、文脈的学習を維持するために導入されました。これには、画像-指示-回答の三つ組と対応する文脈が含まれます。OpenFlamingoは、画像と文脈的例に基づいてテキストを生成するためのフレームワークです。 トレーニング中、オッターモデルはOpenFlamingoのパラダイムに従い、事前学習済みのエンコーダーを凍結し、特定のモジュールを微調整しています。トレーニングデータは、画像、ユーザー指示、GPTによって生成された回答、および[endofchunk]トークンを含む特定の形式に従います。モデルは、クロスエントロピー損失を使用してトレーニングされます。著者らは、Please view this post in your web browser to complete the quiz.トークンで予測目標を区切ることにより、トレーニングデータを分離しています。 著者らは、OtterをHugging Face Transformersに統合し、研究者がモデルを最小限の努力で利用できるようにしました。彼らは、4×RTX-3090…

このGoogleのAI論文は、さまざまなデバイスで大規模な拡散モデルを実行するために画期的なレイテンシー数値を集めるための一連の最適化を提示しています

モデルのサイズと推論ワークロードは、画像生成のための大規模な拡散モデルが一般的になったために急激に増加しています。リソースの限界により、モバイルコンテキストにおけるオンデバイスML推論のパフォーマンス最適化はデリケートなバランスアクトです。これらのモデルのかなりのメモリ要件と計算要件のため、デバイス上で大規模な拡散モデル(LDM)の推論を実行することは、コスト効率とユーザープライバシーの必要性を考慮すると、さらに大きな障壁を生じます。 基礎モデルの迅速な作成と広範な使用は、人工知能を完全に変革しました。その多様性と写真のようなリアルな画像を生成する能力から、大規模な拡散モデルは多くの注目を集めています。サーバーコストの削減、オフライン機能、強化されたユーザープライバシーは、これらのモデルをユーザーのデバイスにローカルに展開することの利点の一部にすぎません。デバイス上の計算およびメモリリソースの制限により、典型的な大規模な拡散モデルには10億以上のパラメータがあり、困難が生じます。 Googleの研究者たちは、モバイルデバイスにおけるGPUを使用した最速の推論レイテンシを可能にする大規模な拡散モデルの実装の一連の変更を提供しています。これらの更新により、さまざまなデバイスで全体的なユーザーエクスペリエンスが向上し、生成AIの利用範囲が拡大します。 低レイテンシ、強化されたプライバシー、大規模なスケーラビリティなど、サーバーベースの方法に比べて多くの利点を持つオンデバイスモデル推論アクセラレーションは、最近注目を集めています。深層学習で頻繁に使用されるsoftmax演算の複雑さは、さまざまな加速戦略を生み出す動機となっています。ウィノグラード畳み込みは、必要な乗算の数を最小限に抑えることにより、畳み込み計算の効率を向上させるために開発されました。これは、グラフィックス処理ユニット(GPU)にとって特に役立ちます。 Transformerデザインの広範な成功と採用は、注意メカニズムの高速化に関する研究を引き起こしました。 Reformerは、計算コストを削減するために疎な近似を使用し、他の作品は低ランクまたは近似テクニックの組み合わせを使用しています。 FlashAttentionは、ハードウェア構成を考慮した正確な注意アルゴリズムであり、より良いパフォーマンスを実現するために使用されます。 主な焦点は、大規模な拡散モデルを使用して書かれた説明からビジュアルを作成するという課題にあります。提案された改善内容がStable Diffusionアーキテクチャとどのように機能するかに焦点が当てられているにもかかわらず、これらの最適化は他の大規模な拡散モデルにも簡単に転送できることは重要です。テキストからの推論は、逆拡散プロセスを誘導するために、望ましいテキストの説明に基づく追加の調整が必要です。 LDMのノイズリダクションモデルで広く使用される注意ブロックは、改善の主要な領域を示しています。モデルは、入力に注意ブロックの重みをより与えることで、関連する情報に絞り込むことができます。注意モジュールは、複数の方法で最適化することができます。以下に詳細を記載された2つの最適化のうち、どちらが最良の結果をもたらすかに応じて、研究者は通常1つだけを利用します。 最初の最適化である部分的に融合されたsoftmaxは、行列の乗算と統合することにより、注意モジュールのsoftmax中に読み取られ、書き込まれるメモリ量を減らします。もう1つの微調整では、I/Oに配慮した正確な注意方法であるFlashAttentionを使用します。 GPUからの高帯域幅メモリアクセスの数を減らすことで、メモリ帯域幅の制限があるアプリケーションには優れた選択肢です。多数のレジスタが必要であり、彼らは、この方法が特定のサイズのSRAMに対してのみ機能することを発見しました。したがって、彼らは特定のサイズの注意行列に対して、一部のGPUでのみこの方法を使用します。 さらに、チームは、LDMの一般的に使用されるレイヤーやユニットの融合ウィンドウが、商用GPUアクセラレートML推論エンジンで現在使用可能なものよりもはるかに大きくなければならないことが判明しました。標準的な融合ルールの制限を考慮して、彼らは、より幅広い種類のニューラルオペレータを実行できるカスタム実装を考案しました。彼らの注意は、ガウス誤差線形ユニット(GELU)とグループ正規化層の2つのサブフィールドに向けられました。 モデルファイルサイズの制限、大量のランタイムメモリ要件、および長時間の推論レイテンシは、デバイス自体での大規模なモデルのML推論を行う際の重要な障害となっています。研究者は、メモリ帯域幅の使用が主要な制約であることを認識しました。したがって、ALU /メモリ効率比を健全に保ちながら、メモリ帯域幅の利用を改善することに焦点を当てました。彼らが実証した最適化は、記録的なレイテンシ値を持つさまざまなデバイスで大規模な拡散モデルを実行することを可能にしました。これらの改善により、モデルの適用範囲が拡大し、幅広いデバイスでユーザーエクスペリエンスが向上しました。

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.