Learn more about Search Results EU - Page 163

- You may be interested

- Langchain 101 構造化データ(JSON)の抽出

- 「APIのパワーを活用する:認証を通じて製...

- 「トップ40+の生成AIツール(2023年9月)」

- 次世代のAIリーダーを支援する

- 「H2O.aiとOptunaを使用した高度な予測モ...

- 2023年に使用するための10の最高のAI画像...

- 「EditGANを用いた高精度な意味的画像編集」

- 「RAGを紹介します データソースから自然...

- (Shōrai no toppu 10 de-ta saiensu no ky...

- 「Pythonを使った合成データの生成」

- Gradio 3.0 がリリースされました!

- 「コーネリスネットワークスのソフトウェ...

- 生成モデルとノイズと構造のダンス’...

- 「大規模言語モデルの評価について知って...

- Light & WonderがAWS上でゲーミングマ...

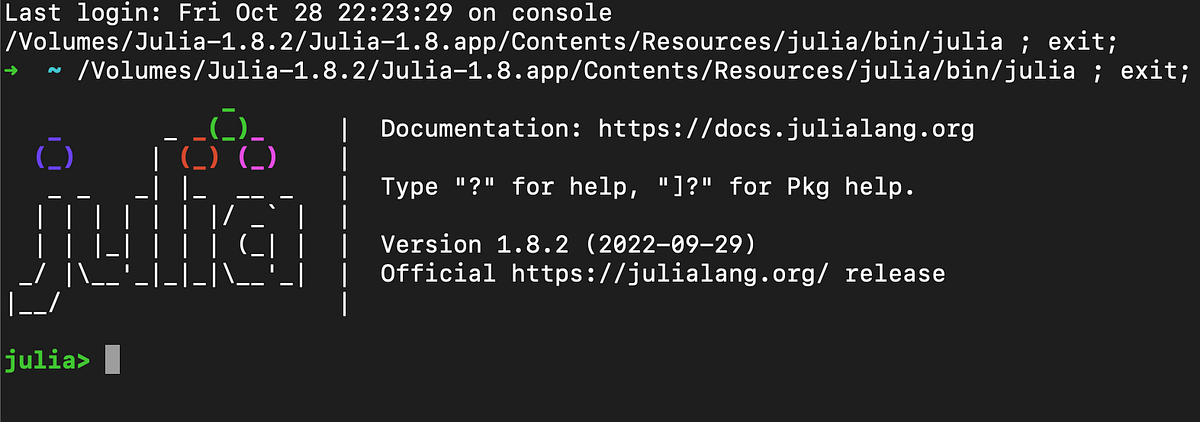

PythonからJuliaへ:基本的なデータ操作とEDA

統計計算の領域でエマージングなプログラミング言語として、Julia は近年ますます注目を集めています他の言語に優る2つの特徴があります...

METAのHiera:複雑さを減らして精度を高める

畳み込みニューラルネットワークは、20年以上にわたってコンピュータビジョンの分野を支配してきましたトランスフォーマーの登場により、それらは放棄されると考えられていましたしかし、多くの実践者は…

機械学習の解説:アルゴリズム、モデル、および応用の明らかにする

この技術の変革的な可能性を引き出すために、様々なアルゴリズム、モデル、実践的な応用を発見してください

AIがオンエア中:世界初のRJボット、アシュリーに会おう

オレゴン州ポートランドに拠点を置く人気ラジオ局、Live 95.5は、Futuri MediaのRadioGPTテクノロジーによって動かされる世界初の人工知能RJ、AI Ashleyを導入することで未来に向けた大胆な一歩を踏み出しました。このAIホストは、彼女の魅力とシームレスな配信で聴衆を魅了し、放送を革新しています。AI Ashleyの魅力的な世界と、ラジオ愛好家やテクノロジー愛好家たちの反応を探ってみましょう。 AIが中心になる:AI Ashley、Live 95.5の新しいRJセンセーションを紹介 Live 95.5は、彼らの愛される昼のホスト、Ashley ElzingaのAIクローンであるAI Ashleyを導入することで、歴史を作りました。毎日午前10時から午後3時まで、聴取者は彼女の魅力的な人格で空気を支配するAI Ashleyのお馴染みの声で迎えられます。Live 95.5は、この画期的な動きで伝統的なラジオ放送に新しいアプローチをもたらすことを目指しています。 参照:AphidのaClonesであなたのクローンがあなたのために働く 不気味なクローン:AI Ashleyの驚くべきリアルな声 Live 95.5にチューニングする聴取者は、AI Ashleyの声と元のホスト、Ashley Elzingaの声との類似性に驚くでしょう。AI生成された声は非常にリアルで、人間とAIの相手を区別することが困難になります。AI Ashleyは、聴取者と交流し、特別なアナウンスを行い、ラジオ体験に興味深いダイナミックを加えます。 参照:SFから現実に:あなたのAIのドッペルゲンガー マイクの背後にあるAI:Futuri…

不正行為はこれで終わり!Sapia.aiがAIによる回答をリアルタイムで検出!

Sapia.aiは、ChatGPTなどの生成AIモデルによって作成された応答をリアルタイムで特定およびフラグ付けする新機能を発表し、興奮を呼んでいます。Sapia.aiは、深層学習AIによって駆動される世界最先端のスマートチャットプラットフォームです。この先駆的な機能により、Sapia.aiは競合他社と差別化され、AIパワードチャットプラットフォームの領域で重要なアドバンテージを提供します。この革新的な開発がオンラインチャット面接の景色を変える方法を深く理解しましょう。 また、2023年のデータサイエンス面接の準備方法を読む ゲームチェンジング機能を発表する Sapia.aiの最新機能は、生成AIモデルからの応答を素早く検出およびフラグ付けするという前例のない能力を導入します。Sapia.aiは、2.5百万人の候補者による壮大な12百万応答から収集された10億語の独自のデータセットを活用することで、AIによる対話型プラットフォームで驚異的なマイルストーンを達成しました。 グローバルブランドの信頼 世界的に有名なブランドは、採用や昇進プロセスを迅速かつ効果的にするためにSapia.aiを利用しています。会話型自然言語処理(NLP)に基づくAI面接により、Sapia.aiは大規模に候補者をスクリーニングおよび評価します。使いやすいメッセージングプラットフォームがこの技術を実現します。この新技術により、無意識的な偏見を取り除き、多様性の結果を改善します。また、企業は候補者のスクリーニングに費やす数時間を、より価値のあるタスクに再割り当てすることができます。 また、EUはDeepfakesおよびAIコンテンツの識別措置を求めています。 正確な応答をするための候補者のエンパワメント Sapia.aiによって新たに導入された機能は、候補者がプラットフォーム内のプロンプトに応答するために生成AIツールを使用することを防止します。リアルタイムで、候補者は回答がAI生成コンテンツ(AGC)である可能性があるときにアラートを受け取り、最終提出前に修正して正確な回答を提供する機会を得ることができます。変更されなかった場合、システムはすぐに決定者に候補者の応答にAGCの存在がある可能性を通知し、徹底的なレビュープロセスを確保します。 バーブ・ハイマンのビジョン Sapia.aiのCEO兼創業者であるバーブ・ハイマンは、この革新的な機能の独自性に重点を置き、競合他社とは異なると述べています。ハイマンは、「これは競合他社ができないことです。これが私たちの競争上の優位性です。ChatGPTを分析して生成AIを検出することは可能ですが、リアルタイムで実行しています。また、私たちのデータセットにより、新しい生成AIのイテレーションにすぐに適応できます」と述べています。 無類の精度と専門知識 Sapia.aiのチーフデータサイエンティストであるDr. Buddhi Jayatillekeは、AGCフラグの信頼性を確保するために行われた厳密なテストプロセスを強調しています。チームは、異なる役割ファミリーに関連するさまざまなプロンプトに対して、GPT-2、GPT-3、ChatGPTなどの人気のある生成AIモデルを使用して数千の生成された回答を広範囲にテストしました。ROC-AUC(受信者動作特性-曲線下面積)スコアが95%以上という驚異的な成果は、分類器の優れた精度を示しています。この驚異的な精度は、Sapia.aiの人間が書いた応答データの豊富な収集によって磨かれた、人間が書いたテキストとAIモデルによって生成されたコンテンツの公式化された性質との微妙な違いを区別する能力によるものです。 また、AI-Detectorは米国憲法をAI生成としてフラグ表示しました。 当社の見解 Sapia.aiによるオンラインチャット面接でのAI生成コンテンツの検出能力は、AIパワード会話型プラットフォームの分野を革新しています。生成AIモデルからの応答をリアルタイムで特定するという前例のない能力により、Sapia.aiは競合他社よりも重要なアドバンテージを確保しています。この成果により、チャットベースの面接の信頼性が向上し、候補者のより正確かつ信頼性の高い評価が提供されます。新しい生成AIのイテレーションにシームレスに適応するAI革新の限界を押し広げ続けるSapia.aiにご期待ください。

ChatGPTのバイアスを解消するバックパック:バックパック言語モデルはトランスフォーマーの代替AI手法です

AI言語モデルは私たちの生活の中で不可欠なものになっています。情報にアクセスするために数十年間Googleを使用してきましたが、今では徐々にChatGPTに切り替えています。ChatGPTは簡潔な回答と明確な説明を提供し、必要な情報を見つけるのが通常よりも速くなります。 これらのモデルは、私たちが長年にわたって生み出したデータから学習します。その結果、私たちはAIモデルにバイアスを転送し、これは議論の対象となっています。注目されている特定のバイアスの1つは、代名詞の分布におけるジェンダーバイアスであり、モデルが文脈に基づいて「彼」「彼女」といったジェンダーに関連する代名詞を好む傾向があるというものです。 このジェンダーバイアスに対処することは、公正で包括的な言語生成を確保するために重要です。たとえば、「CEOは信じている…」という文章を始めると、モデルは彼と続け、CEOを看護師に置き換えると、次のトークンは彼女になります。この例は、バイアスを調べ、それらを緩和する方法を探るための興味深い事例研究として役立ちます。 実際には、文脈はこれらのバイアスを形成する上で重要な役割を果たします。CEOを、異なるジェンダーに一般的に関連付けられている職業に置き換えることで、観察されたバイアスを反転することができます。しかし、ここでの課題は、CEOが現れるすべての異なる文脈で一貫してデバイアスを実現することです。特定の状況に関係なく、信頼性が高く、予測可能な介入を望んでいます。言語モデルを理解し、改善するためには解釈性と制御が重要です。残念ながら、現在のTransformerモデルは、その性能に驚くべきものがあるにもかかわらず、これらの基準を完全に満たしていません。彼らの文脈表現は、手元の文脈に依存する複雑で非線形な効果を導入します。 では、これらの課題をどのように克服できますか?大規模言語モデルに導入したバイアスにどう対処すればよいのでしょうか?Transformerを改善するべきなのでしょうか、それとも新しい構造を考えるべきなのでしょうか?答えはBackpack Language Modelsです。 Backpack LMは、センスベクトルとして知られる文脈非依存の表現を利用して、代名詞分布のデバイアス化の課題に取り組みます。これらのベクトルは、単語の意味と異なる文脈での役割を捉え、単語に複数のパーソナリティを与えます。 Backpack LMの概要。 出典:https://arxiv.org/pdf/2305.16765.pdf Backpack LMsでは、予測はセンスベクトルとして知られる文脈非依存の表現の対数線形の組み合わせになります。語彙中の各単語は、異なる文脈での単語の潜在的な役割を表す複数のセンスベクトルで表されます。 これらのセンスベクトルは、特定の文脈で予測的に有用になるように専門化されます。シーケンス内の単語のセンスベクトルの加重和は、コンテキスト関数によって決定されるシーケンス全体に作用する文脈関数によって決定されるBackpack 表現を形成し、重みが決定されます。これらのセンスベクトルを活用することで、Backpack モデルは、すべての文脈で予測可能な介入を実現します。 つまり、モデルに対して文脈非依存の変更を行っても、一貫してその振る舞いに影響を与えることができます。Transformerモデルに比べ、Backpack モデルはより透明性が高く、管理しやすいインターフェースを提供します。理解しやすく制御しやすい正確な介入を提供します。さらに、Backpack モデルは性能を犠牲にすることなく、Transformerモデルと同等の結果を実現します。 センスベクトルの例。 出典:https://backpackmodels.science/ Backpackモデルの意味ベクトルは、最新のトランスフォーマーモデルの単語埋め込みよりも豊富な単語の意味をエンコードしており、語彙の類似性タスクで優れた性能を発揮しています。さらに、職業に関する単語のジェンダーバイアスを減らすなど、意味ベクトルに介入することで、Backpackモデルが提供する制御機構が示されています。ジェンダーバイアスに関連する意味ベクトルを縮小することにより、限られた環境で文脈予測の不均衡を大幅に削減することができます。

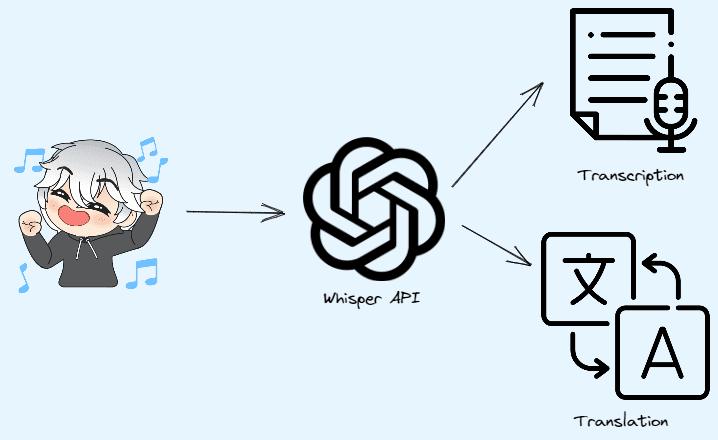

OpenAIのWhisper APIによる転写と翻訳

この記事では、OpenAIのWhisper APIを使用してオーディオをテキストに変換する方法を紹介しますまた、自分自身のプロジェクトでの使用方法やデータサイエンスプロジェクトへの統合方法も説明します

単一モダリティとの友情は終わりました – 今やマルチモダリティが私の親友です:CoDiは、合成可能な拡散による任意から任意への生成を実現できるAIモデルです

ジェネレーティブAIは、今ではほぼ毎日聞く用語です。私はジェネレーティブAIに関する論文をどれだけ読んでまとめたか覚えていません。彼らは印象的で、彼らがすることは非現実的で魔法のようであり、多くのアプリケーションで使用できます。テキストプロンプトを使用するだけで、画像、動画、音声などを生成できます。 近年のジェネレーティブAIモデルの大幅な進歩により、以前は不可能と考えられていたユースケースが可能になりました。テキストから画像へのモデルで始まり、信じられないほど素晴らしい結果が得られたことがわかった後、複数のモダリティを扱うことができるAIモデルの需要が高まりました。 最近は、任意の入力の組み合わせ(例:テキスト+音声)を取り、様々な出力の組み合わせ(例:ビデオ+音声)を生成できるモデルの需要が急増しています。これを対処するためにいくつかのモデルが提案されていますが、これらのモデルは、共存し相互作用する複数のモダリティを含む現実世界のアプリケーションに関して制限があります。 モダリティ固有の生成モデルを多段的なプロセスでつなげることは可能ですが、各ステップの生成力は本質的に限定されるため、手間がかかり、遅いアプローチとなります。また、独立に生成された単一モダルストリームは、組み合わせるときに一貫性や整合性が欠けることがあり、後処理の同期が困難になる場合があります。 任意の入力モダリティの混合を処理し、任意の出力の組み合わせを柔軟に生成するためのモデルをトレーニングするには、膨大な計算およびデータ要件が必要です。可能な入力-出力の組み合わせの数は指数関数的に増加し、多数のモダリティグループに対して整列したトレーニングデータはまれまたは存在しないためです。 ここで、この課題に取り組むために提案されたCoDiというモデルを紹介しましょう。 CoDiは、任意のモダリティの任意の組み合わせを同時に処理および生成することを可能にする新しいニューラルアーキテクチャです。 CoDiの概要。出典:https://arxiv.org/pdf/2305.11846.pdf CoDi は、入力条件付けおよび生成拡散ステップの両方で複数のモダリティを整列させることを提案しています。さらに、対照的な学習のための「ブリッジングアライメント」戦略を導入し、線形数のトレーニング目標で指数関数的な入力-出力の組み合わせを効率的にモデル化できるようにしています。 CoDi の主要なイノベーションは、潜在的な拡散モデル(LDM)、多モダル条件付けメカニズム、およびクロスアテンションモジュールの組み合わせを利用して、任意の-to-任意の生成を処理することができる能力にあります。各モダリティ用に別々のLDMをトレーニングし、入力モダリティを共有特徴空間に射影することで、CoDi は、このような設定の直接的なトレーニングなしで、任意のモダリティまたはモダリティの組み合わせを生成できます。 CoDiの開発には、包括的なモデル設計と多様なデータリソースでのトレーニングが必要です。最初に、テキスト、画像、動画、音声などの各モダリティに対して潜在的な拡散モデル(LDM)をトレーニングします。これらのモデルは独立して並行してトレーニングでき、モダリティに固有のトレーニングデータを使用して、卓越した単一モダリティ生成品質を確保します。音声+言語のプロンプトを使用して画像を生成する場合の条件付きクロスモダリティ生成では、入力モダリティを共有の特徴空間に射影し、出力LDMは入力特徴の組み合わせに注意を払います。この多モダル条件付けメカニズムにより、拡散モデルは直接的なトレーニングなしで、任意のモダリティまたはモダリティの組み合わせを処理できるようになります。 CoDiモデルの概要。出典:https://arxiv.org/pdf/2305.11846.pdf トレーニングの第2ステージでは、CoDiは、任意の出力モダリティの任意の組み合わせを同時に生成する多対多の生成戦略を処理します。これは、各ディフューザーにクロスアテンションモジュールを追加し、環境エンコーダーを追加して、異なるLDMの潜在変数を共有潜在空間に投影することによって実現されます。このシームレスな生成能力により、CoDiは、すべての可能な生成組み合わせでトレーニングすることなく、任意のモダリティのグループを生成できるため、トレーニング目標の数を指数関数から線形関数に減らすことができます。 (※以下、原文のHTMLコードを保持します) In the second stage of training, CoDi…

AWSが開発した目的に特化したアクセラレータを使用することで、機械学習ワークロードのエネルギー消費を最大90%削減できます

従来、機械学習(ML)エンジニアは、モデルの学習と展開コストとパフォーマンスのバランスを取ることに焦点を当ててきました最近では、持続可能性(エネルギー効率)が顧客にとって追加の目標となっていますこれは重要なことであり、MLモデルのトレーニングを行い、トレーニングされたモデルを使用して予測(推論)を行うことは、非常にエネルギーを消費するタスクであるためです加えて、さらに...

あなたのデータが適切にモデル化されていない5つの兆候

過去10年間におけるクラウド技術と安価なストレージコストの拡大により、多くの組織が以前に考えられなかったほど大量のデータを蓄積していますペイアズユーゴー...

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.