Learn more about Search Results ML - Page 14

- You may be interested

- OpenAIのLLMの支配を覆すことを目指す挑戦...

- 「ChatGPTの高度な設定ガイド – Top...

- 新しい – Amazon SageMaker Canvas...

- 「NumPyのドット積のデコード:次元の魔術...

- ウィスコンシン大学とバイトダンスの研究...

- 「RAGとLLM:動的言語モデリングの新たな...

- AI生成アート:倫理的な意義と議論

- マイクロソフトの研究者は、2段階の介入フ...

- 品質管理パトロール:スタートアップが車...

- 古い地図を使って、失われた地域の3Dデジ...

- 「トグルスイッチ」は、量子コンピュータ...

- DPT(Depth Prediction Transformers)を...

- 「2023年のスポーツアナリティクスについ...

- 「Cheat Sheetつきで始めるグラフデータベ...

- 「ChatGPTのような大規模言語モデルによる...

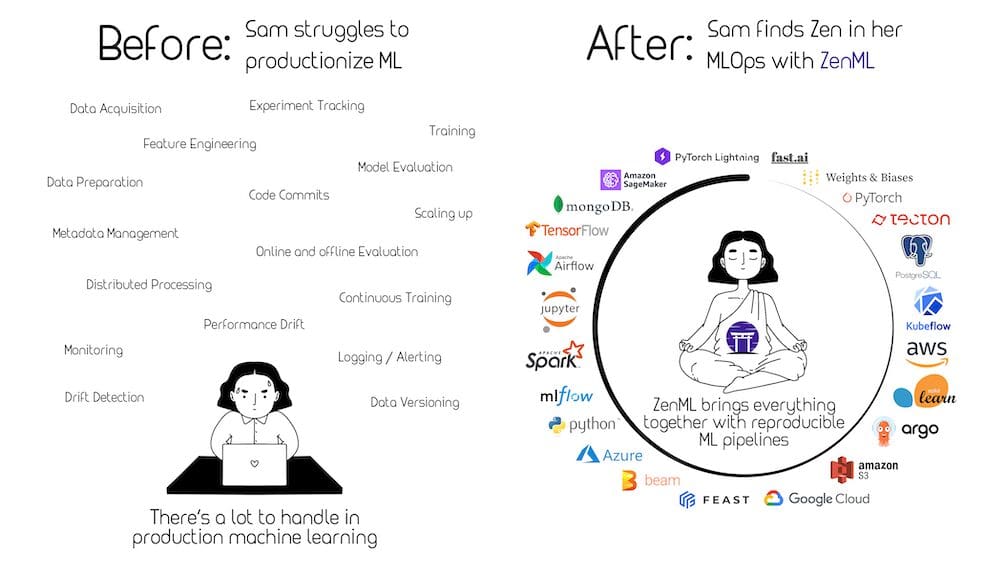

「MLOpsに関する包括的なガイド」

「Machine Learning Operations(MLOps)は、機械学習(ML)モデルが本番環境で繁栄するために必要な構造とサポートを提供する比較的新しい学問分野です」

「MLにより、がんの診断と治療に助けが期待されます」

特定のタイプのがんの診断を支援し、最も効果的な治療法を選択するために新しい機械学習アルゴリズムが設計されました

実験から展開へ:MLflow 101 | パート02

こんにちは👋、そしてこのブログの第2セグメントへの暖かい歓迎です!もし最初から一緒にいてくれたなら、最初の部分では…

Langchain、Weviate、およびStreamlitを使用してカスタムAIベースのチャットボットを構築する

「複数の組織がカスタマイズされたLLMを構築するために競争している中で、私によく聞かれる共通の質問は、このプロセスを効率化するためのツールは何があるのかということですこの記事では、私がどのように...を紹介します」

実験から展開へ MLflow 101 | パート01

こんな感じで想像してみてください:新しいビジネスアイデアが浮かび、必要なデータがすぐに手元にあるとしますあなたは素晴らしい機械学習モデルを作り出すことにワクワクしています🤖しかし、実際には...

AIは人間過ぎるようになったのでしょうか?Google AIの研究者は、LLMsがツールのドキュメントだけでMLモデルやAPIを利用できるようになったことを発見しました!

人工知能が地球を支配しようとする現代において、大規模な言語モデルは人間の脳により近づいています。Googleの研究者たちは、大規模な言語モデルが各ツールのドキュメンテーションを提供するだけで事前のトレーニングなしに未知のツールをゼロショットで使用できることを証明しました。 この解決策全体を、4歳のオードリーに自転車の乗り方を教えることに例えることができます。最初に、彼女に自転車の乗り方を教え、学ぶのを手伝いました(デモンストレーション)。トレーニングホイールを使って乗る方法と、トレーニングホイールを使わずに乗る方法を彼女に示しました。つまり、さまざまなシナリオを彼女に見せました。この解決策は、彼女が本(ドキュメント)で自転車の乗り方を読み、自転車のさまざまな機能について学び、私たちの助けなしで乗ることができるようになった部分に対応しており、それを非常に印象的に行っています。彼女はスキッドすることができ、トレーニングホイールを使ったり使わずに乗ることができます。ここにオードリーが成長した様子が見えますね? デモンストレーション(デモ)は、少数の例を使用して言語モデルにツールの使用方法を教えます。存在するすべてのツールプランをカバーするためには、多くの例が必要かもしれません。ドキュメンテーション(ドキュメント)は、ツールの機能を説明することで言語モデルにツールの使用方法を教えます。 ドキュメントとデモをプロンプトに含める/除外する組み合わせ、およびデモの数を変えて、モデルの結果とパフォーマンスを分析しました。さまざまなツールセットを使用して、複数のモダリティにまたがる6つのタスクで実験が行われました。使用されたLLMプランナーはChatGPT(gpt-3.5-turbo)で、6つのタスクは以下の通りです:ScienceQAにおけるマルチモーダルな質問応答、TabMWTabMWP(数学推論データセット)における表形式の数学推論、NLVRv2におけるマルチモーダルな推論、新たに収集されたデータセットにおける未知のAPIの使用、自然言語による画像編集、およびビデオトラッキング。 彼らは、各データセットでツールのドキュメンテーションを使用した場合と使用しなかった場合のモデルのパフォーマンスを、異なる数のデモンストレーション(デモ)で評価しました。調査結果は、ツールのドキュメント化によってデモンストレーションの必要性が低下することを示しています。ツールのドキュメントがある場合、モデルはデモンストレーションの数が削減されても安定したパフォーマンスを維持するようですが、ツールのドキュメントがない場合、モデルのパフォーマンスは使用されるデモンストレーションの数に非常に敏感であることが示されました。 品質の比較を通じて、ドキュメントに頼ることは、大規模な言語モデルが多数の利用可能なツールを備えるためのスケーラブルな解決策を提供することがわかりました。さらに、ツールのドキュメントだけでLLMは最新のビジョンモデルを理解し、新しいデモを必要とせずに画像編集やビデオトラッキングのタスクで印象的な結果を達成することができます。研究者は、結果が非常に印象的で別のブレークスルーを示唆しているものの、ドキュメントの長さが600ワードを超えると性能が低下することを発見しました。 結果として、この論文はLLMがドキュメンテーションを通じてツールを学ぶだけでなく、追加のデモンストレーションなしで「Grounded SAM」と「Track Anything」などの人気プロジェクトの結果を再現することを示し、ツールのドキュメントを通じた自動的な知識の発見の可能性を示唆しています。これにより、LLMにおけるツールの使用の視点において新たな方向性がもたらされ、モデルの推論能力を明らかにすることを目指しています。

ベントMLを使用したHugging Faceモデルのデプロイ:DeepFloyd IFのアクション

Hugging Faceは、モデルを簡単にアップロード、共有、展開することができるHubプラットフォームを提供しています。これにより、モデルをゼロからトレーニングするために必要な時間と計算リソースを開発者が節約することができます。ただし、実世界のプロダクション環境やクラウドネイティブの方法でモデルを展開することはまだ課題があります。 ここでBentoMLが登場します。BentoMLは、機械学習モデルのサービングと展開のためのオープンソースプラットフォームです。これは、従来の、事前トレーニング済みの、生成モデルおよび大規模言語モデルを組み込んだ本番向けのAIアプリケーションを構築、出荷、スケーリングするための統一されたフレームワークです。以下は、BentoMLフレームワークを高レベルで使用する方法です: モデルの定義:BentoMLを使用するには、機械学習モデル(または複数のモデル)が必要です。このモデルは、TensorFlowやPyTorchなどの機械学習ライブラリを使用してトレーニングできます。 モデルの保存:トレーニング済みのモデルをBentoMLのローカルモデルストアに保存します。これは、すべてのトレーニング済みモデルをローカルで管理し、サービングにアクセスするために使用されます。 BentoMLサービスの作成:モデルをラップし、サービスのロジックを定義するためにservice.pyファイルを作成します。これは、モデルの推論をスケールで実行するためのランナーを指定し、入力と出力の処理方法を定義するAPIを公開します。 Bentoのビルド:構成YAMLファイルを作成することで、すべてのモデルとサービスをパッケージ化し、コードと依存関係を含む展開可能なアーティファクトであるBentoを作成します。 Bentoの展開:Bentoが準備できたら、Bentoをコンテナ化してDockerイメージを作成し、Kubernetes上で実行することができます。または、Bentoを直接Yataiに展開することもできます。Yataiは、Kubernetes上での機械学習デプロイメントを自動化および実行するためのオープンソースのエンドツーエンドソリューションです。 このブログ投稿では、上記のワークフローに従ってDeepFloyd IFをBentoMLと統合する方法をデモンストレーションします。 目次 DeepFloyd IFの簡単な紹介 環境の準備 BentoMLモデルストアへのモデルのダウンロード BentoMLサービスの開始 Bentoのビルドとサービスの提供 サーバーのテスト 次のステップ DeepFloyd IFの簡単な紹介 DeepFloyd IFは、最先端のオープンソースのテキストから画像へのモデルです。Stable Diffusionのような潜在的な拡散モデルとは異なる運用戦略とアーキテクチャを持っています。…

RecList 2.0 オープンソースによるMLモデルの体系的なテストシステム

評価は複雑な問題です評価パイプラインの作成に関与するさまざまなコンポーネントを管理することはしばしば困難ですモデルがどこかにあって、それをロードし、...

「ビジュアルで高速にMLパイプラインを構築する方法!」

最近のディープラーニングの進歩が、リアルタイムメディアの使用例において、たくさんの機械学習(ML)モデルを生み出すことがどれほど注目されるべきか無視するのは難しいです例えば、背景を変える能力など様々な例があります

MLコードを保守しやすくするためのソフトウェアエンジニアリングのベストプラクティス

従来のソフトウェアエンジニアリングプロジェクトとは異なり、MLのコードベースは複雑で進化し続ける性質のため、コードの品質が遅れる傾向がありますこれにより、技術的な負債が増加し、...

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.