Learn more about Search Results 子供 - Page 14

- You may be interested

- 「ODSC East 2024 Pre-Bootcamp Primer コ...

- 「目標をより早く達成するための25のChatG...

- 「Llama 2内のストップ生成の課題」

- コンピュータビジョンの進歩:画像認識の...

- トップAIアドベンチャー:OpenAIレジデンシー

- AIとオープンソースソフトウェア:誕生時...

- 業界固有のAIのナビゲーション:移行期の...

- 「データプラットフォームから機械学習プ...

- LGBTQ+コミュニティをAI研究で支援する

- 「チャットGPTとBardの無料版の実用的な比...

- 「2023年に注目すべき10の環境テック企業」

- 「ドメイン固有のLLMポーションの調合」

- 光を乗りこなす:Sunswift RacingがWorld ...

- 技術系の職種に応募する

- 「IBMが人工知能を搭載した脅威検知および...

「Google LLMは、ドキュメントを読むだけでツールをマスターできる」

急速な技術の進歩の時代において、人工知能(AI)は時折、人間のような驚異的な進歩を遂げています。Googleの研究者たちは画期的な成果を発表しました。大規模言語モデル(LLM)は、単なるツールのドキュメントを手助けにするだけで、機械学習(ML)モデルとAPIを活用することができるようになりました。この発見により、AIと人間のような能力の融合についての議論が巻き起こりました。 また読む:人工知能 vs 人間の知能:トップ7の違い オードリー効果:AIに自転車の乗り方を教える 4歳のオードリーという名前の子供に自転車の乗り方を教えることを想像してみてください。初めは補助輪から始め、さまざまなシナリオを通じて彼女を導き、最終的にはオードリーが自信を持って乗るようになります。同様に、Googleの研究者たちはドキュメントを通じてLLMにツールの機能を紹介し、事前のトレーニングなしにこれらのツールを操作することができるようにしました。まるでオードリーが本でそれについて読んで自転車の乗り方を学んだかのような、印象的で独立した方法です。 また読む:メタがテキスト、画像、音声を同時にトレーニングしたAIモデルをオープンソース化 デモからドキュメントへ:新しい光でAIを教える 歴史的には、AIモデルはデモンストレーション(デモ)を通じてツールを学習していました。多くの例が必要でした。Googleの画期的な手法はこれを変えました。彼らはツールのドキュメント(ドキュメント)を使用してLLMに教え、各使用ケースをデモする代わりにツールの機能を説明しました。この新しい手法は、AIがツールの理解を拡大し、効果的にツールの機能を探索する能力を高めることを目指しています。 AIの卒業:多岐にわたるタスク この新しい手法の力を評価するために、Googleの研究者はLLMをさまざまなタスクに従事させました。これには、マルチモーダルな質問応答、表形式の数学的推論、マルチモーダルな推論、APIの未知の使用、画像編集、ビデオトラッキングなどが含まれます。ChatGPTとして知られるモデルは徹底的にテストされ、その結果は驚くべきものでした。 また読む:AIは今や見たり聞いたりできる:マルチモーダルAIの世界へようこそ パフォーマンスの公開:ツール+ドキュメント vs デモ Googleの実験により、ドキュメントがLLMのパフォーマンスに与える影響が明らかになりました。ツールのドキュメントを持っている場合、モデルのパフォーマンスはデモの数が減少しても一定の水準を保ちます。ただし、ツールのドキュメントがない場合、モデルのパフォーマンスはデモの数の変動に対して脆弱になります。これは、ドキュメントが多目的なツールの利用能力を備えたAIモデルに与える重要な役割を示しています。 また読む:GPTBotの公開:WebをクロールするOpenAIの大胆な動き AIの驚異的な偉業:ツールのドキュメントの力 特筆すべきことに、ツールのドキュメントは人工知能の訓練と開発において画期的な変化をもたらします。研究者たちは、ツールのドキュメントだけで駆動されるLLMが、画像編集やビデオトラッキングなどのタスクにおいて最近のビジョンモデルを巧みに使用できることを実証しました。この成果により、ツールの使用が簡素化され、AIの自律的な知識の発見の可能性が示唆されます。ただし、ドキュメントの長さが600語を超えると、モデルの制約が明らかになります。 未来への一瞥:影響と発見 ツールの使用に加えて、Googleの調査結果は、ツールのドキュメントを通じた自動的な知識の発見への飛躍を意味しています。この研究は、AIの認知能力とツールの利用能力との間のギャップを埋めるものです。追加のデモンストレーションなしで人気のあるプロジェクトを再現することにより、AIの未来は限りなく広がり、その推論能力の新たな次元を明らかにする可能性があります。 私たちの意見 Googleの研究は、AIの驚異的な進化を示し、可能性の範囲を広げるものです。人工知能がツールのドキュメントを通じてMLモデルとAPIをマスターすることで、効率性の向上だけでなく、AIシステム内での自己発見の可能性を解き明かします。AIとツールのドキュメントの交差点は、人間のような能力と技術的な優位性が出会う領域への重要な一歩です。

「AIを使わない人々の7つの愚かな理由」

「今では誰もが人工知能を使っていますあなたのいとこがMidjourneyを使って劇的なアニメ風のシーンを作るために使っていたり、お母さんがレシピを簡単にするために使っていたりするのを見ても、AIはもはや夢物語ではありません無数の無料で使いやすくリソースに優しいツールが存在しているため、AIの恩恵を受けることができる人に理由がないのです...」

UCバークレーの研究者は、Dynalangを紹介しますこれは、未来のテキストおよび画像表現を予測するためにマルチモーダルなワールドモデルを学習するAIエージェントであり、想像されたモデルのロールアウトからの行動を学習します

自然言語を使用して現実世界で人々と自然にコミュニケーションできるボットを作成することは、人工知能の目標の一つです。現在の具現化エージェントは、「青いブロックを取って」「エレベーターを過ぎて右に曲がって」といった単純で低レベルのコマンドを実行できます。しかし、対話エージェントは「ここと今」の範囲外で人々が言語を使う方法の全て、知識の伝達(例:「左上のボタンでテレビの電源を切る」)、状況情報(例:「牛乳が切れています」)、調整(例:「リビングルームの掃除機はもうした」)を理解できるようにする必要があります。 子供たちが読むテキストや他の人から聞く情報のほとんどは、世界の機能や現在の状況についての情報を伝えています。エージェントが他の言語で話すことを可能にするにはどうすればよいでしょうか?強化学習(RL)は、言語依存のエージェントに問題を解決するための技術です。しかし、現在使用されているほとんどの言語依存のRL技術は、タスク固有の指示からアクションを生成するように訓練されています。たとえば、「青いブロックを取って」という目標の説明を入力とし、一連のモーターコマンドを生成することで訓練されます。自然言語が現実の世界で果たす役割の多様性を考慮すると、言語を最適な行動に直接マッピングすることは難しい学習の課題となります。 作業が片付けである場合、エージェントは次の片付けの手順に移るように答えるべきですが、夕食を提供する場合はボウルを集めるべきです。例えば「私はボウルを片付けました」という場合を考えてみましょう。仕事について話さない場合、言語はエージェントにとって最適な行動と弱い相関関係しか持ちません。その結果、言語を活用して活動を完了するためにさまざまな言語入力を使用するための学習信号として、タスク報酬のみの言語から活動へのマッピングがより良い学習信号となる可能性があります。代わりに、彼らは言語の統一的な機能は将来の予測を支援することだと提案しています。「私はボウルを片付けました」というフレーズによって、エージェントは将来の観測をより正確に予測することができます(つまり、キャビネットを開ければ中にボウルがあることがわかる)。 この意味で、子供たちが出会う言語の大部分は視覚的な経験に根ざしているかもしれません。エージェントは「レンチはナットを締めるために使用できる」というような事前の情報を使用して環境の変化を予測することができます。エージェントは「パッケージは外にある」というような発言によって観測を予測するかもしれません。このパラダイムは、指示がエージェントが報酬を予想するのに役立つという予測的な用語の下で一般的な指示の従い方を組み合わせています。彼らは、将来の表現を予測することがエージェントに言語を理解し、その言語が外部世界とどのように相互作用するかを理解するのに豊かな学習信号を提供すると主張しています。次のトークンの予測が言語モデルが世界の知識の内部表現を構築するのに役立つように、これらの貢献は示しています。 UCバークレーの研究者は、Dynalangというエージェントを紹介しています。Dynalangはオンラインの経験を通じて世界の言語と視覚モデルを獲得し、そのモデルを理解して行動する方法を利用します。Dynalangは、そのモデルを使用して行動を学習する(タスク報酬を持つ強化学習)と、言語で世界のモデルを学習する(予測ターゲットを持つ教師あり学習)を分離します。世界モデルは、視覚的およびテキストの入力を観測モダリティとして受け取り、それらは潜在空間に圧縮されます。エージェントが周囲と対話する中で収集したデータを使用して、世界モデルを将来の潜在的な表現を予測するように訓練します。世界モデルの潜在的な表現を入力として使用し、タスク報酬を最大化するための意思決定を行うポリシーを訓練します。 世界モデリングは行動とは異なるため、Dynalangは作業やタスク報酬のない単一のモダリティ(テキストのみまたはビデオのみのデータ)で事前に訓練することができます。また、言語生成のためのフレームワークも統一される可能性があります。エージェントの知覚は言語モデルに影響を与えることができます(つまり、将来のトークンに関する予測を行い、行動空間で言語を生成することにより、環境についてコミュニケーションすることができます)。彼らはDynalangをさまざまな言語的文脈を持つさまざまなドメインでテストしています。Dynalangは、ビジョン言語ナビゲーションにおいて、視覚的および言語的に複雑な領域での指示を理解するために、将来の観測、環境ダイナミクス、修正に関する言語的手がかりを利用して、マルチタスクの家庭清掃設定でタスクをより迅速に実行することを学習します。Messengerベンチマークでは、Dynalangはゲームの最も困難なステージに合わせるためにゲームマニュアルを読み込み、タスク固有のアーキテクチャを上回る成績を収めます。これらの貢献は、Dynalangがさまざまなタスクを達成するためにさまざまな形式の言語を理解することを学習し、最先端の強化学習アルゴリズムやタスク固有のアーキテクチャに頻繁に勝ることを示しています。 彼らが行った貢献は以下の通りです: • 彼らは、将来の予測を利用して言語と視覚体験を結びつけるエージェントであるDynalangを提案しています。 • Dynalangは、さまざまな種類の言語を理解し、様々なタスクに取り組むために学習することにより、最新のRLアルゴリズムやタスク固有の設計を凌駕していることを示しています。 • Dynalangの形式は、アクションやタスクのインセンティブなしで、テキストの事前学習と言語生成を組み合わせる能力を含む新たな可能性を開くことを示しています。

データ漏洩:それは何か、なぜ予測システムが失敗する原因となるのか

「データ漏洩は、経験の長さに関係なく、データサイエンティストにとって確かに脅威ですそれは、経験豊富なプロフェッショナルであっても、誰にでも影響を及ぼす現象です…」

「メーカーに会う:開発者がAI搭載ピットドロイドの背後にNVIDIA Jetsonを使う」

ゴラン・ヴクシッチは、スター・ウォーズの映画シリーズに登場するポッドレーサーを修理・保守するタイプの実世界のピットドロイドを作るプロジェクトの主導者です。 エッジAIジェダイは、ドロイド自体の脳としてNVIDIA Jetson Orin Nano Developer Kitを使用しました。このデベロップメントキットにより、高さ4フィート未満であり、目にはシンプルなウェブカメラが備わっているこのボットは、オブジェクトを識別し、その頭を動かすことができます。 クロアチア出身のヴクシッチは、現在はスウェーデンのマルメに拠点を置いています。最近、彼はピットドロイドと共にベルギーとオランダを旅し、いくつかのテックカンファレンスで数百人にプレゼンテーションを行いました。彼は、コンピュータビジョンとAIについて、このドロイドを使った魅力的な実世界のデモとして使用しました。 ピットドロイドが世界を初めて見る瞬間。 自称スター・ウォーズの熱狂的なファンである彼は、仕事の合間にドロイドの機能をアップグレードしています。彼は、コペンハーゲンに拠点を置く企業のエンジニアリングマネージャーとしての仕事に没頭することがないときに、これを行っています。また、彼は、NVIDIA Inceptionプログラムの一員である、革新的なスタートアップsyntheticAIdataの共同創業者兼最高技術責任者でもあります。 syntheticAIdataは、コスト効果の高い合成データを使用してビジョンAIモデルを作成する会社で、3Dツールやアプリケーションを構築および運用するためのNVIDIA Omniverseプラットフォームへのコネクタを使用しています。 メーカーについて NVIDIAによってJetson AIスペシャリスト、そしてMicrosoftによってAIの「最も価値のある専門家」として認定されたヴクシッチは、約10年前にビジョンAIでタトゥーを分類するスタートアップで働いていたときに人工知能とITに取り組み始めました。 それ以来、彼はエンジニアリングおよびテクニカルマネージャーとして働きながら、さまざまな企業向けのIT戦略とソリューションを開発するなど、他の役割も果たしてきました。 彼はいつもロボット工学に興味を持っており、子供の頃からSFファンでした。 「スター・ウォーズや他の映画を見て、ロボットが現実の世界で何を見て何をすることができるのかを想像していました」とヴクシッチは語ります。彼はまた、NVIDIA Developer Programのメンバーでもあります。 今や、彼はNVIDIA Jetsonプラットフォームを使用したピットドロイドプロジェクトでそれを実現しています。この開発者は、ほぼ10年前の最初の製品の発売以来、Jetsonプラットフォームを使用しています。 ヴクシッチがピットドロイドに読み聞かせをしています。…

AIシステム:発見されたバイアスと真の公正性への魅力的な探求

「人工知能(AI)はもはや未来の概念ではありません-それは私たちの生活の一部になっています Visaが1秒間に1,700件のトランザクションを検証し、...を検出するかを考えるのは難しいです...」

「データクリーニングと前処理の技術をマスターするための7つのステップ」

「初めてのデータサイエンスプロジェクトを解決しようとしていますか?このチュートリアルは、機械学習モデルを適用する前にデータセットを準備するためのステップバイステップのガイドを提供します」

「Lab Sessions 実験的なAIの新しいコラボレーションのシリーズ」

Lab Sessionsは、アーティストから学者、科学者から学生まで、さまざまな人々との実験的なAIコラボレーションのシリーズです

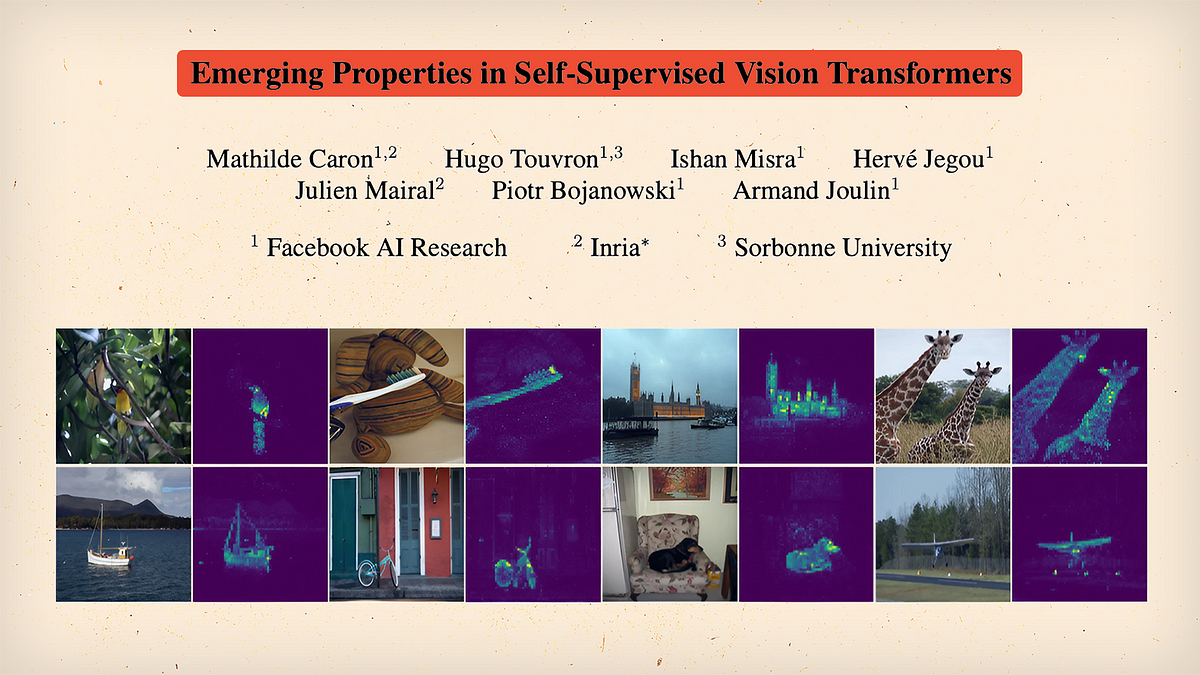

「自己教師あり学習とトランスフォーマー? – DINO論文の解説」

「一部の人々は、Transformerのアーキテクチャを愛し、それをコンピュータビジョンの領域に歓迎しています他の人々は、新しいプレイグラウンドに新しい子供がいることを受け入れたくありません さて、何が起こるのか見てみましょう...」

「UniDetectorであなたが望むものを検出しましょう」

深層学習とAIは、特に検出モデルにおいて、近年驚異的な進歩を遂げてきました。しかし、これらの素晴らしい進展にもかかわらず、物体検出モデルの効果は大規模なベンチマークデータセットに大きく依存しています。しかし、課題は物体のカテゴリやシーンの変動にあります。実世界では、既存の画像とは大きな違いがあり、新しい物体クラスが現れる可能性があり、物体検出器の成功を保証するためにデータセットの再構築が必要です。残念ながら、これは彼らのオープンワールドシナリオでの一般化能力に重大な影響を与えます。これに対して、人間、特に子供でさえも、新しい環境に素早く適応し、よく一般化する能力を持っています。その結果、AIシステムと人間の知能の間には普遍性の欠如が残っています。 この制限を克服する鍵は、あらゆる種類の物体を任意のシーンで検出するための普遍的な物体検出器の開発です。このようなモデルは、追加の再トレーニングを必要とせずに未知の状況で効果的に機能する驚異的な能力を持っているでしょう。このような突破口は、物体検出システムを人間と同等に知能を持つものにする目標に大きく近づくでしょう。 普遍的な物体検出器は、2つの重要な能力を持つ必要があります。まず第一に、さまざまな情報源と異なるラベル空間からの画像を使用してトレーニングする必要があります。分類と位置検出のための大規模な共同トレーニングは、検出器が効果的に一般化するための十分な情報を獲得するために重要です。理想的な大規模学習データセットは、多くの画像タイプを含み、可能な限り多くのカテゴリを網羅し、高品質のバウンディングボックス注釈と広範なカテゴリの語彙を備えている必要があります。残念ながら、このような多様性を実現することは、人間の注釈者による制約のために困難です。実際には、小規模な語彙のデータセットはよりきれいな注釈を提供しますが、大規模なデータセットはノイズが多く、不整合が生じる可能性があります。さらに、専門のデータセットは特定のカテゴリに焦点を当てています。普遍性を達成するためには、検出器は異なるラベル空間を持つ複数の情報源から学ぶ必要があり、包括的で完全な知識を獲得します。 第二に、検出器はオープンワールドにおいて堅牢な一般化能力を示さなければなりません。トレーニング中に見たことのない新しいクラスのカテゴリタグを正確に予測する能力を持っている必要がありますが、視覚情報だけに頼ることはこの目的を達成することができません。包括的な視覚学習には完全に教師あり学習のための人間の注釈が必要です。 これらの制限を克服するために、新しい普遍的な物体検出モデル「UniDetector」が提案されました。 アーキテクチャの概要は、以下のイラストに示されています。 普遍的な物体検出器の2つの重要な能力を実現するためには、2つの対応する課題に取り組む必要があります。第一の課題は、複数の情報源からのトレーニングであり、画像が異なる情報源から来ており、異なるラベル空間と関連付けられています。既存の検出器は、1つのラベル空間からのクラスの予測に限定されており、データセット固有のタクソノミーの違いやデータセット間の注釈の不整合が、複数の異質なラベル空間を統一することを困難にしています。 第二の課題は、新しいカテゴリの識別です。最近の研究における画像テキストの事前トレーニングの成功に触発されて、著者は言語埋め込みを使用して未知のカテゴリを認識するために事前トレーニングされたモデルを活用しています。しかし、完全教師ありトレーニングは、トレーニング中に存在するカテゴリに焦点を当てる傾向があります。その結果、モデルは推論時に基本クラスに偏り、新しいクラスに対しては自信を持たない予測を行う可能性があります。言語埋め込みは新しいクラスを予測する可能性を提供しますが、その性能はまだ基本カテゴリのそれに大きく劣っています。 UniDetectorは、上記の課題に取り組むために設計されています。著者らは言語空間を活用し、異なるラベル空間で効果的に検出器をトレーニングするためにさまざまな構造を探索しています。彼らは、パーティション化された構造を採用することで、特徴の共有を促進し、ラベルの競合を回避することが、検出器のパフォーマンスに有益であることを発見しました。 新しいクラスに対する領域提案段階の一般化能力を向上させるために、著者らは、提案生成段階をRoI(Region of Interest)の分類段階から切り離し、共同トレーニングではなく個別のトレーニングを選択しました。このアプローチは、各段階の固有の特性を活用し、検出器の全体的な普遍性に貢献します。さらに、彼らはクラスに依存しない位置検出ネットワーク(CLN)を導入して一般化された領域提案を実現しました。 さらに、著者らは予測のバイアスを除去するための確率の補正技術を提案しています。彼らはすべてのカテゴリの事前確率を推定し、その事前確率に基づいて予測されたカテゴリの分布を調整します。この補正により、物体検出システム内の新しいクラスのパフォーマンスが大幅に改善されます。著者によれば、UniDetectorは最先端のCNN検出器であるDyheadを6.3% AP(平均適合率)で上回ることができます。 これは、ユニバーサルな物体検出のために設計された革新的なAIフレームワークであるUniDetectorの概要でした。もしこの研究に興味があり、詳細を知りたい場合は、以下のリンクをクリックしてさらなる情報を見つけることができます。

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.