Learn more about Search Results AI workflow - Page 13

- You may be interested

- TaatikNet(ターティクネット):ヘブライ...

- 自己対戦を通じて単純なゲームをマスター...

- 費用効率の高いGPT NeoXおよびPythiaモデ...

- マルチモーダルAI:見て聞くことができる...

- 「推薦エンジンの再構築」

- 不正行為はこれで終わり!Sapia.aiがAIに...

- ユーザーエクスペリエンスの向上:インタ...

- 「Nvidiaの画期的なAIイメージパーソナラ...

- このAI論文は、コントロール可能なマルチ...

- 「Objaverse-XLと出会ってください:1000...

- 「ODSC West Data PrimerシリーズでAIの学...

- あなたの究極のチャットGPTおよびその他の...

- アンソロピックは、以前のモデルと比べて...

- オラクルは、AIとクラウドを基盤とした未...

- 「私たちの独占的なDockerチートシートを...

Hugging FaceとFlowerを使用したフェデレーテッドラーニング

このチュートリアルでは、Hugging Faceを使用して、Flowerを介して複数のクライアント上で言語モデルのトレーニングをフェデレートする方法を紹介します。具体的には、IMDBの評価データセットを使用して、事前トレーニングされたTransformerモデル(distilBERT)をシーケンス分類のために微調整します。最終的な目標は、映画の評価がポジティブかネガティブかを検出することです。 ノートブックはこちらでご利用いただけますが、複数のクライアントで実行する代わりに、Google Colab内でフェデレーテッド環境をエミュレートするためにFlowerのシミュレーション機能(flwr['simulation'])を使用します(これはまた、start_serverを呼び出す代わりにstart_simulationを呼び出す必要があり、その他の変更が必要です)。 依存関係 このチュートリアルに従うためには、以下のパッケージをインストールする必要があります:datasets、evaluate、flwr、torch、およびtransformers。これはpipを使用して行うことができます: pip install datasets evaluate flwr torch transformers 標準的なHugging Faceのワークフロー データの処理 IMDBデータセットを取得するために、Hugging Faceのdatasetsライブラリを使用します。その後、データをトークン化し、PyTorchのデータローダーを作成する必要があります。これはすべてload_data関数で行われます: import random import torch from datasets…

Intel CPUのNNCFと🤗 Optimumを使用した安定したディフュージョンの最適化

潜在的な拡散モデルは、テキストから画像の生成問題を解決する際にゲームチェンジャーとなります。 安定した拡散は、コミュニティや産業界で広く採用されている最も有名な例の一つです。 安定した拡散モデルのアイデアはシンプルで魅力的です:ノイズベクトルから画像を複数の小さなステップで生成し、ノイズを潜在的な画像表現に洗練させます。 ただし、このようなアプローチは、全体的な推論時間を増加させ、クライアントマシンで展開された場合にユーザーエクスペリエンスの低下を引き起こします。 通常のように、強力なGPUがここで役立つことに注意することができますが、これに伴うコストも著しく増加します。 参考までに、H1’23では、8つのvCPUと64GBのRAMを備えた強力なCPU r6i.2xlargeインスタンスの価格は1時間あたり$0.504であり、同様のNVIDIA T4を搭載したg4dn.2xlargeインスタンスの価格は1時間あたり$0.75で、これは1.5倍以上です.. これにより、画像生成サービスは所有者とユーザーにとって非常に高価になります。 クライアントアプリケーションでは、GPUがまったくない場合もあります! これにより、安定した拡散パイプラインの展開は困難な問題となります。 過去5年間、OpenVINO Toolkitは高性能推論のための多くの機能をカプセル化しました。 最初はコンピュータビジョンモデルに設計されたものですが、現在でも最先端のモデルを含む多くのコンテンポラリーモデルにおいて、最高の推論パフォーマンスを示しています。 ただし、リソース制約のあるアプリケーションに安定した拡散モデルを最適化するには、ランタイム最適化にとどまらず、さらに進んだモデル最適化機能がOpenVINO Neural Network Compression Framework(NNCF)から必要とされます。 このブログ記事では、安定した拡散モデルの最適化の問題を概説し、CPUなどのリソース制約のあるHWで実行される場合に、そのようなモデルのレイテンシを大幅に削減するワークフローを提案します。 特に、PyTorchと比較して5.1倍の推論高速化と4倍のモデルフットプリントの削減を達成しました。 安定した拡散の最適化 安定した拡散パイプラインでは、UNetモデルが計算上最もコストがかかります。そのため、単一のモデルの最適化によって推論速度が大幅に向上します。 しかし、このモデルに対しては、従来のモデル最適化手法であるポストトレーニングの8ビット量子化は機能しないことがわかりました。その理由は2つあります。まず、セマンティックセグメンテーション、スーパーレゾリューションなどのピクセルレベル予測モデルは、タスクの複雑さにより、モデル最適化の観点では最も複雑なものの一つであり、モデルパラメータと構造の微調整が結果を多数の方法で崩してしまいます。…

エンドツーエンドのMLパイプラインの構築方法

コミュニティ内のMLエンジニアから最もよく聞かれる不満の1つは、モデルの構築と展開のMLワークフローを手動で行うことがどれだけ費用がかかり、エラーが発生しやすいかということです彼らはトレーニングデータを前処理するためにスクリプトを手動で実行し、展開スクリプトを再実行し、モデルを手動で調整し、働く時間を費やします...

ウェブと組み込みシステムにおけるRustの実行のための9つのルール

ユーザーの要求に応じて、私は最近、range-set-blazeというクレートをWebページ内で動作するように変換しましたまた、マイクロコントローラー(組み込み)でも動作するようにしました(range-set-blazeクレートは効率的に操作を行います...

Pythonプロジェクトのセットアップ:パートV

経験豊富な開発者であろうと、🐍 Pythonを始めたばかりであろうと、堅牢で保守性の高いプロジェクトの構築方法を知ることは重要ですこのチュートリアルでは、...のプロセスを案内します

デプロイ可能な機械学習パイプラインの構築

多くのデータサイエンティストは、最初のコーディング体験をノートブックスタイルのユーザーインターフェースを通じて行いますノートブックは、探索のために欠かせないものであり、私たちのワークフローの重要な要素ですしかし...

市民データサイエンティストとは誰で、何をするのでしょうか?

イントロダクション 今日のデータ駆動の世界において、データサイエンティストの役割は不可欠となっています。しかし、広大なデータセットに隠された謎を解くためには、データサイエンスのPh.D.を持つ必要はないと言ったらどうでしょうか?自己研鑽によって、正式な訓練を受けていないにもかかわらず、価値ある洞察を見出すスキルとツールを持つ新しいタイプの人材である「市民データサイエンティスト」の時代が到来しました。市民データサイエンティストは、形式的な訓練を受けていない普通の人々でありながら、データを行動可能な知識に変換する非凡な能力を持っており、組織が意思決定を行う方法を革新しています。本記事では、市民データサイエンティストの台頭、ビジネスへの影響、および彼らがもたらすエキサイティングな可能性について探求します。 市民データサイエンティストとは何か? 市民データサイエンティストとは、正式なデータサイエンスの訓練を受けていない個人でありながら、データを分析し洞察を導き出すスキルとツールを持っています。自己サービス型の分析プラットフォームや直感的なツールを活用して、データを探索し、モデルを構築し、データに基づく意思決定を行うことで、組織内でデータの力を民主化しています。 組織が彼らを雇うべき理由 データサイエンスは組織に著しい利益をもたらす広大な分野であり、市民データサイエンティストはデータの力を活用する上で重要な役割を担っています。以下は、企業が彼らを必要とする理由のいくつかです。 データ分析を簡素化する: 市民データサイエンティストは、さまざまな部門やチームに統合されており、特定のビジネスの課題に取り組み、それに関連するデータを探索することができます。これにより、より深い理解とより良い意思決定が可能になります。 ギャップを埋める: 彼らはドメインの専門知識とデータサイエンスの確固たる理解を持っており、技術的なスキルと業界知識をつなぐことができます。これにより、データ分析に文脈と洞察をもたらすことができます。 リアルタイムの洞察: 彼らはドメインの専門知識と自動分析ツールへのアクセス権を持っているため、リアルタイムでデータを分析し、意思決定者に迅速な洞察を提供することができます。これにより、組織は素早く対応し、機会をつかみ、リスクを効果的に軽減することができます。 フォースマルチプライヤー: 彼らはルーティンのデータ分析タスクを担当することで、データサイエンティストがより複雑な課題や戦略的なイニシアチブに注力できるようになります。彼らはフォースマルチプライヤーとして機能し、複数のチームをサポートし、全体的な生産性を向上させます。 ユニークな視点: 彼らは、データ分析に自分たちの多様な経験と専門知識をもたらし、新鮮な視点や革新的な問題解決アプローチを生み出すことができます。彼らのユニークな洞察は、しばしば新しい発見や改善された意思決定につながります。 アジャイルな実験: 市民データサイエンティストは、さまざまな分析手法を試行し、モデルを修正し、仮説をテストする柔軟性を持っています。彼らの適応力は、異なる分析手法を実験することでイノベーションを促進し、各自の分野での進歩を推進します。 必要な主要なスキル 市民データサイエンティストとして成功するために必要なスキルセットには、以下のような分析技術、技術的スキル、および専門的スキルが含まれます。 市民データサイエンティストは、Tableau、Power BI、またはMatplotlibやSeabornなどのPythonライブラリなどのプログラムを使用して、データを視覚的に解釈し、提示することができるようになっている必要があります。 彼らはデータを扱い、統計的手法を適用し、単純な機械学習モデルを開発するための基本的なプログラミングスキルを持っている必要があります。PythonやRなどのプログラミング言語に精通していることが有利です。 彼らはまた、統計学、データモデリング、データ可視化などのいくつかの分野に精通しており、データを評価・解釈し、より有用で効果的な洞察を生み出すことができます。…

ビジネスにおける機械学習オペレーションの構築

私のキャリアで気づいたことは、成功したAI戦略の鍵は機械学習モデルを本番環境に展開し、それによって商業的な可能性をスケールで解放する能力にあるということですしかし…

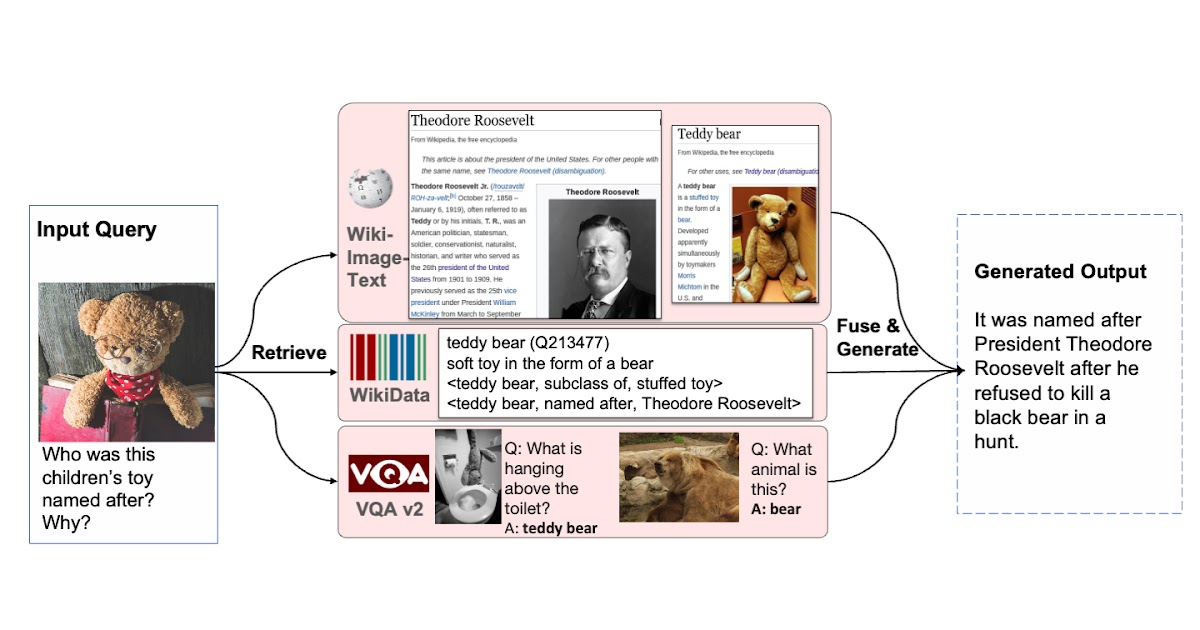

検索増強視覚言語事前学習

Google Research Perceptionチームの学生研究者Ziniu Huと研究科学者Alireza Fathiによる投稿 T5、GPT-3、PaLM、Flamingo、PaLIなどの大規模なモデルは、数百億のパラメータにスケーリングされ、大規模なテキストおよび画像データセットでトレーニングされると、多大な量の知識を格納する能力を示しました。これらのモデルは、画像キャプション、ビジュアルクエスチョンアンサリング、オープンボキャブラリー認識などのダウンストリームタスクで最先端の結果を達成しています。しかし、これらのモデルはトレーニングに膨大な量のデータを必要とし、数十億のパラメータ(多くの場合)を持ち、著しい計算要件を引き起こします。また、これらのモデルをトレーニングするために使用されるデータは古くなる可能性があり、世界の知識が更新されるたびに再トレーニングが必要になる場合があります。たとえば、2年前にトレーニングされたモデルは、現在のアメリカ合衆国大統領に関する古い情報を提供する可能性があります。 自然言語処理(RETRO、REALM)およびコンピュータビジョン(KAT)の分野では、検索増強モデルを使用してこれらの課題に取り組む研究がなされてきました。通常、これらのモデルは、単一のモダリティ(テキストのみまたは画像のみ)を処理できるバックボーンを使用して、知識コーパスから情報をエンコードおよび取得します。ただし、これらの検索増強モデルは、クエリと知識コーパスのすべての利用可能なモダリティを活用できず、モデルの出力を生成するために最も役立つ情報を見つけられない場合があります。 これらの問題に対処するために、「REVEAL:Retrieval-Augmented Visual-Language Pre-Training with Multi-Source Multimodal Knowledge Memory」(CVPR 2023に掲載予定)では、複数のソースのマルチモーダル「メモリ」を利用して知識集中型クエリに答えることを学ぶビジュアル言語モデルを紹介します。REVEALは、ニューラル表現学習を使用して、さまざまな知識ソースをキー-バリューペアから成るメモリ構造に変換し、エンコードします。キーはメモリアイテムのインデックスとして機能し、対応する値はそれらのアイテムに関する関連情報を格納します。トレーニング中、REVEALは、キーエンベッディング、値トークン、およびこのメモリから情報を取得する能力を学習して、知識集中型クエリに対処します。このアプローチにより、モデルパラメータは暗記に専念するのではなく、クエリに関する推論に焦点を当てることができます。 多様な知識ソースから複数の知識エントリを取得する能力を持つビジュアル言語モデルを拡張することで、生成を支援します。 マルチモーダル知識コーパスからのメモリ構築 私たちのアプローチは、異なるソースからの知識アイテムのキーと値のエンベッディングを事前に計算し、キー-バリューペアにエンコードして統一された知識メモリにインデックスするREALMと似ています。各知識アイテムは、より詳細に表現されたトークンエンベッディングのシーケンスである値としてエンコードされます。以前の研究とは異なり、REVEALは、WikiData知識グラフ、Wikipediaのパッセージと画像、Web画像テキストペア、ビジュアルクエスチョンアンサリングデータなど、多様なマルチモーダル知識コーパスを活用しています。各知識アイテムは、テキスト、画像、両方の組み合わせ(たとえば、Wikipediaのページ)、または知識グラフからの関係または属性(たとえば、バラク・オバマは6’2 “の背丈)の場合があります。トレーニング中、モデルパラメータが更新されるたびに、REVEALはキーと値のエンベッディングを連続的に再計算します。ステップごとにメモリを非同期に更新します。 圧縮を使用したメモリのスケーリング メモリ値をエンコードするための素朴な解決策は、各知識アイテムのトークンのすべてのシーケンスを保持することです。次に、モデルは、すべてのトークンを連結してトランスフォーマーエンコーダーデコーダーパイプラインに送信することで、入力クエリとトップkの取得されたメモリ値を融合することができます。このアプローチには2つの問題があります。1つ目は、数億の知識アイテムをメモリに保持する場合、各メモリ値が数百のトークンから構成されている場合、実用的ではないことです。2つ目は、トランスフォーマーエンコーダーが自己注意のために合計トークン数×kに対して2次の複雑度を持っていることです。そのため、Perceiverアーキテクチャを使用して知識アイテムをエンコードおよび圧縮することを提案しています。Perceiverモデルは、トランスフォーマーデコーダーを使用して、フルトークンシーケンスを任意の長さに圧縮します。これにより、kが100にもなるトップkメモリエントリを取得できます。 以下の図は、メモリのキー-バリューペアを構築する手順を示しています。各知識項目は、マルチモーダル視覚言語エンコーダを介して処理され、画像とテキストのトークンのシーケンスに変換されます。キー・ヘッドはこれらのトークンをコンパクトな埋め込みベクトルに変換します。バリュー・ヘッド(パーセプター)は、これらのトークンを少なくし、知識項目に関する適切な情報を保持します。 異なるコーパスからの知識エントリを統一されたキーとバリューの埋め込みペアにエンコードし、キーはメモリのインデックスに使用され、値にはエントリに関する情報が含まれます。…

データサイエンスのワークフローにChatGPTを統合する:ヒントとベストプラクティス

ChatGPT をデータサイエンスワークフローに統合したい場合は、以下の例とヒント、ベストプラクティスを参考にして、ChatGPT を最大限に活用してください

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.