Learn more about Search Results Clean Code - Page 12

- You may be interested

- 『究極の没入型視覚化とモデリング体験を...

- 「ChatGPTを活用したデータ探索:データセ...

- Amazon DocumentDBを使用して、Amazon Sag...

- 時系列予測のためのXGBoostの活用

- 「ChatGPTでより説得力を持つようになろう」

- PandasAIの紹介:GenAIを搭載したデータ分...

- 「FreedomGPT」という名称のAI技術をご紹...

- なぜAIチップの将来がニューロモーフィッ...

- AutoGPTQをご紹介します:GPTQアルゴリズ...

- AIを活用した「ディープフェイク」詐欺:...

- 「LangChainを使用したLLMアプリケーショ...

- ジェンスン・ファンのNvidiaがA.I. 革命を...

- 「LangchainなしでPDFチャットボットを構...

- ユーザーフィードバック – MLモニタ...

- LangChain チートシート — すべての秘密を...

5つのステップでScikit-learnを始める

このチュートリアルでは、Scikit-learnを使用した機械学習の包括的なハンズオンの手順を提供します読者は、データの前処理、モデルのトレーニングと評価、ハイパーパラメータのチューニング、およびパフォーマンスを向上させるためのアンサンブルモデルのコンパイルなど、キーコンセプトと技術を学びます

「Amazon Comprehendのカスタム分類を使用して分類パイプラインを構築する(パートI)」

このマルチシリーズのブログ投稿の最初のパートでは、スケーラブルなトレーニングパイプラインの作成方法と、Comprehendカスタム分類モデルのためのトレーニングデータの準備方法について学びます数回のクリックでAWSアカウントにデプロイできるカスタム分類トレーニングパイプラインを紹介します

「PandasAIを使用してデータを自動的に探索し、クリーンアップする方法」

「我々は、大規模言語モデル(LLM)の採用の最盛期にあります質問応答、リンク検索、日常のタスクの計画からコンテンツまで、私たちのテキスト要件のほとんどが迅速に提供されています...」

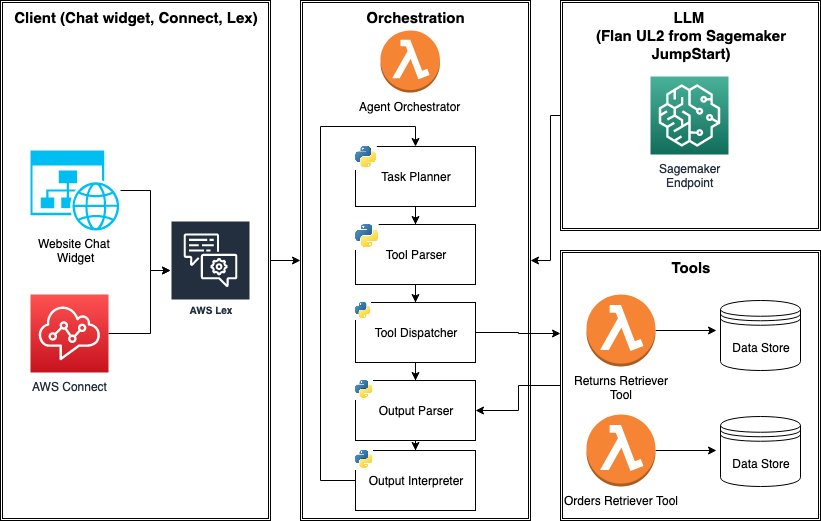

AWS SageMaker JumpStart Foundation Modelsを使用して、ツールを使用するLLMエージェントを構築し、展開する方法を学びましょう

大規模な言語モデル(LLM)エージェントは、1)外部ツール(API、関数、Webフック、プラグインなど)へのアクセスと、2)自己指導型のタスクの計画と実行の能力を持つ、スタンドアロンのLLMの機能を拡張するプログラムですしばしば、LLMは複雑なタスクを達成するために他のソフトウェア、データベース、またはAPIと対話する必要があります[...]

Amazon SageMakerで@remoteデコレータを使用してFalcon 7Bやその他のLLMを微調整する

今日、生成型AIモデルはテキスト要約、Q&A、画像やビデオの生成など、さまざまなタスクをカバーしています出力の品質を向上させるために、n-短期学習、プロンプトエンジニアリング、検索補完生成(RAG)およびファインチューニングなどの手法が使用されていますファインチューニングにより、これらの生成型AIモデルを調整して、ドメイン固有の改善されたパフォーマンスを達成することができます

「Amazon QuickSightでワードクラウドとしてAmazon Comprehendの分析結果を可視化する」

自由形式のテキスト文書のリポジトリで洞察を探すことは、藁の中の針を探すようなものです従来のアプローチでは、単語のカウントや他の基本的な分析を使用して文書を解析することがありますが、Amazon AIと機械学習(ML)ツールの力を活用することで、より深い内容の理解を得ることができます[…]

言語の壁を乗り越える シームレスなサポートのためにAmazon Translateでアプリケーションログを翻訳する

この投稿では、アプリケーションログが英語以外の言語で表示される場合に、開発者やサポートチームがデバッグやサポートを行う際に直面する課題について取り上げます提案される解決策は、CloudWatchの非英語ログを自動的にAmazon Translateを使用して翻訳し、解決策を環境に展開するためのステップバイステップのガイダンスを提供します

Amazon SageMakerドメインをVPCのみモードでサポートし、SageMaker Studioでの自動シャットダウンライフサイクル設定とTerraformでのSageMaker Canvasをサポートします

Amazon SageMakerのドメインは、SageMakerの機械学習(ML)環境をサポートしており、SageMaker StudioやSageMaker Canvasを含んでいますSageMaker Studioは、完全に統合された開発環境(IDE)であり、すべてのML開発ステップを実行するための特別なツールにアクセスできる単一のWebベースの視覚インターフェースを提供しますデータの準備からMLモデルの構築、トレーニング、展開まで、すべてのステップを行うことができます

「PandasAIを用いたデータ分析における生成型AIの活用」

「生成モデルを適用することで、PandasAIは人間のようなクエリを理解し、応答することができ、複雑なデータの操作を実行し、視覚的な表現を生成することができます」

TIIのFalcon 180B基本モデルは、Amazon SageMaker JumpStartを通じて利用可能です

今日は、テクノロジーイノベーション研究所(TII)が開発したFalcon 180B基礎モデルが、お客様がAmazon SageMaker JumpStartを通じて利用できることをお知らせいたしますこのモデルは、推論実行のためのワンクリック展開が可能ですFalcon 180Bは、1800億パラメータのサイズであり、3.5兆トークンの巨大なデータセットでトレーニングされていますFalcon 180Bは、公開された重みを持つ最大かつ最もパフォーマンスの高いモデルの一つですSageMaker JumpStartを使用して、このモデルをお試しいただけますSageMaker JumpStartは、アルゴリズム、モデル、および機械学習(ML)ソリューションへのアクセスを提供するMLハブであり、迅速にMLを始めることができますこの記事では、SageMaker JumpStartを介してFalcon 180Bモデルを発見して展開する方法について説明します

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.