Learn more about Search Results アダプタ - Page 10

- You may be interested

- 「CMUの研究者たちがRoboToolを公開:自然...

- 「MozillaがFirefoxに偽レビューチェッカ...

- OpenAIのAPIとBubbleを使用した4つのアプ...

- 拡散モデル:どのように拡散するのでしょ...

- 「フィンタスティック:3DアーティストがA...

- 「LLMsが幻覚を見るのを止めることはでき...

- 「プラネットデータとAmazon SageMakerの...

- 『Gradioを使ったリテンションの理解』

- 「ユートピアの再創造:デジタル時代の自...

- Googleの安全なAIフレームワークを紹介します

- 「FraudGPTと出会ってください:ChatGPTの...

- 「Microsoftの研究者がPIT(Permutation I...

- 『DeepHowのCEO兼共同創業者、サム・ジェ...

- 「イェール大学とGoogleの研究者が、効率...

- 『リンゴールド・ティルフォードアルゴリ...

DeepMindの最新研究(ICLR 2023)

来週は、2022年5月1日から5日までルワンダのキガリで開催される第11回国際学習表現会議(ICLR)の始まりを迎えますこれはアフリカで開催される初めての主要な人工知能(AI)の会議であり、パンデミックの始まり以来の初の対面イベントです世界中の研究者が集まり、AI、統計学、データサイエンスを含む深層学習の最先端の研究成果、およびマシンビジョン、ゲーム、ロボット工学を含む応用分野について共有します私たちはダイヤモンドスポンサーおよびDEIチャンピオンとして、この会議をサポートすることを誇りに思っています

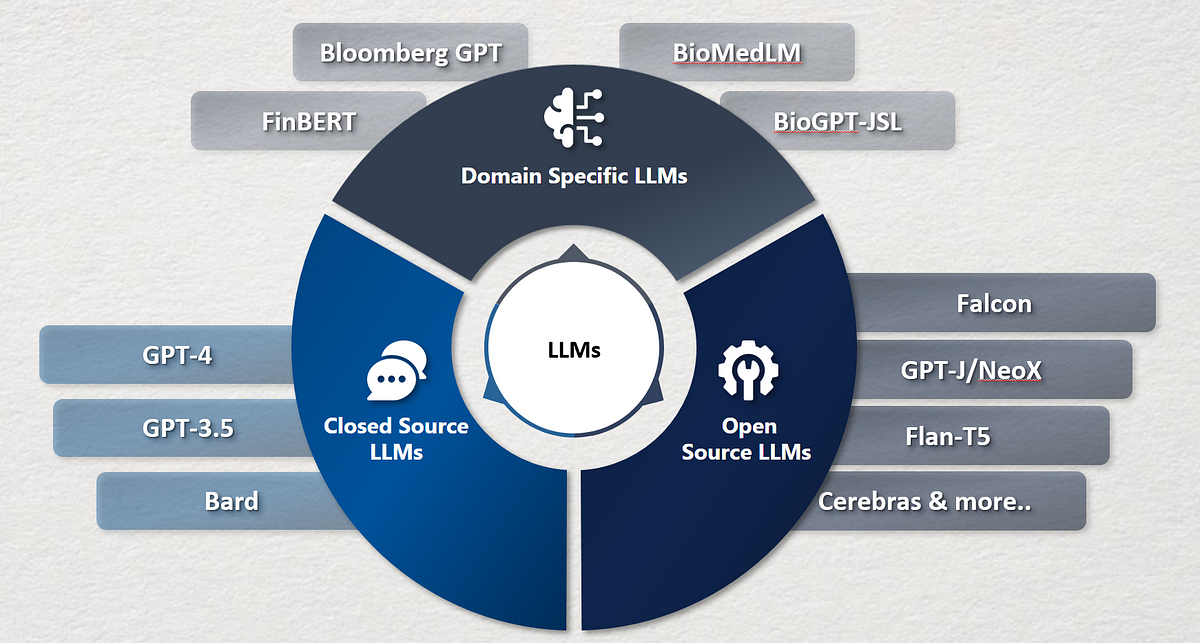

企業がOpenAIのChatGPTに類似した自社の大規模言語モデルを構築する方法

最近の数年間で、言語モデルは大きな注目を集め、自然言語処理、コンテンツ生成、仮想アシスタントなど、さまざまな分野を革新しました最も注目されているのは、

T5 テキストからテキストへのトランスフォーマー(パート2)

BERT [5] の提案により、自然言語処理(NLP)のための転移学習手法の普及がもたらされましたインターネット上での未ラベル化されたテキストの広範な利用可能性により、私たちは...

Google AIは、MediaPipe Diffusionプラグインを導入しましたこれにより、デバイス上で制御可能なテキストから画像生成が可能になります

最近、拡散モデルはテキストから画像を生成する際に非常に成功を収め、画像の品質、推論のパフォーマンス、および創造的な可能性の範囲の大幅な向上をもたらしています。しかし、効果的な生成管理は、特に言葉で定義しにくい条件下では依然として課題となっています。 Googleの研究者によって開発されたMediaPipe拡散プラグインにより、ユーザーの制御下でデバイス内でのテキストから画像の生成が可能になります。本研究では、デバイスそのもの上で大規模な生成モデルのGPU推論に関する以前の研究を拡張し、既存の拡散モデルおよびそのLow-Rank Adaptation(LoRA)のバリエーションに統合できるプログラマブルなテキストから画像の生成の低コストなソリューションを提供します。 拡散モデルでは、イテレーションごとに画像の生成が行われます。拡散モデルの各イテレーションは、ノイズが混入した画像から目標の画像までを生成することで始まります。テキストのプロンプトを通じた言語理解は、画像生成プロセスを大幅に向上させています。テキストの埋め込みは、テキストから画像の生成のためのモデルにリンクされ、クロスアテンション層を介して結びつけられます。ただし、物体の位置や姿勢などの詳細は、テキストのプロンプトを使用して伝えるのがより困難な例です。研究者は、条件画像からの制御情報を拡散に追加することで、拡散を利用して制御を導入します。 Plug-and-Play、ControlNet、およびT2Iアダプターの方法は、制御されたテキストから画像を生成するためによく使用されます。Plug-and-Playは、入力画像から状態をエンコードするために、拡散モデル(Stable Diffusion 1.5用の860Mパラメータ)のコピーと、広く使用されているノイズ除去拡散暗黙モデル(DDIM)逆推定手法を使用します。これにより、入力画像から初期ノイズ入力を導出します。コピーされた拡散からは、自己注意の空間特徴が抽出され、Plug-and-Playを使用してテキストから画像への拡散に注入されます。ControlNetは、拡散モデルのエンコーダーの訓練可能な複製を構築し、ゼロで初期化されたパラメータを持つ畳み込み層を介して接続し、条件情報をエンコードし、それをデコーダーレイヤーに渡します。残念ながら、これによりサイズが大幅に増加し、Stable Diffusion 1.5では約450Mパラメータとなり、拡散モデル自体の半分となります。T2I Adapterは、より小さなネットワーク(77Mパラメータ)であるにもかかわらず、制御された生成で同等の結果を提供します。条件画像のみがT2I Adapterに入力され、その結果がすべての後続の拡散サイクルで使用されます。ただし、このスタイルのアダプターはモバイルデバイス向けではありません。 MediaPipe拡散プラグインは、効果的かつ柔軟性があり、拡張性のある条件付き生成を実現するために開発されたスタンドアロンネットワークです。 訓練済みのベースラインモデルに簡単に接続できる、プラグインのようなものです。 オリジナルモデルからの重みを使用しないゼロベースのトレーニングです。 モバイルデバイス上でほとんど追加費用なしにベースモデルとは独立して実行可能なため、ポータブルです。 プラグインはそのネットワーク自体であり、その結果はテキストから画像への変換モデルに統合されます。拡散モデル(青)に対応するダウンサンプリング層は、プラグインから取得した特徴を受け取ります。 テキストから画像の生成のためのモバイルデバイス上でのポータブルなオンデバイスパラダイムであるMediaPipe拡散プラグインは、無料でダウンロードできます。条件付きの画像を取り込み、多スケールの特徴抽出を使用して、拡散モデルのエンコーダーに適切なスケールで特徴を追加します。テキストから画像への拡散モデルと組み合わせると、プラグインモデルは画像生成に条件信号を追加します。プラグインネットワークは、相対的にシンプルなモデルであるため、パラメータはわずか6Mとなっています。モバイルデバイスでの高速推論を実現するために、MobileNetv2は深度方向の畳み込みと逆ボトルネックを使用しています。 基本的な特徴 自己サービス機械学習のための理解しやすい抽象化。低コードAPIまたはノーコードスタジオを使用してアプリケーションを修正、テスト、プロトタイプ化、リリースするために使用します。 Googleの機械学習(ML)ノウハウを使用して開発された、一般的な問題に対する革新的なMLアプローチ。 ハードウェアアクセラレーションを含む完全な最適化でありながら、バッテリー駆動のスマートフォン上でスムーズに実行するために十分に小さく効率的です。

デバイス上での条件付きテキストから画像生成のための拡散プラグイン

Yang ZhaoとTingbo Houによる投稿、ソフトウェアエンジニア、Core ML 近年、拡散モデルはテキストから画像を生成する際に非常に成功を収め、高品質な画像、改善された推論パフォーマンス、そして創造的なインスピレーションの拡大を実現しています。しかし、特にテキストで説明しづらい条件での生成を効率的に制御することはまだ困難です。 本日、MediaPipe拡散プラグインを発表し、コントロール可能なテキストから画像をデバイス上で実行できるようにします。オンデバイスの大規模生成モデルにおけるGPU推論に関する以前の作業を拡張し、既存の拡散モデルとその低ランク適応(LoRA)バリアントにプラグインを追加し、コントロール可能なテキストから画像を生成するための低コストなソリューションを提供します。 デバイス上で動作するコントロールプラグインによるテキストからの画像生成。 背景 拡散モデルでは、画像生成はイテレーションのノイズ除去プロセスとしてモデル化されます。ノイズ画像から始め、各ステップで、拡散モデルは画像を徐々にノイズ除去して目標のコンセプトの画像を明らかにします。研究によると、テキストプロンプトを介した言語理解を活用することで、画像生成を大幅に改善できます。テキストから画像を生成する場合、テキストの埋め込みはモデルにクロスアテンションレイヤーを介して接続されます。しかし、位置や姿勢など、一部の情報はテキストプロンプトで説明することが難しいです。この問題を解決するために、研究者は拡散に追加のモデルを追加して、条件画像から制御情報を注入します。 制御されたテキストから画像を生成するための一般的なアプローチには、Plug-and-Play、ControlNet、T2I Adapterなどがあります。Plug-and-Playは、広く使用されているノイズ除去拡散暗黙モデル(DDIM)の逆操作アプローチを適用し、入力画像から初期ノイズ入力を導出し、拡散モデルのコピー(安定拡散1.5用の860Mパラメータ)を使用して入力画像から条件をエンコードします。Plug-and-Playは、コピーされた拡散から自己注意で空間特徴を抽出し、それらをテキストから画像への拡散に注入します。ControlNetは、拡散モデルのエンコーダーの学習可能なコピーを作成し、ゼロで初期化されたパラメータを持つ畳み込み層を介してデコーダーレイヤーに接続し、条件情報をエンコードします。しかし、その結果、サイズが大きく、拡散モデルの半分(安定拡散1.5用の430Mパラメータ)になります。T2I Adapterはより小さなネットワーク(77Mパラメータ)であり、制御可能な生成に似た効果を実現します。T2I Adapterは条件画像のみを入力とし、その出力はすべての拡散イテレーションで共有されます。ただし、アダプターモデルはポータブルデバイス向けに設計されていません。 MediaPipe拡散プラグイン 条件付き生成を効率的かつカスタマイズ可能、スケーラブルにするために、MediaPipe拡散プラグインを別個のネットワークとして設計しました。これは以下のような特徴を持っています: プラグ可能:事前にトレーニングされたベースモデルに簡単に接続できます。 スクラッチからトレーニング:ベースモデルの事前トレーニング済みの重みを使用しません。 ポータブル:ベースモデル外でモバイルデバイス上で実行され、ベースモデルの推論と比較して無視できるコストです。 メソッド パラメーターサイズ プラグ可能 スクラッチからトレーニング ポータブル Plug-and-Play…

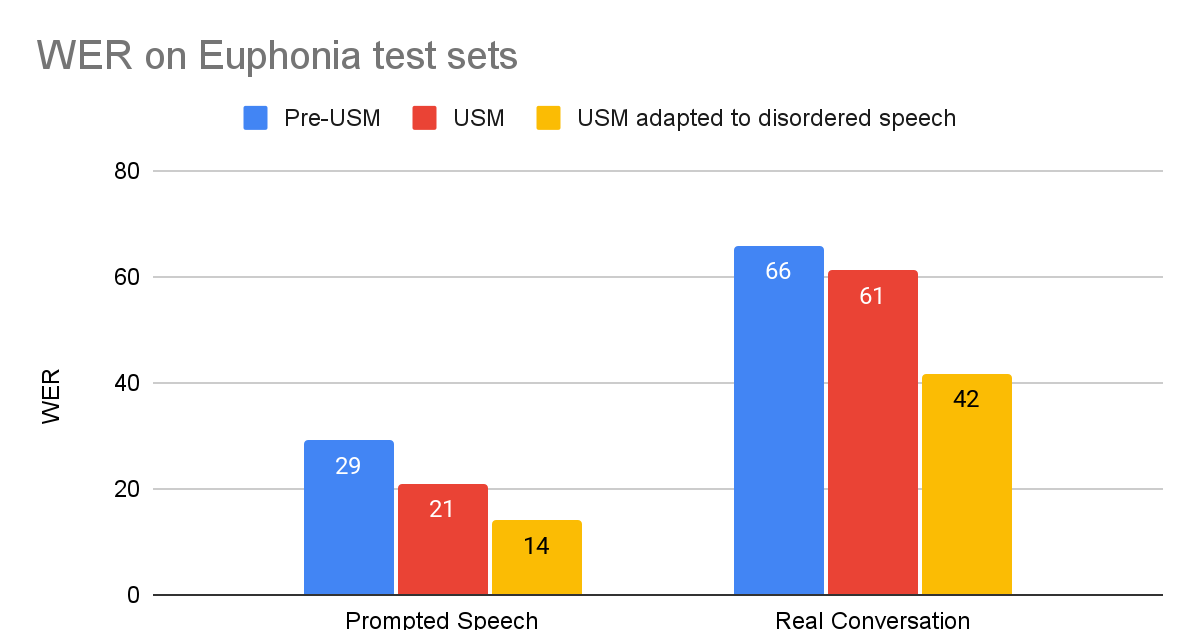

Google Researchにおける責任あるAI 社会的善のためのAI

Google Research、AI for Social GoodのソフトウェアエンジニアであるJimmy TobinとKatrin Tomanekが投稿しました。 GoogleのAI for Social Goodチームは、研究者、エンジニア、ボランティア、その他のメンバーが、ポジティブな社会的インパクトに焦点を合わせたチームです。私たちの使命は、公衆衛生、アクセシビリティ、危機対応、気候とエネルギー、自然と社会の各分野で、現実世界での価値を実現することによって、AIの社会的な利益を示すことです。私たちは、未開発なコミュニティに対してポジティブな変化をもたらす最良の方法は、変化をもたらす人々やその組織と協力することだと信じています。 このブログ記事では、AI for Social Good内のチームであるProject Euphoniaが行った作業について説明します。このチームは、障害のある人々のための自動音声認識(ASR)の改善を目的としています。通常の発話を持つ人々にとって、ASRモデルの単語エラー率(WER)は10%未満になることがありますが、吃音、失語症、失行症などの障害のある人々の場合、エチオロジーと重症度に応じてWERは50%または90%に達することがあります。この問題に対処するために、私たちは1,000人以上の参加者と協力して、1,000時間以上の障害のある音声サンプルを収集し、個人化されたASRが障害のある人々のパフォーマンスギャップを埋めるための実現可能な道であることを示しました。私たちは、レイヤー凍結技術を使用して、3〜4分のトレーニング音声で個人化が成功することを示しました。 この作業は、個人化された音声モデルを必要とする人々にとって有益であるProject Relateの開発につながりました。GoogleのSpeechチームと共同で構築されたProject Relateは、典型的な音声の理解が難しい人々が自分自身のモデルをトレーニングできるようにするものです。人々はこれらの個人化されたモデルを使用して、より効果的にコミュニケーションを取り、より独立した生活を送ることができます。ASRをよりアクセス可能で使いやすくするために、デジタルアシスタント技術、ディクテーションアプリ、および会話で使用するために、GoogleのUniversal Speech Model(USM)を調整する方法について説明します。 課題に対処する Project Relateのユーザーと緊密に連携して作業を行うことで、個人化されたモデルは非常に有用であることが明らかになりましたが、多くのユーザーにとって、数十または数百の例を記録することは困難です。さらに、個人化されたモデルは、自由形式の会話では常にうまく機能しなかったこともわかりました。…

AWSにおけるマルチモデルエンドポイントのためのCI/CD

生産用機械学習ソリューションの再トレーニングと展開を自動化することは、モデルが共変量シフトを考慮しながら、誤りや不要な人間の介入を制限するための重要なステップです

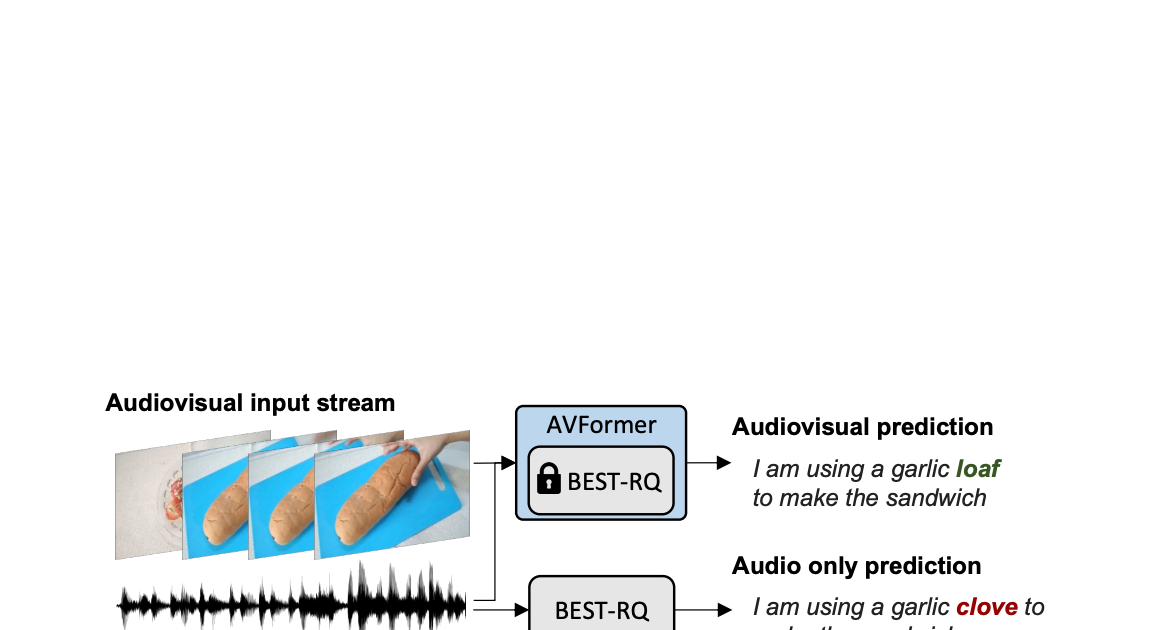

AVFormer:凍結した音声モデルにビジョンを注入して、ゼロショットAV-ASRを実現する

Google Researchの研究科学者、Arsha NagraniとPaul Hongsuck Seoによる投稿 自動音声認識(ASR)は、会議通話、ストリームビデオの転写、音声コマンドなど、さまざまなアプリケーションで広く採用されている確立された技術です。この技術の課題は、ノイズのあるオーディオ入力に集中していますが、マルチモーダルビデオ(テレビ、オンライン編集ビデオなど)の視覚ストリームはASRシステムの堅牢性を向上させる強力な手がかりを提供することができます。これをオーディオビジュアルASR(AV-ASR)と呼びます。 唇の動きは音声認識に強力な信号を提供し、AV-ASRの最も一般的な焦点であるが、野外のビデオで口が直接見えないことがよくあります(例えば、自己中心的な視点、顔のカバー、低解像度など)ため、新しい研究領域である拘束のないAV-ASR(AVATARなど)が誕生し、口の領域だけでなく、ビジュアルフレーム全体の貢献を調査しています。 ただし、AV-ASRモデルをトレーニングするためのオーディオビジュアルデータセットを構築することは困難です。How2やVisSpeechなどのデータセットはオンラインの教育ビデオから作成されていますが、サイズが小さいため、モデル自体は通常、ビジュアルエンコーダーとオーディオエンコーダーの両方から構成され、これらの小さなデータセットで過剰適合する傾向があります。それにもかかわらず、オーディオブックから取得した大量のオーディオデータを用いた大規模なトレーニングによって強く最適化された最近リリースされた大規模なオーディオモデルがいくつかあります。LibriLightやLibriSpeechなどがあります。これらのモデルには数十億のパラメータが含まれ、すぐに利用可能であり、ドメイン間で強い汎化性能を示します。 上記の課題を考慮して、私たちは「AVFormer:ゼロショットAV-ASRの凍結音声モデルにビジョンを注入する」と題した論文で、既存の大規模なオーディオモデルにビジュアル情報を付加するシンプルな方法を提案しています。同時に、軽量のドメイン適応を行います。AVFormerは、軽量のトレーニング可能なアダプタを使用して、視覚的な埋め込みを凍結されたASRモデルに注入します(Flamingoが大規模な言語モデルに視覚テキストタスクのためのビジュアル情報を注入する方法と似ています)。これにより、最小限の追加トレーニング時間とパラメータで弱くラベル付けられた少量のビデオデータでトレーニング可能です。トレーニング中のシンプルなカリキュラムスキームも紹介し、オーディオとビジュアルの情報を効果的に共同処理できるようにするために重要であることを示します。その結果、AVFormerモデルは、3つの異なるAV-ASRベンチマーク(How2、VisSpeech、Ego4D)で最新のゼロショットパフォーマンスを達成し、同時に伝統的なオーディオのみの音声認識ベンチマーク(LibriSpeechなど)のまともなパフォーマンスを保持しています。 拘束のないオーディオビジュアル音声認識。軽量モジュールを使用して、ビジョンを注入して、オーディオビジュアルASRのゼロショットを実現するために、Best-RQ(灰色)の凍結音声モデルにビジョンを注入します。AVFormer(青)というパラメーターとデータ効率の高いモデルが作成されます。オーディオ信号がノイズの場合、視覚的なパンの生成トランスクリプトでオンリーミステイク「クローブ」を「ローフ」に修正するのに役立つ視覚的なパンが役立つ場合があります。 軽量モジュールを使用してビジョンを注入する 私たちの目標は、既存のオーディオのみのASRモデルにビジュアル理解能力を追加しながら、その汎化性能を各ドメイン(AVおよびオーディオのみのドメイン)に維持することです。 このために、既存の最新のASRモデル(Best-RQ)に次の2つのコンポーネントを追加します:(i)線形ビジュアルプロジェクター、および(ii)軽量アダプター。前者は、オーディオトークン埋め込みスペースにおける視覚的な特徴を投影します。このプロセスにより、別々に事前トレーニングされたビジュアル機能とオーディオ入力トークン表現を適切に接続することができます。後者は、その後最小限の変更で、ビデオのマルチモーダル入力を理解するためにモデルを変更します。その後、これらの追加モジュールを、HowTo100Mデータセットからのラベル付けされていないWebビデオとASRモデルの出力を擬似グラウンドトゥルースとして使用してトレーニングし、Best-RQモデルの残りを凍結します。このような軽量モジュールにより、データ効率と強力なパフォーマンスの汎化が可能になります。 我々は、AV-ASRベンチマークにおいて、モデルが人手で注釈付けされたAV-ASRデータセットで一度もトレーニングされていないゼロショット設定で、拡張モデルを評価しました。 ビジョン注入のためのカリキュラム学習 初期評価後、私たちは経験的に、単純な一回の共同トレーニングでは、モデルがアダプタとビジュアルプロジェクタの両方を一度に学習するのが困難であることがわかりました。この問題を緩和するために、私たちは、これら2つの要因を分離し、ネットワークを順序良くトレーニングする2段階のカリキュラム学習戦略を導入しました。最初の段階では、アダプタパラメータが全くフィードされずに最適化されます。アダプタがトレーニングされたら、ビジュアルトークンを追加し、トレーニング済みのアダプタを凍結したまま第2段階でビジュアルプロジェクションレイヤーのみをトレーニングします。 最初の段階は、音声ドメイン適応に焦点を当てています。第2段階では、アダプタが完全に凍結され、ビジュアルプロジェクタは、ビジュアルトークンをオーディオ空間に投影するためのビジュアルプロンプトを生成することを学習する必要があります。このように、私たちのカリキュラム学習戦略は、モデルがAV-ASRベンチマークでビジュアル入力を統合し、新しい音声ドメインに適応することを可能にします。私たちは、交互に適用する反復的な適用では性能が低下するため、各段階を1回だけ適用します。 AVFormerの全体的なアーキテクチャとトレーニング手順。アーキテクチャは、凍結されたConformerエンコーダー・デコーダーモデル、凍結されたCLIPエンコーダー(グレーのロックシンボルで示される凍結層を持つ)、および2つの軽量トレーニング可能なモジュールで構成されています。-(i)ビジュアルプロジェクションレイヤー(オレンジ)およびボトルネックアダプタ(青)を有効にし、多モーダルドメイン適応を可能にします。私たちは、2段階のカリキュラム学習戦略を提案しています。最初に、アダプタ(青)をビジュアルトークンなしでトレーニングします。その後、ビジュアルプロジェクションレイヤー(オレンジ)を調整し、他のすべての部分を凍結したままトレーニングします。 下のプロットは、カリキュラム学習なしでは、AV-ASRモデルがすべてのデータセットでオーディオのみのベースラインよりも劣っており、より多くのビジュアルトークンが追加されるにつれてその差が拡大することを示しています。一方、提案された2段階のカリキュラムが適用されると、AV-ASRモデルは、オーディオのみのベースラインよりも遥かに優れたパフォーマンスを発揮します。 カリキュラム学習の効果。赤と青の線はオーディオビジュアルモデルであり、ゼロショット設定で3つのデータセットに表示されます(WER%が低い方が良いです)。カリキュラムを使用すると、すべての3つのデータセットで改善します(How2(a)およびEgo4D(c)では、オーディオのみのパフォーマンスを上回るために重要です)。4つのビジュアルトークンまで性能が向上し、それ以降は飽和します。 ゼロショットAV-ASRでの結果 私たちは、How2、VisSpeech、Ego4Dの3つのAV-ASRベンチマークで、zero-shotパフォーマンスのために、BEST-RQ、私たちのモデルの音声バージョン、およびAVATARを比較しました。AVFormerは、すべてのベンチマークでAVATARとBEST-RQを上回り、BEST-RQでは600Mパラメータをトレーニングする必要がありますが、AVFormerはわずか4Mパラメータしかトレーニングせず、トレーニングデータセットのわずか5%しか必要としません。さらに、音声のみのLibriSpeechでのパフォーマンスも評価し、AVFormerは両方のベースラインを上回ります。 AV-ASRデータセット全体におけるゼロショット性能に対する最新手法との比較。音声のみのLibriSpeechのパフォーマンスも示します。結果はWER%(低い方が良い)として報告されています。 AVATARとBEST-RQはHowTo100Mでエンドツーエンド(すべてのパラメータ)で微調整されていますが、AVFormerは微調整されたパラメータの少ないセットのおかげで、データセットの5%でも効果的に機能します。…

AWS Inferentia2は、AWS Inferentia1をベースにしており、スループットが4倍に向上し、レイテンシが10倍低減されています

機械学習モデル(MLモデル)のサイズ、特に生成AIにとって、大規模言語モデル(LLM)やファウンデーションモデル(FM)のサイズは年々急速に増加しており、これらのモデルにはより高速で強力なアクセラレータが必要ですAWS Inferentia2は、LLMや生成AIの推論のコストを下げつつ、より高いパフォーマンスを提供するように設計されましたこの[...]

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.

.jpg)