Learn more about Search Results OPT - Page 107

- You may be interested

- 「5分でPythonとTkinterを使用してシンプ...

- 特定のタスクに最適に適合するニューラル...

- お楽しみはいかがですか?データサイエン...

- 「咳の音を分析してCOVID-19患者の重症度...

- 「GoogleのDeblur AI:画像をシャープにす...

- オープンソースとオープンイノベーション...

- 「MC-JEPAに会おう:動きと内容の特徴の自...

- 「すべてのデータを理解する」

- 「イギリスのテックフェスティバルが、ク...

- 「テキスト分析の未来を明らかにする BERT...

- ワビとトロント大学の研究者が、オートラ...

- AIフロンティアシリーズ:人材

- 「ToolJetに会いましょう:最小限のエンジ...

- 「なりすまし検出機能は、ソーシャルメデ...

- 中国からのニューエーアイ研究は、GLM-130...

極小データセットを用いたテキスト分類チャレンジ:ファインチューニング対ChatGPT

Toloka MLチームは、さまざまな条件下でのテキスト分類の異なるアプローチを継続的に研究し比較していますここでは、NLPのパフォーマンスに関する私たちの別の実験をご紹介します

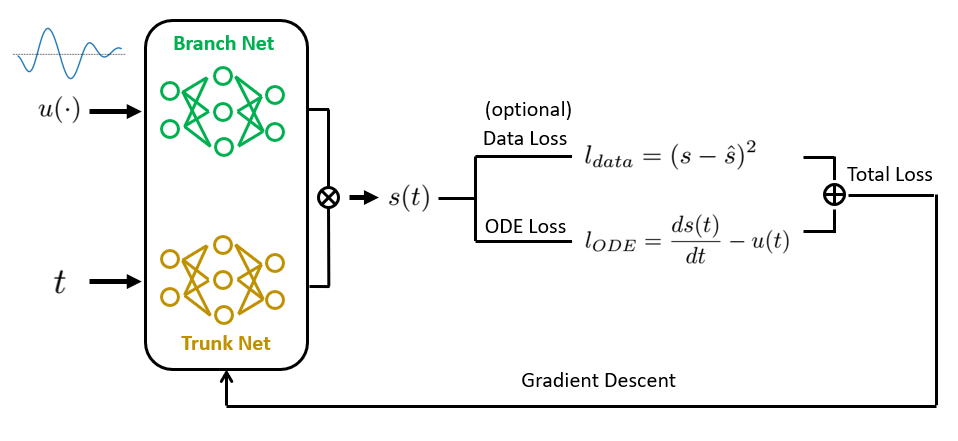

物理情報を組み込んだDeepONetによるオペレータ学習 ゼロから実装しましょう

普通微分方程式と偏微分方程式(ODEs / PDEs)は、物理学や生物学から経済学や気候科学まで、科学と工学の多くの分野の基礎ですそれらは...

Amazon SageMakerを使用してSaaSプラットフォームを統合し、MLパワードアプリケーションを実現します

Amazon SageMakerは、データの受け入れ、変換、バイアスの測定、モデルのトレーニング、展開、および本番環境でのモデルの管理といった幅広い機能を備えたエンドツーエンドの機械学習(ML)プラットフォームですAmazon SageMaker Data Wrangler、Amazon SageMaker Studio、Amazon SageMaker Canvas、Amazon SageMaker Model Registry、Amazon SageMaker Feature Store、Amazon SageMakerなど、Amazon SageMakerは、最高クラスのコンピューティングとサービスを提供しています

「私のお気に入りの3Dアプリ」:Blenderファンが今週「NVIDIA Studio」で彼の日本インスパイアされたシーンを共有

編集者の注:この投稿は、週刊NVIDIA Studioシリーズの一部であり、注目されるアーティストを称え、クリエイティブなヒントやトリックを提供し、NVIDIA Studioテクノロジーがクリエイティブなワークフローを向上させる方法を示します。また、新しいGeForce RTX 40シリーズGPUの機能、技術、リソースについて詳しく解説し、コンテンツの作成を劇的に加速する方法についても掘り下げています。 多様なアーティスト、ファッショニスタ、ミュージシャン、映画芸術家によって、Pedro Soares(通称Blendeered)の創造的な旅がインスピレーションを受け、彼は3Dを使った芸術創造に夢中になりました。 今では、ポルトガルのポルトに拠点を置くアーティストは、自分自身の人生の経験や人々との交流を通じて、彼の芸術的なビジョンを実現するために、芸術的なバックグラウンドに関係なく、人々を活かしています。 日本の文化に魅了されたBlendeeredは、常に芸術的なインスピレーションを提供してくれる強大な存在である動物に捧げられた古い日本の寺院の表現を試みました。その結果、BlenderとBlackmagic DesignのDaVinci Resolveを使用して作成された短編アニメーション「Japanese Temple Set」が、今週のIn the NVIDIA Studioの対象となりました。 https://blogs.nvidia.com/wp-content/uploads/2023/07/nvidia-studio-itns-wk64-pedro-soares-1280w-clip1.mp4 さらに、NVIDIA RTX GPUを搭載したWondershare FilmoraとTrimble SketchUp Goという2つのクラウドベースのAIアプリをご紹介し、コンテンツの作成を向上させる方法や自動化の方法について学んでください。…

Taipy:ユーザーフレンドリーな本番用データサイエンティストアプリケーションを構築するためのツール

データサイエンティストとして、データの視覚化のためのダッシュボードを作成したり、データを視覚化したり、さらにはビジネスアプリケーションを実装して利害関係者が実行可能な意思決定を行うのをサポートするかもしれません

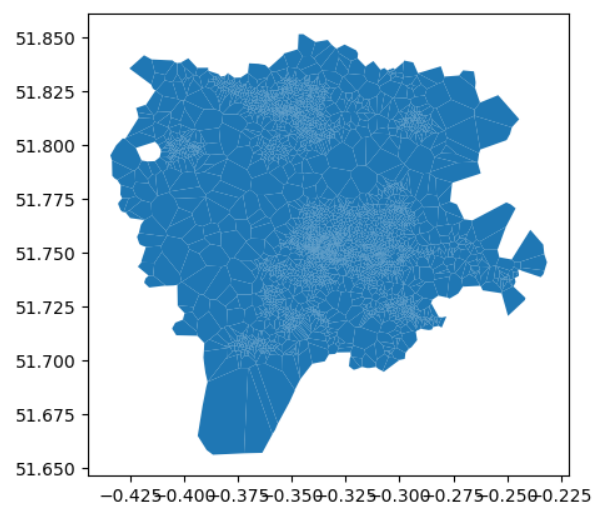

郵便番号レベルでの地理空間データの操作

一部の国では、郵便番号は地域ではなく、ポイントやルートで表されます例えば、カナダの郵便番号の最後の3桁は、地域配送ユニットに対応していて、それは一つの家に対応するかもしれません...

JavaScriptを使用してOracleデータベース内からHugging Face AIを呼び出す方法

JavaScriptとオープンソースを使用して完全に無料でAIアーキテクチャを最適化し、SQL、JSON、またはRESTを使用して同じデータにアクセスしてください

LangChain:LLMがあなたのコードとやり取りできるようにします

生成モデルは皆の注目を集めています現在、多くのAIアプリケーションでは、機械学習の専門家ではなく、API呼び出しの実装方法を知っているだけで済むことが増えています最近の例としては、私は...

T5 テキストからテキストへのトランスフォーマー(パート2)

BERT [5] の提案により、自然言語処理(NLP)のための転移学習手法の普及がもたらされましたインターネット上での未ラベル化されたテキストの広範な利用可能性により、私たちは...

ゼロから大規模言語モデルを構築するための初心者ガイド

はじめに TwitterやLinkedInなどで、私は毎日多くの大規模言語モデル(LLMs)に関する投稿に出会います。これらの興味深いモデルに対してなぜこれほど多くの研究と開発が行われているのか、私は疑問に思ったこともあります。ChatGPTからBARD、Falconなど、無数のモデルの名前が飛び交い、その真の性質を解明したくなるのです。これらのモデルはどのように作成されるのでしょうか?大規模言語モデルを構築するにはどうすればよいのでしょうか?これらのモデルは、あなたが投げかけるほとんどの質問に答える能力を持つのはなぜでしょうか?これらの燃えるような疑問は私の心に長く残り、好奇心をかき立てています。この飽くなき好奇心は私の内に火をつけ、LLMsの領域に飛び込む原動力となっています。 私たちがLLMsの最先端について議論する刺激的な旅に参加しましょう。一緒に、彼らの開発の現状を解明し、彼らの非凡な能力を理解し、彼らが言語処理の世界を革新した方法に光を当てましょう。 学習目標 LLMsとその最新の状況について学ぶ。 利用可能なさまざまなLLMsとこれらのLLMsをゼロからトレーニングするアプローチを理解する。 LLMsのトレーニングと評価におけるベストプラクティスを探究する。 準備はいいですか?では、LLMsのマスタリングへの旅を始めましょう。 大規模言語モデルの簡潔な歴史 大規模言語モデルの歴史は1960年代にさかのぼります。1967年にMITの教授が、自然言語を理解するための最初のNLPプログラムであるElizaを作成しました。Elizaはパターンマッチングと置換技術を使用して人間と対話し理解することができます。その後、1970年にはMITチームによって、人間と対話し理解するための別のNLPプログラムであるSHRDLUが作成されました。 1988年には、テキストデータに存在するシーケンス情報を捉えるためにRNNアーキテクチャが導入されました。2000年代には、RNNを使用したNLPの研究が広範に行われました。RNNを使用した言語モデルは当時最先端のアーキテクチャでした。しかし、RNNは短い文にはうまく機能しましたが、長い文ではうまく機能しませんでした。そのため、2013年にはLSTMが導入されました。この時期には、LSTMベースのアプリケーションで大きな進歩がありました。同時に、アテンションメカニズムの研究も始まりました。 LSTMには2つの主要な懸念がありました。LSTMは長い文の問題をある程度解決しましたが、実際には非常に長い文とはうまく機能しませんでした。LSTMモデルのトレーニングは並列化することができませんでした。そのため、これらのモデルのトレーニングには長い時間がかかりました。 2017年には、NLPの研究において Attention Is All You Need という論文を通じてブレークスルーがありました。この論文はNLPの全体的な景色を変革しました。研究者たちはトランスフォーマーという新しいアーキテクチャを導入し、LSTMに関連する課題を克服しました。トランスフォーマーは、非常に多数のパラメータを含む最初のLLMであり、LLMsの最先端モデルとなりました。今日でも、LLMの開発はトランスフォーマーに影響を受けています。 次の5年間、トランスフォーマーよりも優れたLLMの構築に焦点を当てた重要な研究が行われました。LLMsのサイズは時間とともに指数関数的に増加しました。実験は、LLMsのサイズとデータセットの増加がLLMsの知識の向上につながることを証明しました。そのため、BERT、GPTなどのLLMsや、GPT-2、GPT-3、GPT 3.5、XLNetなどのバリアントが導入され、パラメータとトレーニングデータセットのサイズが増加しました。 2022年には、NLPにおいて別のブレークスルーがありました。 ChatGPT は、あなたが望むことを何でも答えることができる対話最適化されたLLMです。数か月後、GoogleはChatGPTの競合製品としてBARDを紹介しました。…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.